Unveiling Language Competence Neurons: A Psycholinguistic Approach to Model Interpretability

作者: Xufeng Duan, Xinyu Zhou, Bei Xiao, Zhenguang G. Cai

分类: cs.CL

发布日期: 2024-09-24 (更新: 2024-12-11)

💡 一句话要点

利用心理语言学范式揭示语言模型中蕴含语言能力的神经元

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 可解释性 心理语言学 神经元分析 语言能力

📋 核心要点

- 现有大型语言模型的语言能力理解不足,缺乏神经元层面的深入分析。

- 该研究利用心理语言学范式,通过任务探究模型神经元与特定语言能力的关联。

- 实验发现GPT-2-XL在特定任务中展现出人类水平能力,并识别出对应能力的特定神经元。

📝 摘要(中文)

随着大型语言模型(LLMs)在语言能力方面的进步,理解它们如何捕捉语言能力的各个方面仍然是一个重大挑战。因此,本研究在英语中采用了心理语言学范式,这些范式非常适合探测语言处理的更深层次的认知方面,从而探索语言模型中神经元级别的表征,涉及三个任务:声音-形状关联、声音-性别关联和内隐因果关系。我们的研究结果表明,虽然GPT-2-XL在声音-形状任务中表现不佳,但它在声音-性别关联和内隐因果关系方面表现出类似人类的能力。目标神经元消融和激活操作揭示了一个关键关系:当GPT-2-XL表现出一种语言能力时,特定的神经元与该能力相对应;相反,缺乏这种能力表明缺乏专门的神经元。本研究首次利用心理语言学实验来研究神经元层面的深层语言能力,为模型可解释性提供了新的粒度,并深入了解了基于Transformer的LLM中驱动语言能力的内部机制。

🔬 方法详解

问题定义:该论文旨在解决大型语言模型(LLMs)内部如何表征和处理语言能力的问题。现有方法难以深入理解LLMs的内部机制,尤其是在神经元层面。缺乏有效的手段来识别和理解哪些神经元负责特定的语言能力,以及这些神经元如何协同工作。

核心思路:论文的核心思路是借鉴心理语言学的方法,将人类在语言处理方面的认知能力作为探针,来分析LLMs的神经元活动。通过设计特定的心理语言学任务,观察模型在这些任务中的表现,并分析与这些任务相关的神经元,从而揭示模型内部的语言能力表征。

技术框架:该研究的技术框架主要包括以下几个阶段: 1. 任务设计:设计三个心理语言学任务:声音-形状关联、声音-性别关联和内隐因果关系。 2. 模型测试:使用GPT-2-XL模型在这些任务上进行测试,评估其表现。 3. 神经元分析:对模型中与特定任务相关的神经元进行识别和分析,包括神经元激活模式、神经元之间的连接等。 4. 神经元干预:通过神经元消融(neuron ablation)和激活操作(activation manipulation)来验证特定神经元与特定语言能力之间的因果关系。

关键创新:该研究最重要的技术创新点在于将心理语言学实验引入到LLMs的可解释性研究中。与传统的模型分析方法不同,该研究从人类认知角度出发,设计了更具针对性的实验,从而能够更深入地理解模型内部的语言能力表征。这是首次在神经元层面研究深层语言能力。

关键设计: * 心理语言学任务选择:选择了声音-形状关联、声音-性别关联和内隐因果关系三个任务,这些任务分别代表了不同的语言能力,例如语音感知、语义理解和推理能力。 * 神经元消融和激活操作:通过选择性地移除或激活特定神经元,观察模型在任务中的表现变化,从而确定这些神经元是否对该任务至关重要。 * 统计分析:使用统计方法分析神经元激活模式与模型表现之间的关系,例如相关性分析、回归分析等。

🖼️ 关键图片

📊 实验亮点

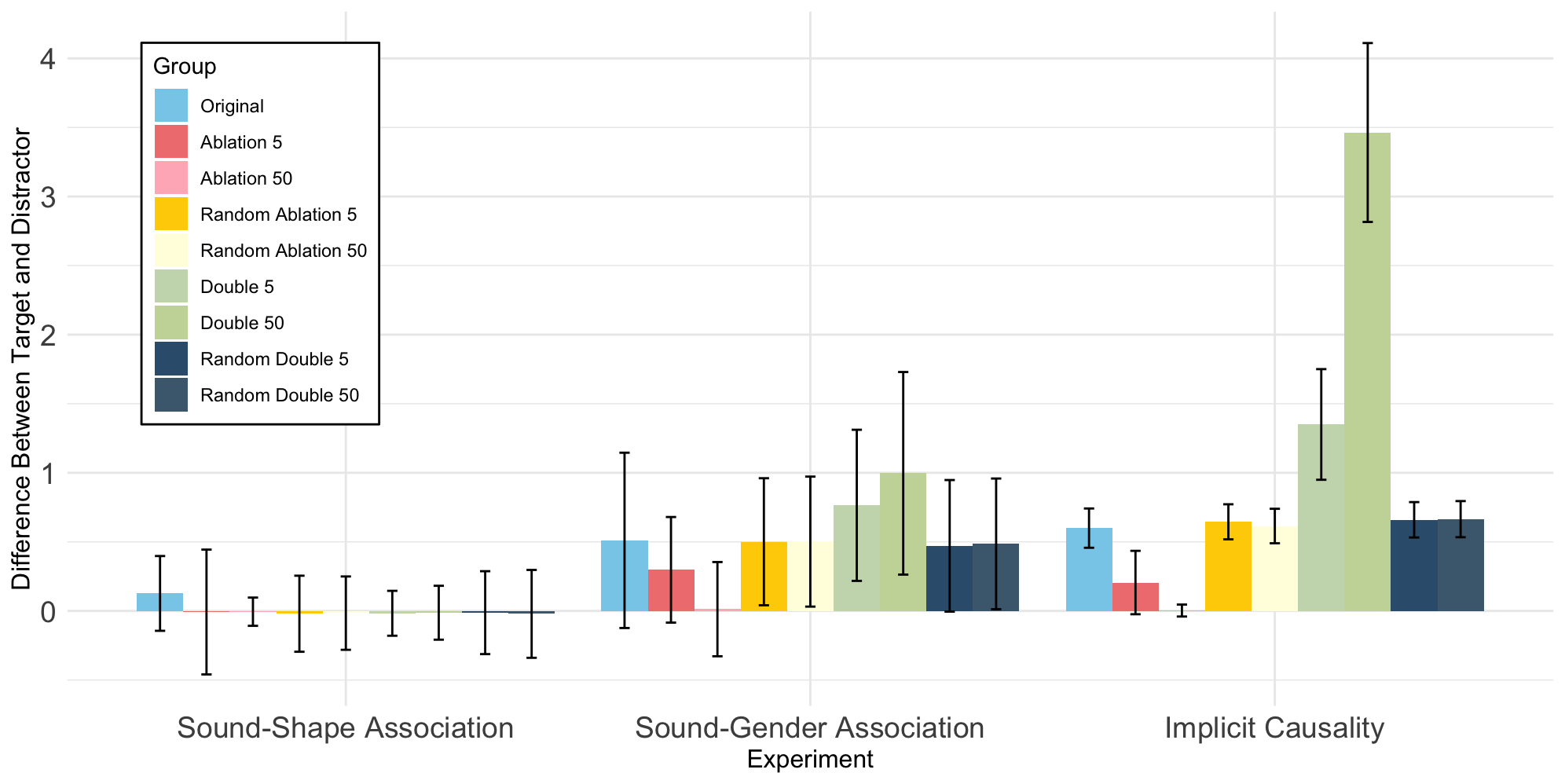

实验结果表明,GPT-2-XL在声音-性别关联和内隐因果关系任务中表现出类似人类的能力,但在声音-形状关联任务中表现不佳。通过神经元消融和激活操作,研究人员识别出与特定语言能力相关的特定神经元。例如,当GPT-2-XL展现出某种语言能力时,特定的神经元与该能力相对应;反之,缺乏这种能力则表明缺乏专门的神经元。

🎯 应用场景

该研究成果可应用于提升大型语言模型的可解释性和可控性。通过理解模型内部神经元的功能,可以更好地诊断模型的问题,并进行针对性的改进。此外,该研究还可以为开发更高效、更可靠的语言模型提供新的思路,例如通过模拟人类大脑的语言处理机制来设计模型结构。

📄 摘要(原文)

As large language models (LLMs) advance in their linguistic capacity, understanding how they capture aspects of language competence remains a significant challenge. This study therefore employs psycholinguistic paradigms in English, which are well-suited for probing deeper cognitive aspects of language processing, to explore neuron-level representations in language model across three tasks: sound-shape association, sound-gender association, and implicit causality. Our findings indicate that while GPT-2-XL struggles with the sound-shape task, it demonstrates human-like abilities in both sound-gender association and implicit causality. Targeted neuron ablation and activation manipulation reveal a crucial relationship: When GPT-2-XL displays a linguistic ability, specific neurons correspond to that competence; conversely, the absence of such an ability indicates a lack of specialized neurons. This study is the first to utilize psycholinguistic experiments to investigate deep language competence at the neuron level, providing a new level of granularity in model interpretability and insights into the internal mechanisms driving language ability in the transformer-based LLM.