Interpreting Arithmetic Mechanism in Large Language Models through Comparative Neuron Analysis

作者: Zeping Yu, Sophia Ananiadou

分类: cs.CL

发布日期: 2024-09-21

备注: Accepted by EMNLP 2024 main. Mechanistic interpretability for arithmetic tasks in large language models

🔗 代码/项目: GITHUB

💡 一句话要点

通过比较神经元分析解读大语言模型中的算术机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 算术机制 神经元分析 可解释性 模型剪枝 模型编辑 注意力机制

📋 核心要点

- 现有方法难以深入理解大语言模型中算术能力的内在机制,阻碍了模型优化和可控性。

- 提出比较神经元分析(CNA)方法,揭示了算术运算在模型内部的逻辑链和关键神经元。

- 实验表明,该方法可用于模型剪枝和编辑,例如减少性别偏见,验证了其有效性。

📝 摘要(中文)

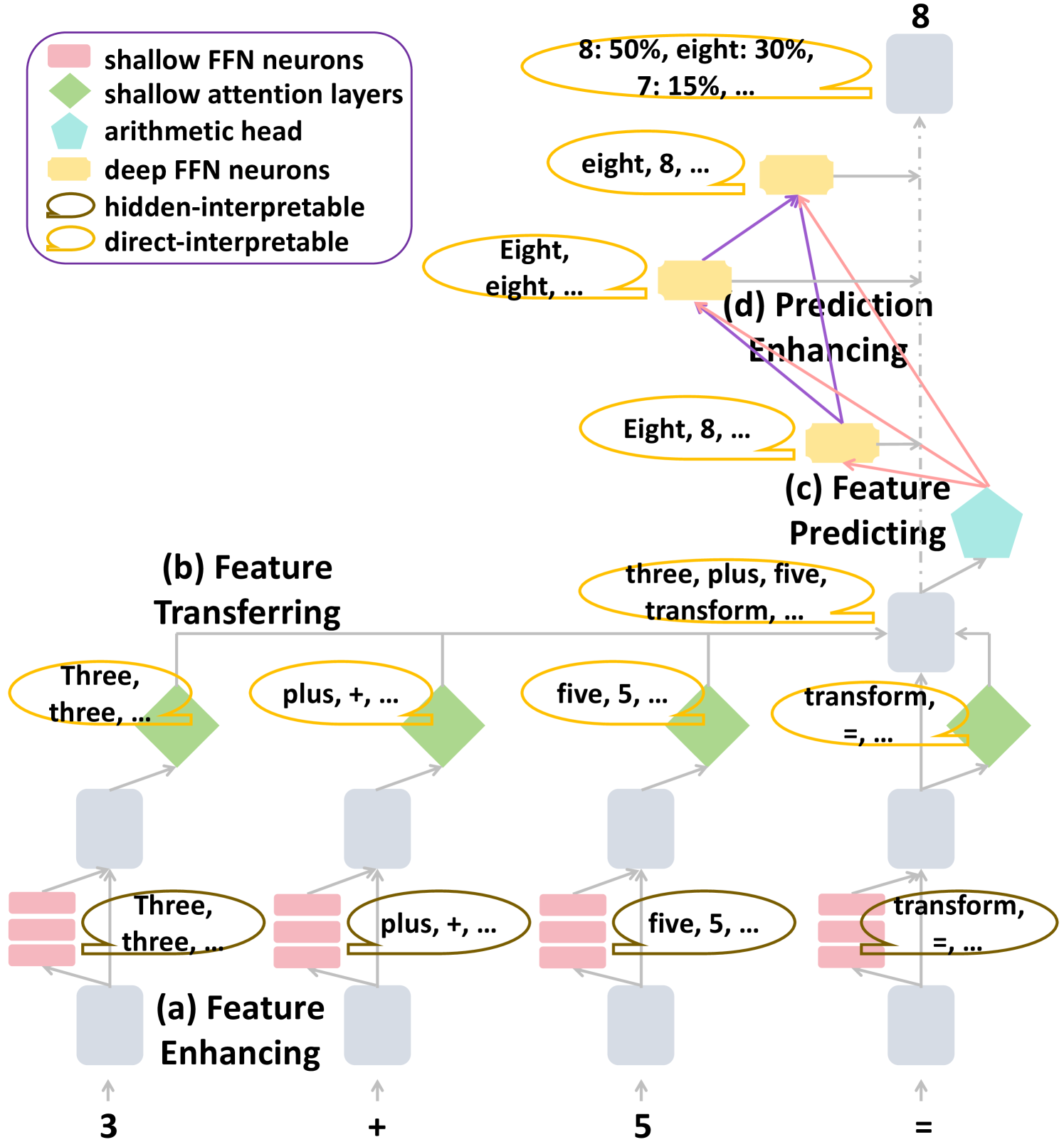

我们发现大语言模型的算术能力集中在少数注意力头上,每个头专门负责不同的运算。为了深入研究其原因,我们引入了比较神经元分析(CNA)方法,该方法识别出一个从输入到预测的内部逻辑链,包含四个不同的阶段:使用浅层FFN神经元进行特征增强、通过浅层注意力层进行特征转移、通过算术头进行特征预测,以及在深层FFN神经元中进行预测增强。此外,我们还识别了特征增强和特征预测阶段中人类可解释的FFN神经元。这些发现促使我们研究LoRA的机制,揭示了它通过放大与预测相关的FFN神经元的系数得分来增强预测概率。最后,我们将我们的方法应用于算术任务的模型剪枝和减少性别偏见的模型编辑。

🔬 方法详解

问题定义:现有方法难以解释大型语言模型(LLM)中算术能力的运作机制。虽然LLM在算术任务上表现出色,但我们对其内部如何执行这些计算知之甚少。这使得我们难以优化模型,并可能导致不可预测的行为,例如在涉及敏感属性(如性别)的算术任务中出现偏差。因此,需要一种方法来深入了解LLM的算术机制,以便更好地控制和改进它们。

核心思路:本文的核心思路是通过比较神经元分析(CNA)来揭示LLM中算术运算的内部逻辑链。CNA旨在识别模型中负责不同算术运算的关键神经元和注意力头,并理解它们之间的相互作用。通过分析这些神经元的激活模式和连接权重,可以构建一个从输入到预测的逻辑流程图,从而揭示模型如何执行算术计算。

技术框架:CNA方法包含以下四个主要阶段:1. 特征增强:浅层前馈网络(FFN)神经元增强输入特征。2. 特征转移:浅层注意力层在不同特征之间传递信息。3. 特征预测:专门的算术头基于转移的特征进行预测。4. 预测增强:深层FFN神经元进一步增强预测结果。该框架通过分析每个阶段的关键神经元和注意力头的行为,揭示了算术运算的完整流程。

关键创新:该论文的关键创新在于提出了比较神经元分析(CNA)方法,这是一种新颖的分析技术,用于理解LLM中算术运算的内部机制。与传统的黑盒方法不同,CNA能够识别模型中负责特定算术运算的关键神经元和注意力头,并揭示它们之间的相互作用。此外,CNA还能够识别人类可解释的FFN神经元,从而进一步增强了模型的可解释性。

关键设计:CNA方法的关键设计包括:1. 神经元激活模式分析:通过分析神经元对不同输入的激活模式,识别与特定算术运算相关的神经元。2. 注意力权重分析:通过分析注意力头的权重,识别在不同特征之间传递信息的注意力头。3. 逻辑链构建:将识别出的神经元和注意力头连接起来,构建一个从输入到预测的逻辑链。4. 可解释性分析:识别具有人类可解释功能的FFN神经元,例如表示数字或运算符的神经元。

🖼️ 关键图片

📊 实验亮点

该研究通过CNA方法揭示了LLM中算术运算的内部机制,发现算术能力集中在少数注意力头上,并识别了关键的FFN神经元。实验表明,该方法可用于模型剪枝,在保持性能的同时减少模型大小,并可用于模型编辑,例如减少性别偏见。LoRA通过放大与预测相关的FFN神经元的系数得分来增强预测概率。

🎯 应用场景

该研究成果可应用于多个领域,包括:1) 模型优化:通过识别和优化关键神经元,提高模型在算术任务上的性能。2) 模型编辑:通过修改关键神经元的行为,减少模型中的偏差。3) 模型安全:通过理解模型的内部机制,提高模型的鲁棒性和可信度。4) 教育领域:帮助学生更好地理解LLM的工作原理。

📄 摘要(原文)

We find arithmetic ability resides within a limited number of attention heads, with each head specializing in distinct operations. To delve into the reason, we introduce the Comparative Neuron Analysis (CNA) method, which identifies an internal logic chain consisting of four distinct stages from input to prediction: feature enhancing with shallow FFN neurons, feature transferring by shallow attention layers, feature predicting by arithmetic heads, and prediction enhancing among deep FFN neurons. Moreover, we identify the human-interpretable FFN neurons within both feature-enhancing and feature-predicting stages. These findings lead us to investigate the mechanism of LoRA, revealing that it enhances prediction probabilities by amplifying the coefficient scores of FFN neurons related to predictions. Finally, we apply our method in model pruning for arithmetic tasks and model editing for reducing gender bias. Code is on https://github.com/zepingyu0512/arithmetic-mechanism.