GroupDebate: Enhancing the Efficiency of Multi-Agent Debate Using Group Discussion

作者: Tongxuan Liu, Xingyu Wang, Weizhe Huang, Wenjiang Xu, Yuting Zeng, Lei Jiang, Hailong Yang, Jing Li

分类: cs.CL, cs.AI

发布日期: 2024-09-21 (更新: 2025-12-26)

备注: Accepted by AAMAS 2026

💡 一句话要点

GroupDebate:利用分组讨论提升多智能体辩论效率,降低token成本

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体辩论 大型语言模型 逻辑推理 分组讨论 token成本

📋 核心要点

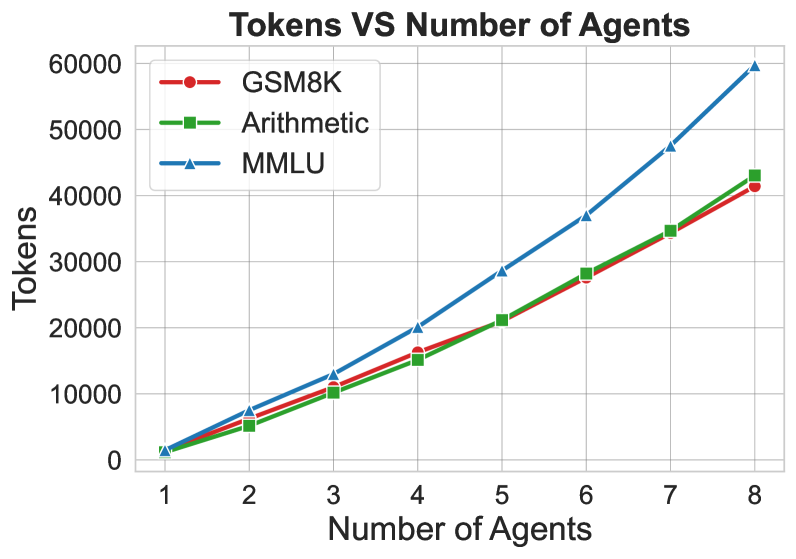

- 多智能体辩论能提升LLM逻辑推理能力,但随着智能体和轮数增加,token成本急剧上升,限制了其可扩展性。

- 提出GroupDebate方法,将智能体分组辩论,组间共享结果,从而在保证性能的同时显著降低token成本。

- 实验表明,GroupDebate方法在多个数据集上可减少高达51.7%的token,并可能提升高达25%的准确率。

📝 摘要(中文)

近年来,大型语言模型(LLMs)在各种自然语言处理任务中展现了卓越的能力。大量研究探索了如何增强其逻辑推理能力,例如思维链、自洽性思维链、思维树和多智能体辩论。在多智能体辩论的背景下,随着智能体数量和辩论轮数的增加,性能可以显著提高。然而,智能体数量和辩论轮数的增加会急剧增加辩论的token成本,从而限制了多智能体辩论技术的可扩展性。为了更好地利用多智能体辩论在逻辑推理任务中的优势,本文提出了一种显著降低多智能体辩论中token成本的方法。该方法包括将所有智能体分成多个辩论组,智能体在其各自组内进行辩论,并在组之间共享中期辩论结果。跨多个数据集的比较实验表明,该方法可以在辩论期间将总token减少高达51.7%,同时潜在地将准确性提高高达25%。我们的方法显著提高了多智能体辩论中交互的性能和效率。

🔬 方法详解

问题定义:论文旨在解决多智能体辩论中token成本过高的问题。现有方法中,增加智能体数量和辩论轮数可以提高性能,但同时也导致token使用量显著增加,使得计算资源消耗巨大,限制了该方法在实际应用中的可扩展性。因此,如何在保证甚至提升性能的前提下,降低token成本是亟待解决的问题。

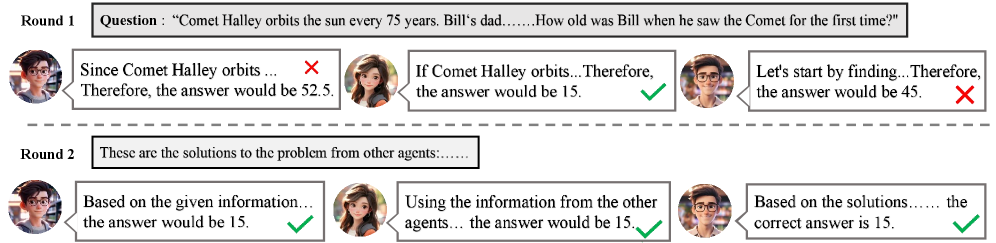

核心思路:论文的核心思路是将所有智能体划分成多个小组,每个小组内部进行独立的辩论,然后小组之间共享辩论的中间结果。通过这种方式,每个智能体只需要与小组内的其他智能体进行交互,减少了全局交互的次数,从而降低了总体的token成本。同时,组间的信息共享可以保证不同小组的观点能够相互影响,避免陷入局部最优。

技术框架:GroupDebate方法主要包含以下几个阶段:1) 智能体分组:将所有智能体划分成若干个小组。2) 组内辩论:每个小组内的智能体进行多轮辩论,生成中间辩论结果。3) 组间信息共享:不同小组之间共享各自的中间辩论结果。4) 最终决策:综合所有小组的辩论结果,做出最终决策。整个流程旨在通过分组辩论和信息共享,在降低token成本的同时,保持甚至提升辩论的性能。

关键创新:该方法最重要的创新点在于引入了分组辩论的机制。与传统的全局辩论相比,分组辩论可以显著减少智能体之间的交互次数,从而降低token成本。同时,组间信息共享保证了不同小组的观点能够相互影响,避免了陷入局部最优。这种分组辩论的策略在多智能体辩论领域是一个新的尝试。

关键设计:论文中可能涉及的关键设计包括:1) 小组规模的确定:小组规模的大小会影响辩论的效率和token成本,需要根据具体任务进行调整。2) 组间信息共享的策略:如何有效地共享组间信息,例如共享哪些信息、共享的频率等,会影响最终的辩论结果。3) 最终决策的制定:如何综合所有小组的辩论结果,做出最终决策,例如采用投票、加权平均等方式。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GroupDebate方法在多个数据集上都取得了显著的效果。与传统的全局辩论相比,该方法可以将总token减少高达51.7%,同时潜在地将准确性提高高达25%。这些结果表明,GroupDebate方法能够在降低token成本的同时,保持甚至提升辩论的性能,具有重要的实际应用价值。

🎯 应用场景

GroupDebate方法可应用于需要复杂逻辑推理的场景,例如问答系统、决策支持系统、代码生成等。通过降低token成本,该方法使得多智能体辩论技术能够应用于更大规模的问题和更复杂的场景,具有重要的实际应用价值。未来,该方法可以进一步扩展到其他多智能体协作任务中,例如多智能体强化学习、多智能体博弈等。

📄 摘要(原文)

In recent years, Large Language Models (LLMs) have demonstrated remarkable capabilities across diverse NLP tasks. Extensive research has explored how to enhance the logical reasoning abilities such as Chain-of-Thought, Chain-of-Thought with Self-Consistency, Tree-Of-Thoughts, and multi-agent debates. In the context of multi-agent debates, significant performance improvements can be achieved with an increasing number of agents and debate rounds. However, the escalation in the number of agents and debate rounds can drastically raise the tokens cost of debates, thereby limiting the scalability of the multi-agent debate technique. To better harness the advantages of multi-agent debates in logical reasoning tasks, this paper proposes a method to significantly reduce token cost in multi-agent debates. This approach involves dividing all agents into multiple debate groups, with agents engaging in debates within their respective groups and sharing interim debate results between groups. Comparative experiments across multiple datasets have demonstrated that this method can reduce the total tokens by up to 51.7% during debates and while potentially enhancing accuracy by as much as 25%. Our method significantly enhances the performance and efficiency of interactions in the multi-agent debate.