CSCE: Boosting LLM Reasoning by Simultaneous Enhancing of Causal Significance and Consistency

作者: Kangsheng Wang, Xiao Zhang, Juntao Lyu, Tianyu Hu, Huimin Ma

分类: cs.CL, cs.AI

发布日期: 2024-09-20 (更新: 2025-03-24)

备注: 6 pages,4 figures. This paper has been accepted for presentation at IEEE International Conference on Multimedia & Expo 2025

💡 一句话要点

提出CSCE框架,通过因果显著性和一致性增强提升LLM推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 因果推理 一致性 处理效应 非链式推理 损失函数 推理效率

📋 核心要点

- 链式推理方法在LLM推理任务中作用日益重要,但推理步骤与状态转移之间的因果幻觉阻碍了LLM推理能力的提升。

- CSCE框架通过定制损失函数,利用处理效应评估增强LLM的因果显著性和一致性,从而提升推理能力。

- CSCE将推理过程从多步级联转变为一次性输出,提高了推理效率,实验表明该方法提高了推理成功率和速度。

📝 摘要(中文)

本文提出了一种非链式推理框架,即因果显著性和一致性增强器(CSCE),旨在同时考虑因果显著性和一致性,从而提升大型语言模型(LLM)的推理能力。通过定制LLM的损失函数,并利用处理效应评估来增强其推理能力,从因果显著性和一致性两个方面入手,确保模型能够捕获关键的因果关系,并在各种场景中保持稳健和一致的性能。此外,我们将推理过程从链式方法中常用的级联式多步推理,转变为因果增强的方法,一次性输出整个推理过程,进一步提高模型的推理效率。大量实验表明,该方法提高了推理成功率和速度,证明了非链式方法也能有效辅助LLM完成推理任务。

🔬 方法详解

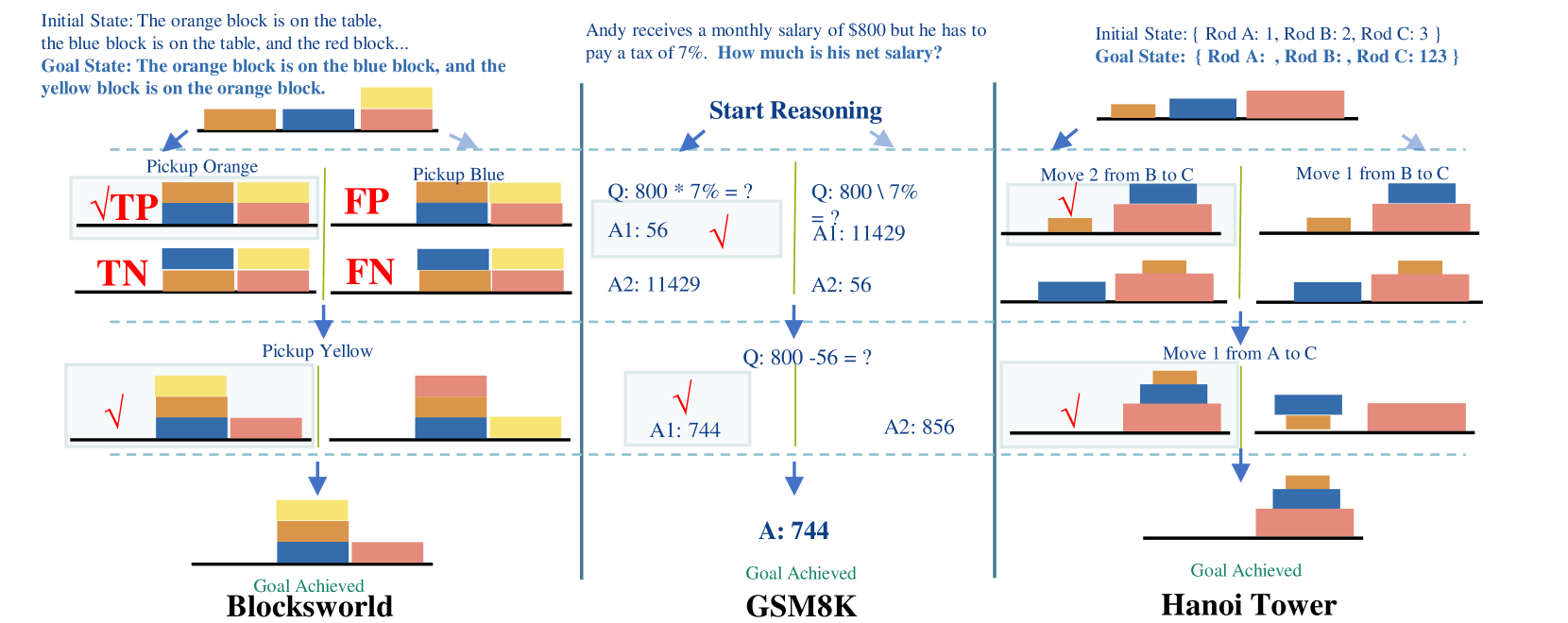

问题定义:现有基于链的推理方法,如思维链(CoT),在长程推理任务中面临因果幻觉问题,即推理步骤与状态转移之间的因果关系不明确或错误,导致推理结果不准确。这些方法通常采用多步推理,每一步都依赖前一步的结果,容易累积误差,降低推理的可靠性。

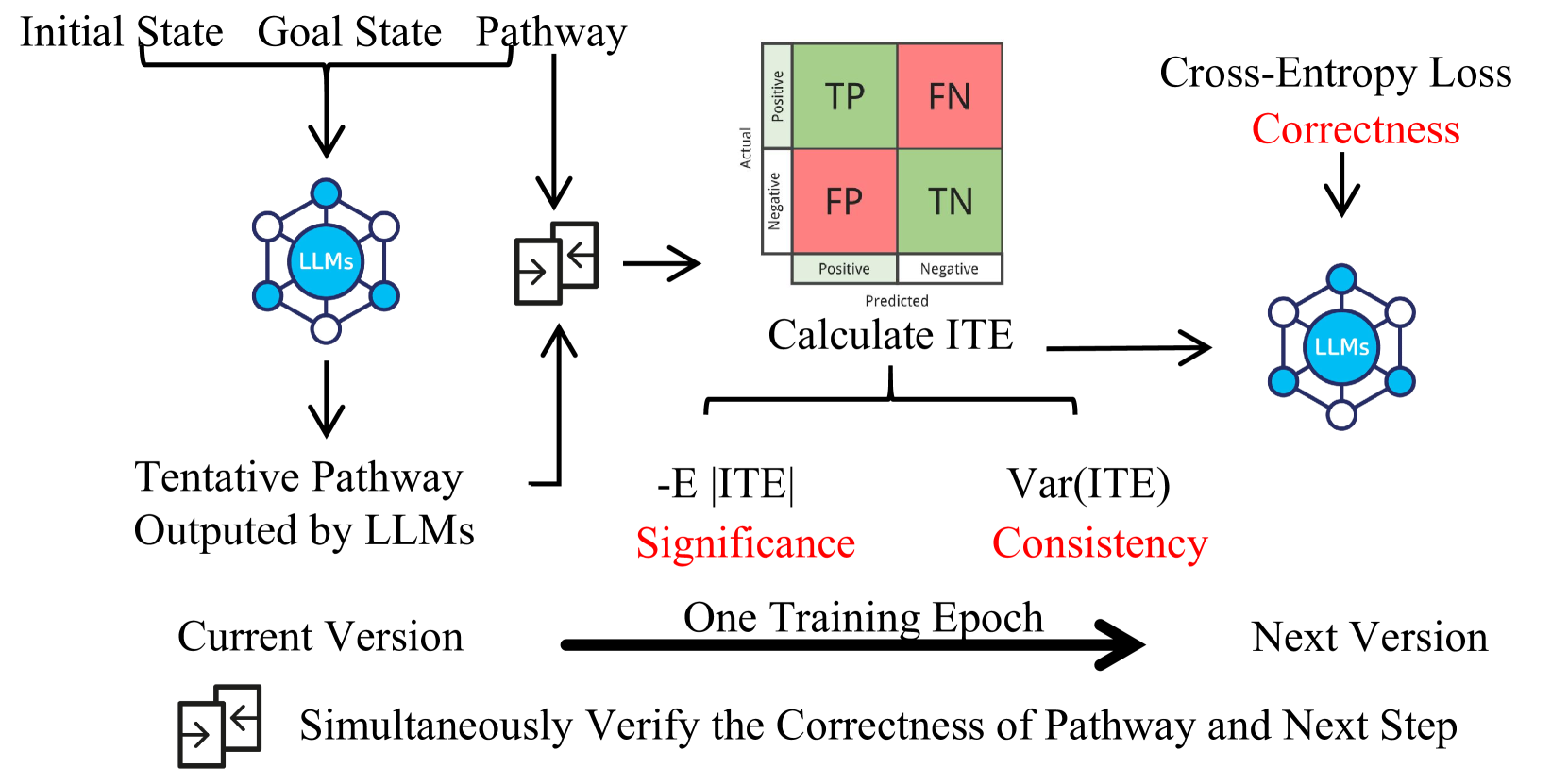

核心思路:CSCE的核心思路是通过同时增强因果显著性和一致性来提升LLM的推理能力。因果显著性是指模型能够准确捕捉推理过程中关键的因果关系,避免因果幻觉。一致性是指模型在不同场景下能够保持推理结果的稳定性和可靠性。通过定制损失函数,并利用处理效应评估,模型能够学习到更准确的因果关系,并在推理过程中保持一致性。

技术框架:CSCE框架采用非链式推理方法,将整个推理过程视为一个整体,一次性输出推理结果。框架主要包含以下几个阶段:1) 输入问题描述;2) LLM生成初步推理过程;3) 利用处理效应评估对推理过程中的因果关系进行评估;4) 根据评估结果定制损失函数,优化LLM的参数;5) 输出最终推理结果。

关键创新:CSCE最重要的技术创新点在于同时考虑了因果显著性和一致性,并通过处理效应评估来增强LLM的推理能力。与传统的链式推理方法不同,CSCE采用非链式推理,避免了误差累积的问题,提高了推理的效率和可靠性。此外,CSCE通过定制损失函数,使LLM能够学习到更准确的因果关系,从而更好地完成推理任务。

关键设计:CSCE的关键设计包括:1) 使用处理效应评估来量化推理过程中因果关系的重要性;2) 根据处理效应评估结果,定制LLM的损失函数,使模型更加关注重要的因果关系;3) 采用非链式推理方法,一次性输出整个推理过程,避免误差累积;4) 通过实验验证CSCE在不同推理任务上的有效性,并与其他基线方法进行比较。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CSCE框架在多个推理任务上取得了显著的性能提升。与传统的链式推理方法相比,CSCE不仅提高了推理的成功率,还提高了推理的速度。具体的性能数据和提升幅度在论文中有详细的展示,证明了CSCE在提升LLM推理能力方面的有效性。

🎯 应用场景

CSCE框架可应用于各种需要复杂推理的场景,例如智能问答、知识图谱推理、医疗诊断、金融风险评估等。通过提高LLM的推理能力,CSCE可以帮助人们更好地解决实际问题,提高工作效率,并为决策提供更可靠的依据。未来,CSCE有望与其他技术相结合,例如强化学习、迁移学习等,进一步提升LLM的推理能力和泛化能力。

📄 摘要(原文)

Chain-based reasoning methods like chain of thought (CoT) play a rising role in solving reasoning tasks for large language models (LLMs). However, the causal hallucinations between a step of reasoning and corresponding state transitions are becoming a significant obstacle to advancing LLMs' reasoning capabilities, especially in long-range reasoning tasks. This paper proposes a non-chain-based reasoning framework for simultaneous consideration of causal significance and consistency, i.e., the Causal Significance and Consistency Enhancer (CSCE). We customize LLM's loss function utilizing treatment effect assessments to enhance its reasoning ability from two aspects: causal significance and consistency. This ensures that the model captures essential causal relationships and maintains robust and consistent performance across various scenarios. Additionally, we transform the reasoning process from the cascading multiple one-step reasoning commonly used in Chain-Based methods, like CoT, to a causal-enhanced method that outputs the entire reasoning process in one go, further improving the model's reasoning efficiency. Extensive experiments show that our method improves both the reasoning success rate and speed. These improvements further demonstrate that non-chain-based methods can also aid LLMs in completing reasoning tasks.