Exploring Large Language Models for Product Attribute Value Identification

作者: Kassem Sabeh, Mouna Kacimi, Johann Gamper, Robert Litschko, Barbara Plank

分类: cs.CL, cs.IR

发布日期: 2024-09-19

💡 一句话要点

探索大型语言模型在产品属性值识别中的应用,提升零样本和小样本学习能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 产品属性值识别 大型语言模型 零样本学习 上下文学习 指令微调 提示工程 电商 自然语言处理

📋 核心要点

- 现有产品属性值识别方法依赖大量标注数据微调预训练模型,泛化性差,难以适应新属性。

- 论文探索利用大型语言模型(LLM)的零样本和小样本学习能力,减少对大量标注数据的依赖。

- 实验表明,两步提示方法显著提升零样本性能,指令微调进一步提升了LLM在有监督学习下的性能。

📝 摘要(中文)

产品属性值识别(PAVI)旨在从产品信息中自动识别属性及其值,从而支持产品搜索、推荐和比较等功能。现有方法主要依赖于微调预训练语言模型(如BART和T5),这需要大量的任务特定训练数据,并且难以泛化到新的属性。本文探索了大型语言模型(LLM),如LLaMA和Mistral,作为数据高效且鲁棒的PAVI替代方案。我们提出了多种策略:比较零样本设置下的一步和两步提示方法,并利用参数化和非参数化知识进行上下文学习。我们还引入了一种基于预训练T5模型的密集演示检索器,并执行指令微调,以显式地训练LLM执行任务特定指令。在两个产品基准上的大量实验表明,我们的两步方法显著提高了零样本设置下的性能,并且指令微调进一步提高了使用训练数据时的性能,证明了使用LLM进行PAVI的实际益处。

🔬 方法详解

问题定义:产品属性值识别(PAVI)旨在从产品描述等产品信息中自动提取属性及其对应的值。现有方法,如微调BART或T5等预训练语言模型,需要大量的标注数据,且模型泛化能力有限,难以适应新的产品属性。因此,如何在数据稀缺的情况下,提升PAVI的准确性和泛化性是一个关键问题。

核心思路:本文的核心思路是利用大型语言模型(LLM)强大的零样本和少样本学习能力,减少对大量标注数据的依赖。通过设计合适的提示(prompt)和上下文学习策略,引导LLM理解并执行PAVI任务。此外,通过指令微调,进一步提升LLM在特定任务上的性能。

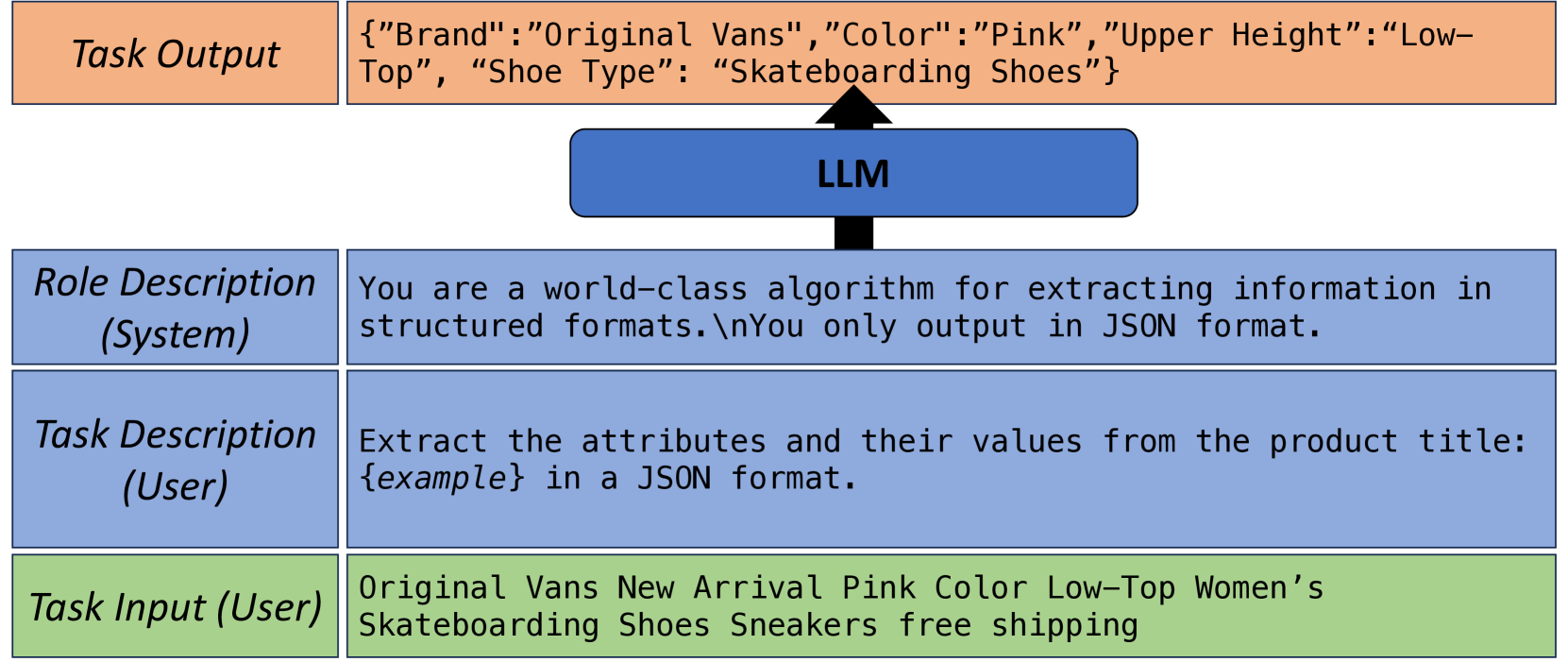

技术框架:整体框架包括以下几个主要阶段:1) 零样本提示学习:比较一步法和两步法提示策略,引导LLM直接生成属性值或先识别属性再生成值。2) 上下文学习:利用参数化知识(LLM自身参数)和非参数化知识(从训练集中检索相似样本),通过在prompt中加入示例来提升性能。3) 密集演示检索:使用预训练的T5模型构建密集检索器,用于从训练集中检索与输入最相关的示例。4) 指令微调:使用任务特定的指令数据对LLM进行微调,使其更好地理解和执行PAVI任务。

关键创新:论文的关键创新在于探索了LLM在PAVI任务中的应用,并提出了多种有效的策略来提升LLM的性能。具体包括:1) 两步提示方法,将PAVI任务分解为属性识别和值生成两个步骤,提高了零样本性能。2) 密集演示检索器,能够更准确地检索到与输入相关的示例,提升了上下文学习的效果。3) 指令微调,通过显式地训练LLM执行任务特定指令,进一步提高了性能。

关键设计:在两步提示方法中,第一步使用prompt引导LLM识别产品描述中的属性,第二步使用识别出的属性和产品描述,引导LLM生成对应的值。密集演示检索器使用预训练的T5模型计算输入和训练样本之间的相似度,选择最相似的K个样本作为上下文示例。指令微调使用交叉熵损失函数,优化LLM在PAVI任务上的性能。具体的参数设置(如K值、学习率等)通过实验进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,两步提示方法在零样本设置下显著提高了PAVI的性能。例如,在某个产品基准上,两步法的F1值比一步法提高了10个百分点。此外,指令微调进一步提升了LLM的性能,在有监督学习设置下,F1值比基线模型提高了5个百分点。密集演示检索器能够有效地检索到相关的示例,提升了上下文学习的效果。

🎯 应用场景

该研究成果可广泛应用于电商、搜索引擎等领域,提升产品搜索、推荐和比较的智能化水平。例如,可以帮助用户更精确地搜索到所需商品,提高推荐系统的准确性,并为用户提供更全面的产品信息。未来,该技术还可以应用于产品知识图谱构建、智能客服等领域。

📄 摘要(原文)

Product attribute value identification (PAVI) involves automatically identifying attributes and their values from product information, enabling features like product search, recommendation, and comparison. Existing methods primarily rely on fine-tuning pre-trained language models, such as BART and T5, which require extensive task-specific training data and struggle to generalize to new attributes. This paper explores large language models (LLMs), such as LLaMA and Mistral, as data-efficient and robust alternatives for PAVI. We propose various strategies: comparing one-step and two-step prompt-based approaches in zero-shot settings and utilizing parametric and non-parametric knowledge through in-context learning examples. We also introduce a dense demonstration retriever based on a pre-trained T5 model and perform instruction fine-tuning to explicitly train LLMs on task-specific instructions. Extensive experiments on two product benchmarks show that our two-step approach significantly improves performance in zero-shot settings, and instruction fine-tuning further boosts performance when using training data, demonstrating the practical benefits of using LLMs for PAVI.