Textualized Agent-Style Reasoning for Complex Tasks by Multiple Round LLM Generation

作者: Chen Liang, Zhifan Feng, Zihe Liu, Wenbin Jiang, Jinan Xu, Yufeng Chen, Yong Wang

分类: cs.CL

发布日期: 2024-09-19

💡 一句话要点

提出AgentCOT框架,通过多轮LLM生成解决复杂任务中的幻觉、可解释性和可控性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 自主代理 链式思考 复杂推理 可解释性 幻觉问题 图结构 多轮生成

📋 核心要点

- 现有Chain-of-Thought方法存在幻觉、可解释性受限和生成不可控等问题,限制了其在复杂任务中的应用。

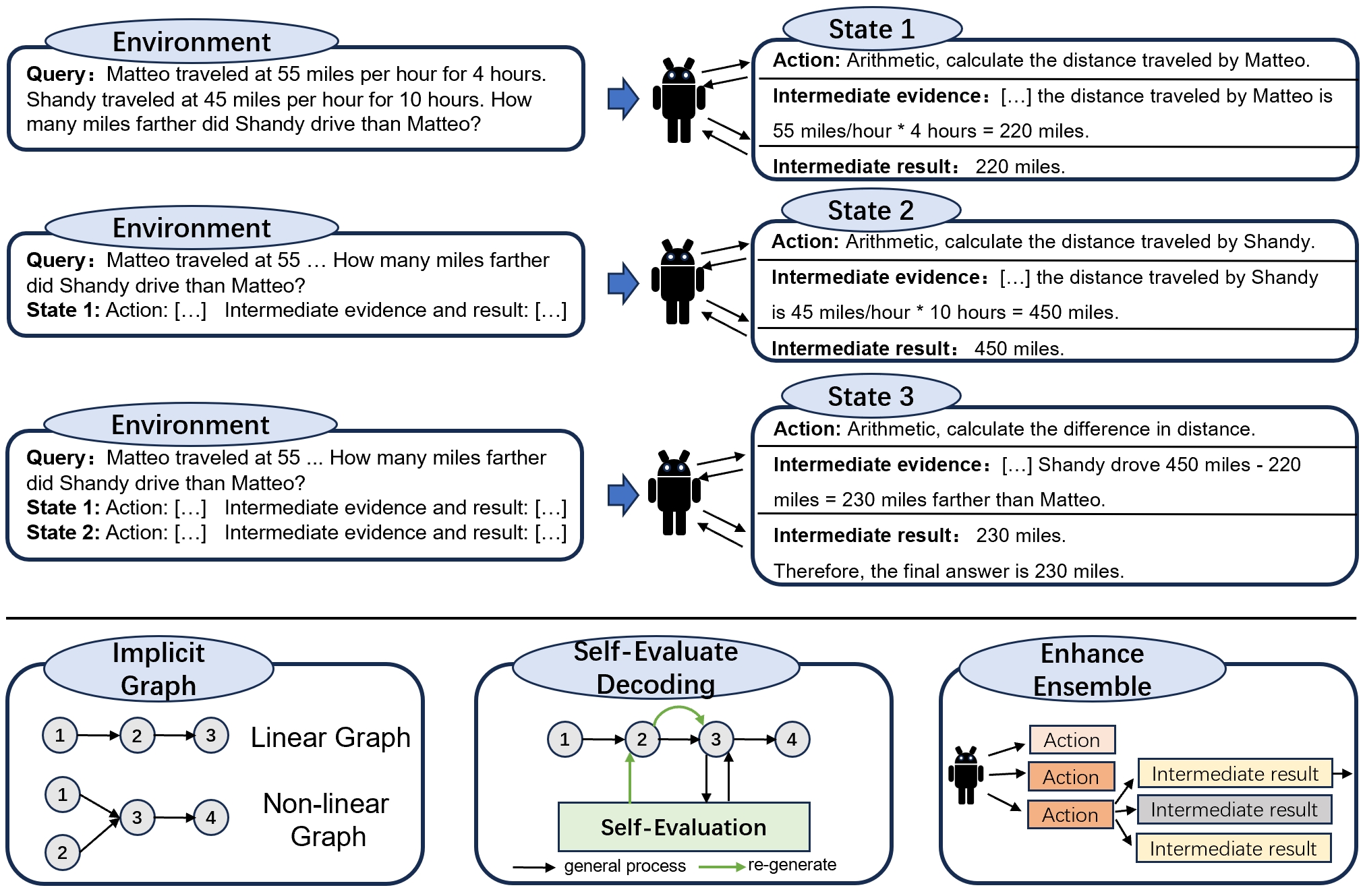

- AgentCOT框架通过模拟代理行为,在每一步选择动作并执行,生成带有证据的中间结果,并构建图结构化推理过程。

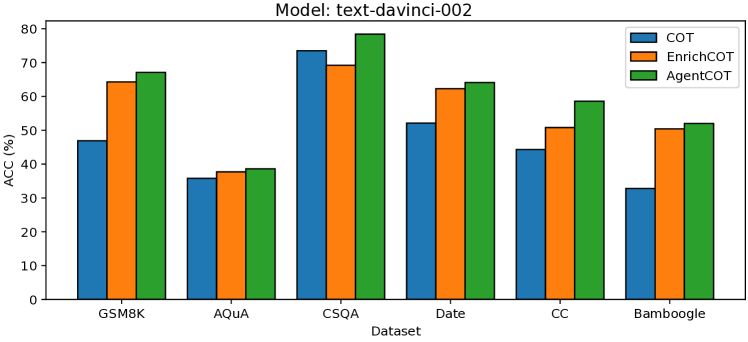

- 实验结果表明,AgentCOT在六个常见基准测试中显著优于现有方法,验证了其有效性。

📝 摘要(中文)

本文提出AgentCOT,一个基于大型语言模型(LLM)的自主代理框架,通过多轮LLM生成以代理风格解决复杂问题。在每个步骤中,AgentCOT选择一个动作并执行它,产生带有支持证据的中间结果。此外,我们将步骤的索引集成到推理过程中,形成用于复杂推理逻辑的图结构。我们引入了两种新策略来增强AgentCOT的性能。我们进行了广泛的实验,以验证我们的方法在六个常见基准上的有效性。结果表明,我们的方法比当前有竞争力的方案带来了显著的改进。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)在进行复杂推理时,容易出现幻觉问题,即生成不真实或不准确的信息。此外,Chain-of-Thought (CoT) 等方法虽然提高了推理能力,但其推理过程的可解释性仍然有限,且生成过程难以控制,导致在需要精确和可信结果的场景中应用受限。

核心思路:AgentCOT的核心思路是将LLM视为一个自主代理,通过模拟人类解决问题的过程,将复杂任务分解为多个步骤,并在每个步骤中选择合适的动作执行。这种代理风格的推理方式可以更好地控制生成过程,并提供支持证据,从而减少幻觉并提高可解释性。通过将步骤索引集成到推理过程中,构建图结构,进一步增强了复杂推理逻辑的表达能力。

技术框架:AgentCOT框架包含以下主要模块:1) 动作选择模块:根据当前状态和任务目标,选择合适的动作。2) 执行模块:执行选定的动作,并生成中间结果和支持证据。3) 状态更新模块:根据中间结果更新当前状态。4) 图结构构建模块:将步骤索引集成到推理过程中,构建图结构。整个流程通过多轮LLM生成迭代进行,直到达到任务目标或达到最大迭代次数。

关键创新:AgentCOT的关键创新在于其代理风格的推理方式,它将LLM从被动生成器转变为主动问题解决者。与传统的CoT方法相比,AgentCOT能够更好地控制生成过程,并提供支持证据,从而减少幻觉并提高可解释性。此外,图结构化的推理过程能够更好地表达复杂推理逻辑。

关键设计:AgentCOT的关键设计包括:1) 动作空间的设计:定义了LLM可以执行的动作集合,例如搜索、计算、总结等。2) 奖励函数的设计:用于评估每个动作的执行效果,并指导动作选择。3) 图结构的构建方式:将步骤索引作为节点,动作作为边,构建图结构。4) 两种新策略:论文中提到了两种新策略来增强AgentCOT的性能,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

AgentCOT在六个常见基准测试中取得了显著的改进,证明了其有效性。具体性能数据和对比基线未知,但摘要中明确指出AgentCOT优于当前有竞争力的方案,表明其在解决复杂任务方面具有显著优势。

🎯 应用场景

AgentCOT框架具有广泛的应用前景,例如在问答系统、知识图谱推理、代码生成、医疗诊断等领域。通过模拟专家解决问题的过程,AgentCOT可以提供更准确、可信和可解释的结果,从而提高决策效率和质量。未来,AgentCOT可以进一步扩展到更多复杂任务中,并与其他技术相结合,例如强化学习、知识图谱等,以实现更强大的问题解决能力。

📄 摘要(原文)

Chain-of-thought prompting significantly boosts the reasoning ability of large language models but still faces three issues: hallucination problem, restricted interpretability, and uncontrollable generation. To address these challenges, we present AgentCOT, a llm-based autonomous agent framework, which can solve complex problems in an agent-style manner by multiple round LLM generation. At each step, AgentCOT selects an action and executes it to yield an intermediate result with supporting evidence. In addition, we integrate the step's index into the reasoning process to form a graph structure for complex inference logic. We introduce two new strategies to enhance the performance of AgentCOT.We conduct extensive experiments to verify the effectiveness of our method on six common benchmarks. Results exhibit that our method brings in substantial improvements over current competitive approaches.