BodyShapeGPT: SMPL Body Shape Manipulation with LLMs

作者: Baldomero R. Árbol, Dan Casas

分类: cs.CL, cs.CV, cs.LG

发布日期: 2024-09-18

备注: Accepted to ECCV 2024 Workshop on Foundation Models for 3D Humans. Code repository: https://github.com/baldoarbol/BodyShapeGPT

💡 一句话要点

BodyShapeGPT:利用LLM实现SMPL人体模型形状操控

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 SMPL-X 3D人体建模 自然语言处理 人机交互

📋 核心要点

- 现有方法难以通过自然语言精确控制3D人体模型,限制了虚拟环境中的个性化定制和人机交互。

- BodyShapeGPT利用微调的LLM,将自然语言描述转化为SMPL-X模型的形状参数,实现对3D人体形状的精确控制。

- 实验表明,该方法能够根据自然语言描述生成准确的人体模型,为虚拟环境中的定制和模拟提供了新的可能性。

📝 摘要(中文)

生成式AI模型提供了多种工具,能够在短时间内完成人类需要花费大量时间才能完成的复杂任务。其中,大型语言模型(LLM)因其生成多样化文本的能力而脱颖而出,这些文本范围从文学叙事到不同知识领域的专业回复。本文探讨了使用微调的LLM来识别人物的身体描述,并通过推断形状参数,使用SMPL-X模型创建精确的头像表示。我们证明了LLM可以被训练来理解和操纵SMPL的形状空间,从而允许通过自然语言控制3D人体形状。这种方法有望改善人机交互,并为虚拟环境中的定制和模拟开辟新的途径。

🔬 方法详解

问题定义:论文旨在解决如何通过自然语言描述精确控制3D人体模型形状的问题。现有方法通常依赖于手动调整参数或使用复杂的图像处理技术,难以实现自然语言驱动的直观控制,并且泛化能力有限。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的语义理解和生成能力,将自然语言描述映射到SMPL-X模型的形状参数空间。通过训练LLM理解人体描述与形状参数之间的关系,实现通过自然语言直接控制3D人体形状。

技术框架:BodyShapeGPT的技术框架主要包含两个阶段:首先,使用包含人体描述和对应SMPL-X形状参数的数据集对LLM进行微调,使其能够理解自然语言描述与形状参数之间的关系。其次,在推理阶段,将自然语言描述输入到微调后的LLM中,LLM生成对应的SMPL-X形状参数,从而创建3D人体模型。

关键创新:该方法最重要的创新点在于利用LLM直接学习自然语言描述与3D人体形状参数之间的映射关系,避免了传统方法中复杂的中间步骤,实现了自然语言驱动的3D人体形状控制。与现有方法相比,该方法更加直观、灵活,并且具有更好的泛化能力。

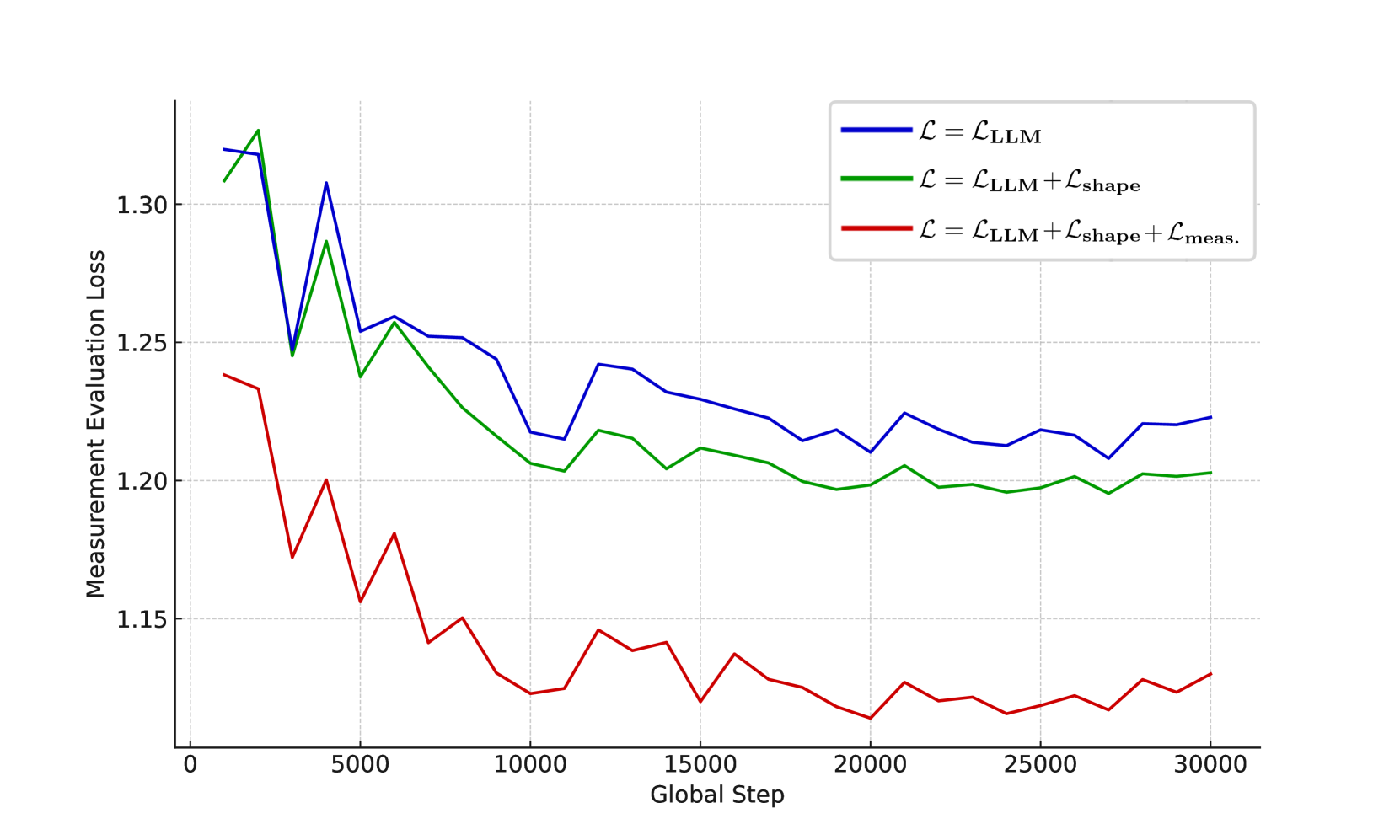

关键设计:论文的关键设计包括:选择合适的LLM架构进行微调;构建包含丰富人体描述和对应SMPL-X形状参数的数据集;设计合适的损失函数,例如均方误差损失,用于优化LLM的参数,使其能够准确预测SMPL-X形状参数。

🖼️ 关键图片

📊 实验亮点

论文展示了BodyShapeGPT能够根据自然语言描述生成准确的人体模型。虽然论文中没有提供具体的性能数据和对比基线,但通过可视化结果可以看出,生成的模型能够较好地反映自然语言描述中的体型特征。该方法为自然语言驱动的3D人体建模提供了一种新的思路。

🎯 应用场景

BodyShapeGPT在虚拟现实、游戏开发、个性化服装定制等领域具有广泛的应用前景。它可以用于创建逼真的虚拟化身,实现个性化的角色定制,并为用户提供更加自然和直观的人机交互体验。此外,该技术还可以应用于人体工程学研究和运动模拟等领域。

📄 摘要(原文)

Generative AI models provide a wide range of tools capable of performing complex tasks in a fraction of the time it would take a human. Among these, Large Language Models (LLMs) stand out for their ability to generate diverse texts, from literary narratives to specialized responses in different fields of knowledge. This paper explores the use of fine-tuned LLMs to identify physical descriptions of people, and subsequently create accurate representations of avatars using the SMPL-X model by inferring shape parameters. We demonstrate that LLMs can be trained to understand and manipulate the shape space of SMPL, allowing the control of 3D human shapes through natural language. This approach promises to improve human-machine interaction and opens new avenues for customization and simulation in virtual environments.