RUIE: Retrieval-based Unified Information Extraction using Large Language Model

作者: Xincheng Liao, Junwen Duan, Yixi Huang, Jianxin Wang

分类: cs.CL

发布日期: 2024-09-18 (更新: 2025-01-21)

备注: To appear in COLING 2025 main conference

💡 一句话要点

提出RUIE:基于检索的统一信息抽取框架,利用大语言模型实现高效任务泛化。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 统一信息抽取 大语言模型 检索增强 上下文学习 知识蒸馏

📋 核心要点

- 现有UIE方法依赖大量计算资源,且大语言模型泛化能力不足,难以适应新任务。

- RUIE通过检索相关示例进行上下文学习,结合LLM偏好和关键词奖励,提升泛化能力。

- 实验表明,RUIE在多个数据集上显著优于指令调优和其他检索方法,F1值提升显著。

📝 摘要(中文)

统一信息抽取(UIE)旨在从非结构化文本中提取各种结构化信息。虽然大型语言模型(LLM)在UIE中展现出潜力,但它们需要大量的计算资源,并且常常难以泛化到未见过的任务。我们提出了RUIE(基于检索的统一信息抽取),该框架利用上下文学习来实现高效的任务泛化。RUIE引入了一种新颖的演示选择机制,该机制结合了LLM偏好和关键词增强的奖励模型,并采用通过对比学习和知识蒸馏训练的双编码器检索器。作为第一个用于UIE的可训练检索框架,RUIE可以作为各种LLM的通用插件。在八个保留数据集上的实验结果表明了RUIE的有效性,与指令调优方法和其他检索器相比,平均F1分数分别提高了19.22和3.22。

🔬 方法详解

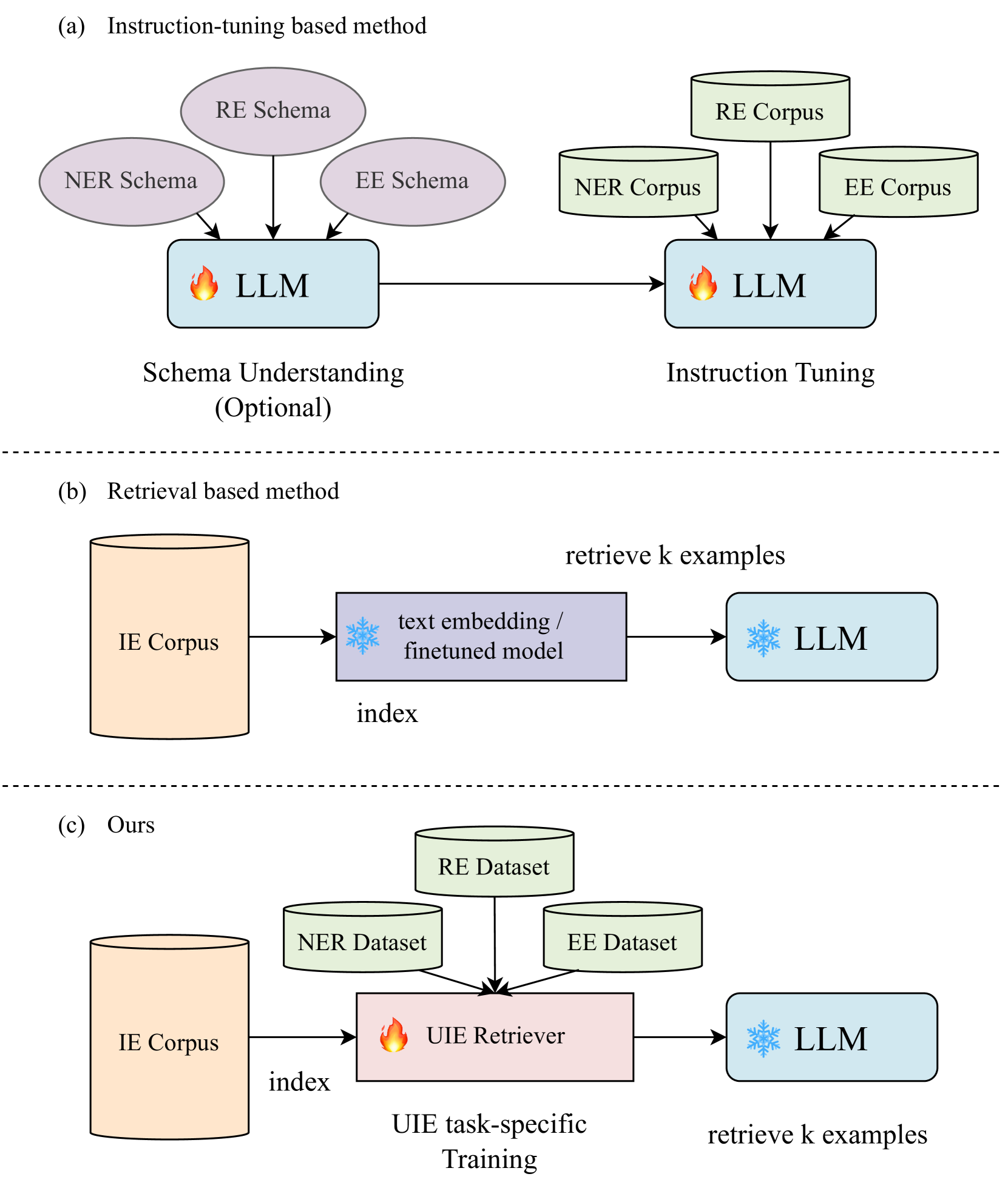

问题定义:统一信息抽取旨在从非结构化文本中提取结构化信息,现有方法如直接使用大型语言模型进行指令调优,计算成本高昂,且泛化能力受限,难以适应新的信息抽取任务。缺乏一种高效且通用的方法来利用大语言模型进行统一信息抽取。

核心思路:RUIE的核心思路是利用检索增强的上下文学习,通过检索与当前任务相关的示例,为大语言模型提供上下文信息,从而提高其泛化能力。通过可训练的检索器,RUIE能够更有效地选择合适的示例,并结合LLM的偏好进行优化。

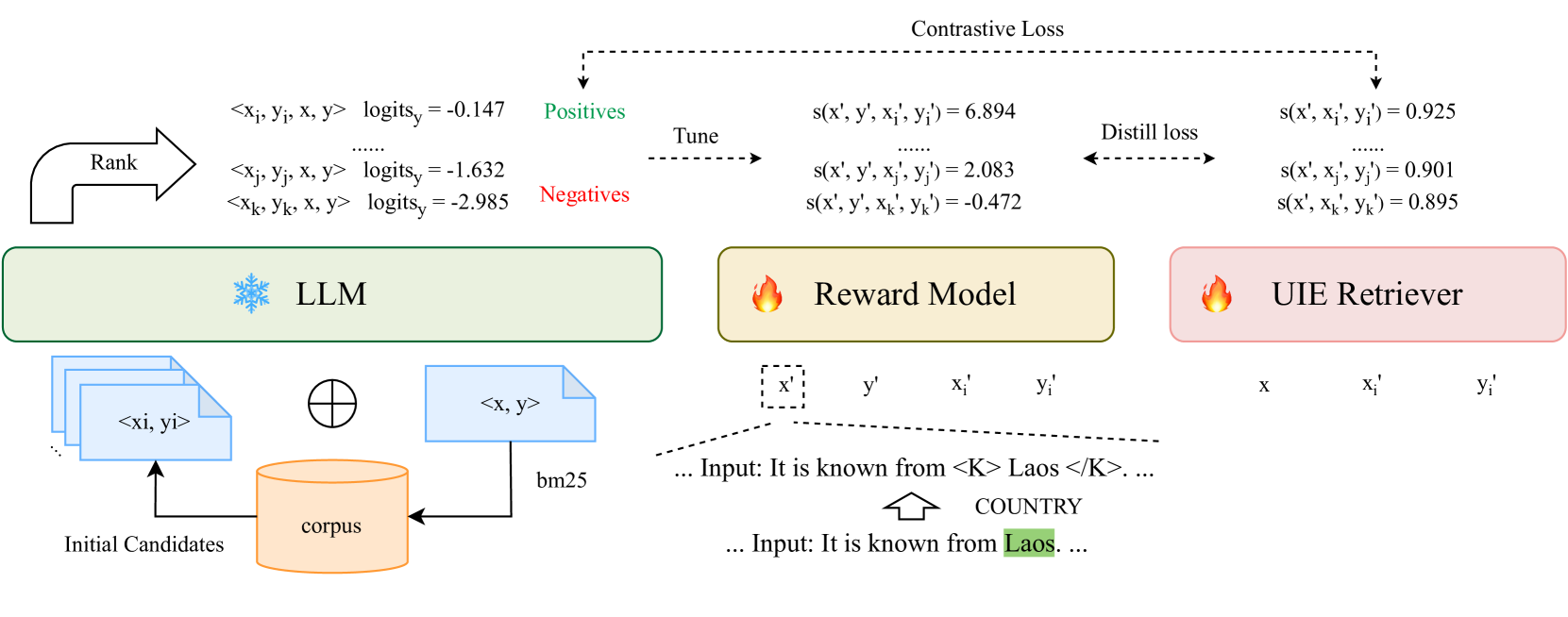

技术框架:RUIE框架主要包含三个模块:1) 双编码器检索器:用于从示例库中检索相关示例;2) 演示选择机制:结合LLM偏好和关键词增强的奖励模型,选择最佳演示示例;3) 大语言模型:利用检索到的示例进行上下文学习,完成信息抽取任务。整个流程是,给定输入文本,检索器检索相关示例,演示选择机制选择最佳示例,然后将输入文本和选定的示例一起输入到大语言模型中,生成抽取结果。

关键创新:RUIE的关键创新在于其可训练的检索框架,这是第一个用于UIE的可训练检索框架。传统的检索方法通常是固定的,无法针对特定的UIE任务进行优化。RUIE通过对比学习和知识蒸馏训练双编码器检索器,使其能够更好地适应不同的UIE任务。此外,RUIE的演示选择机制结合了LLM偏好和关键词增强的奖励模型,能够更有效地选择合适的示例。

关键设计:RUIE的双编码器检索器使用对比学习进行训练,损失函数采用InfoNCE损失。知识蒸馏用于将大型语言模型的知识迁移到双编码器检索器中。演示选择机制中的奖励模型使用关键词增强,以提高对重要信息的关注。具体参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

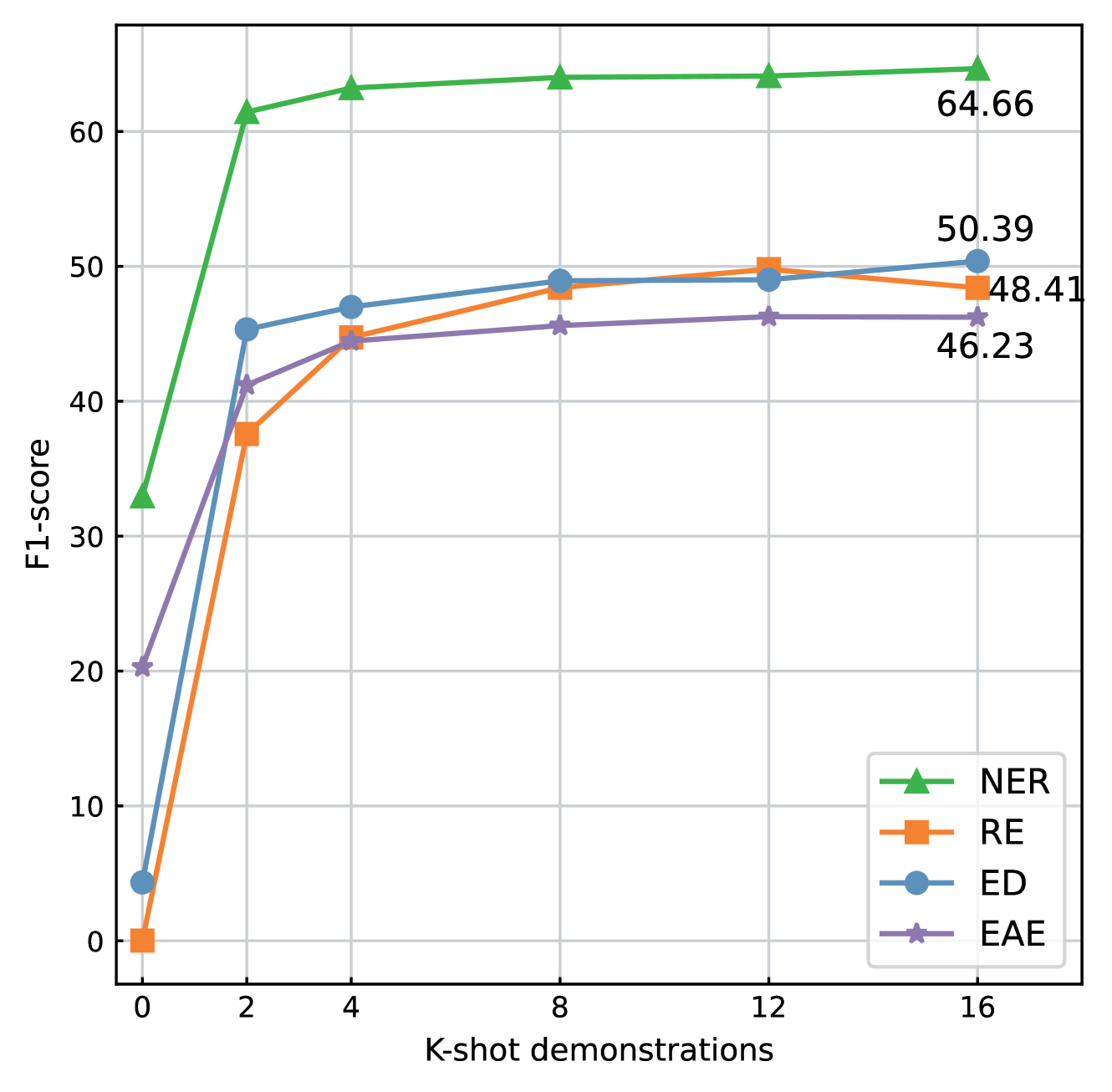

RUIE在八个保留数据集上进行了实验,结果表明,与指令调优方法相比,RUIE的平均F1分数提高了19.22。与其他检索器相比,RUIE的平均F1分数提高了3.22。这些结果表明,RUIE在UIE任务中具有显著的优势,能够有效地提高信息抽取的性能。

🎯 应用场景

RUIE可应用于各种信息抽取场景,例如从新闻文章中提取事件信息、从医疗记录中提取疾病信息、从金融报告中提取财务信息等。该研究的实际价值在于降低了UIE的计算成本,提高了泛化能力,使得大语言模型能够更有效地应用于各种信息抽取任务。未来,RUIE可以进一步扩展到多语言信息抽取、跨领域信息抽取等领域。

📄 摘要(原文)

Unified information extraction (UIE) aims to extract diverse structured information from unstructured text. While large language models (LLMs) have shown promise for UIE, they require significant computational resources and often struggle to generalize to unseen tasks. We propose RUIE (Retrieval-based Unified Information Extraction), a framework that leverages in-context learning for efficient task generalization. RUIE introduces a novel demonstration selection mechanism combining LLM preferences with a keyword-enhanced reward model, and employs a bi-encoder retriever trained through contrastive learning and knowledge distillation. As the first trainable retrieval framework for UIE, RUIE serves as a universal plugin for various LLMs. Experimental results on eight held-out datasets demonstrate RUIE's effectiveness, with average F1-score improvements of 19.22 and 3.22 compared to instruction-tuning methods and other retrievers, respectively.