Chain-of-Thought Prompting for Speech Translation

作者: Ke Hu, Zhehuai Chen, Chao-Han Huck Yang, Piotr Żelasko, Oleksii Hrinchuk, Vitaly Lavrukhin, Jagadeesh Balam, Boris Ginsburg

分类: cs.CL

发布日期: 2024-09-17 (更新: 2025-03-26)

💡 一句话要点

提出基于思维链提示的语音翻译方法,显著提升Speech-LLM的翻译性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语音翻译 思维链提示 Speech-LLM 自动语音识别 低秩自适应

📋 核心要点

- 现有Speech-LLM在语音翻译任务中,直接使用语音嵌入作为提示,缺乏中间推理步骤,限制了翻译性能。

- 论文提出利用ASR转录作为中间提示,引导Speech-LLM进行两步翻译,模仿思维链推理过程,提升翻译质量。

- 实验表明,该方法在多个翻译任务上显著提升了BLEU值,优于直接语音提示和端到端ASR+AST预测。

📝 摘要(中文)

大型语言模型(LLMs)在语言理解和生成方面取得了显著进展。基于文本LLM的成功,最近的研究已将这些模型调整为使用语音嵌入进行提示,从而产生了在自动语音识别(ASR)和自动语音翻译(AST)方面表现出强大性能的Speech-LLM模型。本文提出了一种新颖的方法,利用ASR转录作为Speech-LLM中AST的提示,该Speech-LLM构建在编码器-解码器文本LLM之上。通过首先解码语音以生成ASR转录,然后将这些转录与编码的语音一起用于提示,我们以类似思维链(CoT)提示的两步过程来指导语音翻译。低秩自适应(LoRA)用于T5 LLM进行模型适配,并显示出优于完整模型微调的性能。实验结果表明,所提出的CoT提示显著提高了AST性能,与单独的语音提示相比,在6个En->X或X->En AST任务中平均提高了2.4个BLEU点。此外,与相关的CoT预测方法(预测ASR和AST转录的连接序列)相比,我们的方法表现更好,平均提高了2个BLEU点。

🔬 方法详解

问题定义:论文旨在提升Speech-LLM在自动语音翻译(AST)任务中的性能。现有方法通常直接将语音编码输入LLM进行翻译,缺乏中间推理步骤,导致翻译效果受限。痛点在于如何有效地利用语音信息,并引入中间推理过程,以提高翻译的准确性和流畅性。

核心思路:论文的核心思路是借鉴思维链(Chain-of-Thought, CoT)提示的思想,将语音翻译过程分解为两个步骤:首先,将语音解码为文本(ASR转录);然后,将ASR转录作为提示,引导LLM进行翻译。这种两步法模拟了人类的翻译过程,即先理解语音内容,再进行翻译。

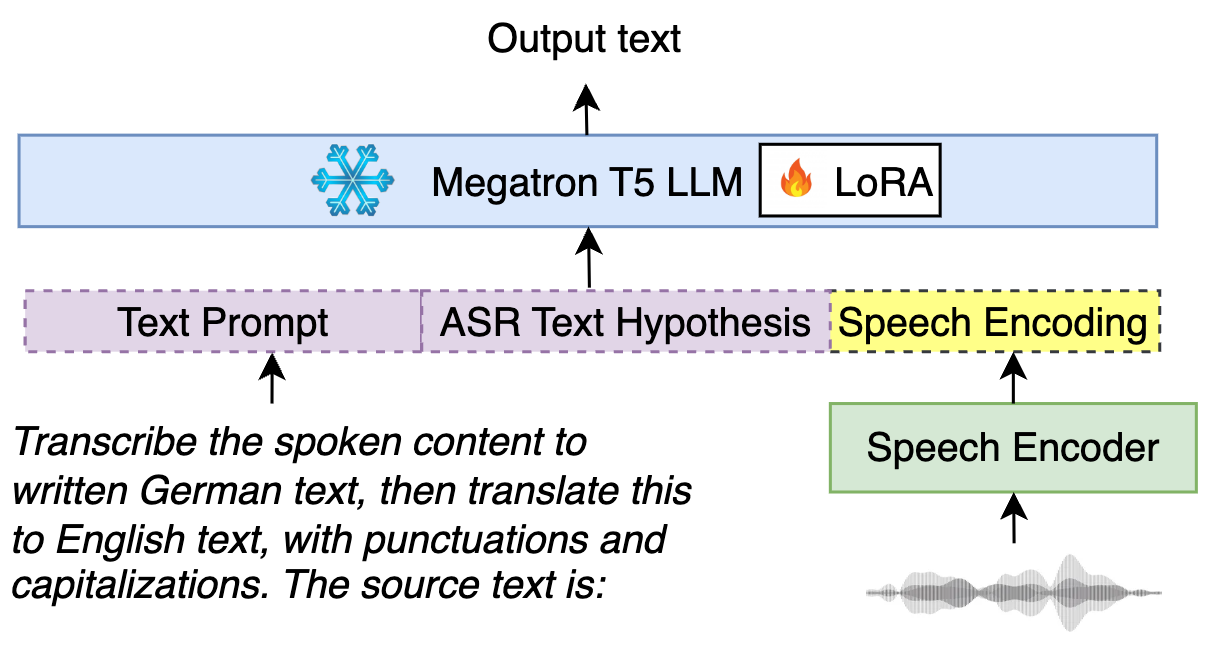

技术框架:整体框架包含一个语音编码器和一个基于Megatron-T5的编码器-解码器结构文本LLM。首先,语音编码器将语音信号转换为语音嵌入。然后,使用语音嵌入解码生成ASR转录。最后,将语音嵌入和ASR转录一起作为提示输入Megatron-T5,生成目标语言的翻译。

关键创新:关键创新在于将ASR转录作为中间提示,引入到Speech-LLM的翻译过程中。这使得模型能够利用ASR转录中的文本信息,更好地理解语音内容,从而生成更准确的翻译。与直接预测ASR和AST连接序列的方法相比,该方法能够更好地利用ASR信息,提升翻译性能。

关键设计:论文使用低秩自适应(LoRA)来微调T5 LLM,以适应语音翻译任务。LoRA通过学习低秩矩阵来更新LLM的权重,从而减少了训练参数,提高了训练效率。此外,论文还探索了不同的ASR转录策略,例如使用不同的ASR模型或调整ASR模型的参数,以优化翻译性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的CoT提示方法在6个En->X或X->En AST任务中,相比于单独的语音提示,平均提高了2.4个BLEU点。与预测ASR和AST转录连接序列的CoT方法相比,该方法平均提高了2个BLEU点。这些结果表明,该方法能够显著提升Speech-LLM的语音翻译性能。

🎯 应用场景

该研究成果可应用于各种语音翻译场景,如国际会议同声传译、跨语言语音助手、多语言在线教育等。通过提高语音翻译的准确性和流畅性,可以促进跨语言交流和信息共享,具有重要的实际应用价值和广阔的市场前景。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable advancements in language understanding and generation. Building on the success of text-based LLMs, recent research has adapted these models to use speech embeddings for prompting, resulting in Speech-LLM models that exhibit strong performance in automatic speech recognition (ASR) and automatic speech translation (AST). In this work, we propose a novel approach to leverage ASR transcripts as prompts for AST in a Speech-LLM built on an encoder-decoder text LLM. The Speech-LLM model consists of a speech encoder and an encoder-decoder structure Megatron-T5. By first decoding speech to generate ASR transcripts and subsequently using these transcripts along with encoded speech for prompting, we guide the speech translation in a two-step process like chain-of-thought (CoT) prompting. Low-rank adaptation (LoRA) is used for the T5 LLM for model adaptation and shows superior performance to full model fine-tuning. Experimental results show that the proposed CoT prompting significantly improves AST performance, achieving an average increase of 2.4 BLEU points across 6 En->X or X->En AST tasks compared to speech prompting alone. Additionally, compared to a related CoT prediction method that predicts a concatenated sequence of ASR and AST transcripts, our method performs better by an average of 2 BLEU points.