Strategic Insights in Human and Large Language Model Tactics at Word Guessing Games

作者: Matīss Rikters, Sanita Reinsone

分类: cs.CL, cs.CY

发布日期: 2024-09-17 (更新: 2024-12-13)

期刊: Published in the 4th Wordplay: When Language Meets Games Workshop @ ACL 2024

💡 一句话要点

分析人类与大语言模型在猜词游戏中的策略,揭示模型在多语言环境下的挑战。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 猜词游戏 大语言模型 人类策略 多语言处理 自然语言理解

📋 核心要点

- 现有猜词游戏策略研究较少,尤其缺乏对人类玩家策略的深入分析以及大语言模型在多语言环境下的表现评估。

- 通过调查人类玩家的策略和动机,并利用大语言模型进行猜词游戏,分析模型在不同语言环境下的表现。

- 实验结果揭示了现有大语言模型在猜词游戏中,尤其是在多语言环境下,存在生成重复词、幻觉词等问题。

📝 摘要(中文)

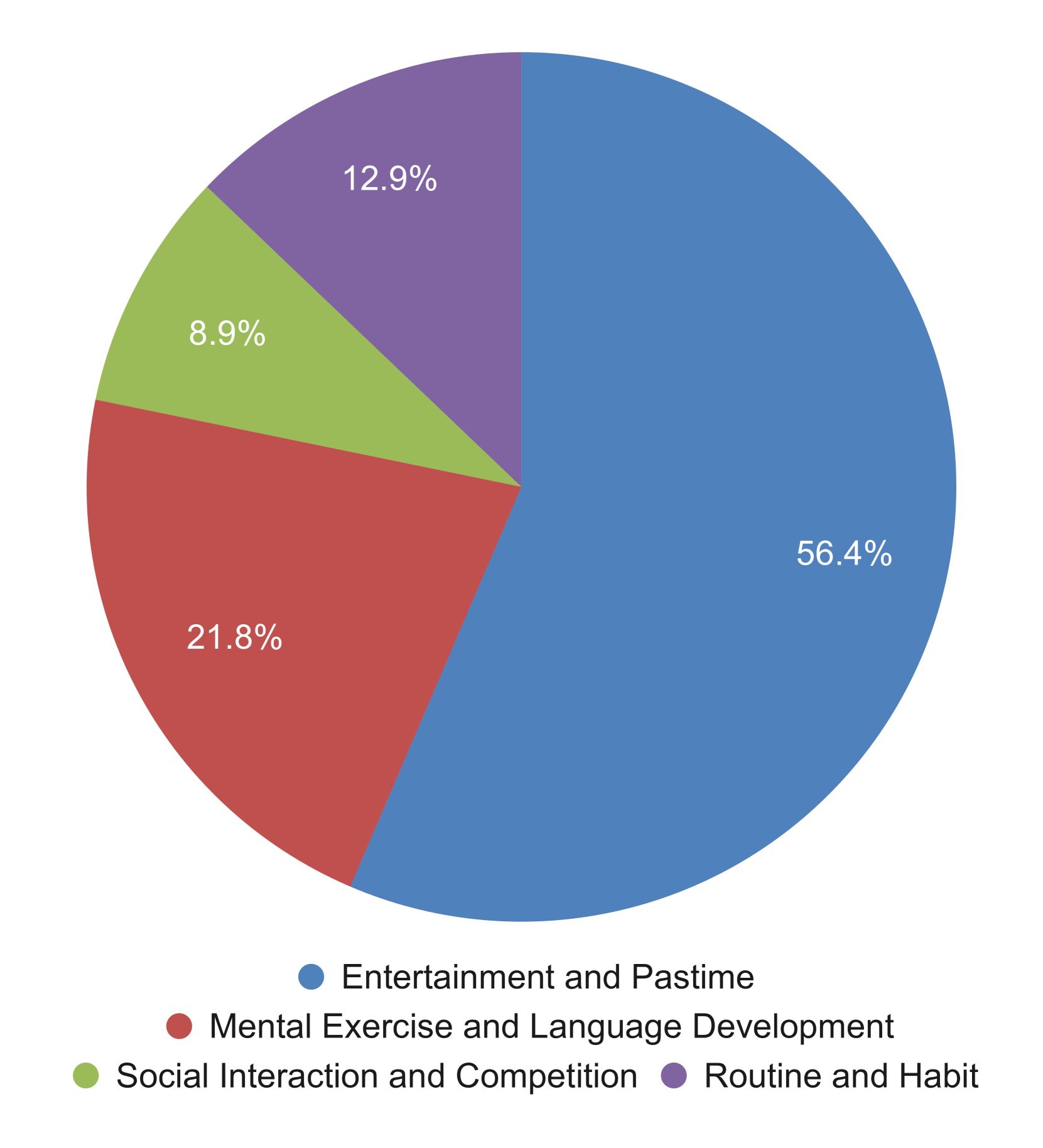

本文研究了在过去两年多的时间里,日常猜词游戏玩家所演变的策略。通过对25%的频繁玩家进行的调查,揭示了他们的策略以及持续参与每日游戏的动机。此外,本文还探讨了几种流行的开源大语言模型系统和开源模型在理解和玩两种不同语言的猜词游戏方面的能力。结果表明,某些模型在保持正确的猜测长度和避免重复生成方面存在困难,并且会出现幻觉,生成不存在的单词和词形变化。

🔬 方法详解

问题定义:论文旨在分析人类玩家在猜词游戏中的策略,并评估大语言模型在玩猜词游戏时的能力,尤其是在多语言环境下的表现。现有方法缺乏对人类策略的量化分析,也缺乏对大语言模型在猜词游戏中的多语言能力的系统评估。现有大语言模型可能难以理解游戏规则,生成不符合规则的答案,或者出现幻觉问题。

核心思路:论文的核心思路是结合人类玩家的策略分析和大语言模型的实验评估。首先,通过调查问卷收集人类玩家的策略和动机。然后,利用这些数据来指导大语言模型在猜词游戏中的训练和评估。通过对比人类玩家和大语言模型的表现,揭示模型在理解和执行策略方面的优缺点。

技术框架:论文的技术框架主要包括两个部分:人类策略分析和大语言模型实验。人类策略分析部分采用问卷调查的方法,收集玩家的策略、动机和游戏经验。大语言模型实验部分,选择了几种流行的开源大语言模型,并在两种不同语言的猜词游戏中进行测试。评估指标包括猜测的准确率、猜测的长度是否符合规则、是否出现重复猜测以及是否出现幻觉词。

关键创新:论文的关键创新在于结合了人类策略分析和大语言模型实验,从人类玩家的角度来评估大语言模型在猜词游戏中的能力。此外,论文还关注了多语言环境下的猜词游戏,揭示了现有大语言模型在处理不同语言时可能遇到的问题。

关键设计:在人类策略分析方面,问卷设计涵盖了玩家的常用策略、起始词选择、信息利用方式等多个方面。在大语言模型实验方面,采用了零样本学习的方式,直接让模型玩猜词游戏,并观察其表现。没有对模型进行专门的微调,以便更好地评估模型的通用能力。评估指标包括猜测的准确率、猜测的长度是否符合规则、是否出现重复猜测以及是否出现幻觉词。

🖼️ 关键图片

📊 实验亮点

实验结果表明,某些大语言模型在猜词游戏中难以保持正确的猜测长度,并会生成重复的猜测。此外,模型还会出现幻觉,生成不存在的单词和词形变化。这些问题在多语言环境下尤为突出,表明现有大语言模型在处理不同语言时仍存在挑战。

🎯 应用场景

该研究的潜在应用领域包括:提升大语言模型在自然语言理解和生成方面的能力,改进人机交互系统,以及开发更智能的教育游戏。通过理解人类玩家的策略,可以设计出更具挑战性和趣味性的游戏,同时也可以帮助大语言模型更好地理解人类的思维方式。

📄 摘要(原文)

At the beginning of 2022, a simplistic word-guessing game took the world by storm and was further adapted to many languages beyond the original English version. In this paper, we examine the strategies of daily word-guessing game players that have evolved during a period of over two years. A survey gathered from 25% of frequent players reveals their strategies and motivations for continuing the daily journey. We also explore the capability of several popular open-access large language model systems and open-source models at comprehending and playing the game in two different languages. Results highlight the struggles of certain models to maintain correct guess length and generate repetitions, as well as hallucinations of non-existent words and inflections.