Schrodinger's Memory: Large Language Models

作者: Wei Wang, Qing Li

分类: cs.CL

发布日期: 2024-09-16 (更新: 2024-09-27)

💡 一句话要点

基于量子力学视角,探究大语言模型(LLM)的记忆机制与评估方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 记忆机制 通用逼近定理 模型评估 量子力学 薛定谔的猫 人工智能

📋 核心要点

- 现有研究缺乏对大语言模型(LLM)记忆能力及其底层理论的深入探索,阻碍了对LLM认知机制的理解。

- 论文提出LLM的记忆类似于“薛定谔的记忆”,只有在被查询时才显现,并用通用逼近定理(UAT)解释其记忆机制。

- 通过实验验证了不同LLM的记忆能力,并提出了一种基于记忆能力评估LLM的新方法,为LLM的评估提供了新视角。

📝 摘要(中文)

记忆是人类一切活动的基础。随着大语言模型(LLM)的发展,其语言能力越来越接近人类。LLM是否具有记忆?从目前的表现来看,LLM似乎确实表现出记忆能力。那么,这种记忆的底层机制是什么?以往的研究缺乏对LLM记忆能力和底层理论的深入探索。本文利用通用逼近定理(UAT)来解释LLM中的记忆机制。我们还进行了实验,验证了各种LLM的记忆能力,并提出了一种基于这些记忆能力来评估它们能力的新方法。我们认为LLM的记忆就像薛定谔的记忆,只有在查询特定记忆时才会变得可观察。我们只能根据模型对查询的输出来确定模型是否保留了记忆;否则,它仍然是不确定的。最后,我们扩展了这个概念,比较了人脑和LLM的记忆能力,突出了它们操作机制的异同。

🔬 方法详解

问题定义:现有方法缺乏对LLM记忆机制的深入理解,无法有效评估LLM的记忆能力。以往的研究主要集中在LLM的语言生成能力上,而忽略了其记忆能力的本质和评估方法。这使得我们难以理解LLM是如何存储和检索信息的,也无法有效地利用LLM的记忆能力来解决实际问题。

核心思路:论文的核心思路是将LLM的记忆类比于量子力学中的“薛定谔的猫”,即记忆只有在被查询时才会显现。基于此,论文利用通用逼近定理(UAT)来解释LLM的记忆机制,并提出了一种新的基于记忆能力的LLM评估方法。这种设计旨在揭示LLM记忆的本质,并提供一种更全面的LLM评估方法。

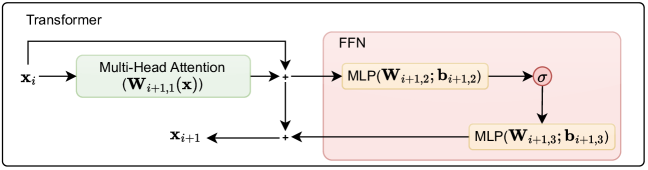

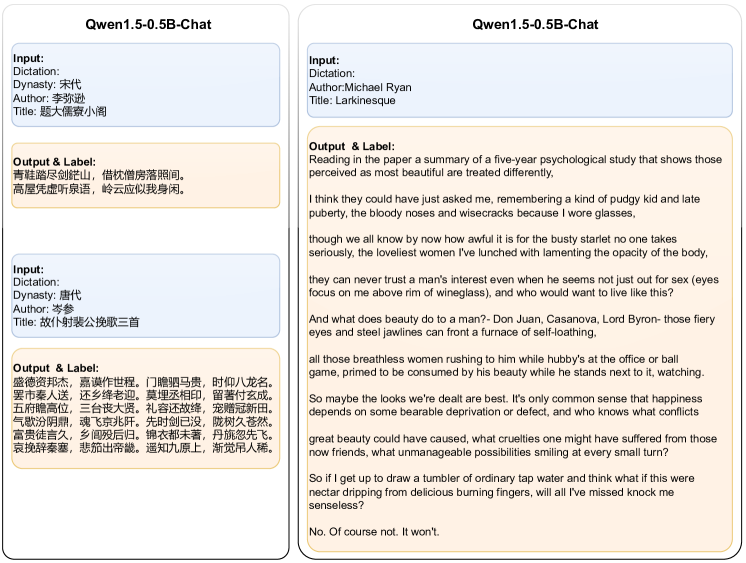

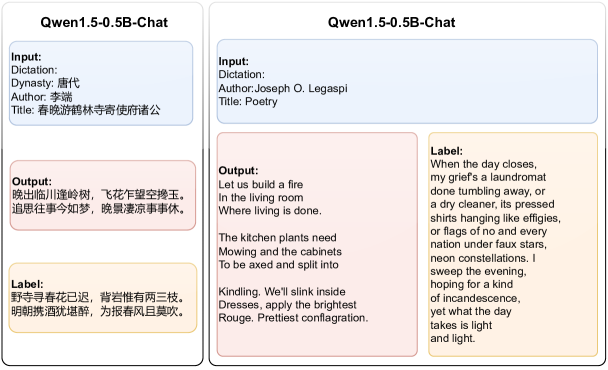

技术框架:论文的技术框架主要包括三个部分:首先,使用通用逼近定理(UAT)来解释LLM的记忆机制,认为LLM通过学习大量的参数来逼近各种函数,从而实现记忆的存储。其次,设计实验来验证不同LLM的记忆能力,包括对LLM进行特定信息的记忆测试,并分析其输出结果。最后,提出一种基于记忆能力的LLM评估方法,通过评估LLM在不同记忆任务上的表现来衡量其整体能力。

关键创新:论文最重要的技术创新点在于提出了“薛定谔的记忆”这一概念,并将LLM的记忆类比于量子力学中的不确定性。这种类比为理解LLM的记忆机制提供了一个新的视角,并为LLM的评估提供了一种新的思路。与现有方法相比,该方法更加关注LLM记忆的本质,并能够更全面地评估LLM的能力。

关键设计:论文的关键设计包括:1) 使用通用逼近定理(UAT)来解释LLM的记忆机制,这需要对UAT有深入的理解。2) 设计合适的实验来验证LLM的记忆能力,这需要仔细选择记忆任务和评估指标。3) 提出一种基于记忆能力的LLM评估方法,这需要对LLM的整体能力有全面的认识。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了不同LLM的记忆能力,并提出了一种基于记忆能力评估LLM的新方法。具体的性能数据、对比基线、提升幅度等实验结果在摘要中未提及,属于未知信息。但该研究为LLM的评估提供了一个新的视角。

🎯 应用场景

该研究成果可应用于提升LLM在知识密集型任务中的表现,例如问答系统、知识图谱构建和信息检索。通过更深入地理解和评估LLM的记忆能力,可以开发出更高效、更可靠的LLM应用,并推动人工智能技术在各个领域的应用。

📄 摘要(原文)

Memory is the foundation of all human activities; without memory, it would be nearly impossible for people to perform any task in daily life. With the development of Large Language Models (LLMs), their language capabilities are becoming increasingly comparable to those of humans. But do LLMs have memory? Based on current performance, LLMs do appear to exhibit memory. So, what is the underlying mechanism of this memory? Previous research has lacked a deep exploration of LLMs' memory capabilities and the underlying theory. In this paper, we use Universal Approximation Theorem (UAT) to explain the memory mechanism in LLMs. We also conduct experiments to verify the memory capabilities of various LLMs, proposing a new method to assess their abilities based on these memory ability. We argue that LLM memory operates like Schrödinger's memory, meaning that it only becomes observable when a specific memory is queried. We can only determine if the model retains a memory based on its output in response to the query; otherwise, it remains indeterminate. Finally, we expand on this concept by comparing the memory capabilities of the human brain and LLMs, highlighting the similarities and differences in their operational mechanisms.