Thinking Before Speaking: A Role-playing Model with Mindset

作者: Baohua Zhang, Yongyi Huang, Wenyao Cui, Huaping Zhang

分类: cs.CL, cs.AI

发布日期: 2024-09-14

💡 一句话要点

提出基于思维模式的角色扮演模型,提升LLM的角色模拟真实度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 角色扮演 大型语言模型 思维模式 知识表示 模型微调

📋 核心要点

- 现有LLM角色扮演易被识别,缺乏角色特定知识和逻辑处理能力。

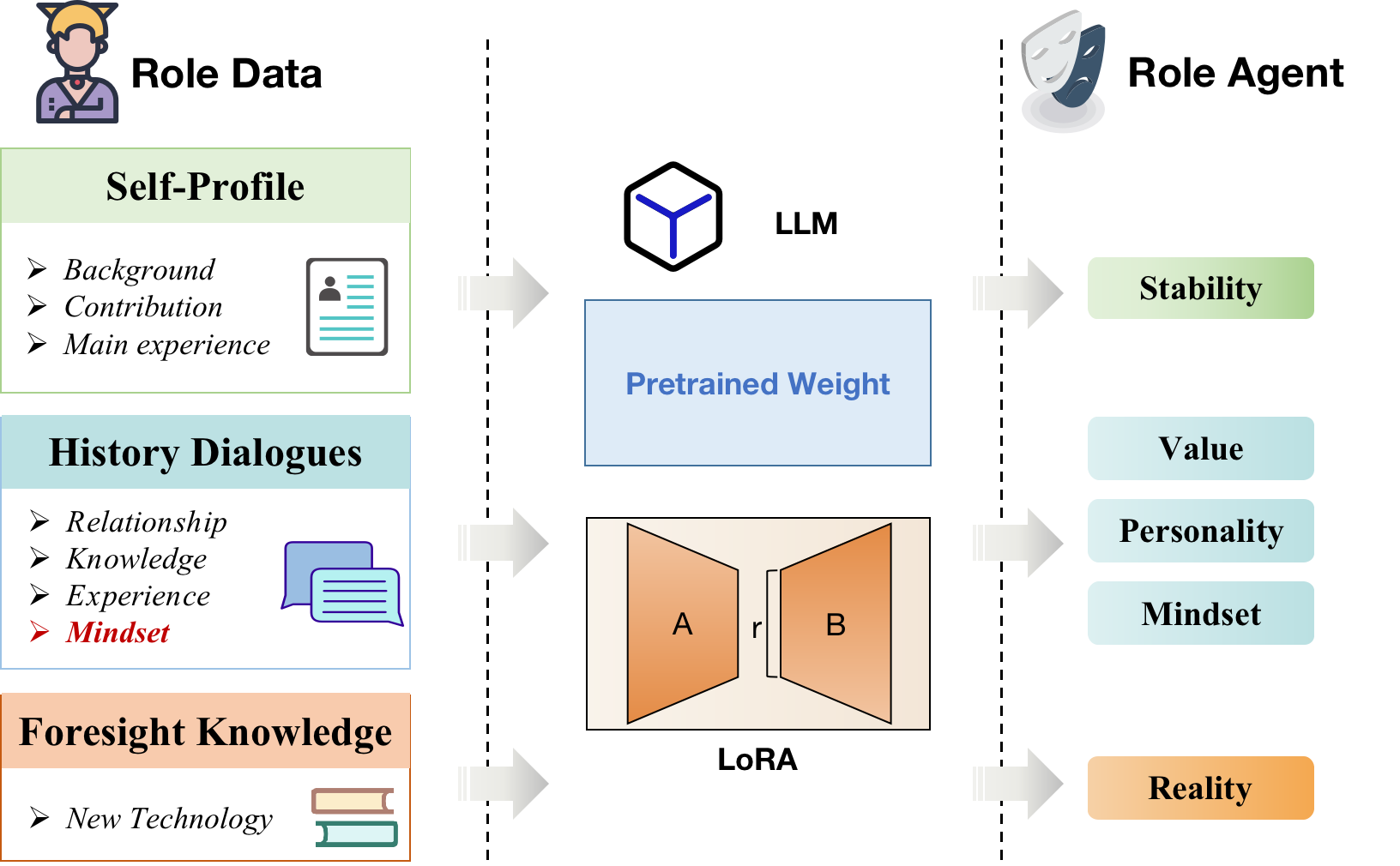

- TBS模型通过扩展角色数据,补充思维模式,并微调LLM,使其采纳角色思考方式。

- 实验表明,TBS模型在语气、知识和思维模式上,能更真实地模拟角色。

📝 摘要(中文)

角色扮演对于大型语言模型(LLMs)来说是一项简单的任务,因为它们擅长模拟人类行为。目前许多研究通过微调模型或使用专门的提示,使LLMs能够以特定角色的语气生成回复。然而,通常很容易识别出LLMs何时在扮演角色。当面对角色不具备的知识,或者需要角色的特定经验或逻辑来回答的问题时,这些模型往往表现不佳。为了解决这个问题,并使LLMs更像真实的角色,本文提出了一种“先思考后发言”(Thinking Before Speaking, TBS)模型。与其他研究不同,我们首先基于角色的真实生活场景和历史对话来扩展数据,并为每对对话补充角色的思维模式。然后,我们添加少量包含角色知识范围之外元素的数据点,并微调LLMs。这种方法可以帮助LLMs采纳角色的思考过程和逻辑,避免超出角色知识库的回复。我们还准备了一个数据集和评估指标来测试这些能力。实验结果表明,我们的TBS模型在语气、知识和思维模式方面可以更好地模拟角色。

🔬 方法详解

问题定义:现有的大型语言模型在进行角色扮演时,虽然可以通过微调或prompt工程模拟特定角色的语气,但往往缺乏角色自身的知识背景和思维逻辑。当遇到超出角色知识范围的问题,或者需要角色特定经验来回答的问题时,LLM的表现会明显下降,容易被识别出是在“扮演”而非“成为”角色。因此,需要解决的问题是如何让LLM在角色扮演时,不仅模仿语气,还能具备角色的思维模式和知识体系。

核心思路:论文的核心思路是让LLM在生成回复之前,先“思考”角色的思维模式。具体来说,就是通过构建包含角色思维模式的数据集,并在此基础上微调LLM,使其能够学习角色的思考方式和逻辑。这样,LLM在进行角色扮演时,就能更好地理解角色的知识范围和行为准则,从而生成更符合角色设定的回复。

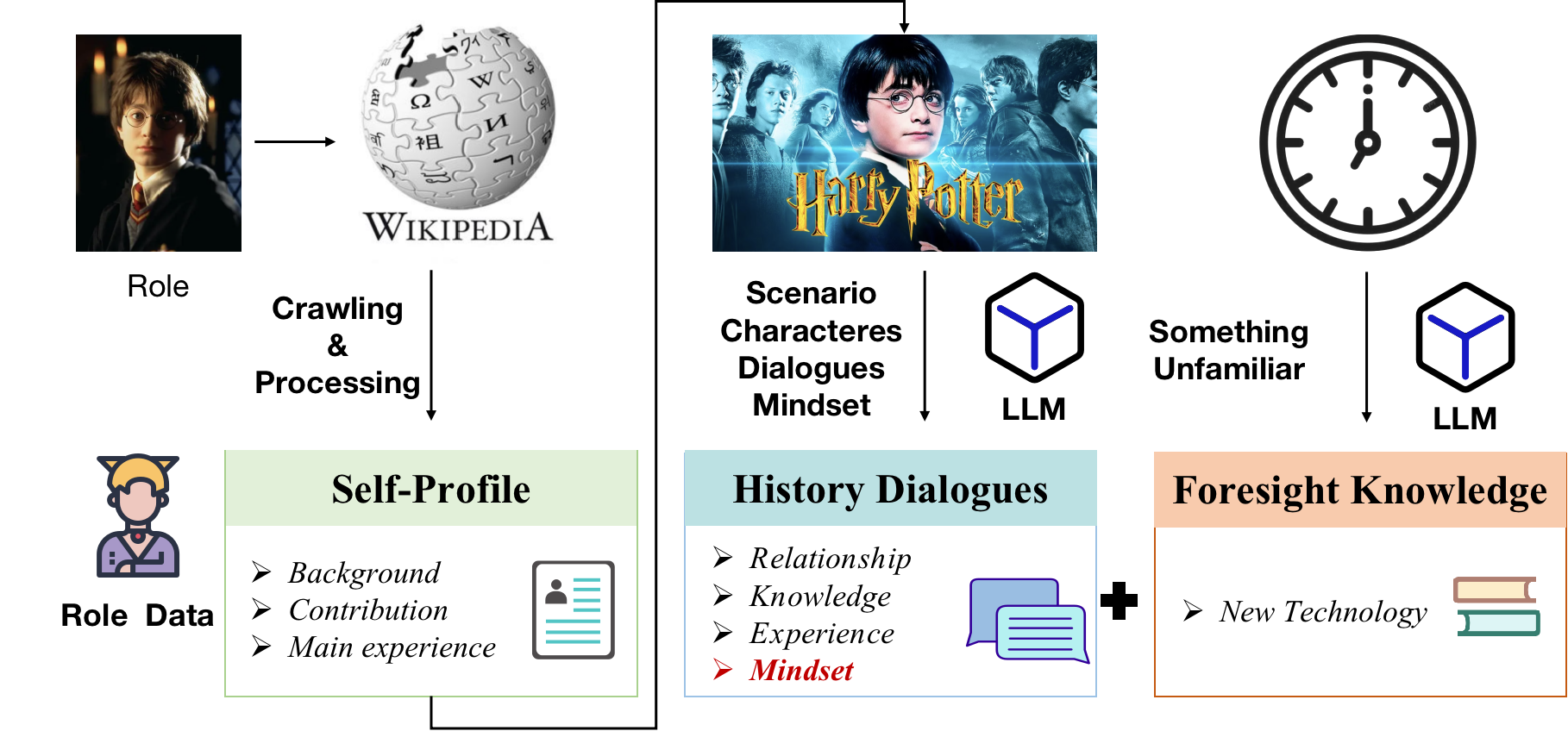

技术框架:TBS模型的技术框架主要包含以下几个步骤:1) 数据扩展:基于角色的真实生活场景和历史对话,扩展数据集,并为每对对话补充角色的思维模式。思维模式可以包括角色的信念、价值观、目标等。2) 数据增强:添加少量包含角色知识范围之外元素的数据点,用于训练模型处理超出角色知识范围的问题。3) 模型微调:使用扩展后的数据集微调LLM,使其学习角色的思维模式和知识体系。4) 评估:使用专门设计的评估指标,评估模型在语气、知识和思维模式方面的角色扮演能力。

关键创新:论文最重要的技术创新点在于引入了“思维模式”的概念,并将其融入到LLM的角色扮演训练中。与以往只关注语气和风格的方法不同,TBS模型更加注重让LLM理解角色的内在逻辑和知识体系,从而实现更真实的模拟。此外,论文还提出了针对角色扮演的评估指标,用于衡量模型在知识和思维模式方面的表现。

关键设计:在数据扩展阶段,需要仔细设计思维模式的表示方式,使其能够准确地反映角色的内在逻辑。在模型微调阶段,需要选择合适的损失函数和优化器,以确保模型能够有效地学习角色的思维模式。此外,还需要控制数据增强的比例,避免模型过度拟合训练数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TBS模型在语气、知识和思维模式方面均优于基线模型。具体来说,TBS模型能够更好地处理超出角色知识范围的问题,并生成更符合角色设定的回复。论文还提出了新的评估指标,用于衡量模型在知识和思维模式方面的表现,为未来的研究提供了参考。

🎯 应用场景

该研究成果可应用于智能客服、虚拟助手、游戏AI等领域。通过让AI具备更真实的角色扮演能力,可以提升用户体验,增强人机交互的自然性和流畅性。例如,在游戏中,AI可以扮演更加生动和可信的角色,为玩家提供更沉浸式的体验。在教育领域,可以创建更逼真的虚拟教师或辅导员,提供个性化的学习支持。

📄 摘要(原文)

Role-playing is an easy task for Large Language Models (LLMs), as they are skilled at simulating human behaviors. Many current studies have enabled LLMs to generate responses in the tone of a specific role by fine-tuning the models or using specialized prompts. However, it is typically easy to recognize when a role is being played by LLMs. These models tend to perform poorly when confronted with knowledge that the assumed role does not possess, or a question that requires the specific experience or logic of the role to answer. To address this problem and make LLMs act more like real roles, we propose a Thinking Before Speaking (TBS) model in this paper. Unlike other studies, we first extend the data based on the character's real-life scenarios and the historical dialogue, supplementing each pair of dialogue with the character's mindset. Then we add few data points that include elements beyond the role's knowledge, and fine-tune the LLMs. This approach can help LLMs adopt the role's thought process and logic, avoiding responses that fall outside the role's knowledge base. We have also prepared a dataset and evaluation metrics to test these capabilities. Experimental results show that our TBS model can better emulate a role in terms of tone, knowledge, and mindset.