Salmon: A Suite for Acoustic Language Model Evaluation

作者: Gallil Maimon, Amit Roth, Yossi Adi

分类: cs.SD, cs.CL, eess.AS

发布日期: 2024-09-11 (更新: 2025-01-15)

备注: ICASSP 2025, project page - https://pages.cs.huji.ac.il/adiyoss-lab/salmon/

💡 一句话要点

提出SALMon:用于评估声学语言模型的新型评测套件

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 语音语言模型 声学评估 评测基准 情感识别 背景噪声 说话人身份 房间脉冲响应

📋 核心要点

- 现有的语音语言模型评估缺乏对声学信息的全面考量,无法充分评估模型对情感、噪声等因素的感知能力。

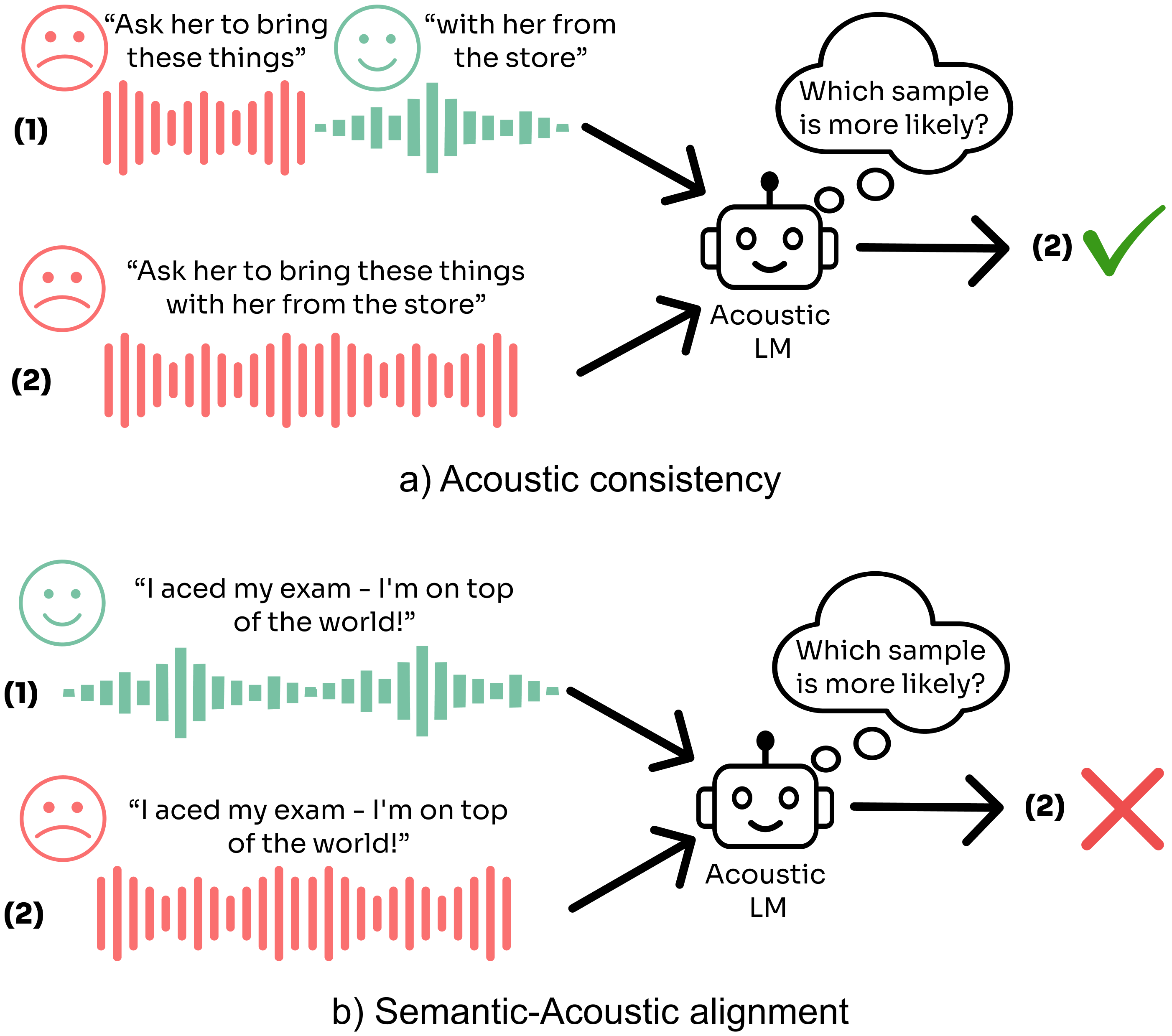

- SALMon评测套件通过建模方法,比较模型对正确和错误样本的评分,从而快速评估模型对声学因素的理解程度。

- 实验结果展示了不同语音语言模型在SALMon上的表现,揭示了它们在处理不同声学因素时的优势和不足。

📝 摘要(中文)

语音语言模型最近展现出作为通用语音处理系统的巨大潜力。这类模型能够对音频信号中丰富的声学信息进行建模,超越了口语内容本身,例如情感、背景噪声等。然而,目前缺乏能够评估模型对各种声学因素感知能力的评测基准。为了弥补这一差距,我们推出了SALMon,这是一个新颖的评测套件,涵盖了背景噪声、情感、说话人身份和房间脉冲响应。所提出的基准既评估了被检查元素的一致性,也评估了它与口语文本的匹配程度。我们采用基于建模的方法,衡量模型是否给正确的样本赋予比错误样本更高的分数。这种方法使得即使对于大型模型,基准测试的计算速度也很快。我们在SALMon上评估了几个语音语言模型,从而突出了每种评估方法的优点和缺点。我们公开了代码和数据。

🔬 方法详解

问题定义:论文旨在解决语音语言模型评估中缺乏对声学信息(如情感、背景噪声、说话人身份和房间脉冲响应)全面评估的问题。现有评估方法主要集中在语音识别准确率上,忽略了模型对非语言声学特征的理解能力,这限制了语音语言模型在更广泛应用场景中的潜力。

核心思路:论文的核心思路是构建一个综合性的评测套件,通过比较模型对正确和错误样本的评分来评估其对不同声学因素的感知能力。这种基于建模的评估方法避免了复杂的特征工程和人工标注,使得评估过程更加高效和可扩展。

技术框架:SALMon评测套件包含四个主要模块,分别对应背景噪声、情感、说话人身份和房间脉冲响应。每个模块都包含一系列正负样本对,其中正样本是与口语文本一致的声学信息,负样本则是不一致的声学信息。评估过程包括:1) 使用语音语言模型对正负样本进行评分;2) 计算模型对正样本的平均得分和对负样本的平均得分;3) 根据得分差异评估模型在该声学因素上的表现。

关键创新:SALMon的关键创新在于其基于建模的评估方法,它避免了传统评估方法中对特定声学特征的依赖,而是直接评估模型对整体声学场景的理解能力。此外,SALMon提供了一个统一的评估框架,可以方便地评估不同语音语言模型在多个声学因素上的表现。

关键设计:SALMon的关键设计包括:1) 针对每个声学因素精心设计的正负样本对,确保能够有效区分模型对该因素的感知能力;2) 使用评分差异作为评估指标,能够更准确地反映模型对正负样本的区分能力;3) 提供易于使用的代码和数据,方便研究人员进行评估和比较。

🖼️ 关键图片

📊 实验亮点

论文在SALMon上评估了多个语音语言模型,结果表明不同模型在不同声学因素上的表现差异显著。例如,某些模型在情感识别方面表现出色,但在处理背景噪声方面表现较差。这些结果突出了SALMon作为评估语音语言模型声学感知能力的重要工具的价值,并为未来的模型改进提供了方向。

🎯 应用场景

SALMon评测套件可用于评估和改进语音语言模型在各种实际应用场景中的性能,例如语音助手、情感识别、说话人验证和语音增强等。通过使用SALMon,研究人员可以更好地了解模型的优势和不足,从而开发出更鲁棒、更智能的语音处理系统。此外,SALMon还可以促进语音语言模型在更广泛领域的应用,例如医疗保健、教育和娱乐等。

📄 摘要(原文)

Speech language models have recently demonstrated great potential as universal speech processing systems. Such models have the ability to model the rich acoustic information existing in audio signals, beyond spoken content, such as emotion, background noise, etc. Despite this, evaluation benchmarks which evaluate awareness to a wide range of acoustic aspects, are lacking. To help bridge this gap, we introduce SALMon, a novel evaluation suite encompassing background noise, emotion, speaker identity and room impulse response. The proposed benchmarks both evaluate the consistency of the inspected element and how much it matches the spoken text. We follow a modelling based approach, measuring whether a model gives correct samples higher scores than incorrect ones. This approach makes the benchmark fast to compute even for large models. We evaluated several speech language models on SALMon, thus highlighting the strengths and weaknesses of each evaluated method. We make the code and data publicly available at https://pages.cs.huji.ac.il/adiyoss-lab/salmon/ .