MMEvol: Empowering Multimodal Large Language Models with Evol-Instruct

作者: Run Luo, Haonan Zhang, Longze Chen, Ting-En Lin, Xiong Liu, Yuchuan Wu, Min Yang, Minzheng Wang, Pengpeng Zeng, Lianli Gao, Heng Tao Shen, Yunshui Li, Xiaobo Xia, Fei Huang, Jingkuan Song, Yongbin Li

分类: cs.CL

发布日期: 2024-09-09 (更新: 2024-12-31)

💡 一句话要点

MMEvol:通过指令进化赋能多模态大语言模型,提升数据质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 指令数据进化 视觉推理 数据增强 认知推理

📋 核心要点

- 多模态大语言模型依赖大规模指令数据,但现有数据在多样性和复杂性上存在不足,限制了模型性能。

- MMEvol框架通过精细感知、认知推理和交互进化,迭代提升指令数据质量,生成更复杂多样的图像-文本数据。

- 实验结果表明,MMEvol在多个视觉-语言任务上显著提升模型性能,并以更少数据达到SOTA水平。

📝 摘要(中文)

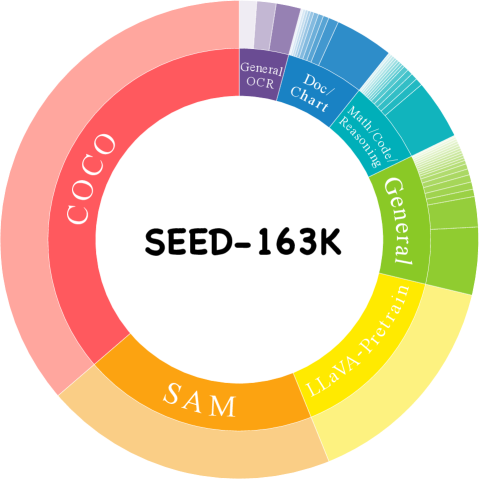

多模态大语言模型(MLLM)的发展在各个领域的需求不断增长,取得了显著进展。虽然模型驱动的方法试图通过多样化的架构来增强 MLLM 的能力,但收益已变得越来越小。相反,数据驱动的方法,即扩大图像-文本指令数据的规模,更有效,但面临数据多样性和复杂性有限的挑战。缺乏高质量的数据构成了 MLLM 发展的一个重大障碍。为了解决数据质量瓶颈,我们提出了一种新的多模态指令数据进化框架 MMEvol。该框架通过精细的感知、认知推理和交互进化相结合,迭代地提高数据质量,生成更复杂和多样化的图像-文本指令数据集,从而增强 MLLM 的能力。从最初的指令集 SEED-163K 开始,我们利用 MMEvol 系统地扩大指令类型的多样性,扩展视觉推理步骤以提高认知推理能力,并彻底探索图像中的精细信息以增强视觉理解和鲁棒性。为了全面评估我们方法的有效性,我们对 13 个视觉-语言任务进行了广泛的定性分析和定量实验。与使用初始种子数据训练的基线模型相比,结果表明我们的方法实现了平均 3.1 个百分点的准确率提升。此外,与最先进的模型相比,我们的方法使用明显更少的数据在九个任务中达到了最先进(SOTA)的性能。

🔬 方法详解

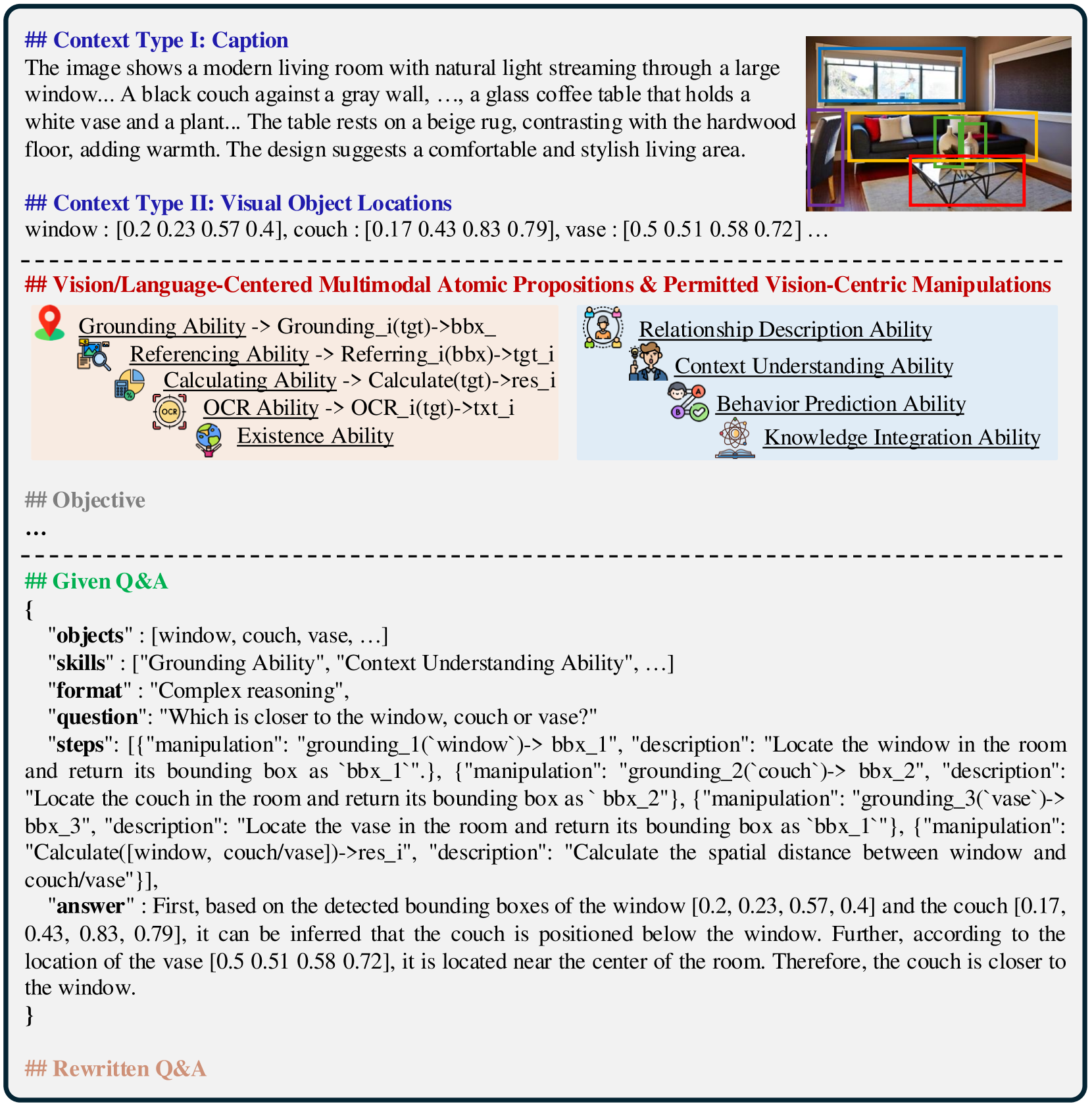

问题定义:现有的多模态大语言模型(MLLM)依赖于大规模的图像-文本指令数据进行训练,然而,这些数据的质量,特别是其多样性和复杂性,往往不足。这导致模型在处理复杂视觉推理和细粒度视觉理解任务时表现受限。现有方法要么依赖模型架构的改进,但收益递减;要么简单地扩大数据规模,但无法有效提升数据质量。因此,如何生成高质量、多样化的多模态指令数据成为一个关键问题。

核心思路:MMEvol的核心思路是通过一个迭代的进化过程,逐步提升多模态指令数据的质量。该方法模拟了人类学习的过程,从简单的指令开始,逐步增加指令的复杂度和多样性。通过精细的感知、认知推理和交互进化,MMEvol能够生成更具挑战性的指令数据,从而提升MLLM的性能。这种数据驱动的方法避免了对模型架构的过度依赖,更加注重数据本身的力量。

技术框架:MMEvol框架包含三个主要阶段:精细感知、认知推理和交互进化。首先,精细感知阶段旨在增强模型对图像细节的理解能力,例如识别图像中的细微差异或特定对象。其次,认知推理阶段通过增加推理步骤的长度和复杂度,提升模型的推理能力。最后,交互进化阶段则通过模拟人机交互,生成更具动态性和多样性的指令数据。这三个阶段相互协作,共同提升数据质量。

关键创新:MMEvol的关键创新在于其迭代进化的数据生成方式。与传统的静态数据生成方法不同,MMEvol能够根据模型的表现,动态调整数据生成的策略,从而生成更具针对性的训练数据。此外,MMEvol将精细感知、认知推理和交互进化三个方面结合起来,全面提升了数据的质量和多样性。

关键设计:MMEvol框架的具体实现细节未知,但可以推测其可能包含以下关键设计:1) 使用预训练的多模态模型作为数据生成器,利用其强大的生成能力;2) 设计特定的损失函数,鼓励生成更具挑战性和多样性的指令数据;3) 采用强化学习等技术,根据模型的反馈,优化数据生成的策略;4) 精心设计每个阶段的具体实现方式,例如,在精细感知阶段,可能使用注意力机制来关注图像的细节区域。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MMEvol在13个视觉-语言任务上取得了显著的性能提升,平均准确率提升了3.1个百分点。更重要的是,MMEvol在9个任务上达到了SOTA水平,并且使用了明显少于SOTA模型的数据。这表明MMEvol能够更有效地利用数据,提升模型的性能。

🎯 应用场景

MMEvol具有广泛的应用前景,可用于提升多模态智能体的能力,例如在机器人导航、智能客服、自动驾驶等领域。通过生成高质量的训练数据,MMEvol可以显著提升这些智能体在复杂环境中的感知、推理和决策能力。此外,MMEvol还可以用于生成更具创意性的多模态内容,例如自动生成图像描述、故事创作等。

📄 摘要(原文)

The development of Multimodal Large Language Models (MLLMs) has seen significant advancements with increasing demands in various fields (e.g., multimodal agents, embodied intelligence). While model-driven approaches attempt to enhance MLLMs capabilities through diverse architectures, the gains have become increasingly marginal. Conversely, data-driven methods, which scale up image-text instruction data, are more effective but face limited data diversity and complexity challenges. The absence of high-quality data constitutes a significant development barrier for MLLMs. To address the data quality bottleneck, we propose MMEvol, a novel multimodal instruction data evolution framework. This framework iteratively improve data quality through a refined combination of fine-grained perception, cognitive reasoning, and interaction evolution, generating a more complex and diverse image-text instruction dataset that empowers MLLMs with enhanced capabilities. Beginning with an initial set of instructions, SEED-163K, we utilize MMEvol to systematically broaden the diversity of instruction types, extend visual reasoning steps to improve cognitive reasoning abilities, and thoroughly explore fine-grained information within images to enhance visual understanding and robustness. To comprehensively evaluate the effectiveness of our approach, we conduct extensive qualitative analysis and quantitative experiments across 13 vision-language tasks. Compared to baseline models trained with the initial seed data, the results demonstrate that our method achieves an average accuracy improvement of 3.1 percentage points. Furthermore, our approach reaches state-of-the-art (SOTA) performance in nine tasks using significantly less data compared to state-of-the-art models.