Constrained Multi-Layer Contrastive Learning for Implicit Discourse Relationship Recognition

作者: Yiheng Wu, Junhui Li, Muhua Zhu

分类: cs.CL

发布日期: 2024-09-07

💡 一句话要点

提出约束多层对比学习方法,提升隐式篇章关系识别性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 隐式篇章关系识别 对比学习 多层神经网络 表征学习 自然语言处理

📋 核心要点

- 现有IDRR方法依赖复杂神经网络,中间层能力不一,难以有效区分不同类别。

- 提出约束多层对比学习,增强表征学习,约束高层损失小于低层损失。

- 在PDTB2.0和3.0数据集上,多类和二元分类性能均显著提升。

📝 摘要(中文)

本文针对隐式篇章关系识别(IDRR)任务,现有方法通常将其视为分类问题,即使使用BERT和RoBERTa等预训练语言模型,IDRR仍然依赖于复杂的多层神经网络来捕获两个篇章单元之间的交互。因此,这些中间层的输出在区分不同类别的实例时可能具有不同的能力。为此,我们提出了一种监督对比学习(CL)方法,即以标签和实例为中心的CL,以增强表征学习。此外,我们提出了一种新颖的约束多层CL方法,以适当地施加约束,即较高层的对比损失应小于较低层的对比损失。在PDTB 2.0和PDTB 3.0上的实验结果表明,我们的方法可以显著提高多类分类和二元分类的性能。

🔬 方法详解

问题定义:隐式篇章关系识别(IDRR)旨在识别文本中没有显式连接词连接的两个篇章单元之间的语义关系。现有方法,即使是基于预训练语言模型的方法,通常依赖于复杂的多层神经网络来捕获两个篇章单元之间的交互。然而,这些中间层的输出在区分不同类别的实例时可能具有不同的能力,导致模型性能受限。现有方法的痛点在于未能充分利用中间层的信息,并且缺乏对不同层级表征能力的有效约束。

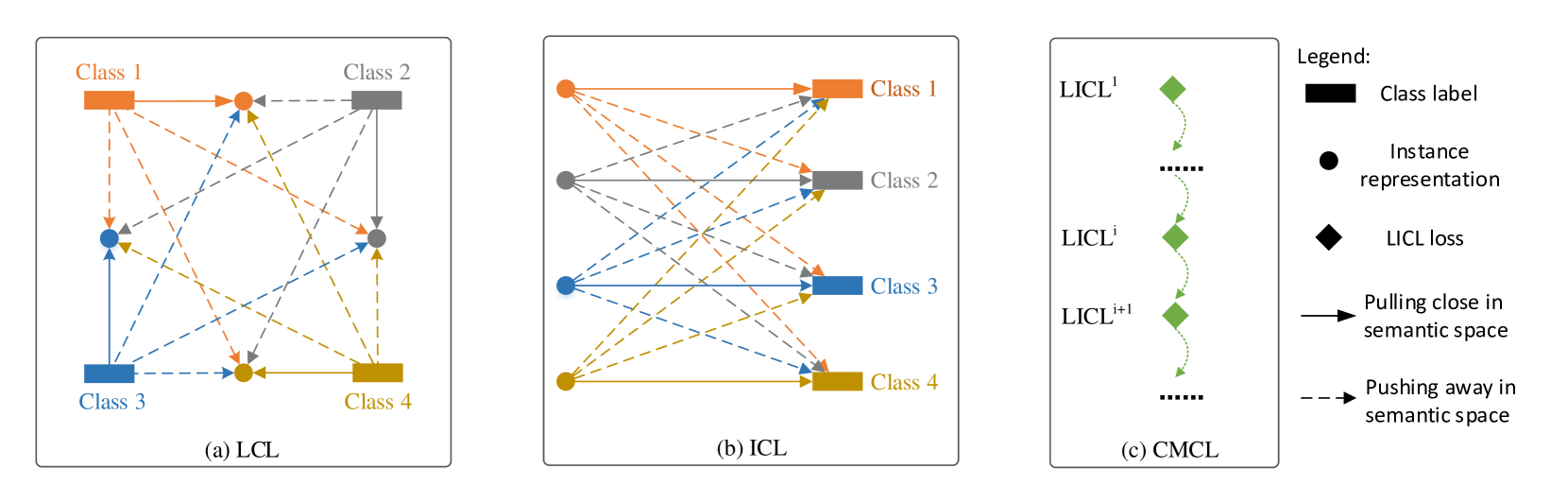

核心思路:本文的核心思路是利用对比学习(Contrastive Learning, CL)来增强表征学习,并引入层级约束,使得模型能够更好地利用多层神经网络的中间层信息。通过对比学习,模型能够学习到更具区分性的表征,从而提高IDRR的性能。同时,通过约束高层损失小于低层损失,可以引导模型学习到更稳定、更抽象的表征。

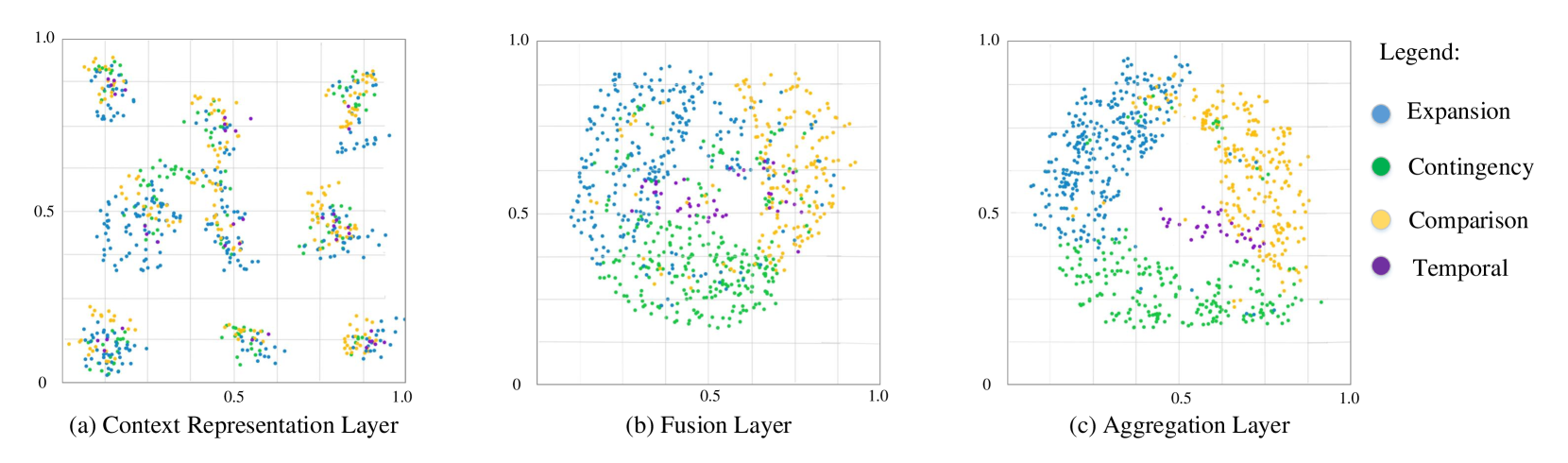

技术框架:整体框架包括以下几个主要模块: 1. 预训练语言模型编码器:使用BERT或RoBERTa等预训练语言模型对两个篇章单元进行编码,得到初始的表征。 2. 多层神经网络:使用多层神经网络进一步提取特征,得到不同层级的表征。 3. 对比学习模块:在每个中间层应用对比学习,增强表征的区分性。 4. 约束模块:对不同层级的对比损失进行约束,使得高层损失小于低层损失。 5. 分类器:使用最终的表征进行分类,预测篇章关系。

关键创新:本文的关键创新在于提出了约束多层对比学习方法。具体来说,包括以下两点: 1. 标签和实例为中心的对比学习:传统的对比学习方法通常只考虑实例之间的关系,而忽略了标签信息。本文提出的方法同时考虑了标签和实例信息,使得模型能够学习到更具区分性的表征。 2. 约束多层对比学习:本文提出了对不同层级的对比损失进行约束,使得高层损失小于低层损失。这种约束可以引导模型学习到更稳定、更抽象的表征,从而提高IDRR的性能。

关键设计: 1. 对比损失函数:采用了标签和实例为中心的对比损失函数,具体形式未知,但应包含正负样本对的构建和损失计算。 2. 层级约束:对不同层级的对比损失进行约束,具体约束形式未知,但应保证高层损失小于低层损失。 3. 网络结构:使用了多层神经网络来提取特征,具体层数和结构未知,但应保证能够提取到不同层级的表征。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的约束多层对比学习方法在PDTB 2.0和PDTB 3.0数据集上均取得了显著的性能提升。具体提升幅度未知,但摘要中明确指出是“显著提高”,表明该方法具有较强的有效性。该方法在多类分类和二元分类任务上均表现出色,证明了其通用性。

🎯 应用场景

该研究成果可应用于自然语言处理的多个领域,例如文本摘要、机器翻译、问答系统等。通过提高篇章关系识别的准确性,可以提升这些应用在理解文本语义方面的能力。此外,该方法还可以推广到其他需要理解文本结构和语义关系的NLP任务中,具有广泛的应用前景。

📄 摘要(原文)

Previous approaches to the task of implicit discourse relation recognition (IDRR) generally view it as a classification task. Even with pre-trained language models, like BERT and RoBERTa, IDRR still relies on complicated neural networks with multiple intermediate layers to proper capture the interaction between two discourse units. As a result, the outputs of these intermediate layers may have different capability in discriminating instances of different classes. To this end, we propose to adapt a supervised contrastive learning (CL) method, label- and instance-centered CL, to enhance representation learning. Moreover, we propose a novel constrained multi-layer CL approach to properly impose a constraint that the contrastive loss of higher layers should be smaller than that of lower layers. Experimental results on PDTB 2.0 and PDTB 3.0 show that our approach can significantly improve the performance on both multi-class classification and binary classification.