Can OpenSource beat ChatGPT? -- A Comparative Study of Large Language Models for Text-to-Code Generation

作者: Luis Mayer, Christian Heumann, Matthias Aßenmacher

分类: cs.CL, cs.LG, cs.SE

发布日期: 2024-09-06

备注: Conference Paper accepted at the 9th SwissText Conference (2024)

💡 一句话要点

对比研究:ChatGPT等大型语言模型在文本生成代码任务中的性能评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 文本生成代码 代码生成 ChatGPT LeetCode

📋 核心要点

- 现有文本生成代码模型在处理复杂编程问题时存在性能差异,缺乏系统性的对比评估。

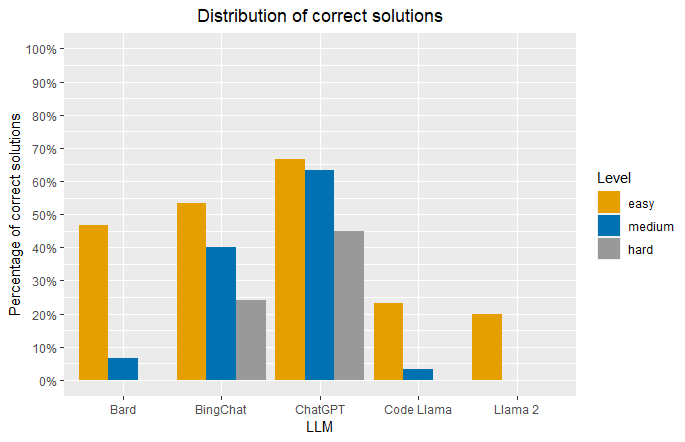

- 该研究通过LeetCode编程题,对比Bard、BingChat、ChatGPT、Llama2和Code Llama等模型生成Python代码的质量。

- 实验结果表明,ChatGPT在解决编程挑战方面表现最佳,即使与专门的代码生成模型相比也更胜一筹。

📝 摘要(中文)

近年来,大型语言模型(LLMs)已成为强大的工具,在包括软件工程在内的各个领域具有潜在的应用。本研究评估了五个不同的最先进的LLMs——Bard、BingChat、ChatGPT、Llama2和Code Llama——在文本生成代码方面的能力。在一项实证研究中,我们将来自编程网站LeetCode的编码问题的文本描述提示输入到模型中,任务是用Python创建解决方案。随后,使用LeetCode的测试功能评估生成的输出的质量。结果表明,所研究的模型之间的性能存在很大差异。ChatGPT能够最有效地处理这些典型的编程挑战,甚至超过了像Code Llama这样专门用于代码的模型。为了获得更深入的了解,我们测量了生成输出的运行时间和内存使用情况,并将它们与Leetcode上的其他代码提交进行了比较。详细的错误分析,包括对生成的代码在正确的缩进和形式方面的差异的比较,以及将错误解决的任务分配到某些错误类别,使我们能够更细致地了解结果和改进的潜力。结果还显示,当模型面临大量上下文(以更长的提示形式)时,产生的不正确代码的模式越来越明显。

🔬 方法详解

问题定义:论文旨在评估和比较不同大型语言模型(LLMs)在文本到代码生成任务中的性能。现有方法缺乏对不同LLM在解决实际编程问题能力上的系统性评估,特别是对于代码专业模型与通用LLM的对比。此外,现有研究较少关注生成代码的效率(运行时和内存占用)以及错误类型分析。

核心思路:论文的核心思路是通过LeetCode上的编程问题作为基准,将问题的文本描述作为prompt输入到不同的LLM中,然后评估生成的Python代码的正确性、效率和错误类型。通过这种方式,可以系统地比较不同LLM在解决实际编程问题时的能力,并识别它们的优势和劣势。

技术框架:该研究的技术框架主要包括以下几个步骤: 1. 问题选择:从LeetCode中选择一系列编程问题,这些问题具有不同的难度和类型。 2. Prompt构建:将LeetCode问题的文本描述作为prompt,输入到不同的LLM中。 3. 代码生成:使用LLM生成Python代码。 4. 代码评估:使用LeetCode的测试功能评估生成代码的正确性。同时,测量生成代码的运行时和内存占用。 5. 错误分析:对错误解决的任务进行错误类型分析,并比较不同LLM生成的代码在缩进和格式上的差异。

关键创新:该研究的关键创新在于: 1. 系统性对比评估:对多个主流LLM(包括通用LLM和代码专业LLM)在文本到代码生成任务中进行了系统性的对比评估。 2. 多维度评估:不仅评估了生成代码的正确性,还评估了生成代码的效率(运行时和内存占用)以及错误类型。 3. 详细错误分析:对错误解决的任务进行了详细的错误类型分析,为改进LLM的代码生成能力提供了有价值的 insights。

关键设计:该研究的关键设计包括: 1. LeetCode作为基准:选择LeetCode作为基准,因为它提供了大量的编程问题和测试用例,可以方便地评估生成代码的正确性。 2. Python作为目标语言:选择Python作为目标语言,因为它是一种流行的编程语言,并且被广泛用于数据科学和机器学习领域。 3. 运行时和内存占用测量:测量生成代码的运行时和内存占用,以评估生成代码的效率。 4. 错误类型分类:对错误解决的任务进行错误类型分类,例如语法错误、逻辑错误等,以便更好地理解LLM的错误模式。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ChatGPT在解决LeetCode编程问题方面表现最佳,显著优于其他模型,包括专门的代码生成模型Code Llama。此外,研究还发现,当输入更长的prompt时,模型生成错误代码的概率会增加。对生成代码的运行时和内存占用进行了测量,并进行了详细的错误分析,为进一步改进LLM的代码生成能力提供了依据。

🎯 应用场景

该研究成果可应用于自动化代码生成、智能编程助手、软件开发教育等领域。通过了解不同LLM在代码生成方面的优劣,可以为开发者选择合适的工具提供参考,并促进LLM在软件工程领域的更广泛应用。未来的研究可以进一步探索如何改进LLM的代码生成能力,例如通过微调或prompt工程。

📄 摘要(原文)

In recent years, large language models (LLMs) have emerged as powerful tools with potential applications in various fields, including software engineering. Within the scope of this research, we evaluate five different state-of-the-art LLMs - Bard, BingChat, ChatGPT, Llama2, and Code Llama - concerning their capabilities for text-to-code generation. In an empirical study, we feed prompts with textual descriptions of coding problems sourced from the programming website LeetCode to the models with the task of creating solutions in Python. Subsequently, the quality of the generated outputs is assessed using the testing functionalities of LeetCode. The results indicate large differences in performance between the investigated models. ChatGPT can handle these typical programming challenges by far the most effectively, surpassing even code-specialized models like Code Llama. To gain further insights, we measure the runtime as well as the memory usage of the generated outputs and compared them to the other code submissions on Leetcode. A detailed error analysis, encompassing a comparison of the differences concerning correct indentation and form of the generated code as well as an assignment of the incorrectly solved tasks to certain error categories allows us to obtain a more nuanced picture of the results and potential for improvement. The results also show a clear pattern of increasingly incorrect produced code when the models are facing a lot of context in the form of longer prompts.