The representation landscape of few-shot learning and fine-tuning in large language models

作者: Diego Doimo, Alessandro Serra, Alessio Ansuini, Alberto Cazzaniga

分类: cs.CL, cs.LG

发布日期: 2024-09-05 (更新: 2024-09-07)

💡 一句话要点

通过分析表征概率图景,揭示大语言模型中ICL与SFT的差异化学习机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 上下文学习 监督微调 表征学习 概率图景

📋 核心要点

- 现有研究对ICL和SFT这两种提升LLM任务性能的策略,在模型内部表征上的差异知之甚少。

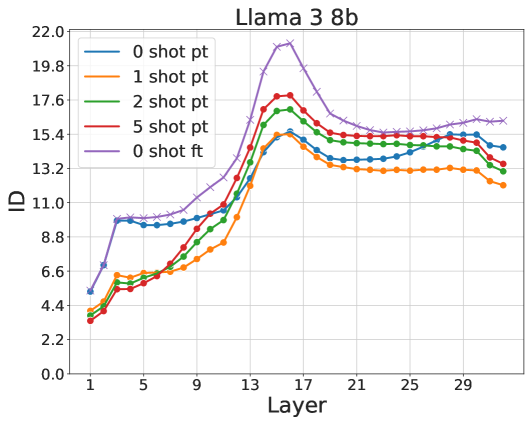

- 论文通过分析LLM隐藏层表征的概率图景,对比ICL和SFT在解决同一任务时的内部结构差异。

- 研究发现ICL和SFT在网络不同层级形成了显著不同的表征模式,揭示了LLM解决任务的多样化计算策略。

📝 摘要(中文)

本文研究了大型语言模型(LLM)中上下文学习(ICL)和监督微调(SFT)这两种常用策略,在提升特定任务性能时,是否会在LLM内部产生相似的表征。通过分析两种情况下隐藏层表征的概率图景,以问答任务为例,发现ICL和SFT创建了非常不同的内部结构,且都在网络中间经历了急剧的转变。在网络的前半部分,ICL塑造了可解释的、根据语义内容分层组织的表征。相比之下,SFT获得的概率图景更模糊,语义混合。在模型的后半部分,微调后的表征发展出能更好编码答案身份的概率模式,而ICL表征的图景则表现出不太明确的峰值。该方法揭示了LLM在不同条件下解决同一任务时所开发的多样化计算策略,为设计从语言模型中提取信息的优化方法迈出了一步。

🔬 方法详解

问题定义:论文旨在研究大型语言模型中,上下文学习(ICL)和监督微调(SFT)这两种常用的提升模型在特定任务上表现的方法,是否在模型内部产生了相似的表征。现有研究缺乏对这两种方法在模型内部运作机制的深入理解,无法解释为何它们在性能上可以达到相似的效果,也无法指导如何更有效地利用这两种方法。

核心思路:论文的核心思路是通过分析LLM在执行问答任务时,其内部隐藏层表征的概率图景,来比较ICL和SFT这两种方法所产生的表征差异。概率图景可以揭示模型内部表征的结构和组织方式,从而帮助理解不同学习策略对模型内部运作的影响。通过对比两种方法在不同网络层级的概率图景,可以深入了解它们如何处理和编码信息。

技术框架:论文的技术框架主要包括以下几个步骤:1. 选择一个问答任务作为研究对象。2. 使用ICL和SFT两种方法训练LLM。3. 提取LLM在执行问答任务时,各隐藏层的表征向量。4. 计算这些表征向量的概率密度,构建概率图景。5. 对比ICL和SFT在不同网络层级的概率图景,分析其差异。

关键创新:论文的关键创新在于使用概率图景来分析LLM内部表征。这种方法能够揭示表征的结构和组织方式,从而深入理解不同学习策略对模型内部运作的影响。此外,论文还发现了ICL和SFT在网络不同层级形成了显著不同的表征模式,这为理解LLM的学习机制提供了新的视角。

关键设计:论文的关键设计包括:1. 选择合适的问答任务,确保任务的复杂度和代表性。2. 使用标准的ICL和SFT训练流程,保证实验的可重复性。3. 选择合适的概率密度估计方法,准确地构建概率图景。4. 设计合理的指标,量化ICL和SFT在不同网络层级的概率图景差异。具体的参数设置、损失函数、网络结构等细节未在摘要中体现,属于未知信息。

🖼️ 关键图片

📊 实验亮点

研究发现,ICL在网络前半部分形成可解释的、语义分层组织的表征,而SFT则产生更模糊、语义混合的表征。在网络后半部分,SFT微调后的表征能更好编码答案身份,而ICL表征的峰值不明显。这些发现揭示了LLM在不同条件下解决同一任务时所开发的多样化计算策略。

🎯 应用场景

该研究成果可应用于优化大型语言模型的训练和推理过程,例如,可以根据ICL和SFT的特点,设计更有效的混合训练策略,或者根据不同任务的特点,选择更合适的学习方法。此外,该研究还可以帮助我们更好地理解LLM的内部运作机制,为开发更智能、更可控的语言模型奠定基础。

📄 摘要(原文)

In-context learning (ICL) and supervised fine-tuning (SFT) are two common strategies for improving the performance of modern large language models (LLMs) on specific tasks. Despite their different natures, these strategies often lead to comparable performance gains. However, little is known about whether they induce similar representations inside LLMs. We approach this problem by analyzing the probability landscape of their hidden representations in the two cases. More specifically, we compare how LLMs solve the same question-answering task, finding that ICL and SFT create very different internal structures, in both cases undergoing a sharp transition in the middle of the network. In the first half of the network, ICL shapes interpretable representations hierarchically organized according to their semantic content. In contrast, the probability landscape obtained with SFT is fuzzier and semantically mixed. In the second half of the model, the fine-tuned representations develop probability modes that better encode the identity of answers, while the landscape of ICL representations is characterized by less defined peaks. Our approach reveals the diverse computational strategies developed inside LLMs to solve the same task across different conditions, allowing us to make a step towards designing optimal methods to extract information from language models.