Debate on Graph: a Flexible and Reliable Reasoning Framework for Large Language Models

作者: Jie Ma, Zhitao Gao, Qi Chai, Wangchun Sun, Pinghui Wang, Hongbin Pei, Jing Tao, Lingyun Song, Jun Liu, Chen Zhang, Lizhen Cui

分类: cs.CL, cs.AI

发布日期: 2024-09-05

备注: 12 pages

🔗 代码/项目: GITHUB

💡 一句话要点

提出Debate on Graph (DoG)框架,提升LLM在知识图谱问答中的推理可靠性与灵活性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱问答 大型语言模型 推理 辩论 图神经网络

📋 核心要点

- 现有KGQA方法面临过长推理路径干扰答案生成和假阳性关系阻碍路径优化的挑战。

- DoG框架通过子图聚焦和多角色辩论机制,迭代优化推理路径,提高答案生成的准确性和可靠性。

- 实验结果表明,DoG在多个数据集上显著优于现有方法,并具有良好的LLM集成灵活性。

📝 摘要(中文)

大型语言模型(LLM)由于缺乏相关知识,在实际应用中可能出现幻觉。知识图谱包含广泛的多关系结构,存储了大量的符号事实。因此,将LLM与知识图谱集成已被广泛探索,知识图谱问答(KGQA)是集成的关键试金石。该任务要求LLM通过从知识图谱中检索相关三元组来回答自然语言问题。然而,现有方法面临两个重大挑战:过长的推理路径分散了答案生成,以及假阳性关系阻碍了路径的优化。本文提出了一个迭代交互式KGQA框架,利用LLM的交互学习能力在图上进行推理和辩论(DoG)。具体来说,DoG采用了一种子图聚焦机制,允许LLM在每个推理步骤后进行答案尝试,从而减轻了冗长推理路径的影响。另一方面,DoG利用一个多角色辩论团队来逐步简化复杂问题,减少假阳性关系的影响。这种辩论机制确保了推理过程的可靠性。在五个公共数据集上的实验结果表明了该架构的有效性和优越性。值得注意的是,DoG在WebQuestions和GrailQA上的准确率分别比最先进的方法ToG高出23.7%和9.1%。此外,在上述数据集上与各种LLM的集成实验突出了DoG的灵活性。

🔬 方法详解

问题定义:论文旨在解决知识图谱问答(KGQA)任务中,由于LLM推理路径过长和假阳性关系干扰导致的答案生成不准确问题。现有方法难以有效处理复杂问题,容易受到噪声关系的误导,导致推理过程偏离正确方向。

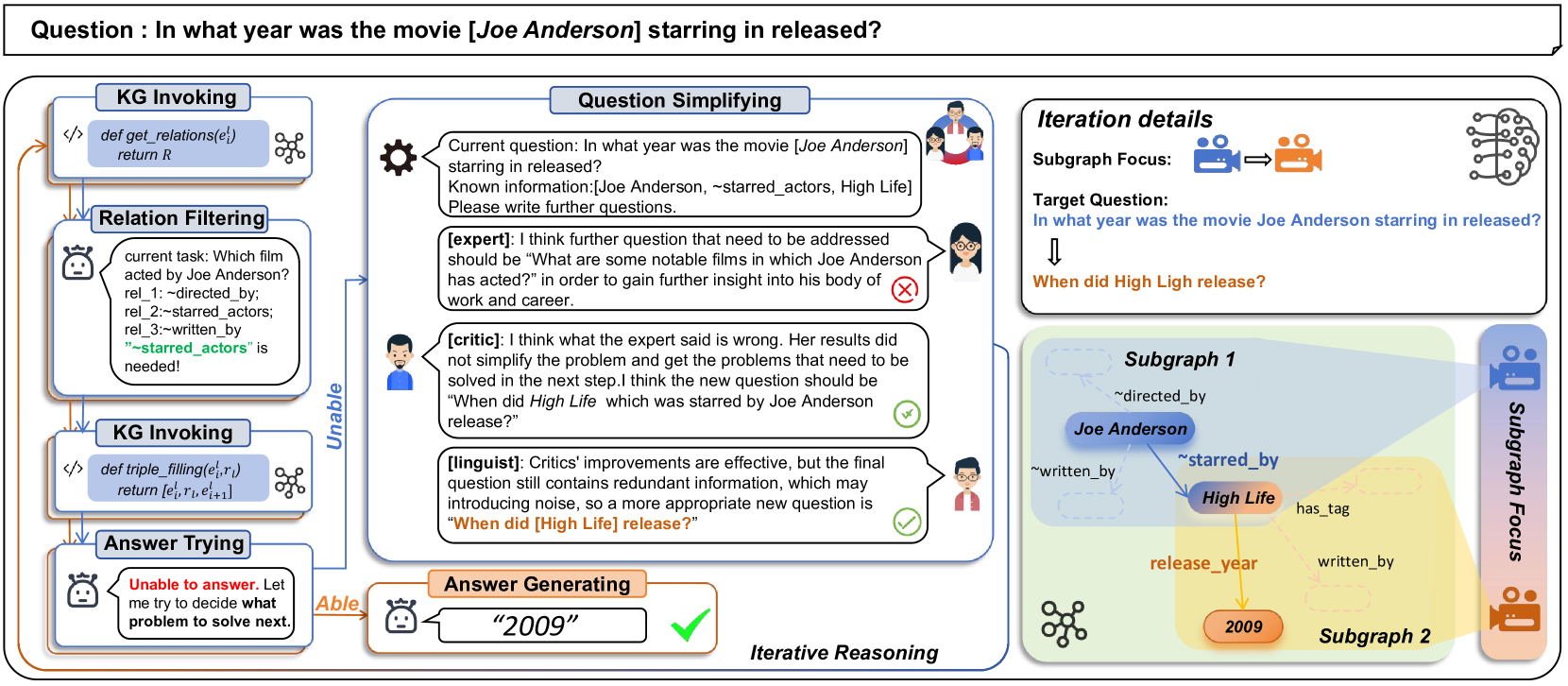

核心思路:论文的核心思路是引入迭代交互式的推理和辩论机制。通过子图聚焦,限制LLM的推理范围,避免过长的推理路径。同时,利用多角色辩论团队,对问题进行逐步简化和澄清,减少假阳性关系的影响,从而提高推理的可靠性。

技术框架:DoG框架包含以下主要模块:1) 问题编码器:将自然语言问题编码为向量表示。2) 子图聚焦模块:根据问题表示,从知识图谱中提取相关的子图。3) 多角色辩论团队:由多个具有不同角色的LLM组成,例如提问者、回答者、质疑者等,共同对问题进行分析和推理。4) 答案生成模块:根据辩论结果,生成最终答案。整个流程是迭代进行的,每次迭代都会更新子图和问题表示,直到生成满意的答案。

关键创新:DoG的关键创新在于其迭代交互式的推理和辩论机制。与传统的单步推理方法不同,DoG允许LLM在推理过程中进行多次尝试和修正,从而更好地处理复杂问题。多角色辩论团队的设计,模拟了人类的辩论过程,可以有效地识别和消除假阳性关系的影响。

关键设计:子图聚焦模块使用基于图神经网络(GNN)的方法,学习节点和关系的表示,并根据问题表示计算注意力权重,从而选择最相关的子图。多角色辩论团队中的每个角色都由一个独立的LLM实现,并使用不同的提示语进行引导。损失函数包括答案预测损失和辩论一致性损失,用于优化整个框架的性能。

🖼️ 关键图片

📊 实验亮点

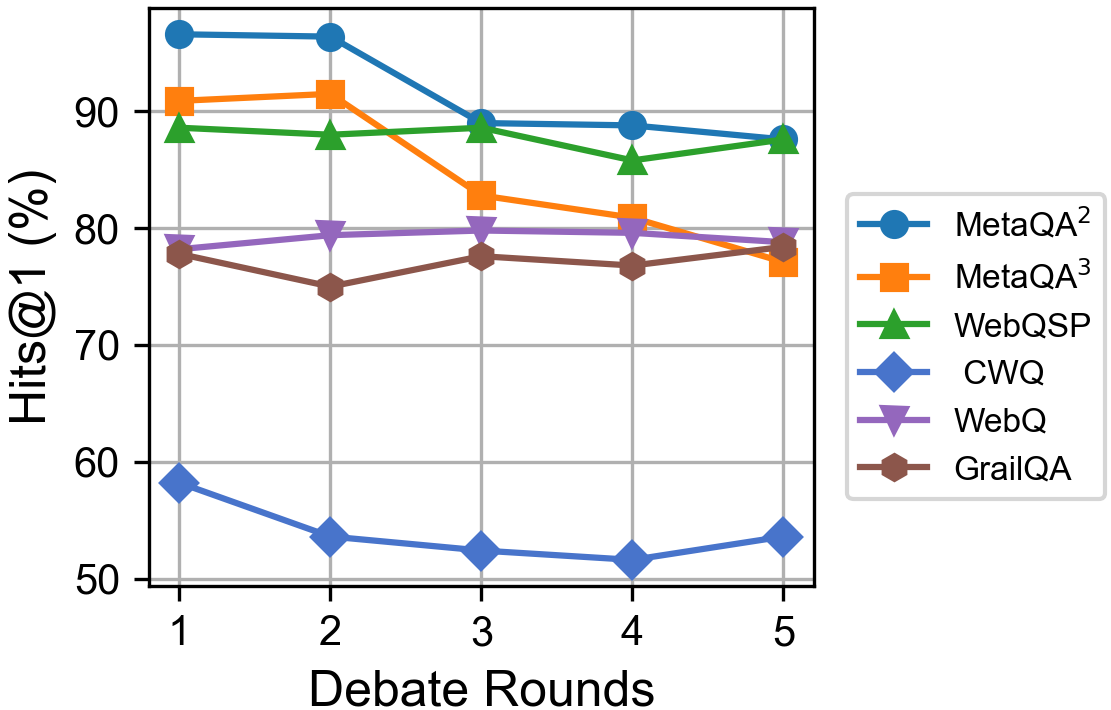

DoG在WebQuestions和GrailQA数据集上取得了显著的性能提升,准确率分别比最先进的方法ToG高出23.7%和9.1%。实验结果表明,DoG能够有效地处理复杂问题,并减少假阳性关系的影响。此外,DoG具有良好的LLM集成灵活性,可以与不同的LLM结合使用,进一步提升性能。

🎯 应用场景

DoG框架可应用于智能问答系统、知识图谱检索、语义搜索等领域。通过提高LLM在知识图谱上的推理能力,可以为用户提供更准确、更可靠的答案。该研究对于构建更智能、更可信赖的人工智能系统具有重要意义,并有望在医疗、金融、教育等领域发挥重要作用。

📄 摘要(原文)

Large Language Models (LLMs) may suffer from hallucinations in real-world applications due to the lack of relevant knowledge. In contrast, knowledge graphs encompass extensive, multi-relational structures that store a vast array of symbolic facts. Consequently, integrating LLMs with knowledge graphs has been extensively explored, with Knowledge Graph Question Answering (KGQA) serving as a critical touchstone for the integration. This task requires LLMs to answer natural language questions by retrieving relevant triples from knowledge graphs. However, existing methods face two significant challenges: \textit{excessively long reasoning paths distracting from the answer generation}, and \textit{false-positive relations hindering the path refinement}. In this paper, we propose an iterative interactive KGQA framework that leverages the interactive learning capabilities of LLMs to perform reasoning and Debating over Graphs (DoG). Specifically, DoG employs a subgraph-focusing mechanism, allowing LLMs to perform answer trying after each reasoning step, thereby mitigating the impact of lengthy reasoning paths. On the other hand, DoG utilizes a multi-role debate team to gradually simplify complex questions, reducing the influence of false-positive relations. This debate mechanism ensures the reliability of the reasoning process. Experimental results on five public datasets demonstrate the effectiveness and superiority of our architecture. Notably, DoG outperforms the state-of-the-art method ToG by 23.7\% and 9.1\% in accuracy on WebQuestions and GrailQA, respectively. Furthermore, the integration experiments with various LLMs on the mentioned datasets highlight the flexibility of DoG. Code is available at \url{https://github.com/reml-group/DoG}.