CLUE: Concept-Level Uncertainty Estimation for Large Language Models

作者: Yu-Hsiang Wang, Andrew Bai, Che-Ping Tsai, Cho-Jui Hsieh

分类: cs.CL, cs.LG

发布日期: 2024-09-04

💡 一句话要点

提出概念级不确定性估计CLUE,提升LLM生成结果的可解释性与可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 不确定性估计 概念级表示 幻觉检测 自然语言生成 可解释性 提示工程

📋 核心要点

- 现有LLM不确定性估计方法侧重于序列级别,忽略了序列内部各概念的不确定性差异。

- CLUE框架将LLM输出分解为概念级表示,独立评估每个概念的不确定性。

- 实验表明,CLUE提供更可解释的不确定性估计,并应用于幻觉检测和故事生成。

📝 摘要(中文)

大型语言模型(LLMs)在各种自然语言生成(NLG)任务中表现出卓越的能力。先前的研究表明,LLMs的生成过程涉及不确定性。然而,现有的不确定性估计方法主要集中在序列级别,忽略了序列中各个信息的独立性。这些方法无法单独评估序列中每个组成部分的不确定性。为了解决这个问题,我们提出了一种新的LLM概念级不确定性估计(CLUE)框架。我们利用LLMs将输出序列转换为概念级表示,将序列分解为独立的概念,并分别测量每个概念的不确定性。实验表明,与句子级不确定性相比,CLUE可以提供更具可解释性的不确定性估计结果,并且可以作为幻觉检测和故事生成等各种任务的有用工具。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)的不确定性估计方法主要关注整个生成序列的不确定性,而忽略了序列中各个概念的不确定性差异。这种序列级别的估计无法提供细粒度的信息,限制了其在幻觉检测、可信度评估等任务中的应用。现有方法无法有效区分序列中哪些概念是可靠的,哪些概念是不可靠的。

核心思路:CLUE的核心思路是将LLM的输出序列分解为一系列独立的概念,并对每个概念的不确定性进行单独评估。通过将序列分解为更小的、语义更明确的单元,可以更精确地捕捉到LLM在生成过程中对不同概念的置信度。这种细粒度的不确定性估计可以为下游任务提供更丰富的信息。

技术框架:CLUE框架主要包含以下几个步骤:1) 概念提取:利用LLM将输出序列转换为概念级表示。这可以通过提示工程(Prompt Engineering)或者微调LLM来实现,使其能够将句子分解为一系列相关的概念。2) 不确定性量化:对于每个提取出的概念,使用某种不确定性量化方法来估计其不确定性。这可以基于LLM的输出概率分布、或者使用集成方法等。3) 不确定性聚合:根据具体任务的需求,可以将各个概念的不确定性进行聚合,得到序列级别的不确定性估计。

关键创新:CLUE的关键创新在于将不确定性估计从序列级别推进到概念级别。与现有方法相比,CLUE能够提供更细粒度、更可解释的不确定性估计结果。这种概念级别的估计可以更好地反映LLM在生成过程中对不同信息的置信度,从而为下游任务提供更可靠的依据。

关键设计:论文中可能使用了特定的提示工程技巧来引导LLM进行概念提取。例如,可以使用特定的指令,要求LLM将句子分解为一系列关键词或短语。此外,论文可能还采用了特定的不确定性量化方法,例如基于蒙特卡洛dropout或者深度集成的变分推理方法。具体的参数设置、损失函数和网络结构等技术细节需要在论文中进一步查找。

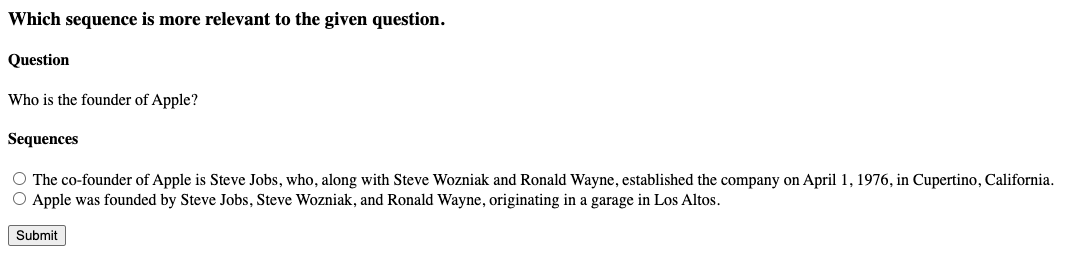

🖼️ 关键图片

📊 实验亮点

实验结果表明,CLUE能够提供比句子级别不确定性估计更具可解释性的结果。具体性能数据未知,但论文强调CLUE在幻觉检测和故事生成等任务中的有效性。与基线方法相比,CLUE在提供细粒度不确定性信息方面具有显著优势。

🎯 应用场景

CLUE框架可应用于多种场景,如幻觉检测,帮助识别LLM生成内容中不可靠的部分;故事生成,引导LLM生成更连贯和可信的故事;以及知识图谱构建,评估从文本中提取的概念的可靠性。该研究有助于提升LLM生成结果的质量和可信度,促进其在各个领域的应用。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable proficiency in various natural language generation (NLG) tasks. Previous studies suggest that LLMs' generation process involves uncertainty. However, existing approaches to uncertainty estimation mainly focus on sequence-level uncertainty, overlooking individual pieces of information within sequences. These methods fall short in separately assessing the uncertainty of each component in a sequence. In response, we propose a novel framework for Concept-Level Uncertainty Estimation (CLUE) for LLMs. We leverage LLMs to convert output sequences into concept-level representations, breaking down sequences into individual concepts and measuring the uncertainty of each concept separately. We conduct experiments to demonstrate that CLUE can provide more interpretable uncertainty estimation results compared with sentence-level uncertainty, and could be a useful tool for various tasks such as hallucination detection and story generation.