AgentRE: An Agent-Based Framework for Navigating Complex Information Landscapes in Relation Extraction

作者: Yuchen Shi, Guochao Jiang, Tian Qiu, Deqing Yang

分类: cs.CL

发布日期: 2024-09-03

备注: Accepted by CIKM 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出AgentRE框架,利用LLM解决复杂场景下的关系抽取难题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 关系抽取 大型语言模型 Agent框架 低资源学习 知识图谱 信息抽取 推理 复杂场景

📋 核心要点

- 复杂场景下的关系抽取面临关系类型多样和实体关系模糊等挑战,传统语言模型表现不佳。

- AgentRE框架利用大型语言模型的记忆、检索和反思能力,辅助Agent获取和处理信息,提升关系抽取性能。

- 实验结果表明AgentRE在英语和中文数据集上表现优异,尤其在低资源场景下,且可生成高质量训练数据。

📝 摘要(中文)

本文提出了一种基于Agent的关系抽取框架AgentRE,旨在解决复杂场景下关系抽取面临的挑战,例如关系类型多样和单个句子中实体间关系模糊等问题,这些问题导致纯粹的“文本输入,文本输出”语言模型(LMs)性能不佳。AgentRE充分利用大型语言模型(LLMs)的潜力,包括记忆、检索和反思能力,以实现复杂场景下的关系抽取。具体来说,AgentRE构建了三个主要模块,作为Agent获取和处理各种有用信息的工具,从而提高关系抽取性能。在英语和中文的两个数据集上的大量实验结果表明,AgentRE具有优越的性能,尤其是在低资源场景下。此外,AgentRE生成的轨迹可以被提炼,以构建高质量的训练数据集,该数据集包含不同的推理方法,可用于微调较小的模型。

🔬 方法详解

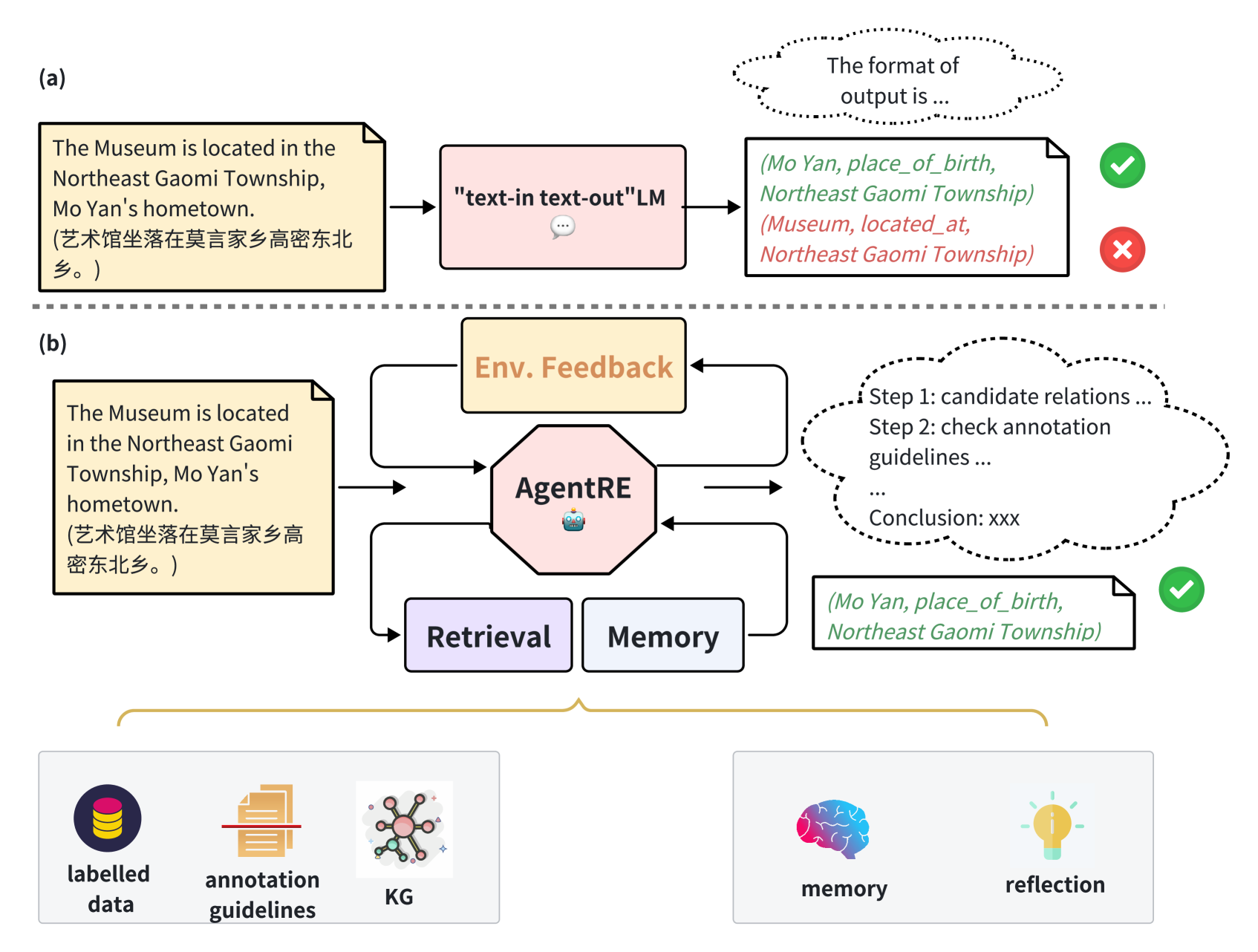

问题定义:论文旨在解决复杂场景下的关系抽取问题。现有方法,特别是纯粹的“文本输入,文本输出”的语言模型,在处理关系类型多样、实体关系模糊等复杂情况时表现不佳。这些痛点限制了关系抽取技术在实际应用中的效果。

核心思路:论文的核心思路是将关系抽取任务建模为一个Agent与环境交互的过程。Agent通过与环境交互,利用大型语言模型(LLMs)的记忆、检索和反思能力,逐步获取并处理信息,从而更准确地识别实体之间的关系。这种方法模拟了人类专家在解决复杂问题时的推理过程。

技术框架:AgentRE框架包含三个主要模块:记忆模块(Memory Module)、检索模块(Retrieval Module)和反思模块(Reflection Module)。记忆模块用于存储Agent的历史交互信息;检索模块用于从外部知识库或文档中检索相关信息;反思模块用于分析Agent的行动轨迹,并进行自我改进。Agent通过循环执行“观察-思考-行动”的步骤,不断与环境交互,最终完成关系抽取任务。

关键创新:AgentRE的关键创新在于将Agent的概念引入关系抽取任务,并充分利用了大型语言模型的推理能力。与传统的“文本输入,文本输出”方法不同,AgentRE能够通过与环境的交互,动态地获取和处理信息,从而更好地应对复杂场景。此外,AgentRE还能够生成可解释的推理轨迹,为模型的调试和改进提供了依据。

关键设计:AgentRE的具体实现细节包括:如何设计Agent的观察空间、行动空间和奖励函数;如何选择和配置大型语言模型;如何构建和维护外部知识库;如何设计记忆、检索和反思模块的具体算法。论文中可能还涉及一些超参数的设置,例如学习率、批次大小等。具体的损失函数和网络结构取决于所使用的大型语言模型和具体的任务设置。

🖼️ 关键图片

📊 实验亮点

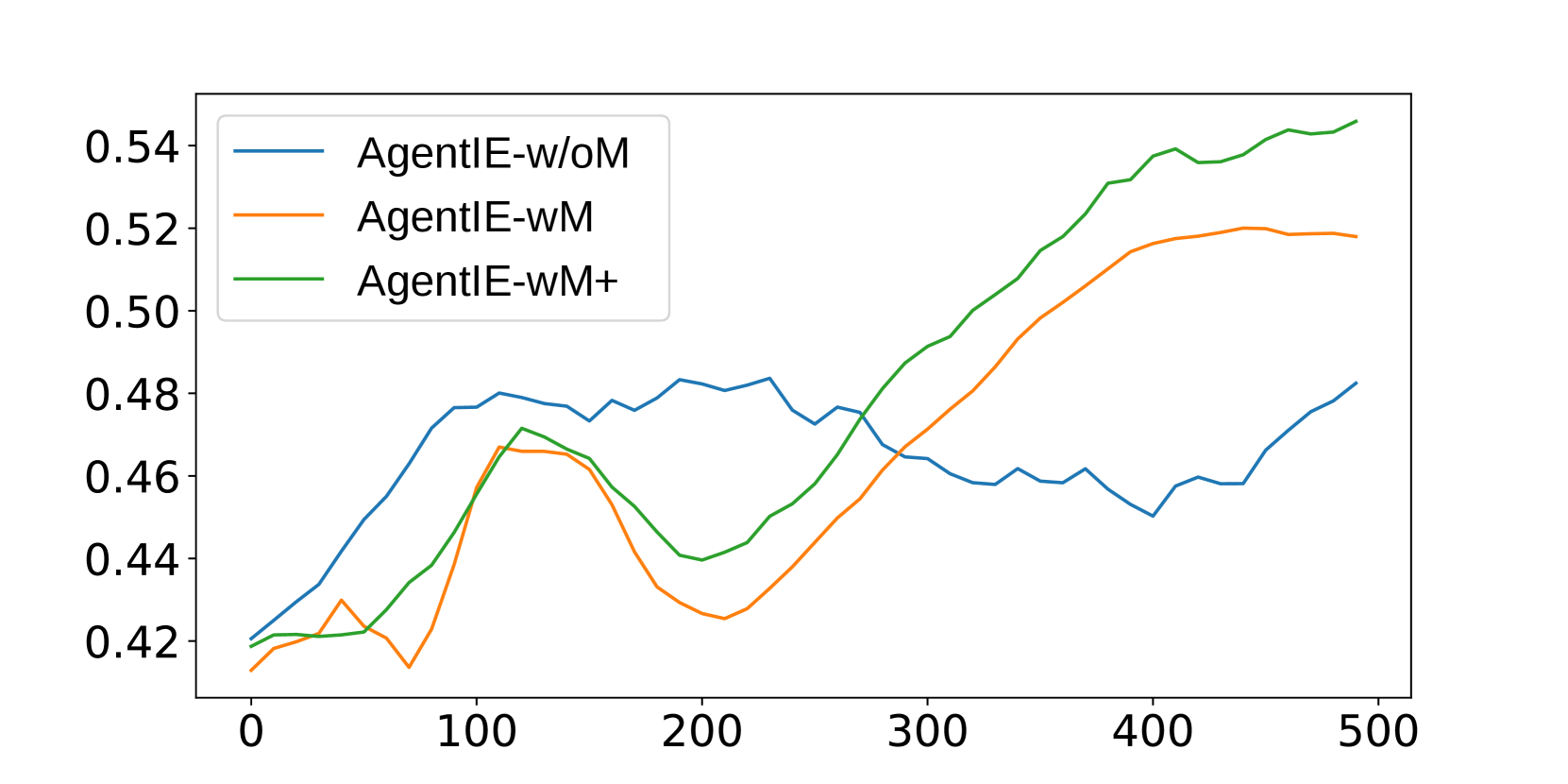

AgentRE在英语和中文数据集上均取得了优于现有方法的性能。尤其在低资源场景下,AgentRE的优势更加明显,表明其具有较强的泛化能力。此外,AgentRE生成的推理轨迹可以被提炼成高质量的训练数据,用于微调较小的模型,进一步提升了模型的效率和可部署性。具体性能数据需要在论文中查找。

🎯 应用场景

AgentRE框架可应用于知识图谱构建、智能问答系统、信息检索等领域。通过提升复杂场景下的关系抽取性能,该研究有助于提高机器对文本信息的理解能力,从而为各种下游任务提供更准确、更全面的知识支持。未来,该框架有望应用于医疗、金融等专业领域,辅助专家进行决策。

📄 摘要(原文)

The relation extraction (RE) in complex scenarios faces challenges such as diverse relation types and ambiguous relations between entities within a single sentence, leading to the poor performance of pure "text-in, text-out" language models (LMs). To address these challenges, in this paper, we propose an agent-based RE framework, namely AgentRE, which fully leverages the potential of large language models (LLMs) including memory, retrieval and reflection, to achieve RE in complex scenarios. Specifically, three major modules are built in AgentRE serving as the tools to help the agent acquire and process various useful information, thereby obtaining improved RE performance. Our extensive experimental results upon two datasets in English and Chinese demonstrate our AgentRE's superior performance, especially in low-resource scenarios. Additionally, the trajectories generated by AgentRE can be refined to construct a high-quality training dataset incorporating different reasoning methods, which can be used to fine-tune smaller models. Code is available at https://github.com/Lightblues/AgentRE.