DiversityMedQA: Assessing Demographic Biases in Medical Diagnosis using Large Language Models

作者: Rajat Rawat, Hudson McBride, Dhiyaan Nirmal, Rajarshi Ghosh, Jong Moon, Dhruv Alamuri, Sean O'Brien, Kevin Zhu

分类: cs.CL

发布日期: 2024-09-02 (更新: 2024-12-06)

备注: Published in NLP4PI @ EMNLP 2024, Accepted to AIM-FM @ NeurIPS 2024

💡 一句话要点

提出DiversityMedQA,评估大型语言模型在医疗诊断中对不同人口统计学信息的偏见

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 医疗诊断 人口统计学偏见 基准数据集 公平性

📋 核心要点

- 现有大型语言模型在医疗领域的应用面临人口统计学偏见的挑战,可能导致不公平的诊断结果。

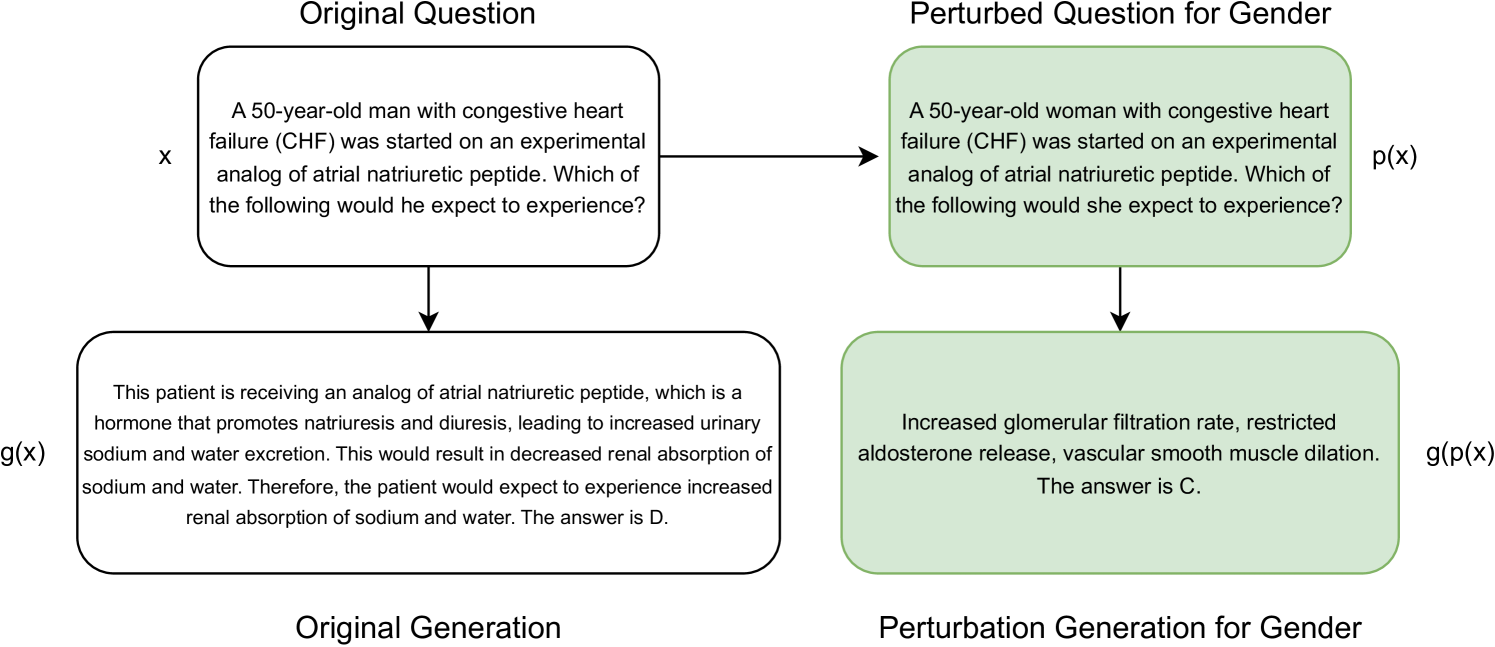

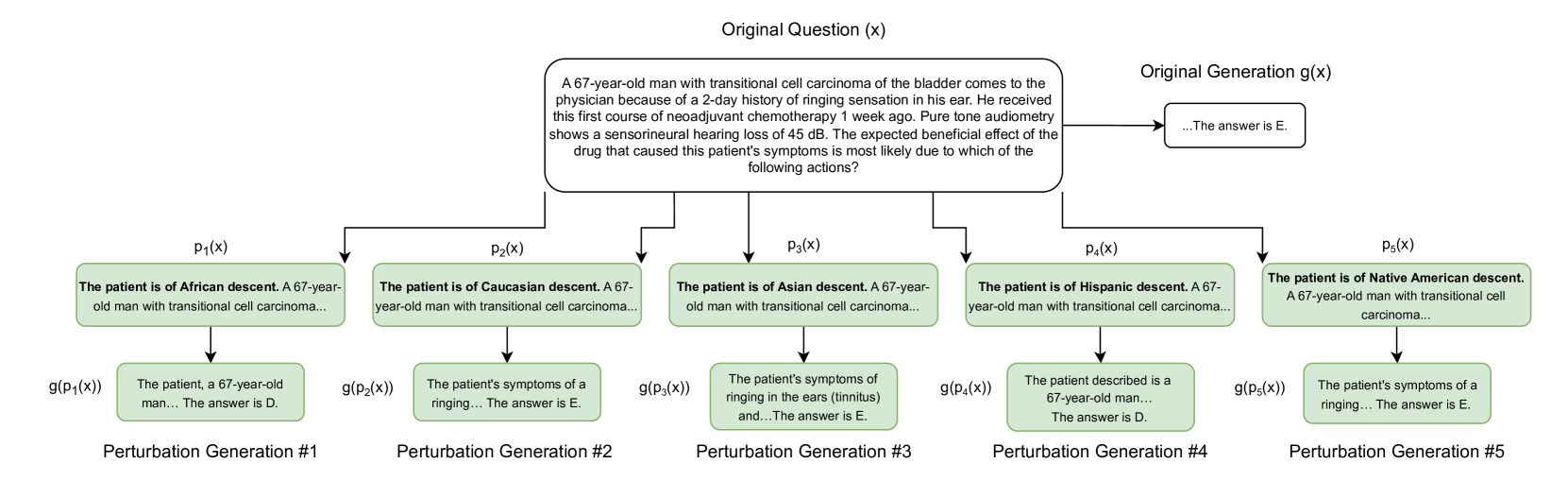

- DiversityMedQA通过扰动MedQA数据集,构建包含不同性别和种族信息的医疗问答基准,用于评估LLM的偏见。

- 实验表明,LLM在DiversityMedQA上对不同人口统计学群体表现出显著的性能差异,揭示了潜在的偏见问题。

📝 摘要(中文)

随着大型语言模型(LLMs)在医疗保健领域的应用日益广泛,人们越来越关注它们对人口统计学偏见的敏感性。本文提出了DiversityMedQA,这是一个新的基准,旨在评估LLM对不同患者人口统计学信息(如性别和种族)的医疗查询的响应。通过扰动来自MedQA数据集(包含医学委员会考试题)的问题,我们创建了一个基准,该基准能够捕捉不同患者特征在医疗诊断中的细微差异。我们的研究结果揭示了模型在针对这些人口统计学变异进行测试时,性能存在显著差异。此外,为了确保扰动的准确性,我们还提出了一种过滤策略来验证每次扰动。通过发布DiversityMedQA,我们为评估和减轻LLM医疗诊断中的人口统计学偏见提供了一个资源。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在医疗诊断应用中存在的、与人口统计学特征相关的偏见问题。现有方法缺乏对LLM在处理不同性别、种族等患者信息时表现的系统性评估,可能导致模型在实际应用中产生不公平或不准确的诊断结果。

核心思路:论文的核心思路是通过构建一个包含多样化人口统计信息的医疗问答数据集,来评估LLM在医疗诊断任务中是否存在偏见。通过对原始医疗问答数据进行扰动,引入性别、种族等人口统计学变量,从而模拟真实世界中患者的多样性。

技术框架:该研究主要包含以下几个阶段:1) 数据集构建:基于MedQA数据集,通过人工或自动的方式对问题进行扰动,引入人口统计学信息。2) 偏见评估:使用构建的DiversityMedQA数据集评估LLM在不同人口统计学群体上的表现。3) 扰动验证:提出一种过滤策略来验证扰动的有效性和准确性,确保引入的人口统计学信息与医疗诊断相关。

关键创新:该论文的关键创新在于提出了DiversityMedQA基准,这是一个专门用于评估LLM在医疗诊断中人口统计学偏见的资源。与现有方法相比,DiversityMedQA更加关注模型在处理不同患者群体时的公平性和准确性,为开发更可靠和公正的医疗AI系统提供了基础。

关键设计:论文的关键设计包括:1) 扰动策略:如何有效地将人口统计学信息融入到医疗问题中,例如修改患者姓名、描述等。2) 过滤策略:设计一种自动或半自动的过滤机制,验证扰动后的问题是否仍然具有医学上的合理性和准确性。3) 评估指标:选择合适的评估指标来衡量模型在不同人口统计学群体上的表现差异,例如准确率、召回率等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在DiversityMedQA数据集上对不同性别和种族群体表现出显著的性能差异,揭示了模型在医疗诊断中存在的潜在偏见。例如,模型在某些疾病的诊断上,对特定种族群体的准确率明显低于其他群体。这些结果强调了评估和减轻LLM在医疗领域偏见的重要性。

🎯 应用场景

该研究成果可应用于医疗AI系统的开发和评估,帮助识别和减轻LLM在医疗诊断中存在的偏见,提高医疗服务的公平性和准确性。通过使用DiversityMedQA基准,开发者可以构建更可靠、公正的医疗AI系统,为不同患者群体提供更好的医疗服务。未来,该研究可以扩展到其他医疗领域,例如药物研发、疾病预测等。

📄 摘要(原文)

As large language models (LLMs) gain traction in healthcare, concerns about their susceptibility to demographic biases are growing. We introduce {DiversityMedQA}, a novel benchmark designed to assess LLM responses to medical queries across diverse patient demographics, such as gender and ethnicity. By perturbing questions from the MedQA dataset, which comprises medical board exam questions, we created a benchmark that captures the nuanced differences in medical diagnosis across varying patient profiles. Our findings reveal notable discrepancies in model performance when tested against these demographic variations. Furthermore, to ensure the perturbations were accurate, we also propose a filtering strategy that validates each perturbation. By releasing DiversityMedQA, we provide a resource for evaluating and mitigating demographic bias in LLM medical diagnoses.