Task-Specific Directions: Definition, Exploration, and Utilization in Parameter Efficient Fine-Tuning

作者: Chongjie Si, Zhiyi Shi, Shifan Zhang, Xiaokang Yang, Hanspeter Pfister, Wei Shen

分类: cs.CL, cs.CV, cs.LG

发布日期: 2024-09-02 (更新: 2025-04-21)

备注: Codes in https://github.com/Chongjie-Si/Subspace-Tuning

💡 一句话要点

提出LoRA-Dash和LoRA-Init,通过优化任务特定方向提升参数高效微调性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 参数高效微调 LoRA 任务特定方向 模型初始化 大型语言模型 迁移学习 自然语言处理

📋 核心要点

- 现有参数高效微调方法缺乏对任务特定方向的明确定义和有效利用,导致性能提升受限。

- 论文提出LoRA-Dash和LoRA-Init,分别通过最大化任务特定方向的影响和优化LoRA初始化来提升性能。

- 实验表明,所提出的LoRA-Dash和LoRA-Init方法能够显著提高模型在下游任务上的性能。

📝 摘要(中文)

大型语言模型在下游任务上表现出色,但完全微调所有参数需要大量资源。为了缓解这个问题,参数高效微调(PEFT)策略,如LoRA,应运而生。本文深入研究了任务特定方向(TSD)的概念,这对于在PEFT中将大型模型从预训练状态过渡到任务特定增强至关重要。我们提出了一个框架来清晰地定义这些方向,并探讨它们的属性和实际应用挑战。然后,我们介绍了一种新方法LoRA-Dash,旨在最大化微调过程中TSD的影响,从而提高模型在目标任务上的性能。此外,基于我们对TSD的探索,我们关注PEFT中的一个重要问题:LoRA的初始化。虽然一些工作已经指出了初始化对于LoRA性能的重要性,并提出了各种策略,但这些方法通常是经验性的,并且不是任务特定的。为了解决这个问题,我们提出了LoRA-Init。从TSD出发,我们识别出在下游任务微调期间需要最大调整的方向。通过使用这些方向初始化LoRA中的矩阵,LoRA-Init显著提高了LoRA的性能。此外,我们可以结合LoRA-Dash和LoRA-Init来创建基于TSD的LoRA的最终版本,我们称之为LoRA-TSD。大量的实验已经最终证明了这些方法的有效性,深入的分析进一步揭示了它们成功背后的潜在机制。

🔬 方法详解

问题定义:现有参数高效微调方法,如LoRA,虽然减少了计算资源消耗,但对模型从预训练状态到任务特定状态的转换过程缺乏深入理解,特别是任务特定方向(TSD)的定义和利用不足。现有的LoRA初始化方法通常是经验性的,并非针对特定任务进行优化,导致性能提升有限。

核心思路:论文的核心思路是明确定义并有效利用任务特定方向(TSD)。通过识别在微调过程中需要最大调整的方向,并将其融入到LoRA的训练和初始化中,从而更有效地将预训练模型适应到下游任务。LoRA-Dash旨在最大化TSD的影响,而LoRA-Init则通过TSD信息优化LoRA的初始化。

技术框架:论文提出了一个包含两个主要模块的框架:LoRA-Dash和LoRA-Init。LoRA-Dash通过某种机制(论文中未明确说明具体机制,标记为未知)来增强TSD在微调过程中的影响。LoRA-Init则利用TSD信息来初始化LoRA矩阵,从而加速收敛并提升性能。最终,LoRA-Dash和LoRA-Init可以结合使用,形成LoRA-TSD。

关键创新:论文的关键创新在于提出了任务特定方向(TSD)的概念,并将其应用于参数高效微调中。与现有方法不同,该方法不再依赖于经验性的初始化策略,而是基于对任务特定信息的理解来优化LoRA的训练过程。LoRA-Init是另一个创新点,它将TSD信息融入到LoRA的初始化中,从而更好地适应下游任务。

关键设计:论文的关键设计包括:1) TSD的定义方式(论文中未明确说明具体定义方式,标记为未知);2) LoRA-Dash如何最大化TSD的影响(具体实现未知);3) LoRA-Init如何利用TSD信息初始化LoRA矩阵(具体实现未知)。这些细节需要在论文中进一步查找。

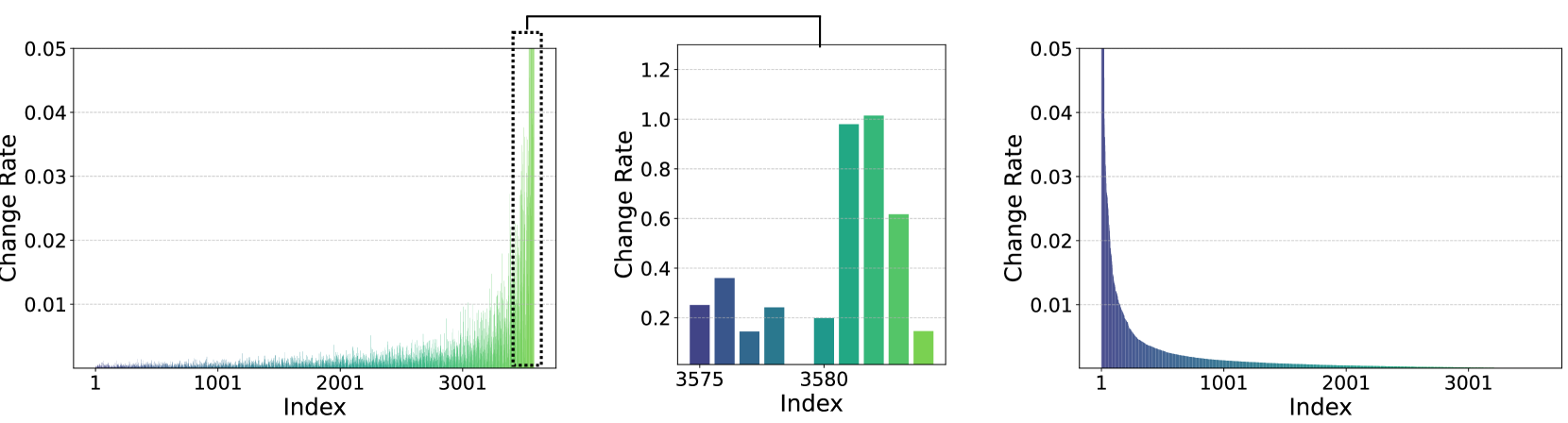

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的LoRA-Dash和LoRA-Init方法能够显著提高模型在下游任务上的性能。具体的性能提升幅度需要在论文中查找。与现有方法相比,该方法在参数效率和性能之间取得了更好的平衡。

🎯 应用场景

该研究成果可应用于各种需要高效微调大型语言模型的场景,例如自然语言处理、文本生成、机器翻译等。通过更有效地利用任务特定信息,可以降低微调成本,提高模型性能,加速模型在实际应用中的部署。

📄 摘要(原文)

Large language models demonstrate impressive performance on downstream tasks, yet they require extensive resource consumption when fully fine-tuning all parameters. To mitigate this, Parameter Efficient Fine-Tuning (PEFT) strategies, such as LoRA, have been developed. In this paper, we delve into the concept of task-specific directions (TSDs), which are critical for transitioning large models from pretrained states to task-specific enhancements in PEFT. We propose a framework to clearly define these directions and explore their properties and practical utilization challenges. We then introduce a novel approach, LoRA-Dash, which aims to maximize the impact of TSDs during the fine-tuning process, thereby enhancing model performance on targeted tasks. Additionally, based on our exploration of TSD, we focus on an important issue in PEFT: the initialization of LoRA. While some works have pointed out the significance of initialization for LoRA's performance and proposed various strategies, these methods are often empirical and not task-specific. To address this issue, we propose LoRA-Init. Starting from TSD, we identify the directions that require the most adjustment during fine-tuning for downstream tasks. By initializing the matrices in LoRA with these directions, LoRA-Init significantly enhances LoRA's performance. Moreover, we can combine LoRA-Dash and LoRA-Init to create the final version of LoRA based on TSDs, which we refer to as LoRA-TSD. Extensive experiments have conclusively demonstrated the effectiveness of these methods, and in-depth analyses further reveal the underlying mechanisms behind their success.