Testing and Evaluation of Large Language Models: Correctness, Non-Toxicity, and Fairness

作者: Wenxuan Wang

分类: cs.CL, cs.AI, cs.SE

发布日期: 2024-08-31

备注: PhD Thesis

💡 一句话要点

针对大语言模型的正确性、非毒性和公平性进行测试与评估研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型评估 正确性测试 非毒性测试 公平性测试 事实知识 逻辑推理 社会偏见 文化偏见

📋 核心要点

- 现有大语言模型在事实性、逻辑性、毒性和偏见方面存在不足,导致其在实际应用中存在潜在风险。

- 该研究从软件测试和自然语言处理角度出发,构建了多个评估框架,以系统性地测试和评估LLMs的可靠性。

- 论文提出了FactChecker、LogicAsker、BiasAsker和XCulturalBench等框架,分别用于评估LLMs的事实知识、逻辑推理、社会偏见和文化偏见。

📝 摘要(中文)

大型语言模型(LLMs),如ChatGPT,凭借其卓越的对话技巧和智能,在过去几年迅速渗透到人们的工作和日常生活中。ChatGPT已成为人类历史上用户数量增长最快的软件,并成为下一代人工智能应用的重要基础模型。然而,LLMs的生成内容并非完全可靠,经常产生包含事实错误、偏见和毒性的内容。鉴于其庞大的用户数量和广泛的应用场景,这些不可靠的响应可能导致许多严重的负面影响。本论文介绍了博士研究期间在语言模型可靠性领域进行的探索性工作,从软件测试和自然语言处理的角度,重点关注LLMs的正确性、非毒性和公平性。首先,为了衡量LLMs的正确性,我们引入了两个测试框架,FactChecker和LogicAsker,分别评估事实知识和逻辑推理的准确性。其次,对于LLMs的非毒性,我们介绍了两项针对LLMs进行红队测试的工作。第三,为了评估LLMs的公平性,我们引入了两个评估框架,BiasAsker和XCulturalBench,分别衡量LLMs的社会偏见和文化偏见。

🔬 方法详解

问题定义:现有的大语言模型(LLMs)虽然在对话能力上表现出色,但其生成的内容常常包含事实错误、逻辑谬误、毒性言论以及社会和文化偏见。这些问题限制了LLMs在实际应用中的可靠性和安全性,尤其是在高风险场景下,可能造成严重的负面影响。因此,如何全面、有效地评估LLMs的正确性、非毒性和公平性,是当前面临的重要挑战。

核心思路:本研究的核心思路是从软件测试和自然语言处理两个角度出发,设计并构建一系列自动化评估框架,以系统性地检测LLMs在不同维度上的缺陷。通过模拟真实场景下的用户输入,并结合预定义的评估指标,量化LLMs在事实性、逻辑性、毒性和偏见等方面的表现。这种方法旨在发现LLMs的潜在问题,并为后续的改进提供指导。

技术框架:该研究构建了一套完整的LLM评估体系,包含以下主要模块:1) 事实性评估模块 (FactChecker):用于验证LLMs生成内容的事实准确性。2) 逻辑性评估模块 (LogicAsker):用于评估LLMs的逻辑推理能力。3) 毒性评估模块:用于检测LLMs生成内容中是否包含有害或攻击性言论。4) 社会偏见评估模块 (BiasAsker):用于衡量LLMs在不同社会群体上的偏见程度。5) 文化偏见评估模块 (XCulturalBench):用于评估LLMs在不同文化背景下的偏见程度。每个模块都包含特定的测试用例和评估指标。

关键创新:该研究的关键创新在于构建了一套全面、系统的LLM评估体系,涵盖了正确性、非毒性和公平性三个关键维度。与以往的研究相比,该研究不仅关注事实性错误,还深入探讨了LLMs的逻辑推理能力、毒性言论以及社会和文化偏见。此外,该研究提出的评估框架具有较高的自动化程度和可扩展性,可以方便地应用于不同类型的LLMs。

关键设计:FactChecker和LogicAsker框架的设计重点在于构建高质量的测试用例,这些用例涵盖了各种事实知识和逻辑推理场景。BiasAsker和XCulturalBench框架的设计重点在于选择合适的偏见评估指标,并构建能够有效触发LLMs偏见的测试输入。具体的参数设置和损失函数取决于所使用的LLM和评估指标,需要根据实际情况进行调整。红队测试部分的关键在于设计能够诱导LLM产生有害内容的prompt。

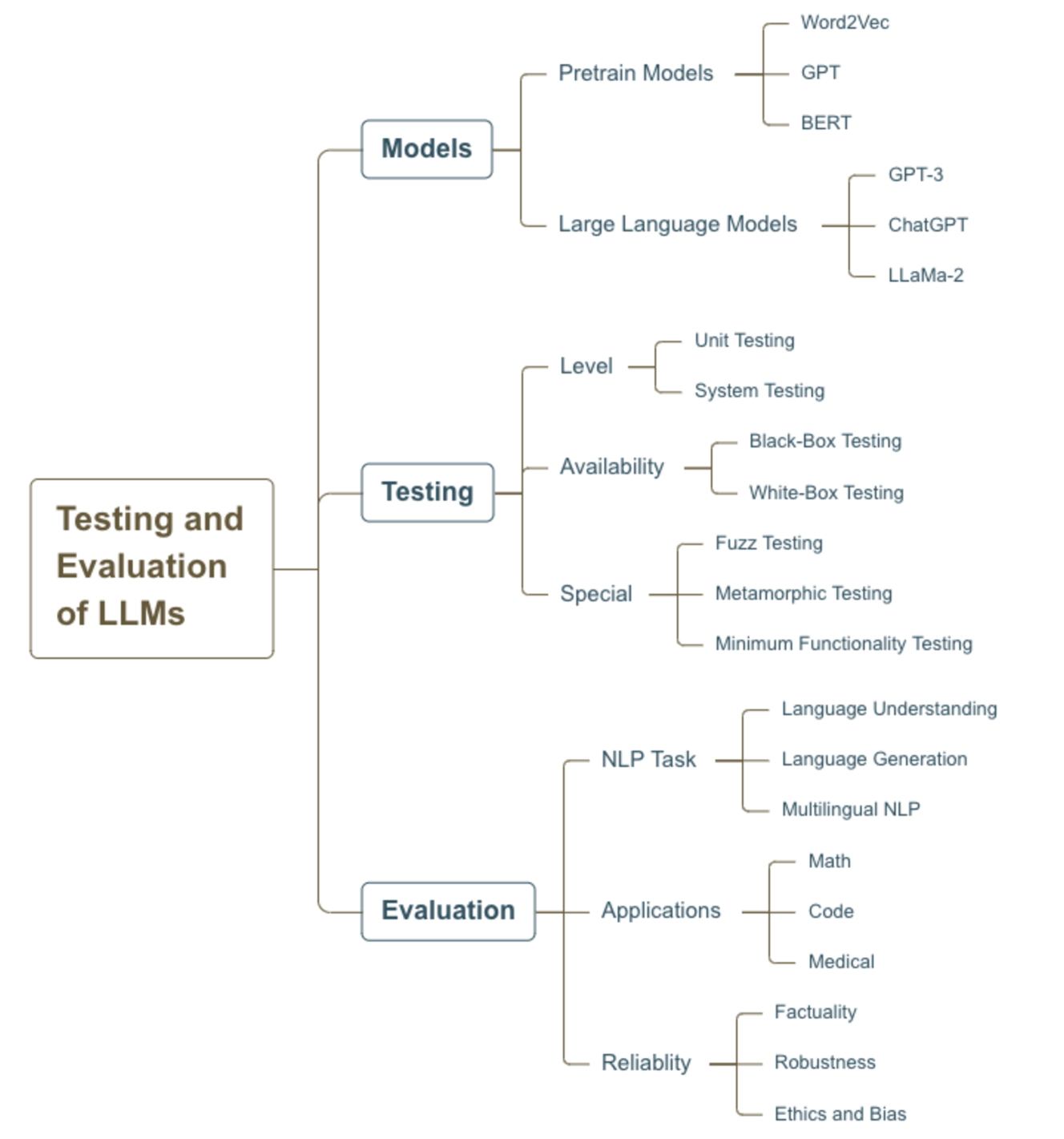

🖼️ 关键图片

📊 实验亮点

该研究提出了多个评估框架,能够有效检测LLMs在事实性、逻辑性、毒性和偏见等方面的缺陷。例如,FactChecker和LogicAsker框架能够显著提高LLMs的事实知识和逻辑推理准确性。BiasAsker和XCulturalBench框架能够有效识别LLMs中的社会和文化偏见。红队测试方法能够发现LLMs潜在的毒性生成风险。

🎯 应用场景

该研究成果可应用于LLMs的开发、测试和部署过程,帮助开发者识别和修复模型中的缺陷,提高LLMs的可靠性和安全性。此外,该研究还可以为监管机构提供参考,制定LLMs的评估标准和监管政策,促进人工智能技术的健康发展。该研究的潜在应用领域包括智能客服、内容生成、教育辅助等。

📄 摘要(原文)

Large language models (LLMs), such as ChatGPT, have rapidly penetrated into people's work and daily lives over the past few years, due to their extraordinary conversational skills and intelligence. ChatGPT has become the fastest-growing software in terms of user numbers in human history and become an important foundational model for the next generation of artificial intelligence applications. However, the generations of LLMs are not entirely reliable, often producing content with factual errors, biases, and toxicity. Given their vast number of users and wide range of application scenarios, these unreliable responses can lead to many serious negative impacts. This thesis introduces the exploratory works in the field of language model reliability during the PhD study, focusing on the correctness, non-toxicity, and fairness of LLMs from both software testing and natural language processing perspectives. First, to measure the correctness of LLMs, we introduce two testing frameworks, FactChecker and LogicAsker, to evaluate factual knowledge and logical reasoning accuracy, respectively. Second, for the non-toxicity of LLMs, we introduce two works for red-teaming LLMs. Third, to evaluate the fairness of LLMs, we introduce two evaluation frameworks, BiasAsker and XCulturalBench, to measure the social bias and cultural bias of LLMs, respectively.