The creative psychometric item generator: a framework for item generation and validation using large language models

作者: Antonio Laverghetta, Simone Luchini, Averie Linell, Roni Reiter-Palmon, Roger Beaty

分类: cs.CL

发布日期: 2024-08-30

备注: CREAI 2024

💡 一句话要点

提出创造性心理测量项目生成器(CPIG),利用大语言模型自动生成并验证创造力评估试题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 创造力评估 心理测量学 试题生成 迭代优化

📋 核心要点

- 现有方法难以有效生成和验证创造力评估试题,阻碍了对人类创造力的准确评估。

- CPIG框架利用大语言模型迭代生成和评估试题,旨在生成能激发更具创造性回答的试题。

- 实验结果表明,CPIG能够生成有效且可靠的试题,且效果不受评估偏差影响。

📝 摘要(中文)

随着大语言模型(LLMs)越来越多地被用于自动化需要高度创造力的工作场所流程,尽管创造力在现代经济中日益重要,但很少有研究探讨它们是否能为人类生成有效的创造力评估。我们开发了一个受心理测量学启发的框架,用于为经典的自由回答创造力测试——创造性问题解决(CPS)任务创建测试项目(问题)。我们的框架,创造性心理测量项目生成器(CPIG),使用基于LLM的项目生成器和评估器的混合体来迭代开发用于编写CPS项目的新提示,以便来自后续迭代的项目将引发测试参与者更具创造性的反应。我们发现强有力的经验证据表明,CPIG生成有效且可靠的项目,并且这种效果不能归因于评估过程中的已知偏差。我们的发现对使用LLM自动生成人类和AI的有效且可靠的创造力测试具有重要意义。

🔬 方法详解

问题定义:论文旨在解决如何利用大语言模型自动生成和验证创造力评估试题的问题。现有方法在生成高质量、无偏见的创造力评估试题方面存在挑战,人工设计试题成本高昂且主观性强。

核心思路:论文的核心思路是构建一个迭代式的生成和评估框架,利用大语言模型生成试题,并利用另一组大语言模型评估试题的质量,通过迭代优化,生成能够有效激发测试者创造性思维的试题。这种方法旨在减少人工干预,提高试题生成的效率和客观性。

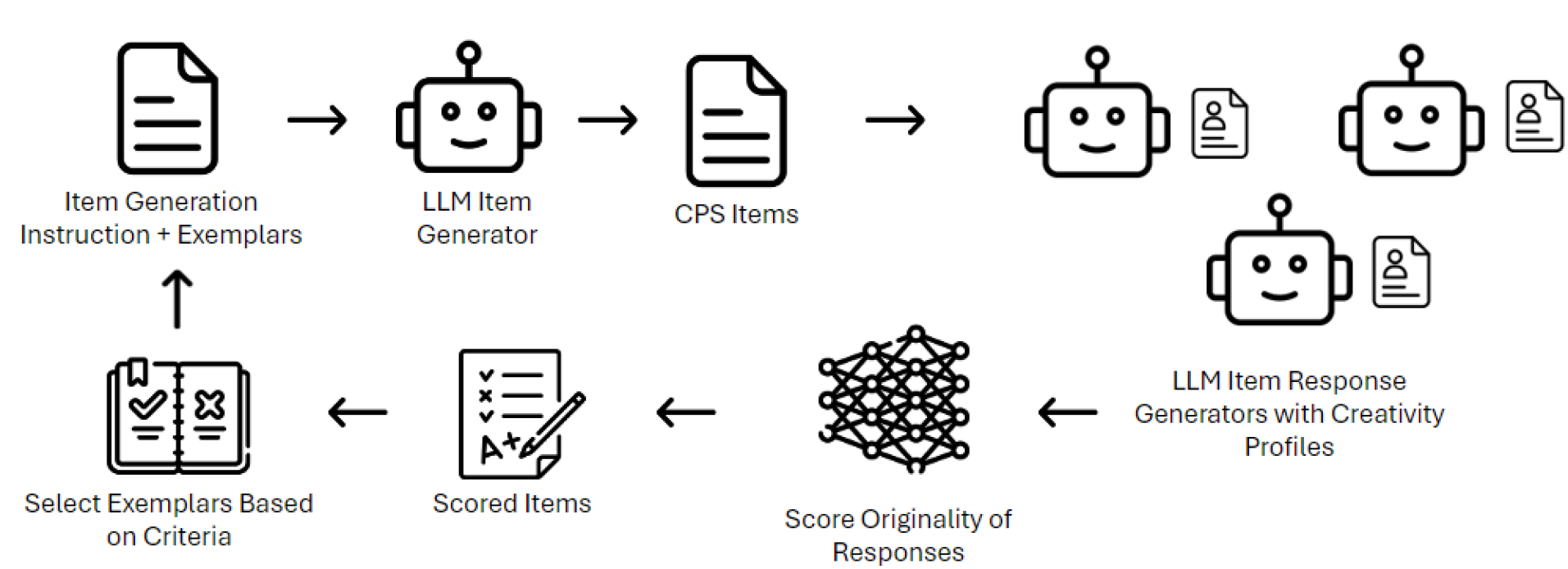

技术框架:CPIG框架包含以下主要模块:1) 项目生成器:使用大语言模型生成CPS任务的试题提示。2) 项目评估器:使用大语言模型评估生成的试题提示的质量,例如,评估试题是否能够激发创造性回答。3) 迭代优化器:根据项目评估器的反馈,调整项目生成器的参数或提示,以生成更高质量的试题。整个流程通过多次迭代,不断优化试题的质量。

关键创新:该论文的关键创新在于将大语言模型应用于创造力评估试题的自动生成和验证,并构建了一个迭代优化的框架。与传统的人工设计方法相比,CPIG能够显著提高试题生成的效率和客观性,并能够生成更具挑战性和启发性的试题。

关键设计:论文中,项目生成器和评估器都使用了预训练的大语言模型,例如GPT-3。关键设计包括:1) 如何设计提示,引导大语言模型生成高质量的试题。2) 如何设计评估指标,衡量试题的质量,例如,评估试题是否能够激发测试者的发散性思维和收敛性思维。3) 如何设计迭代优化的策略,根据评估结果调整生成器的参数或提示。

🖼️ 关键图片

📊 实验亮点

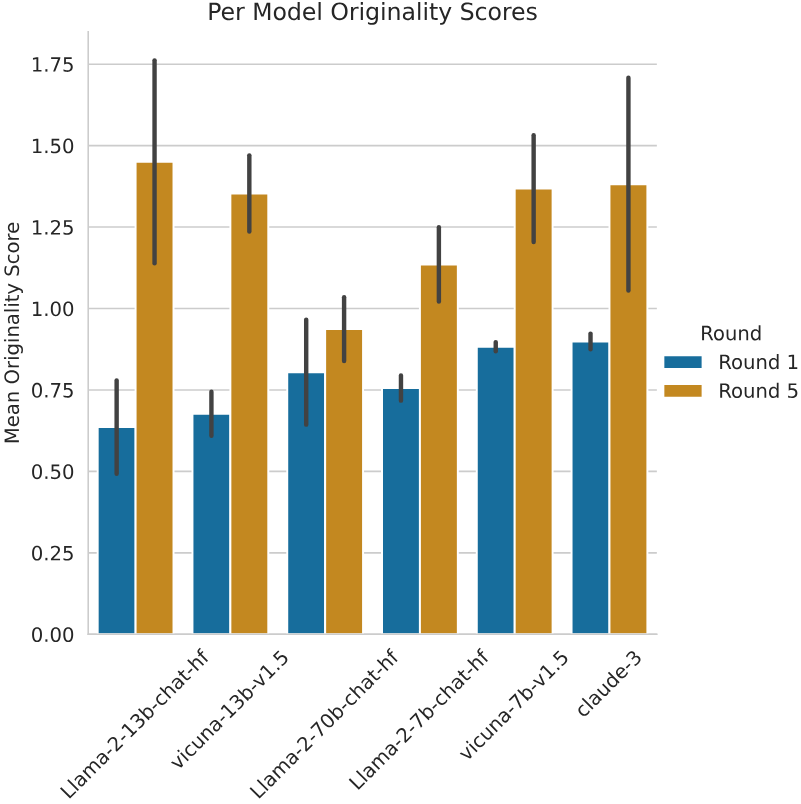

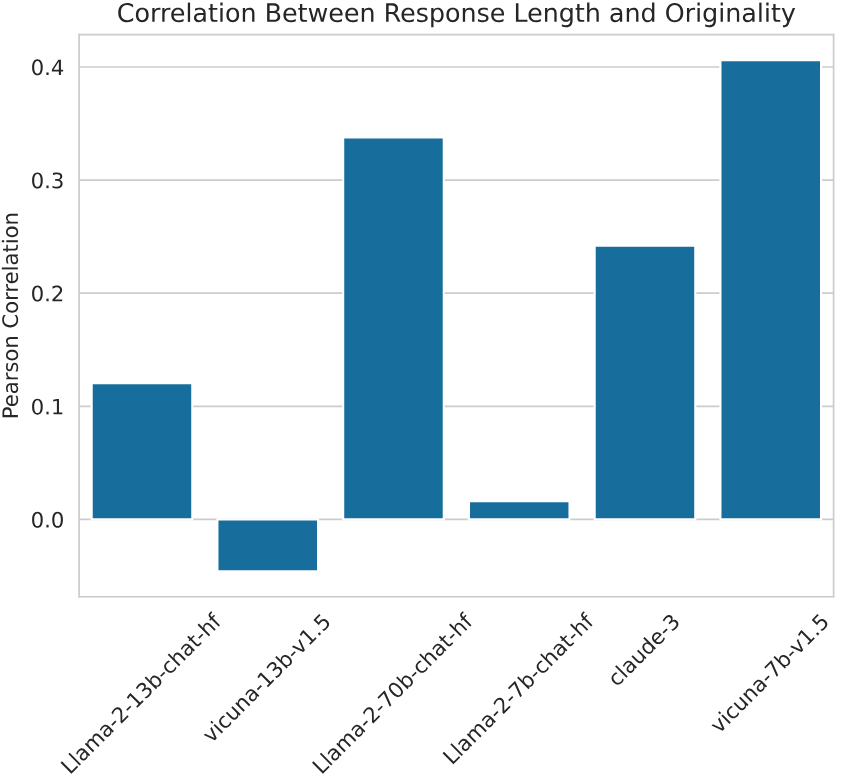

实验结果表明,CPIG能够生成有效且可靠的创造力评估试题。与人工设计的试题相比,CPIG生成的试题能够更好地激发测试者的创造性思维,且评估结果不受评估偏差的影响。具体而言,使用CPIG生成的试题进行评估,测试者的创造力得分与使用传统试题的得分具有显著相关性,表明CPIG生成的试题具有良好的效度。

🎯 应用场景

该研究成果可应用于教育、招聘、人才选拔等领域,自动生成创造力评估试题,降低评估成本,提高评估效率和客观性。此外,该方法还可用于生成其他类型的心理测量试题,具有广泛的应用前景。未来,该技术可用于个性化学习和智能辅导系统,根据学生的创造力水平,定制个性化的学习内容和评估方式。

📄 摘要(原文)

Increasingly, large language models (LLMs) are being used to automate workplace processes requiring a high degree of creativity. While much prior work has examined the creativity of LLMs, there has been little research on whether they can generate valid creativity assessments for humans despite the increasingly central role of creativity in modern economies. We develop a psychometrically inspired framework for creating test items (questions) for a classic free-response creativity test: the creative problem-solving (CPS) task. Our framework, the creative psychometric item generator (CPIG), uses a mixture of LLM-based item generators and evaluators to iteratively develop new prompts for writing CPS items, such that items from later iterations will elicit more creative responses from test takers. We find strong empirical evidence that CPIG generates valid and reliable items and that this effect is not attributable to known biases in the evaluation process. Our findings have implications for employing LLMs to automatically generate valid and reliable creativity tests for humans and AI.