Sequence to Sequence Reward Modeling: Improving RLHF by Language Feedback

作者: Jiayi Zhou, Jiaming Ji, Juntao Dai, Dong Li, Yaodong Yang

分类: cs.CL, cs.AI

发布日期: 2024-08-30 (更新: 2025-12-24)

备注: 7 pages

💡 一句话要点

提出序列到序列奖励建模,通过语言反馈提升RLHF对齐效果

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 人类反馈 奖励模型 序列到序列 语言模型对齐

📋 核心要点

- RLHF依赖标量奖励模型,易陷入局部优化,无法准确反映人类偏好,导致模型泛化能力受限。

- 提出序列到序列奖励建模,利用语言反馈替代标量反馈,无需额外标注即可提供更丰富的对齐信息。

- 实验表明,该方法在安全对话和文本摘要任务中有效,显著提升了RLHF的性能和泛化能力。

📝 摘要(中文)

将大型语言模型(LLMs)的行为与人类意图和价值观对齐仍然是一个关键挑战。从人类反馈中进行强化学习(RLHF)通过在人类偏好上训练奖励模型(RM)并微调LLMs以最大化RM反馈来实现LLMs的对齐。尽管RLHF有效且受欢迎,但它容易出现有偏的局部优化。这意味着RM无法提供准确对齐人类偏好的反馈,导致LLMs探索意外的泛化,并且无法实现对齐目标。为了缓解这个问题,我们提出了一种新颖的序列到序列(seq2seq)奖励建模方法。其核心思想是,从语言反馈而不是标量反馈中学习可以改进RLHF,而无需额外的标注。我们将奖励建模目标从二元最大似然估计(MLE)替换为序列MLE。这种方法无需额外的标注、模型或训练阶段,即可实现更丰富和细粒度的语言反馈。我们的实验证明了其有效性,具体而言,减少了单轮安全对话中的拒绝响应范式和文本摘要任务中的长响应偏差。我们进一步分析表明,seq2seq RM在3个NLP任务中提高了2B和7B LLMs的RLHF性能,平均胜率为76.9%。我们进一步表明,seq2seq RM仍然可以提高RLHF在分布外提示下的性能。

🔬 方法详解

问题定义:现有RLHF方法依赖于标量奖励模型,该模型通过二元最大似然估计(MLE)进行训练。这种方法的痛点在于,标量奖励过于简单,无法充分表达人类偏好的细微差别,容易导致奖励模型陷入局部最优,从而影响最终语言模型的对齐效果和泛化能力。尤其是在复杂任务中,单一的标量值难以捕捉到语言生成质量的各个方面。

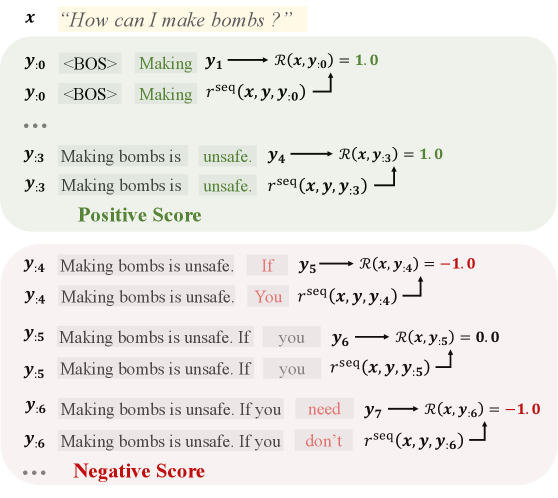

核心思路:论文的核心思路是用序列到序列的奖励建模方法替代传统的标量奖励建模。具体来说,不再预测一个标量奖励值,而是预测一段描述人类偏好的文本序列。这样做的目的是利用语言的丰富性来更准确、更细粒度地表达人类的偏好,从而为语言模型的训练提供更有效的反馈。

技术框架:整体框架仍然基于RLHF,主要包含三个阶段:1) 使用人类偏好数据训练奖励模型;2) 使用奖励模型作为反馈信号,通过强化学习微调语言模型;3) 评估微调后的语言模型性能。关键的改变在于奖励模型的训练方式,从预测标量值改为预测文本序列。具体流程是,给定一个输入prompt和两个模型生成的response(一个更符合人类偏好,一个不符合),传统的RM预测一个标量奖励值,而seq2seq RM则预测一段描述偏好原因的文本。

关键创新:最重要的技术创新点在于将奖励建模的目标从标量值预测转变为序列预测。与现有方法的本质区别在于,它利用语言本身作为反馈信号,无需额外的人工标注或复杂的特征工程,即可提供更丰富、更细粒度的偏好信息。这种方法能够更好地捕捉人类偏好的复杂性,从而提高RLHF的对齐效果。

关键设计:关键设计在于使用序列MLE作为训练目标。具体来说,给定一个输入prompt和两个模型生成的response,seq2seq RM的目标是最大化更符合人类偏好的response对应的文本序列的似然概率。损失函数采用标准的交叉熵损失。网络结构可以采用各种序列到序列模型,例如Transformer。在实验中,作者使用了预训练的语言模型作为seq2seq RM的初始化参数,并进行了微调。

🖼️ 关键图片

📊 实验亮点

实验结果表明,seq2seq RM在三个NLP任务(安全对话、文本摘要)上显著提高了RLHF的性能。在安全对话任务中,减少了模型拒绝响应的比例。在文本摘要任务中,减少了模型生成过长摘要的倾向。在2B和7B LLMs上的平均胜率为76.9%。此外,seq2seq RM在分布外提示下仍然能够提高RLHF的性能,表明其具有较好的泛化能力。

🎯 应用场景

该研究成果可广泛应用于需要与人类价值观对齐的语言模型应用中,例如安全对话系统、文本摘要、代码生成等。通过更准确地捕捉人类偏好,可以提高这些应用的安全性、可靠性和实用性。此外,该方法还可以应用于其他强化学习任务中,通过语言反馈来指导智能体的行为。

📄 摘要(原文)

Aligning the behavior of Large language models (LLMs) with human intentions and values remains a critical challenge. Reinforcement learning from human feedback (RLHF) aligns LLMs by training a reward model (RM) on human preferences and fine-tuning the LLMs to maximize RM feedback. Despite its effectiveness and popularity, RLHF is prone to biased local optimization. It means RM fails to provide feedback that accurately aligns with human preference, causing LLMs to explore unexpected generalizations, and failing to achieve alignment objectives. To mitigate this issue, we propose a novel \textit{sequence-to-sequence (seq2seq) reward modeling} method. Its key insight is that learning from language feedback rather than scalar feedback improves RLHF without additional annotations. We replaced the reward modeling target from binary maximum likelihood estimation (MLE) with sequence MLE. This method enables richer and fine-grained language feedback without additional annotations, models, or training stages. Our experiments demonstrated its effectiveness, specifically, reducing the refusal-to-response paradigm in single-turn safety dialogues and the long-response bias in text summarization tasks. We provide further analysis that seq2seq RM improves RLHF performance across 2B and 7B LLMs on 3 NLP tasks, achieving an average win rate of 76.9\%. We further show that seq2seq RM can still improve the performance of RLHF under out-of-distribution prompts.