LoraMap: Harnessing the Power of LoRA Connections

作者: Hyeryun Park, Jeongwon Kwak, Dongsuk Jang, Sumin Park, Jinwook Choi

分类: cs.CL, cs.AI

发布日期: 2024-08-29 (更新: 2024-10-16)

备注: 17 pages, 12 figures, 7 tables

💡 一句话要点

LoraMap:利用LoRA连接提升LLM在事实核查任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低秩适应 LoRA 事实核查 大型语言模型 参数高效 知识融合 推理数据集

📋 核心要点

- 大型语言模型在特定领域易出现幻觉,事实核查是缓解该问题的重要手段,但计算成本高昂。

- LoraMap通过建立多个LoRA之间的连接,使它们能够从不同角度进行推理和事实核查。

- 实验表明,LoraMap在事实核查任务中优于LoraHub,且参数量远小于LoraConcat。

📝 摘要(中文)

事实核查技术可以缓解大型语言模型(LLM)中的幻觉问题,这在特定领域尤为突出。由于低秩适应(LoRA)等参数高效技术可以克服巨大的计算开销,一些研究探索了集成多个LoRA。虽然之前的研究侧重于并行集成,但本文研究了在多个LoRA之间建立连接的方法。我们创建了三个针对事实核查的推理数据集,并对单个LoRA进行微调,使其能够从不同的角度观察和推理。然后,我们探索了分配这些推理LoRA的策略,并引入了LoraMap,一种用于映射它们之间连接的方法。事实核查任务的结果表明,LoraMap的性能优于现有的LoRA集成方法LoraHub。与连接LoRA并进一步微调它们的LoraConcat相比,LoraMap也以明显更少的训练参数实现了更好的性能。

🔬 方法详解

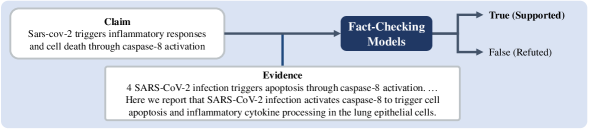

问题定义:论文旨在解决大型语言模型在特定领域的事实核查任务中存在的幻觉问题。现有方法,如直接微调整个模型,计算成本过高。虽然LoRA等参数高效方法降低了成本,但现有研究主要集中于并行集成多个LoRA,忽略了LoRA之间潜在的协同效应。

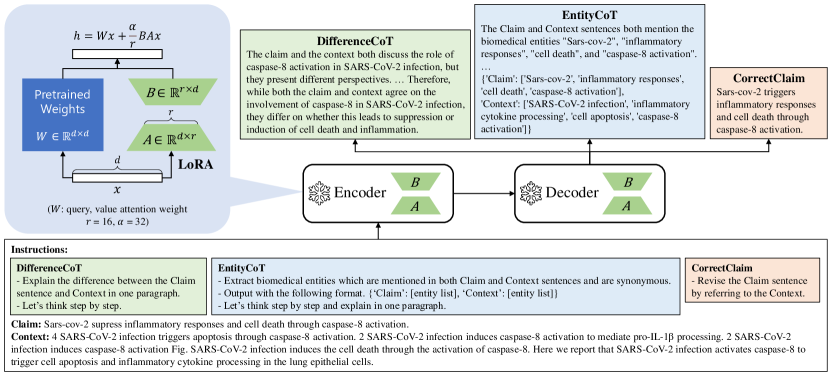

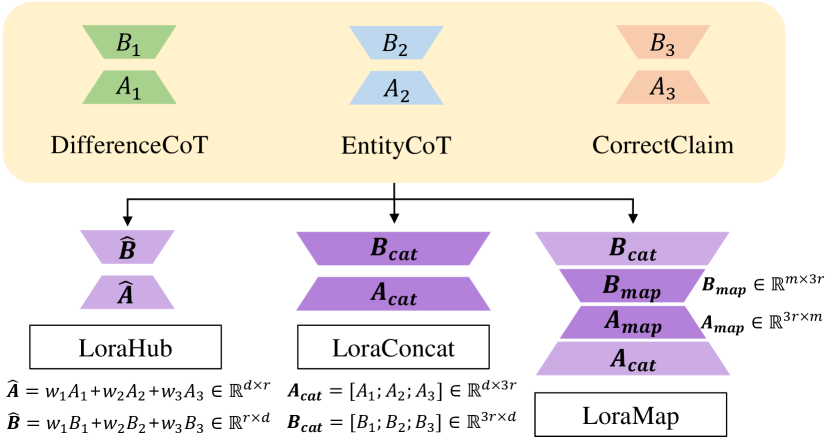

核心思路:论文的核心思路是建立多个LoRA之间的连接,形成一个LoRA网络(LoraMap),使不同的LoRA可以互相传递信息,从而从不同的角度进行推理和事实核查。通过学习LoRA之间的连接方式,可以有效地利用不同LoRA的知识,提高事实核查的准确性。

技术框架:LoraMap的整体框架包括以下几个步骤:1) 创建针对事实核查的推理数据集;2) 对多个LoRA进行微调,每个LoRA专注于不同的推理角度;3) 设计LoraMap,用于学习LoRA之间的连接;4) 使用事实核查任务评估LoraMap的性能。LoraMap的关键在于学习LoRA之间的连接权重,这些权重决定了哪些LoRA应该互相传递信息,以及传递信息的强度。

关键创新:LoraMap的关键创新在于提出了LoRA连接的概念,并设计了一种学习LoRA之间连接的方法。与现有方法相比,LoraMap能够更好地利用不同LoRA的知识,提高事实核查的准确性。此外,LoraMap的参数效率更高,因为它只需要学习LoRA之间的连接权重,而不需要微调整个模型。

关键设计:LoraMap的关键设计包括:1) 设计了三种针对事实核查的推理数据集,用于训练和评估LoRA;2) 探索了不同的LoRA分配策略,以确定哪些LoRA应该连接在一起;3) 使用可学习的连接权重来控制LoRA之间的信息传递;4) 使用交叉熵损失函数来优化连接权重,目标是最大化事实核查的准确性。具体的网络结构和参数设置在论文中有详细描述,此处不再赘述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LoraMap在事实核查任务中优于LoraHub,并且参数量远小于LoraConcat。具体来说,LoraMap在三个推理数据集上都取得了最好的性能,并且使用的可训练参数比LoraConcat少得多。这些结果表明,LoraMap是一种有效的参数高效的事实核查方法。

🎯 应用场景

LoraMap具有广泛的应用前景,可以应用于各种需要事实核查的场景,例如新闻验证、科学研究、医疗诊断等。通过将LoraMap集成到现有的LLM中,可以有效地提高LLM的可靠性和可信度,减少幻觉的产生。此外,LoraMap的参数效率使其非常适合在资源受限的环境中使用,例如移动设备和嵌入式系统。

📄 摘要(原文)

Fact-checking techniques can mitigate hallucinations in Large Language Models (LLMs), a prominent issue in specialized domains. As parameter-efficient techniques such as Low-Rank Adaptation (LoRA) can overcome substantial computational overhead, some studies have explored the integration of multiple LoRAs. While previous studies focus on parallel integration, this paper investigates methods to establish connections among multiple LoRAs. We create three reasoning datasets tailored to fact-checking and fine-tune individual LoRAs, allowing them to view and reason from diverse perspectives. Then, we explore strategies for allocating these reasoning LoRAs and introduce LoraMap, an approach to map connections between them. The results of the fact-checking task demonstrate that the performance of LoraMap is superior to LoraHub, an existing method for integrating LoRAs. LoraMap also outperforms with significantly fewer trainable parameters than LoraConcat, which concatenates LoRAs and further fine-tunes them.