Structured Event Reasoning with Large Language Models

作者: Li Zhang

分类: cs.CL

发布日期: 2024-08-28

备注: PhD thesis

💡 一句话要点

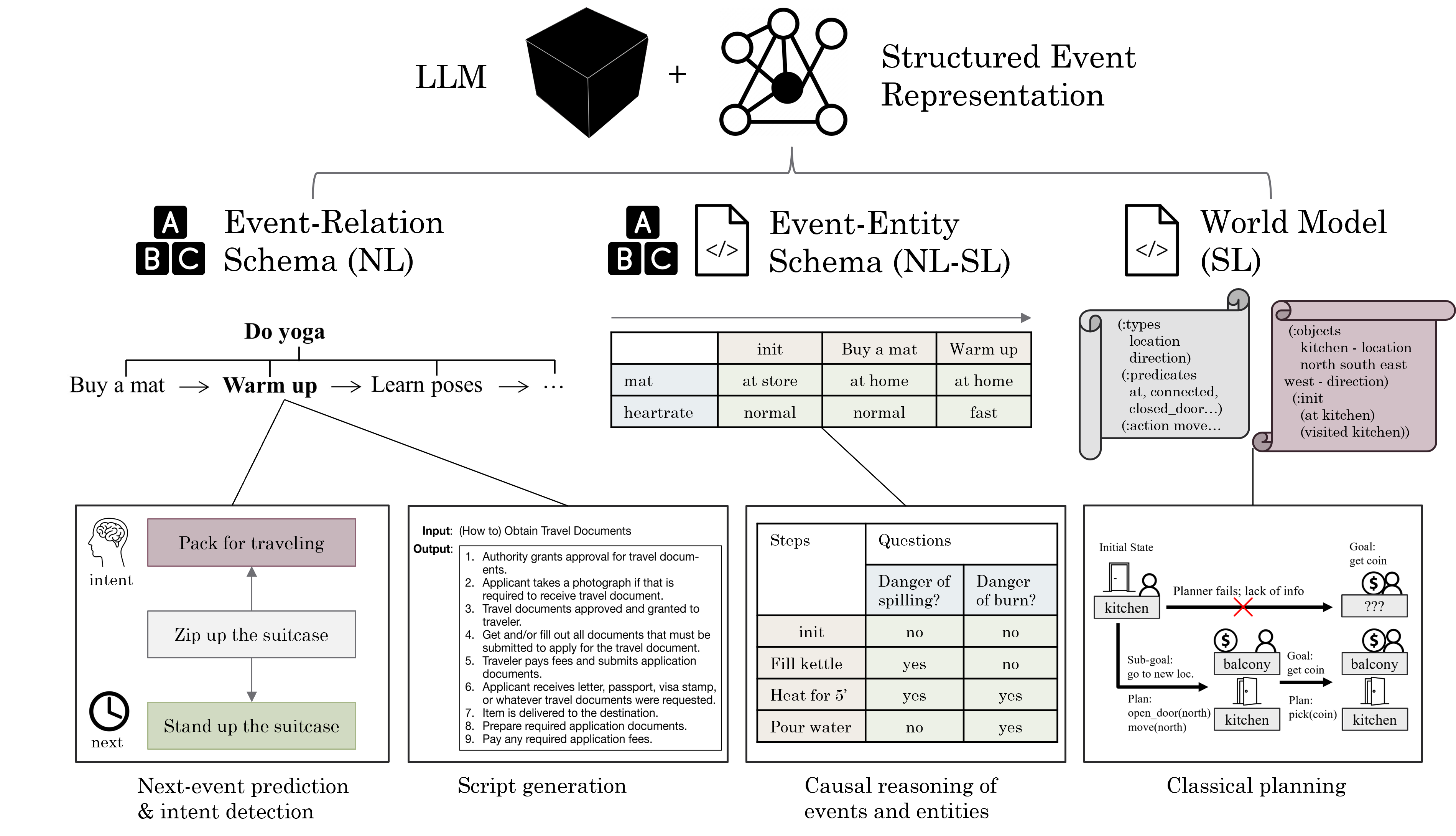

提出结合结构化事件表示与大语言模型的方法,提升复杂事件推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事件推理 大语言模型 结构化表示 常识推理 符号推理 可解释性 知识表示

📋 核心要点

- 现有端到端大语言模型在复杂事件推理上存在不足,且黑盒特性导致缺乏可解释性。

- 论文提出三种通用方法,结合大语言模型与结构化事件表示,提升推理能力并增强可解释性。

- 实验结果表明,提出的方法在常识推理和规划任务中显著优于端到端大语言模型。

📝 摘要(中文)

现实事件的推理是人工智能和自然语言处理领域的一个统一挑战,它在各种领域都有着深刻的效用,而在高风险应用中的谬误可能是灾难性的。大语言模型(LLM)能够处理这些领域中的各种文本,已被证明能够回答问题和解决问题。然而,我表明,端到端LLM仍然系统性地无法推理复杂的事件,并且由于其黑盒性质而缺乏可解释性。为了解决这些问题,我提出了三种通用方法,将LLM与事件的结构化表示结合使用。第一种是基于语言的表示,涉及子事件的关系,可以通过微调由LLM学习。第二种是半符号表示,涉及实体的状态,可以通过少样本提示由LLM预测和利用。第三种是完全符号表示,可以由用结构化数据训练的LLM预测,并由符号求解器执行。在一系列涵盖常识推理和规划的事件推理任务中,我表明每种方法都大大优于端到端LLM,并且具有更高的可解释性。这些结果表明了LLM和结构化表示之间在事件推理及其他方面的协同作用。

🔬 方法详解

问题定义:论文旨在解决大语言模型在复杂事件推理中存在的不足,特别是其黑盒特性导致的可解释性差以及在处理复杂事件时表现出的系统性失败。现有方法,即端到端的大语言模型,难以有效捕捉事件之间的结构化关系和实体状态的演变,从而影响推理的准确性和可靠性。

核心思路:论文的核心思路是将大语言模型与结构化事件表示相结合,利用大语言模型的文本处理能力和结构化表示的明确性和可解释性。通过这种结合,可以弥补大语言模型在复杂事件推理方面的缺陷,并提高推理过程的可解释性。

技术框架:论文提出了三种技术框架:1) 基于语言的表示,通过微调大语言模型学习子事件之间的关系;2) 半符号表示,通过少样本提示让大语言模型预测和利用实体状态;3) 完全符号表示,使用结构化数据训练大语言模型,并使用符号求解器执行推理。这三种框架分别对应不同程度的结构化信息,可以根据具体任务选择合适的框架。

关键创新:论文的关键创新在于提出了将大语言模型与结构化事件表示相结合的通用方法,并针对不同程度的结构化信息设计了三种不同的技术框架。这种结合既利用了大语言模型的强大文本处理能力,又引入了结构化表示的明确性和可解释性,从而显著提升了复杂事件推理的性能。

关键设计:具体的技术细节包括:1) 基于语言的表示中,如何设计合适的子事件关系表示,以及如何通过微调大语言模型学习这些关系;2) 半符号表示中,如何设计有效的少样本提示,以及如何利用大语言模型预测的实体状态;3) 完全符号表示中,如何构建结构化数据,以及如何训练大语言模型预测符号表示,并使用符号求解器执行推理。这些设计都需要根据具体任务进行调整和优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的三种方法在事件推理任务中均显著优于端到端的大语言模型。具体而言,在常识推理和规划任务中,性能提升幅度明显,同时模型的可解释性也得到了提高。这些结果验证了将大语言模型与结构化表示相结合的有效性。

🎯 应用场景

该研究成果可应用于智能助手、自动驾驶、医疗诊断等领域,提升机器对复杂情境的理解和推理能力。通过更准确的事件推理,可以提高决策的可靠性,减少潜在风险,并为用户提供更智能化的服务。未来,该研究有望推动人工智能在更多领域的应用。

📄 摘要(原文)

Reasoning about real-life events is a unifying challenge in AI and NLP that has profound utility in a variety of domains, while fallacy in high-stake applications could be catastrophic. Able to work with diverse text in these domains, large language models (LLMs) have proven capable of answering questions and solving problems. However, I show that end-to-end LLMs still systematically fail to reason about complex events, and they lack interpretability due to their black-box nature. To address these issues, I propose three general approaches to use LLMs in conjunction with a structured representation of events. The first is a language-based representation involving relations of sub-events that can be learned by LLMs via fine-tuning. The second is a semi-symbolic representation involving states of entities that can be predicted and leveraged by LLMs via few-shot prompting. The third is a fully symbolic representation that can be predicted by LLMs trained with structured data and be executed by symbolic solvers. On a suite of event reasoning tasks spanning common-sense inference and planning, I show that each approach greatly outperforms end-to-end LLMs with more interpretability. These results suggest manners of synergy between LLMs and structured representations for event reasoning and beyond.