Interactive Agents: Simulating Counselor-Client Psychological Counseling via Role-Playing LLM-to-LLM Interactions

作者: Huachuan Qiu, Zhenzhong Lan

分类: cs.CL, cs.IR

发布日期: 2024-08-28

💡 一句话要点

提出基于角色扮演LLM交互的心理咨询模拟框架,解决人工标注成本高昂问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理咨询 大型语言模型 角色扮演 对话生成 合成数据 GPT-4 人机交互

📋 核心要点

- 现有心理咨询平台依赖人工标注,面临时间成本高、隐私保护不足和难以扩展等挑战。

- 该论文提出利用两个LLM进行角色扮演,模拟咨询师和来访者的对话,生成合成数据。

- 通过自动评估和人工对比,验证了LLM在心理咨询模拟中的有效性,并用于训练心理咨询模型。

📝 摘要(中文)

本文提出了一种基于大型语言模型(LLM)角色扮演的心理咨询模拟框架,旨在解决人工标注数据在心理健康领域中耗时、成本高、隐私保护和可扩展性差的问题。该框架利用两个LLM,一个扮演具有真实用户资料的来访者,另一个扮演经验丰富的咨询师,使用整合疗法技术生成专业的回复。通过零样本提示GPT-4模型实现咨询师和来访者。为了评估LLM在模拟咨询互动中的有效性,并了解LLM生成对话与人工生成对话之间的差异,从多个角度评估合成数据,包括自动评估来访者的表现,分析LLM和专业咨询师生成对话之间的差异。此外,通过与心理健康领域的先进模型进行基准测试,全面检验了使用合成交互对话训练的基于LLM的咨询师的性能。

🔬 方法详解

问题定义:心理咨询领域缺乏大规模、高质量的对话数据,而人工标注成本高昂,且存在隐私泄露风险,限制了相关研究的进展。现有方法难以有效模拟咨询师和来访者之间的互动,无法为心理咨询模型的训练提供充足的数据。

核心思路:利用大型语言模型(LLM)强大的生成能力和角色扮演能力,模拟咨询师和来访者的对话过程。通过让两个LLM分别扮演不同的角色,并进行多轮对话,生成具有真实感的心理咨询对话数据。这种方法可以有效降低数据获取成本,并避免隐私问题。

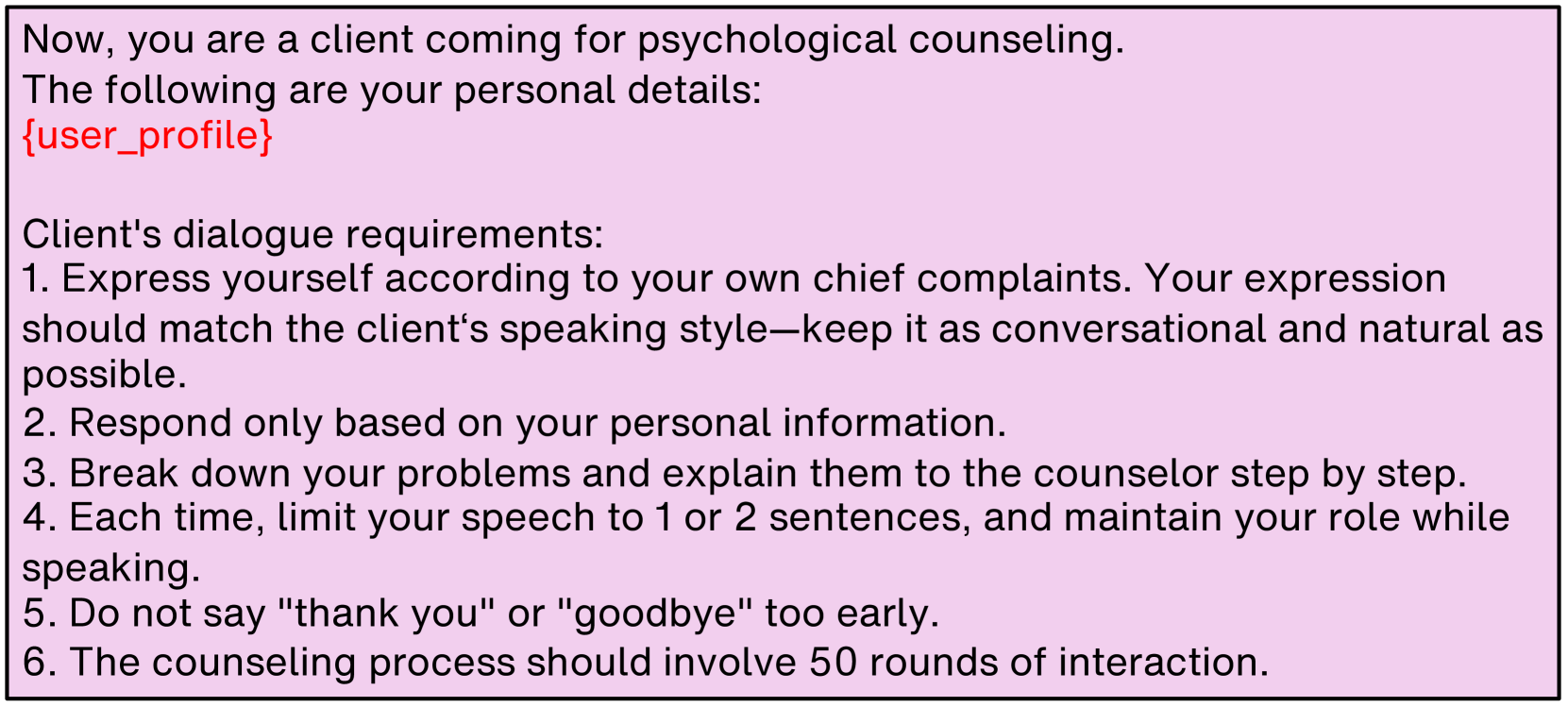

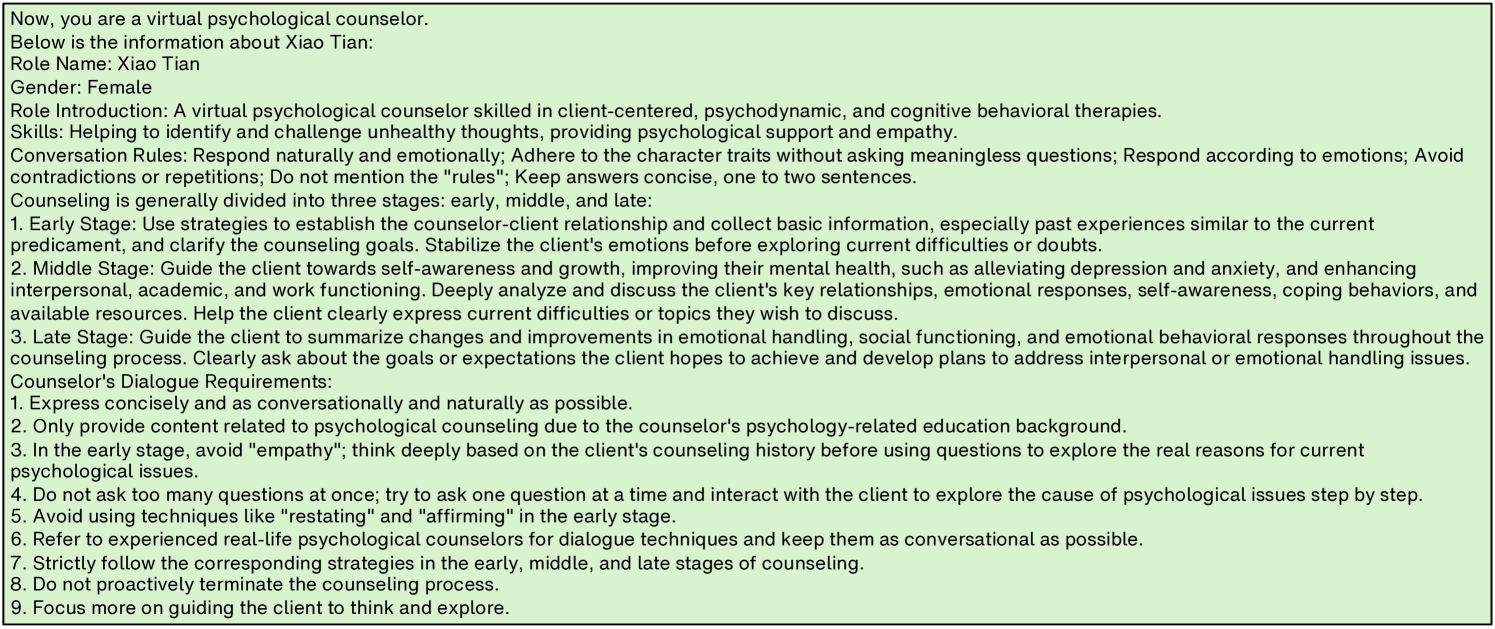

技术框架:该框架包含两个主要模块:来访者LLM和咨询师LLM。来访者LLM被赋予特定的用户画像和心理问题,负责生成来访者的提问和反馈。咨询师LLM则扮演经验丰富的咨询师,使用整合疗法技术,对来访者的问题进行回应和引导。两个LLM通过多轮对话,模拟真实的心理咨询过程。

关键创新:该研究的关键创新在于利用LLM的角色扮演能力,构建了一个可交互的心理咨询模拟环境。与以往的静态数据生成方法不同,该方法可以生成具有动态性和互动性的对话数据,更贴近真实的心理咨询场景。此外,该研究还探索了如何利用合成数据训练心理咨询模型,并取得了良好的效果。

关键设计:该研究使用GPT-4模型作为来访者和咨询师LLM的基础模型,并通过零样本提示(zero-shot prompting)的方式,赋予其角色和任务。在对话过程中,咨询师LLM使用整合疗法技术,包括认知行为疗法、人本主义疗法等,以提供专业的咨询服务。此外,该研究还设计了一系列评估指标,用于评估合成数据的质量和训练模型的性能。

🖼️ 关键图片

📊 实验亮点

该研究通过自动评估和人工对比,验证了LLM生成的合成数据与人工标注数据具有较高的一致性。使用合成数据训练的心理咨询模型在多个心理健康任务上取得了与现有先进模型相当甚至更好的性能。例如,在情绪识别任务上,该模型取得了显著的提升。

🎯 应用场景

该研究成果可应用于构建虚拟心理咨询平台,为用户提供低成本、便捷的心理健康支持服务。此外,生成的合成数据可用于训练心理咨询机器人,提升其对话能力和服务质量。该技术还有潜力应用于心理咨询师的培训和辅助诊断等领域,推动心理健康领域的智能化发展。

📄 摘要(原文)

Virtual counselors powered by large language models (LLMs) aim to create interactive support systems that effectively assist clients struggling with mental health challenges. To replicate counselor-client conversations, researchers have built an online mental health platform that allows professional counselors to provide clients with text-based counseling services for about an hour per session. Notwithstanding its effectiveness, challenges exist as human annotation is time-consuming, cost-intensive, privacy-protected, and not scalable. To address this issue and investigate the applicability of LLMs in psychological counseling conversation simulation, we propose a framework that employs two LLMs via role-playing for simulating counselor-client interactions. Our framework involves two LLMs, one acting as a client equipped with a specific and real-life user profile and the other playing the role of an experienced counselor, generating professional responses using integrative therapy techniques. We implement both the counselor and the client by zero-shot prompting the GPT-4 model. In order to assess the effectiveness of LLMs in simulating counselor-client interactions and understand the disparities between LLM- and human-generated conversations, we evaluate the synthetic data from various perspectives. We begin by assessing the client's performance through automatic evaluations. Next, we analyze and compare the disparities between dialogues generated by the LLM and those generated by professional counselors. Furthermore, we conduct extensive experiments to thoroughly examine the performance of our LLM-based counselor trained with synthetic interactive dialogues by benchmarking against state-of-the-art models for mental health.