AgentMonitor: A Plug-and-Play Framework for Predictive and Secure Multi-Agent Systems

作者: Chi-Min Chan, Jianxuan Yu, Weize Chen, Chunyang Jiang, Xinyu Liu, Weijie Shi, Zhiyuan Liu, Wei Xue, Yike Guo

分类: cs.CL

发布日期: 2024-08-27

🔗 代码/项目: GITHUB

💡 一句话要点

AgentMonitor:用于预测和安全多智能体系统的即插即用框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 性能预测 安全监控 大型语言模型 智能体框架

📋 核心要点

- 现有方法难以在多智能体系统执行前预测其性能,配置过程依赖于事后观察,效率较低。

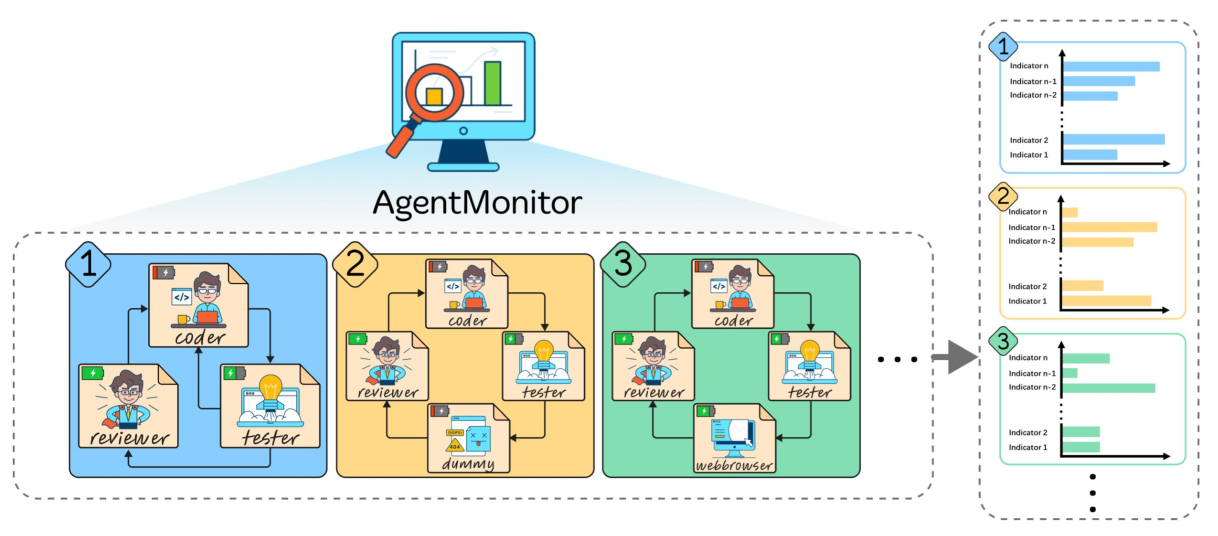

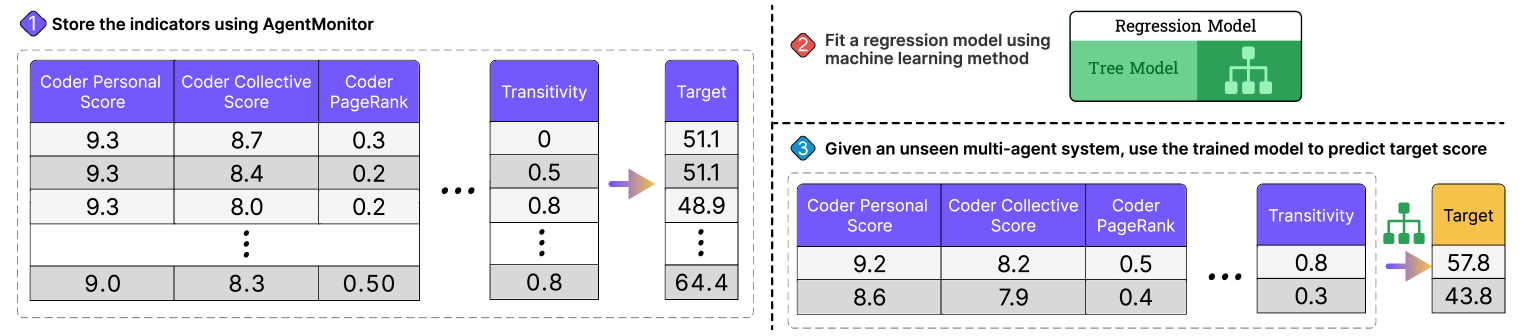

- AgentMonitor通过在智能体层面集成,捕获输入输出并转化为统计数据,训练回归模型预测任务性能。

- 实验表明,AgentMonitor能有效预测多智能体系统性能,并能实时纠正恶意智能体行为,提升系统安全性和可靠性。

📝 摘要(中文)

大型语言模型(LLM)的快速发展催生了基于LLM的智能体。最近的研究表明,多智能体系统(MAS),其中每个智能体扮演特定的角色,可以优于单个LLM。然而,为任务配置MAS仍然具有挑战性,性能只能在执行后观察到。受到LLM开发中缩放定律的启发,我们研究了MAS的性能是否可以预先预测。我们引入了AgentMonitor,一个在智能体级别集成的框架,用于捕获输入和输出,并将它们转换为统计数据,以训练回归模型来预测任务性能。此外,它还可以应用实时校正来解决恶意智能体带来的安全风险,减轻负面影响并增强MAS的安全性。实验表明,XGBoost模型在域内实现了0.89的Spearman相关性,在更具挑战性的场景中实现了0.58。此外,使用AgentMonitor平均减少了6.2%的有害内容,并增加了1.8%的有用内容,从而提高了安全性和可靠性。

🔬 方法详解

问题定义:论文旨在解决多智能体系统(MAS)在配置和部署过程中,难以预先评估其性能和安全性的问题。现有方法通常需要在系统执行后才能观察到性能,且缺乏对恶意智能体的有效防御机制,导致配置效率低下,并存在潜在的安全风险。

核心思路:论文的核心思路是借鉴LLM的缩放定律,通过监控智能体的输入和输出,提取关键统计信息,并利用这些信息训练回归模型来预测MAS的性能。同时,AgentMonitor还具备实时校正功能,能够检测并缓解恶意智能体带来的安全威胁。

技术框架:AgentMonitor框架主要包含以下几个模块:1) 数据采集模块:负责收集每个智能体的输入和输出数据。2) 特征提取模块:将采集到的数据转化为统计特征,例如文本长度、情感倾向等。3) 性能预测模块:使用回归模型(如XGBoost)基于提取的特征预测MAS的整体性能。4) 安全监控模块:实时检测智能体的行为,识别潜在的恶意行为。5) 实时校正模块:对检测到的恶意行为进行干预,例如限制其输出或将其隔离。

关键创新:AgentMonitor的关键创新在于其在智能体层面的集成和监控能力,以及利用统计特征进行性能预测和安全监控的方法。与传统的黑盒测试方法相比,AgentMonitor能够更细粒度地了解智能体的行为,并更准确地预测系统性能。此外,实时校正功能也为MAS的安全运行提供了保障。

关键设计:在性能预测模块中,论文采用了XGBoost模型,并使用了Spearman相关系数作为评估指标。在安全监控模块中,论文使用了基于规则和机器学习相结合的方法来检测恶意行为。具体的规则和机器学习模型(未知)的选择取决于具体的应用场景和安全需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AgentMonitor框架能够有效预测多智能体系统的性能。具体而言,使用XGBoost模型在域内实现了0.89的Spearman相关性,在更具挑战性的场景中也达到了0.58。此外,AgentMonitor还能够有效降低有害内容的生成,平均减少了6.2%,并增加了有用内容的生成,平均提升了1.8%,显著提升了系统的安全性和可靠性。

🎯 应用场景

AgentMonitor可应用于各种基于多智能体系统的应用场景,例如智能客服、自动化交易、协同机器人等。通过预先预测系统性能,可以优化系统配置,提高效率。同时,实时安全监控功能可以有效防止恶意攻击,保障系统安全稳定运行。该研究为构建可靠、安全的多智能体系统提供了新的思路和方法。

📄 摘要(原文)

The rapid advancement of large language models (LLMs) has led to the rise of LLM-based agents. Recent research shows that multi-agent systems (MAS), where each agent plays a specific role, can outperform individual LLMs. However, configuring an MAS for a task remains challenging, with performance only observable post-execution. Inspired by scaling laws in LLM development, we investigate whether MAS performance can be predicted beforehand. We introduce AgentMonitor, a framework that integrates at the agent level to capture inputs and outputs, transforming them into statistics for training a regression model to predict task performance. Additionally, it can further apply real-time corrections to address security risks posed by malicious agents, mitigating negative impacts and enhancing MAS security. Experiments demonstrate that an XGBoost model achieves a Spearman correlation of 0.89 in-domain and 0.58 in more challenging scenarios. Furthermore, using AgentMonitor reduces harmful content by 6.2% and increases helpful content by 1.8% on average, enhancing safety and reliability. Code is available at \url{https://github.com/chanchimin/AgentMonitor}.