On-Device Language Models: A Comprehensive Review

作者: Jiajun Xu, Zhiyuan Li, Wei Chen, Qun Wang, Xin Gao, Qi Cai, Ziyuan Ling

分类: cs.CL

发布日期: 2024-08-26 (更新: 2024-09-14)

备注: 38 pages, 6 figures

🔗 代码/项目: GITHUB

💡 一句话要点

综述:端侧语言模型部署与优化技术

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 端侧语言模型 模型压缩 量化 剪枝 知识蒸馏 硬件加速 边缘计算 移动设备

📋 核心要点

- 现有大型语言模型计算开销大,难以直接部署在资源受限的边缘设备上,面临性能与资源利用的挑战。

- 通过模型压缩、高效架构设计、硬件加速和边缘-云协同等方法,可以在端侧设备上部署和运行LLM。

- 端侧LLM具有低延迟、数据本地化和个性化等优势,在实际应用中展现出巨大潜力,但仍面临诸多挑战。

📝 摘要(中文)

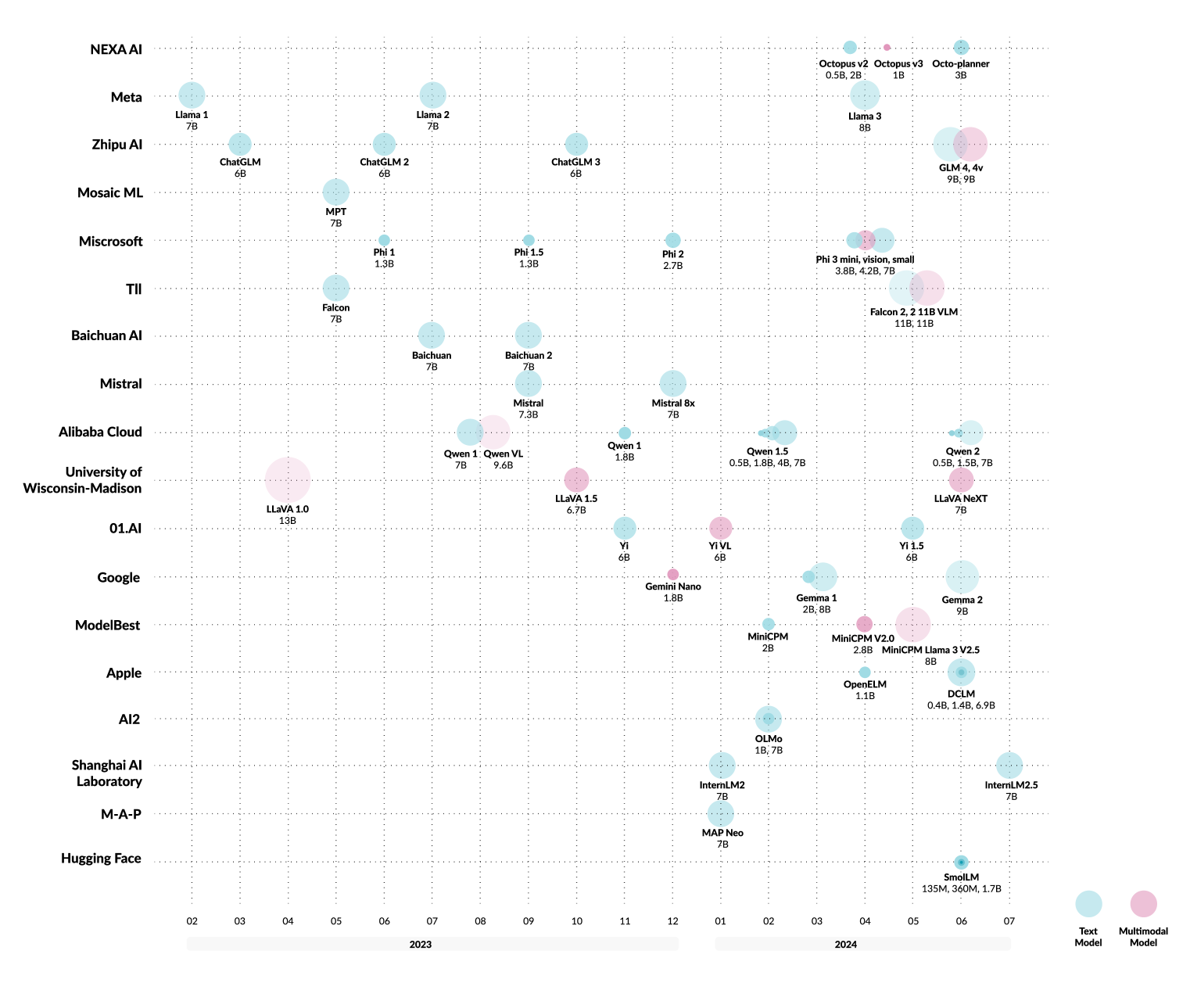

大型语言模型(LLM)的出现彻底改变了自然语言处理应用。由于降低延迟、数据本地化和个性化用户体验等原因,在边缘设备上运行LLM变得越来越有吸引力。本综述考察了在资源受限的设备上部署计算密集型LLM的挑战,并探讨了跨多个领域的创新解决方案。论文研究了端侧语言模型的发展、其高效架构(包括参数共享和模块化设计)以及最先进的压缩技术(如量化、剪枝和知识蒸馏)。分析了硬件加速策略和协作式边缘-云部署方法,强调了性能和资源利用之间的复杂平衡。来自主要移动制造商的端侧语言模型的案例研究展示了实际应用和潜在优势。本综述还讨论了自适应学习、多模态能力和个性化等关键方面。通过识别关键研究方向和开放挑战,本文为端侧语言模型的未来发展提供了路线图,强调需要跨学科的努力来实现无处不在的智能计算的全部潜力,同时确保负责任和合乎道德的部署。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在资源受限的边缘设备上部署的问题。现有方法要么无法将LLM部署到端侧,要么在部署后性能显著下降,无法满足实际应用的需求。痛点在于如何在有限的计算资源、存储空间和功耗下,保证LLM的性能和效率。

核心思路:论文的核心思路是通过模型压缩、高效架构设计、硬件加速以及边缘-云协同等多种手段,降低LLM的计算复杂度和资源占用,使其能够在端侧设备上高效运行。同时,探索自适应学习和个性化方法,以进一步提升端侧LLM的性能和用户体验。

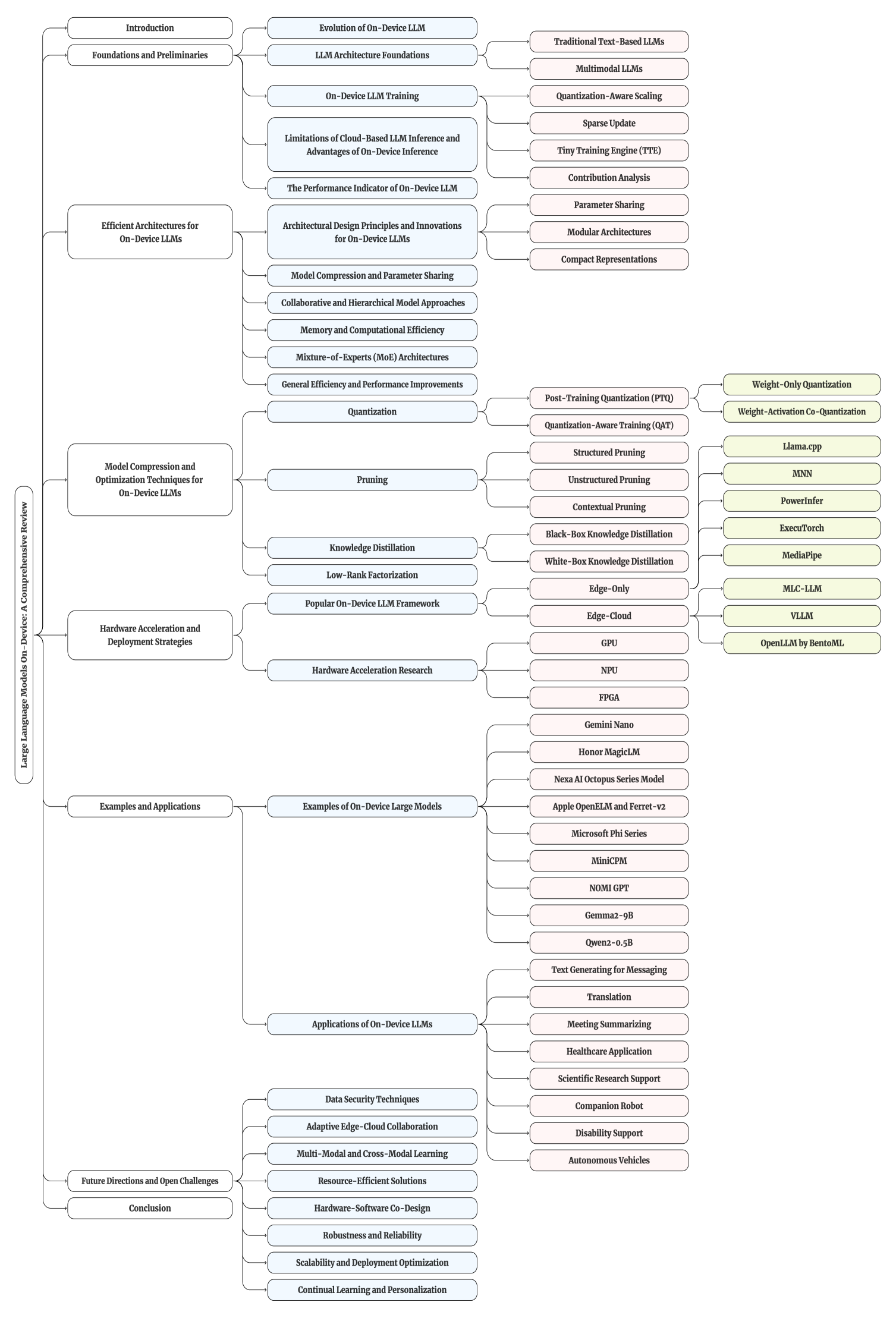

技术框架:论文首先概述了端侧LLM的发展现状,然后分别从模型压缩(量化、剪枝、知识蒸馏)、高效架构设计(参数共享、模块化设计)、硬件加速和边缘-云协同四个方面详细介绍了相关的技术方法。最后,通过案例研究展示了端侧LLM的实际应用,并讨论了未来的研究方向和挑战。

关键创新:论文的关键创新在于对端侧LLM部署的各种技术方法进行了全面的综述和分析,并指出了未来的研究方向和挑战。它整合了多个领域的知识,包括模型压缩、硬件加速和分布式计算,为研究人员提供了一个系统的参考框架。

关键设计:论文没有提出新的算法或模型,而是在综述的基础上,对各种现有技术进行了深入的分析和比较。例如,在模型压缩方面,论文比较了不同量化方法(如后训练量化和量化感知训练)的优缺点,并讨论了它们在端侧LLM部署中的适用性。在硬件加速方面,论文分析了不同硬件平台(如GPU、NPU和专用加速器)的性能和功耗特性,并探讨了如何针对特定硬件平台优化LLM的部署。

🖼️ 关键图片

📊 实验亮点

该综述全面梳理了端侧LLM部署与优化的各项技术,包括模型压缩、高效架构、硬件加速和边缘-云协同等。通过案例研究,展示了主要移动制造商在端侧LLM上的实际应用和潜在优势。论文还指出了自适应学习、多模态能力和个性化是未来端侧LLM的重要发展方向。

🎯 应用场景

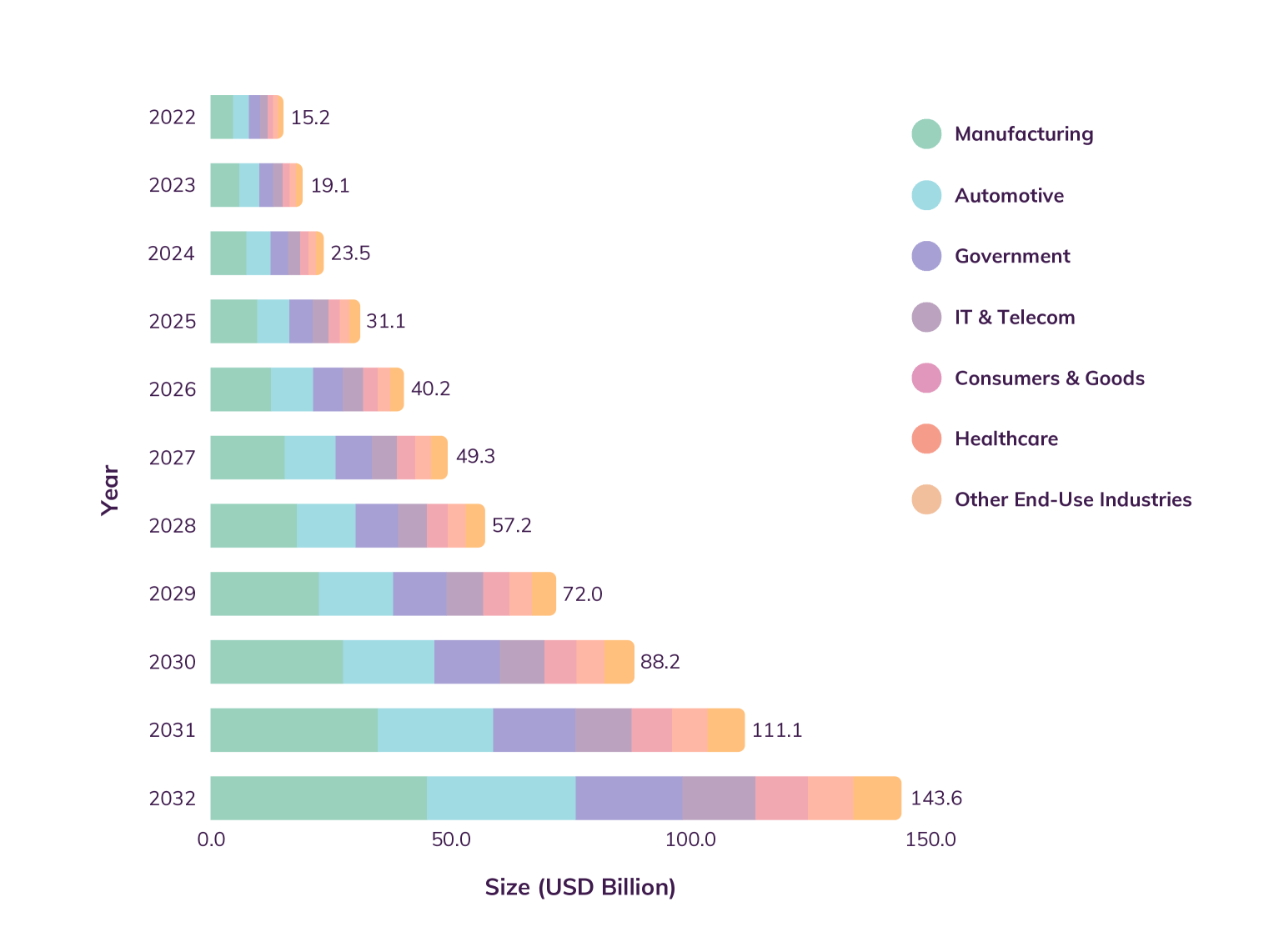

该研究成果对智能手机、物联网设备、可穿戴设备等边缘计算设备上的自然语言处理应用具有重要意义。例如,可以实现离线语音助手、本地化机器翻译、个性化推荐等功能,提高用户体验,保护用户隐私,并降低对云端服务器的依赖。未来,端侧LLM有望在智能家居、自动驾驶、工业自动化等领域发挥更大的作用。

📄 摘要(原文)

The advent of large language models (LLMs) revolutionized natural language processing applications, and running LLMs on edge devices has become increasingly attractive for reasons including reduced latency, data localization, and personalized user experiences. This comprehensive review examines the challenges of deploying computationally expensive LLMs on resource-constrained devices and explores innovative solutions across multiple domains. The paper investigates the development of on-device language models, their efficient architectures, including parameter sharing and modular designs, as well as state-of-the-art compression techniques like quantization, pruning, and knowledge distillation. Hardware acceleration strategies and collaborative edge-cloud deployment approaches are analyzed, highlighting the intricate balance between performance and resource utilization. Case studies of on-device language models from major mobile manufacturers demonstrate real-world applications and potential benefits. The review also addresses critical aspects such as adaptive learning, multi-modal capabilities, and personalization. By identifying key research directions and open challenges, this paper provides a roadmap for future advancements in on-device language models, emphasizing the need for interdisciplinary efforts to realize the full potential of ubiquitous, intelligent computing while ensuring responsible and ethical deployment. For a comprehensive review of research work and educational resources on on-device large language models (LLMs), please visit https://github.com/NexaAI/Awesome-LLMs-on-device. To download and run on-device LLMs, visit https://www.nexaai.com/models.