On the Limitations of Language Targeted Pruning: Investigating the Calibration Language Impact in Multilingual LLM Pruning

作者: Simon Kurz, Jian-Jia Chen, Lucie Flek, Zhixue Zhao

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-08-26 (更新: 2025-11-17)

备注: Accepted for publication in TACL

💡 一句话要点

研究多语言LLM剪枝中校准语言的影响,揭示现有剪枝方法的局限性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言LLM 模型剪枝 校准语言 内部表示 知识保留 语言无关特征 模型压缩

📋 核心要点

- 现有LLM剪枝方法主要基于英文文本校准,忽略了多语言LLM的特性及其在非英语语言中的应用。

- 本文通过比较不同校准语言对多语言模型剪枝的影响,分析了剪枝后的模型性能和内部表示变化。

- 实验表明,目标语言校准虽能保持困惑度,但不能持续提升下游任务性能,且会损失语言无关特征。

📝 摘要(中文)

本文深入研究了单语应用中多语言语言模型剪枝的性能和内部表示变化。针对多语言模型,首次全面地比较了不同校准语言对多种语言、任务、模型和最先进剪枝技术的影响。通过分析潜在子空间、剪枝掩码和神经元,结果表明,虽然目标语言校准能有效保持困惑度并产生高信噪比,但并不能持续提高下游任务性能。对内部表示的分析揭示了当前剪枝方法的局限性:它们虽然能有效保留语言特定特征等主要信息,但不足以弥补对知识保留和推理至关重要的细微、语言无关特征的损失。

🔬 方法详解

问题定义:论文旨在解决多语言LLM剪枝过程中,使用单一(通常是英语)校准语言可能导致模型在其他语言上性能下降的问题。现有方法主要关注在英文数据上进行校准,忽略了多语言LLM的特性,导致剪枝后的模型在非英文任务上的表现不佳。现有方法的痛点在于无法有效保留对知识保留和推理至关重要的细微、语言无关特征。

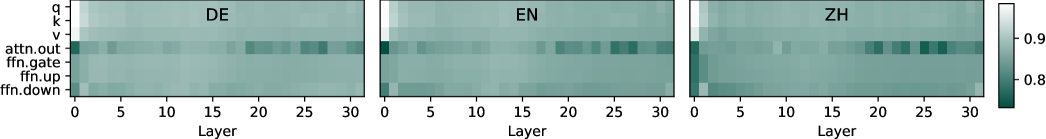

核心思路:论文的核心思路是通过对比不同校准语言对多语言LLM剪枝的影响,来揭示现有剪枝方法的局限性。通过分析剪枝后模型的性能、内部表示(潜在子空间、剪枝掩码、神经元)的变化,探究不同校准语言对模型的影响,从而更好地理解剪枝过程中的信息损失。

技术框架:论文的整体框架包括以下几个主要阶段:1) 选择多种多语言LLM模型、多种语言和任务;2) 使用不同的校准语言对模型进行剪枝;3) 在不同语言和任务上评估剪枝后模型的性能(困惑度、下游任务性能);4) 分析剪枝后模型的内部表示(潜在子空间、剪枝掩码、神经元),以理解信息损失的原因。

关键创新:论文的主要创新在于:1) 首次全面地研究了不同校准语言对多语言LLM剪枝的影响;2) 从内部表示的角度分析了剪枝过程中的信息损失,揭示了现有剪枝方法的局限性;3) 强调了保留语言无关特征对于知识保留和推理的重要性。与现有方法相比,本文更关注多语言场景下的剪枝问题,并深入分析了剪枝对模型内部表示的影响。

关键设计:论文的关键设计包括:1) 选择了多种具有代表性的多语言LLM模型;2) 选择了多种不同的语言和任务,以保证实验结果的泛化性;3) 使用了多种最先进的剪枝技术,以保证研究的全面性;4) 从多个层次(潜在子空间、剪枝掩码、神经元)分析了剪枝后模型的内部表示;5) 采用了信噪比等指标来评估剪枝的效果。

🖼️ 关键图片

📊 实验亮点

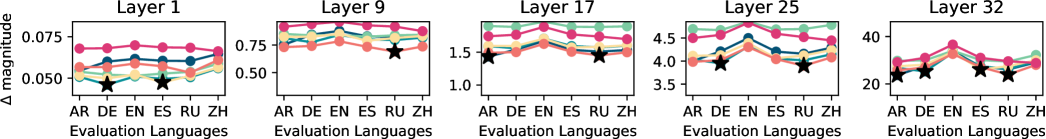

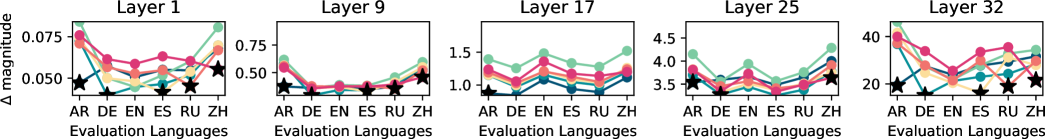

实验结果表明,虽然目标语言校准能有效保持困惑度并产生高信噪比,但并不能持续提高下游任务性能。更重要的是,内部表示分析揭示了现有剪枝方法的局限性:它们虽然能有效保留语言特定特征,但不足以弥补对知识保留和推理至关重要的细微、语言无关特征的损失。这表明,未来的剪枝方法需要更加关注语言无关特征的保留。

🎯 应用场景

该研究成果可应用于多语言LLM的压缩和部署,尤其是在资源受限的场景下。通过选择合适的校准语言,可以在保证模型性能的同时,显著降低模型的计算和存储成本。此外,该研究也为未来多语言LLM剪枝方法的设计提供了新的思路,例如,可以设计专门保留语言无关特征的剪枝策略。

📄 摘要(原文)

Recent advances in large language model (LLM) pruning have shown state-of-the-art (SotA) compression results in post-training and retraining-free settings while maintaining high predictive performance. However, previous research mainly considered calibrating based on English text, despite the multilingual nature of modern LLMs and their frequent use in non-English languages. This analysis paper conducts an in-depth investigation of the performance and internal representation changes associated with pruning multilingual language models for monolingual applications. We present the first comprehensive empirical study, comparing different calibration languages for pruning multilingual models across diverse languages, tasks, models, and SotA pruning techniques. We further analyze the latent subspaces, pruning masks, and individual neurons within pruned models. Our results reveal that while calibration on the target language effectively retains perplexity and yields high signal-to-noise ratios, it does not consistently improve downstream task performance. Further analysis of internal representations at three different levels highlights broader limitations of current pruning approaches: While they effectively preserve dominant information like language-specific features, this is insufficient to counteract the loss of nuanced, language-agnostic features that are crucial for knowledge retention and reasoning.