Balancing Diversity and Risk in LLM Sampling: How to Select Your Method and Parameter for Open-Ended Text Generation

作者: Yuxuan Zhou, Margret Keuper, Mario Fritz

分类: cs.CL, cs.AI

发布日期: 2024-08-24 (更新: 2025-01-08)

💡 一句话要点

提出基于前缀树的LLM采样方法评估框架,平衡多样性与风险

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 文本生成 采样策略 多样性 风险

📋 核心要点

- 现有LLM采样方法依赖人工设计的参数,且对少量示例文本敏感,缺乏通用性。

- 论文提出基于前缀树的框架,在解码时权衡多样性和风险,从而评估截断采样方法的能力。

- 该方法对现有截断采样方法进行了全面比较,并为用户选择参数提供了实用指导。

📝 摘要(中文)

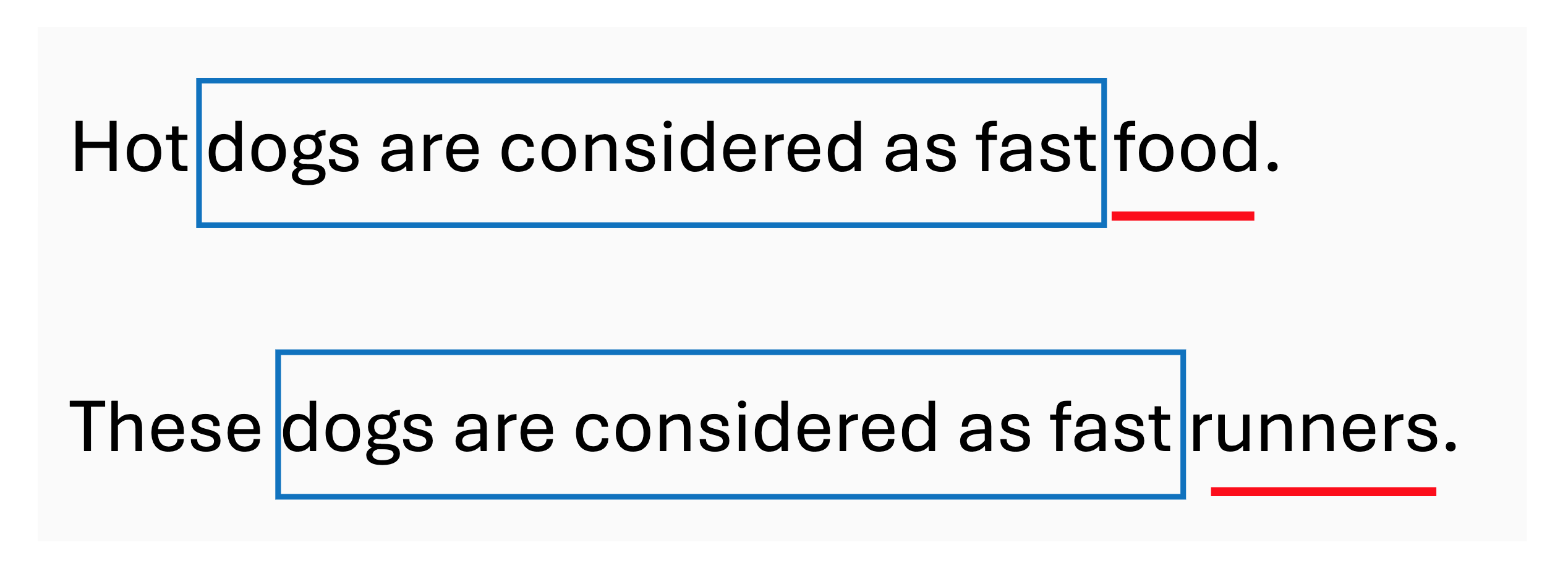

基于采样的解码策略已被广泛应用于大型语言模型(LLMs)中,通过调整温度和尾部截断来平衡多样性和质量。考虑到候选下一个token对不同前缀的强烈依赖性,最近的研究提出了自适应地截断LLM预测分布的尾部。尽管这些方法在开放式文本生成任务中取得了改进的结果,但结果高度依赖于精心设计的参数和有限的示例文本。本文提出了一种系统的方法来估计截断采样方法的能力,通过考虑每个解码步骤中多样性和风险之间的权衡,基于我们收集的前缀树,该前缀树保留了完整句子的上下文。我们的工作对现有的截断采样方法进行了全面的比较,并为用户选择参数提供了实用的指导。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)采样解码策略,如温度采样和尾部截断,在开放式文本生成任务中被广泛使用。然而,这些方法的结果高度依赖于人工设计的参数,并且对少量示例文本非常敏感。这意味着针对特定任务或数据集调整的参数,可能无法很好地泛化到其他场景。此外,现有方法缺乏一种系统性的方式来评估不同采样方法的能力,以及如何根据具体任务的需求选择合适的参数。

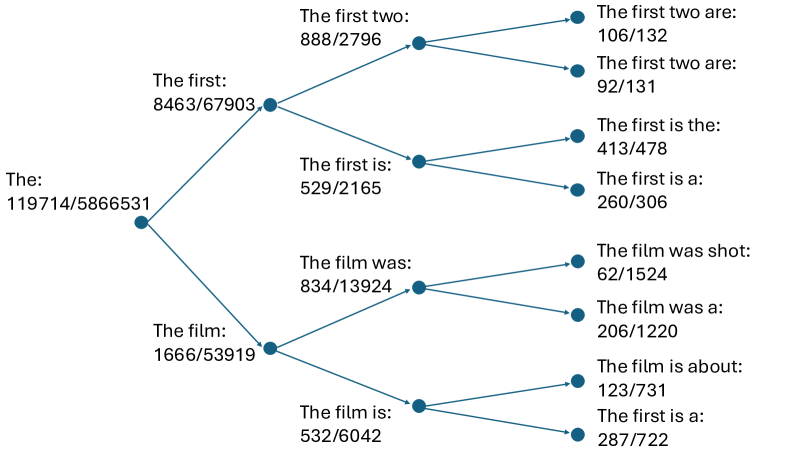

核心思路:论文的核心思路是构建一个基于前缀树的框架,用于在每个解码步骤中估计截断采样方法的能力。该框架通过考虑多样性和风险之间的权衡来实现这一目标。前缀树用于保存完整句子的上下文信息,从而可以更准确地评估不同采样策略在不同上下文下的表现。通过分析前缀树中的信息,可以估计不同采样方法的容量,并为用户选择合适的参数提供指导。

技术框架:该框架主要包含以下几个阶段:1) 构建前缀树:收集大量文本数据,并构建一个前缀树,用于保存文本的上下文信息。2) 评估多样性:对于每个解码步骤,评估不同采样方法生成文本的多样性。3) 评估风险:对于每个解码步骤,评估不同采样方法生成不合理或错误文本的风险。4) 权衡多样性和风险:基于多样性和风险的评估结果,计算一个综合指标,用于评估不同采样方法的能力。5) 参数选择:根据综合指标,为用户选择合适的采样方法和参数。

关键创新:该论文最重要的技术创新点在于提出了一种系统性的方法来评估截断采样方法的能力,通过考虑每个解码步骤中多样性和风险之间的权衡。与现有方法相比,该方法不需要人工设计参数,并且可以更好地泛化到不同的任务和数据集。此外,该方法还提供了一种实用的指导,帮助用户选择合适的采样方法和参数。

关键设计:论文的关键设计包括:1) 前缀树的构建方式,如何有效地保存上下文信息。2) 多样性的评估指标,例如生成文本的熵或互信息。3) 风险的评估指标,例如生成文本的困惑度或流畅度。4) 多样性和风险的权衡方式,例如使用加权平均或帕累托优化。5) 参数选择的策略,例如基于综合指标选择最佳参数或提供参数范围建议。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出方法的有效性。实验结果表明,该方法可以有效地评估不同截断采样方法的能力,并为用户选择合适的参数提供指导。具体来说,该方法在多个开放式文本生成任务中取得了显著的性能提升,例如在故事创作任务中,生成文本的质量和多样性均得到了明显改善。

🎯 应用场景

该研究成果可广泛应用于各种开放式文本生成任务,例如故事创作、对话生成、代码生成等。通过该方法,用户可以根据具体任务的需求,选择合适的采样方法和参数,从而提高生成文本的质量和多样性。此外,该研究还可以促进对LLM采样解码策略的更深入理解,并为未来的研究提供指导。

📄 摘要(原文)

Sampling-based decoding strategies have been widely adopted for Large Language Models (LLMs) in numerous applications, targeting a balance between diversity and quality via temperature tuning and tail truncation. Considering the strong dependency of the candidate next tokens on different prefixes, recent studies propose to adaptively truncate the tail of LLMs' predicted distribution. Although improved results have been reported with these methods on open-ended text generation tasks, the results are highly dependent on the curated parameters and the limited exemplar text. In this paper, we propose a systematic way to estimate the capacity of a truncation sampling method by considering the trade-off between diversity and risk at each decoding step, based on our collected prefix tree which preserves the context of a full sentence. Our work offers a comprehensive comparison of existing truncation sampling methods and serves as a practical user guideline for their parameter selection.