HySem: A context length optimized LLM pipeline for unstructured tabular extraction

作者: Narayanan PP, Anantharaman Palacode Narayana Iyer

分类: cs.CL, cs.AI

发布日期: 2024-08-18 (更新: 2024-10-05)

备注: 19 pages, 7 tables, 10 figures, 2 algorithms

💡 一句话要点

HySem:针对非结构化表格抽取,优化上下文长度的LLM流程

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 表格抽取 语义表示 大型语言模型 上下文长度优化 JSON生成

📋 核心要点

- 制药行业表格数据利用率低,主要挑战在于表格的非结构化和多样性,以及现有方法在语义表示上的不足。

- HySem通过优化上下文长度,并使用定制微调的LLM,将HTML表格转换为准确的语义JSON表示。

- HySem在准确性上超越了同类开源模型,并与GPT-4o性能相当,同时有效解决了上下文长度限制问题。

📝 摘要(中文)

制药行业的法规合规报告依赖于详细的表格,但由于其非结构化格式和任意内容,这些表格在合规之外的利用率往往不足。提取和语义表示表格数据具有挑战性,因为表格呈现方式多种多样。大型语言模型(LLM)在语义表示方面表现出巨大的潜力,但它们面临着与准确性和上下文大小限制相关的挑战,而这些挑战对于行业应用至关重要。我们介绍了一种名为HySem的流程,该流程采用了一种新颖的上下文长度优化技术,可以从HTML表格生成准确的语义JSON表示。这种方法利用定制的微调模型,专门为对成本和隐私敏感的中小型制药企业设计。HySem在通用硬件上运行,并利用开源模型,在准确性方面超越了其同类开源模型,并且在与OpenAI GPT-4o进行基准测试时提供了具有竞争力的性能,并有效解决了上下文长度限制,这是支持更大表格的关键因素。

🔬 方法详解

问题定义:论文旨在解决从非结构化HTML表格中准确提取语义信息并将其表示为JSON格式的问题。现有方法,特别是直接使用大型语言模型(LLM),面临着两个主要痛点:一是准确性不足,二是上下文长度限制,导致无法处理大型表格。这些问题限制了表格数据在制药等行业的应用。

核心思路:HySem的核心思路是通过上下文长度优化来提高LLM在表格语义抽取任务中的准确性和效率。具体而言,它通过定制的微调模型和优化的输入方式,使得LLM能够在有限的上下文窗口内处理更多的表格内容,从而更好地理解表格的结构和语义。

技术框架:HySem的整体框架是一个pipeline,主要包括以下几个阶段:1) HTML表格解析:将HTML表格解析为结构化的数据表示。2) 上下文长度优化:采用特定的技术来压缩或选择关键的表格内容,以适应LLM的上下文窗口。3) LLM语义抽取:使用定制的微调LLM模型,从优化的表格表示中提取语义信息。4) JSON生成:将提取的语义信息转换为JSON格式。

关键创新:HySem的关键创新在于其上下文长度优化技术和定制的微调模型。上下文长度优化技术允许模型处理更大的表格,而定制的微调模型则针对特定的表格类型和语义信息进行了优化,从而提高了准确性。与现有方法相比,HySem能够更好地平衡准确性和效率,并能够处理更大的表格。

关键设计:论文中关键的设计细节可能包括:1) 上下文长度优化的具体算法,例如,选择最具代表性的行和列。2) 微调LLM模型的具体架构和训练数据,例如,使用制药行业的表格数据进行微调。3) JSON生成的规则和模板,以确保生成的JSON格式符合行业标准。4) 损失函数的设计,用于优化LLM模型的训练。

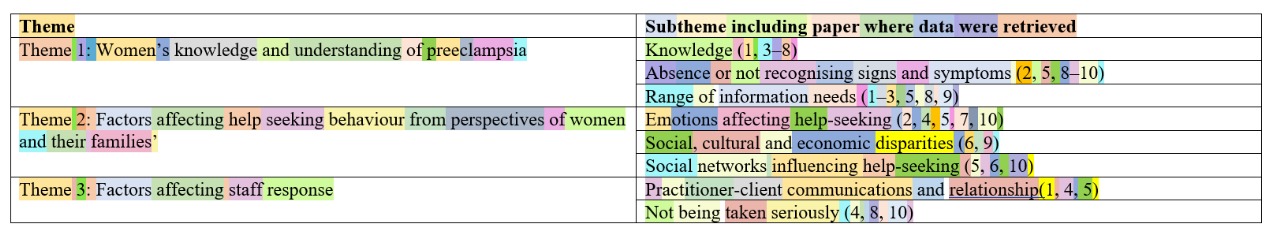

🖼️ 关键图片

📊 实验亮点

HySem在实验中超越了同类开源模型,并在与OpenAI GPT-4o的基准测试中表现出具有竞争力的性能。它有效地解决了上下文长度限制,能够处理更大的表格,并且在准确性方面取得了显著的提升。具体的性能数据和提升幅度在论文中进行了详细的展示。

🎯 应用场景

HySem在制药行业的法规合规报告、数据分析和知识发现方面具有广泛的应用前景。它可以自动提取和结构化表格数据,从而减少人工处理的工作量,提高数据质量和分析效率。此外,HySem还可以应用于其他需要处理非结构化表格数据的领域,如金融、医疗和法律等。

📄 摘要(原文)

Regulatory compliance reporting in the pharmaceutical industry relies on detailed tables, but these are often under-utilized beyond compliance due to their unstructured format and arbitrary content. Extracting and semantically representing tabular data is challenging due to diverse table presentations. Large Language Models (LLMs) demonstrate substantial potential for semantic representation, yet they encounter challenges related to accuracy and context size limitations, which are crucial considerations for the industry applications. We introduce HySem, a pipeline that employs a novel context length optimization technique to generate accurate semantic JSON representations from HTML tables. This approach utilizes a custom fine-tuned model specifically designed for cost- and privacy-sensitive small and medium pharmaceutical enterprises. Running on commodity hardware and leveraging open-source models, HySem surpasses its peer open-source models in accuracy and provides competitive performance when benchmarked against OpenAI GPT-4o and effectively addresses context length limitations, which is a crucial factor for supporting larger tables.