The Death of Schema Linking? Text-to-SQL in the Age of Well-Reasoned Language Models

作者: Karime Maamari, Fadhil Abubaker, Daniel Jaroslawicz, Amine Mhedhbi

分类: cs.CL

发布日期: 2024-08-14 (更新: 2024-08-18)

💡 一句话要点

利用大型语言模型,本文提出一种无需模式链接的Text-to-SQL方法,并在BIRD基准上取得领先。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text-to-SQL 大型语言模型 模式链接 数据库查询 自然语言处理

📋 核心要点

- 传统Text-to-SQL方法依赖模式链接,但其可能错误地排除必要信息,限制了查询生成准确性。

- 本文提出一种新颖的Text-to-SQL流程,在大型语言模型足够大的上下文窗口下,完全避免模式链接。

- 通过数据增强、选择和校正等技术,进一步提升模型性能,并在BIRD基准上取得了显著的准确率提升。

📝 摘要(中文)

模式链接是Text-to-SQL流程中的关键步骤,旨在检索用户查询相关的数据库表和列,同时忽略不相关的部分。然而,不完善的模式链接可能排除生成准确查询所需的必要列。本文重新审视了在使用最新一代大型语言模型(LLMs)时的模式链接。经验表明,即使存在大量不相关的模式元素,较新的模型也擅长在生成过程中利用相关的模式元素。因此,当模式适合模型的上下文窗口时,我们的Text-to-SQL流程完全放弃了模式链接,以最大限度地减少由于过滤所需模式元素而导致的问题。此外,我们没有过滤上下文信息,而是强调诸如增强、选择和校正等技术,并采用它们来提高Text-to-SQL流程的准确性。我们的方法在BIRD基准上排名第一,实现了71.83%的准确率。

🔬 方法详解

问题定义:Text-to-SQL任务旨在将自然语言查询转换为可执行的SQL语句。传统方法中,模式链接负责从数据库模式中选择与查询相关的表和列。然而,模式链接模块可能存在缺陷,错误地过滤掉生成正确SQL语句所需的关键信息,从而导致查询生成错误。现有方法过度依赖模式链接的准确性,缺乏对大型语言模型直接处理完整模式能力的探索。

核心思路:本文的核心思路是,当大型语言模型(LLMs)的上下文窗口足够大时,可以直接将完整的数据库模式输入模型,而无需进行模式链接。LLMs具备强大的上下文理解和推理能力,能够从大量信息中识别并利用相关的模式元素。通过避免模式链接,可以消除因模式链接错误而导致的信息丢失,从而提高查询生成的准确性。

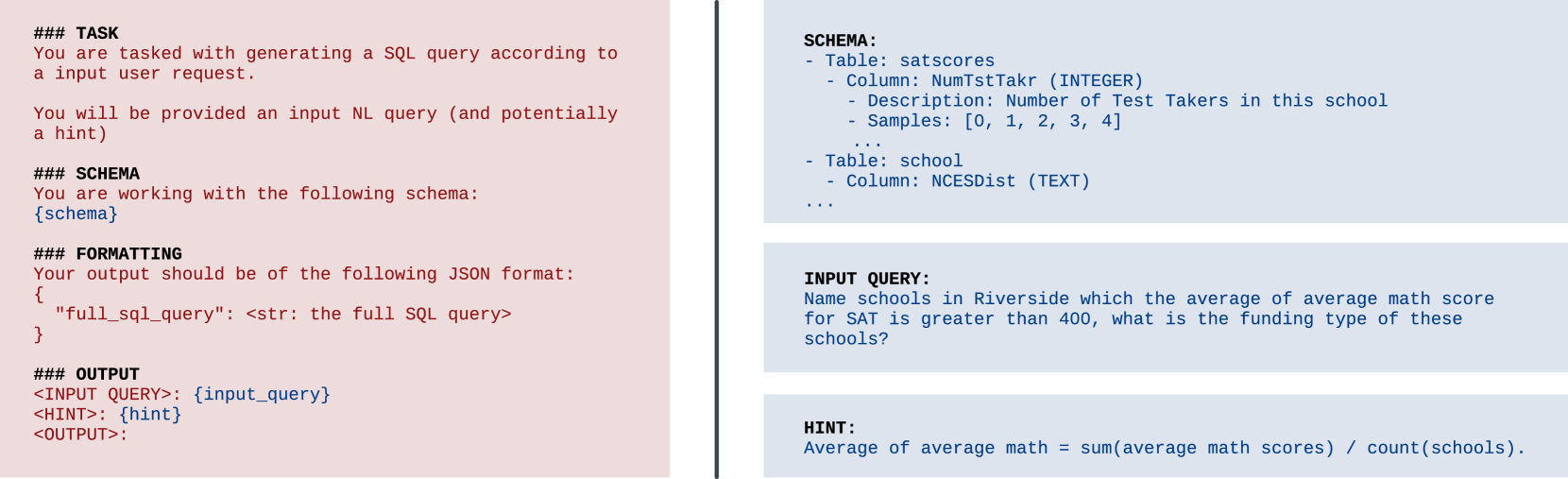

技术框架:该Text-to-SQL流程主要包括以下步骤:1) 将自然语言查询和完整的数据库模式(表名、列名、数据类型等)拼接成模型的输入;2) 使用大型语言模型生成SQL查询语句;3) 使用数据增强技术扩充训练数据,提高模型的泛化能力;4) 使用选择和校正技术,对生成的SQL查询进行优化,例如选择更合适的表或列,修正语法错误等。

关键创新:本文最重要的技术创新点在于,直接利用大型语言模型处理完整的数据库模式,而无需进行模式链接。这种方法充分利用了LLMs强大的上下文理解能力,避免了模式链接错误带来的信息损失。此外,本文还探索了数据增强、选择和校正等技术,进一步提升了模型性能。

关键设计:在模型输入方面,将自然语言查询和数据库模式以特定的格式拼接在一起,例如使用特殊符号分隔表名、列名和数据类型。在数据增强方面,采用随机替换、同义词替换等方法生成新的训练样本。在选择和校正方面,可以使用规则或模型来判断生成的SQL查询是否合理,并进行相应的修改。

🖼️ 关键图片

📊 实验亮点

该方法在BIRD基准测试中取得了71.83%的准确率,超越了所有已知的Text-to-SQL系统。实验结果表明,在大型语言模型足够大的上下文窗口下,放弃模式链接可以显著提高查询生成的准确性。数据增强、选择和校正等技术进一步提升了模型性能。

🎯 应用场景

该研究成果可应用于智能数据库查询、自然语言数据分析、智能客服等领域。通过直接利用大型语言模型处理数据库模式,可以降低Text-to-SQL系统的开发难度,提高查询准确率,并为用户提供更便捷的数据库访问方式。未来,该方法有望扩展到更复杂的数据库和查询场景。

📄 摘要(原文)

Schema linking is a crucial step in Text-to-SQL pipelines. Its goal is to retrieve the relevant tables and columns of a target database for a user's query while disregarding irrelevant ones. However, imperfect schema linking can often exclude required columns needed for accurate query generation. In this work, we revisit schema linking when using the latest generation of large language models (LLMs). We find empirically that newer models are adept at utilizing relevant schema elements during generation even in the presence of large numbers of irrelevant ones. As such, our Text-to-SQL pipeline entirely forgoes schema linking in cases where the schema fits within the model's context window in order to minimize issues due to filtering required schema elements. Furthermore, instead of filtering contextual information, we highlight techniques such as augmentation, selection, and correction, and adopt them to improve the accuracy of our Text-to-SQL pipeline. Our approach ranks first on the BIRD benchmark achieving an accuracy of 71.83%.