Can Advanced LLMs Coach Smaller LLMs? Knowledge Distillation for Goal-Oriented Dialogs

作者: Tong Wang, K. Sudhir, Dat Hong

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-08-13 (更新: 2025-09-13)

💡 一句话要点

提出GER框架,通过知识蒸馏提升小模型在目标导向对话中的性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 知识蒸馏 目标导向对话 大型语言模型 提示工程 检索增强

📋 核心要点

- 现有LLM在目标导向对话中面临性能、成本和控制的权衡,开源模型性能不足。

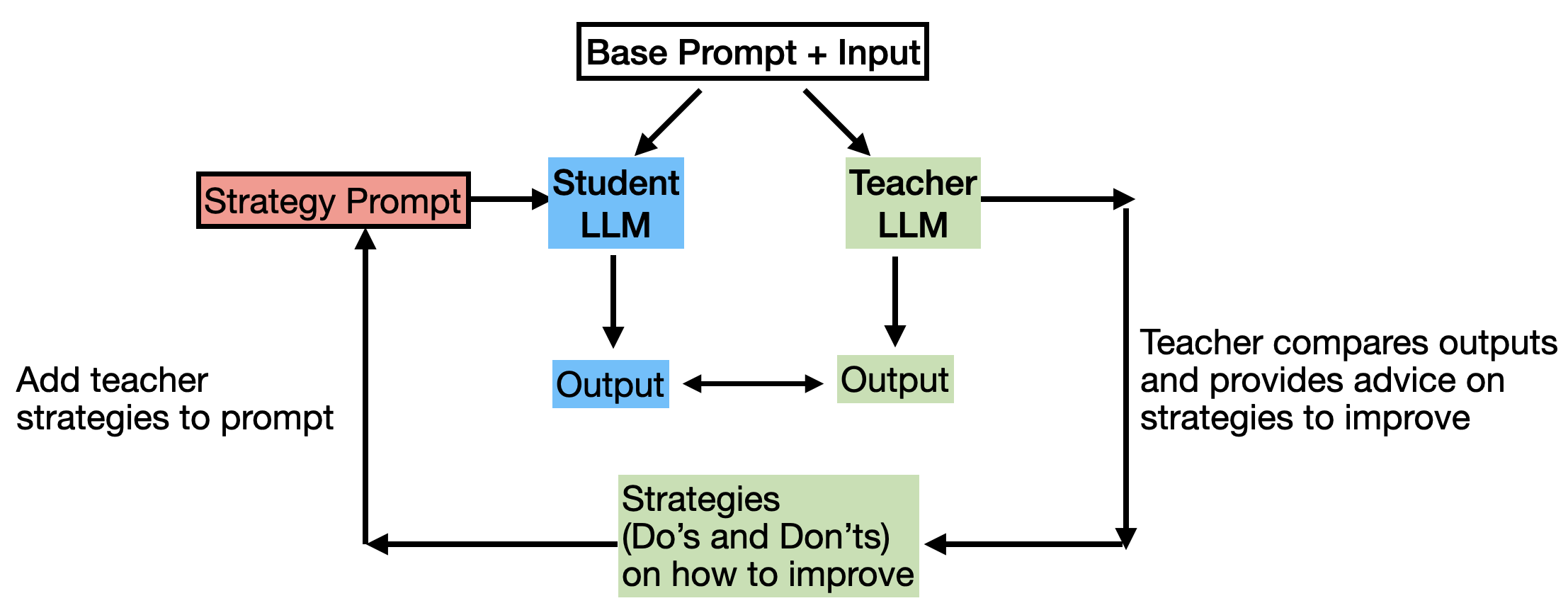

- 提出GER框架,通过教师LLM提取指导知识,辅助学生LLM进行推理,无需修改学生模型参数。

- 实验表明,GER优于传统微调和非定制指导方法,并具有良好的泛化能力。

📝 摘要(中文)

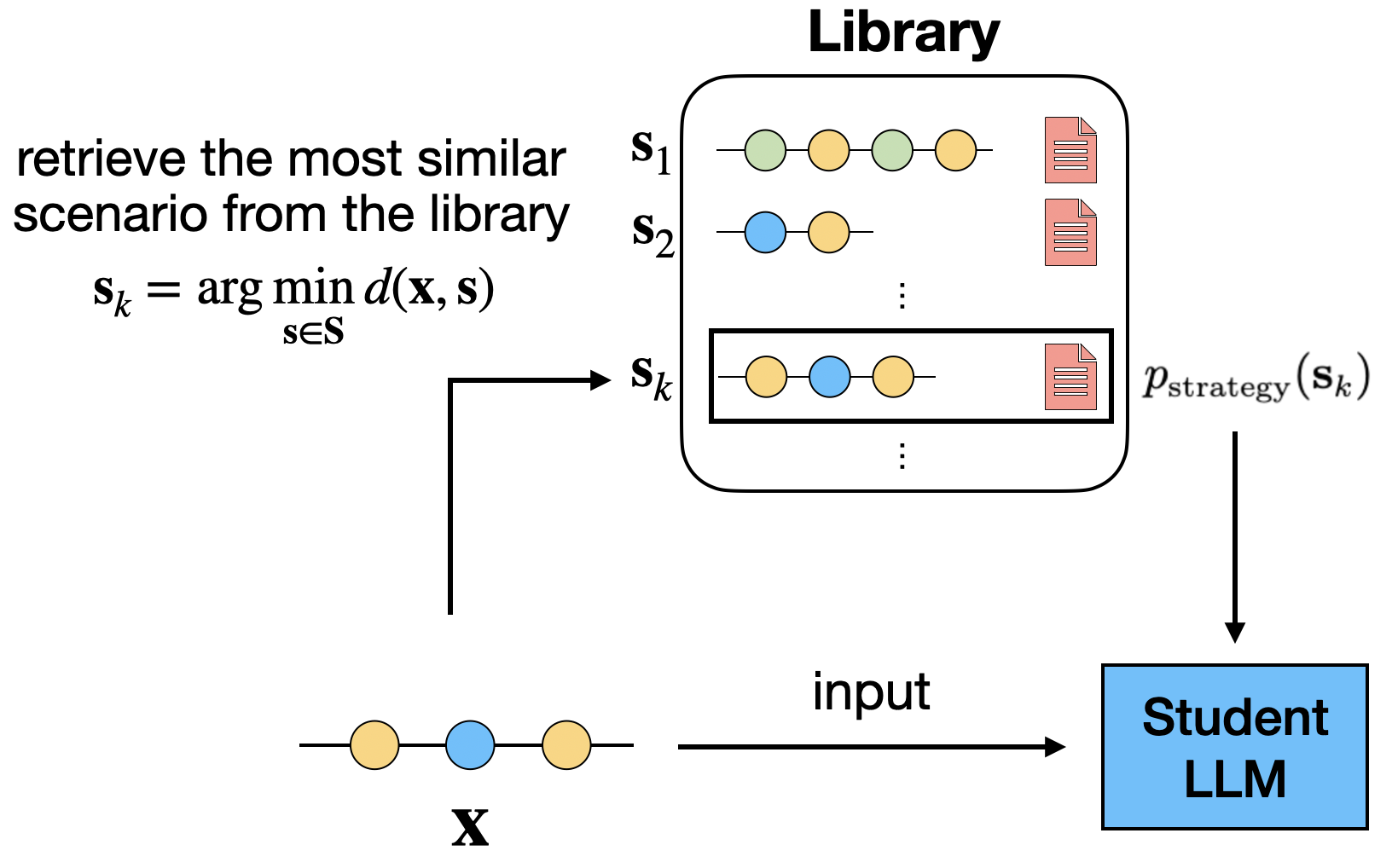

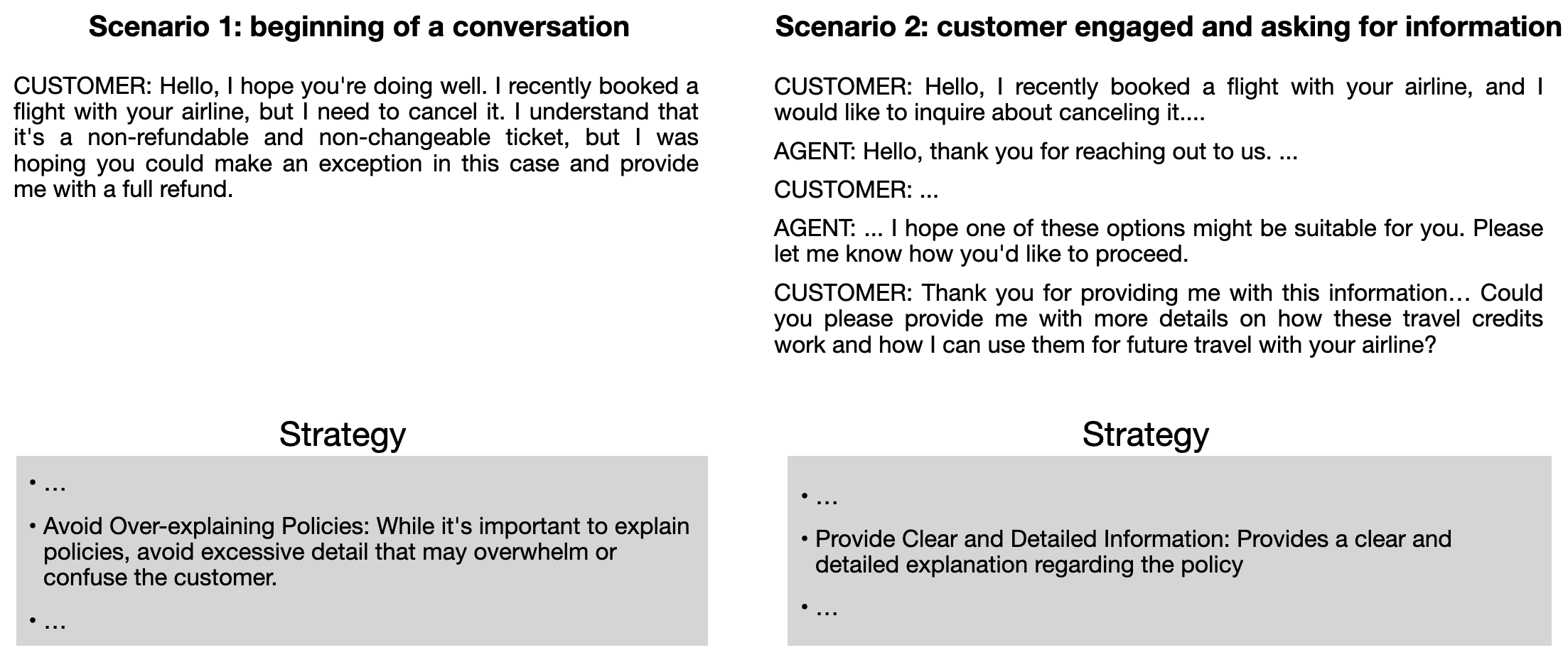

企业在部署大型语言模型(LLM)用于目标导向对话(如客户服务)时,面临性能、控制和成本之间的关键权衡。GPT-4等专有模型性能强大,但成本高昂且无法自托管,引发安全和隐私问题。开源替代方案提供灵活性和较低的token成本,但在性能上有所滞后。我们介绍了一种基于提示的知识蒸馏框架——指导提取与检索(GER),其中高性能教师LLM指导低性能学生LLM,而无需修改学生的参数。GER从教师那里提取各种对话场景的战术指导,并将这些场景-指导对存储在结构化库中。在推理时,学生检索相关指导并将其集成到其提示中。虽然GER训练可以完全使用合成数据进行引导,但其模块化设计使其能够无缝地用人工对话日志增强合成数据。此外,模块化设计使得指导库的审计和更新变得容易,以适应新的场景和约束。实验表明,GER基于指导的训练优于基于示例输出的微调和非定制指导基线,并且可以推广到其他上下文和学生模型。GER框架可能可以扩展到指导人工服务代理。

🔬 方法详解

问题定义:论文旨在解决目标导向对话系统中,小型LLM性能不足的问题。现有方法,如直接微调或使用通用提示,无法充分利用大型LLM的知识,且微调成本较高,通用提示效果有限。

核心思路:核心思想是利用知识蒸馏,将大型LLM的知识迁移到小型LLM,但不同于传统的参数微调,GER通过提取并检索指导信息的方式,在推理阶段动态地增强小型LLM的提示,从而提升其性能。这种方法避免了对学生模型参数的修改,降低了训练成本,并提高了灵活性。

技术框架:GER框架包含以下几个主要模块:1) 指导提取:使用教师LLM,针对不同的对话场景,生成相应的指导信息。2) 指导库构建:将场景-指导对存储在结构化的指导库中,方便检索。3) 指导检索:在推理阶段,根据当前对话场景,从指导库中检索相关的指导信息。4) 提示集成:将检索到的指导信息集成到学生LLM的提示中,从而引导学生LLM生成更准确的回复。

关键创新:关键创新在于使用提示工程和检索增强的方式进行知识蒸馏,避免了对学生模型参数的直接修改。这种方法具有更高的灵活性和可扩展性,可以方便地添加新的场景和指导信息。此外,GER框架的模块化设计使得指导库的审计和更新变得容易。

关键设计:GER框架的关键设计包括:1) 如何设计有效的提示,从教师LLM中提取高质量的指导信息。2) 如何构建高效的指导库,以便快速检索相关的指导信息。3) 如何将检索到的指导信息有效地集成到学生LLM的提示中,避免引入噪声或干扰。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GER框架在目标导向对话任务中显著优于传统的微调方法和非定制指导基线。具体来说,GER在多个数据集上取得了更高的准确率和更低的错误率。此外,GER框架还具有良好的泛化能力,可以应用于不同的学生模型和对话场景。这些结果表明,GER是一种有效的知识蒸馏方法,可以显著提升小型LLM在目标导向对话中的性能。

🎯 应用场景

GER框架可应用于各种目标导向对话系统,如客户服务、智能助手等。它可以帮助企业在保证性能的同时,降低成本和提高安全性。此外,GER框架还可以扩展到指导人工服务代理,提高其服务质量和效率。该研究的未来影响在于推动了知识蒸馏技术在对话系统中的应用,并为构建更智能、更高效的对话系统提供了新的思路。

📄 摘要(原文)

Enterprises deploying LLMs for goal-oriented dialogs, such as customer service, face a critical trade-off between performance, control, and cost. Proprietary models like GPT-4 offer strong performance but are costly and cannot be self-hosted, raising security and privacy concerns. Open-source alternatives offer flexibility and lower token costs but lag in performance. We introduce Guidance Elicitation and Retrieval (GER), a prompt-based knowledge distillation framework where a high-performance teacher LLM coaches a lower-performance student without modifying the student's parameters. GER extracts tactical guidance for a wide range of dialog scenarios from the teacher and stores these scenario-guidance pairs in a structured library. At inference time, the student retrieves the relevant guidance and integrates it into its prompt. While GER training can be bootstrapped entirely with synthetic data, its modular design lets it seamlessly augment the synthetic data with human conversational logs. In addition, the modular design enables easy auditing and updating of the guidance library as new scenarios and constraints emerge. Experiments show GER's guidance-based coaching outperforms both example output based fine-tuning and non-customized guidance baselines, and generalizes across other contexts and student models. The GER framework is potentially extensible to coach human service agents.