A semantic embedding space based on large language models for modelling human beliefs

作者: Byunghwee Lee, Rachith Aiyappa, Yong-Yeol Ahn, Haewoon Kwak, Jisun An

分类: cs.CL, cs.CY, physics.soc-ph

发布日期: 2024-08-13 (更新: 2025-06-06)

备注: 5 figures, 2 tables (SI: 25 figures, 7 tables). Published in Nature Human Behaviour (2025)

DOI: 10.1038/s41562-025-02228-z

💡 一句话要点

利用大型语言模型构建语义嵌入空间,建模人类信念体系

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 信念建模 大型语言模型 语义嵌入 认知失调 在线辩论 用户行为预测

📋 核心要点

- 现有信念研究多集中于特定议题,依赖调查问卷,难以捕捉复杂信念体系。

- 论文提出利用大型语言模型,构建信念语义嵌入空间,捕捉信念间的关联与极化。

- 实验表明,该空间能预测个体新信念,并估计认知失调,揭示信念形成机制。

📝 摘要(中文)

信念是人类认知和决策的基础,指导着我们的行为和社会关系。构建一个能够概括信念及其相互关系的模型的对于理解信念对我们行为的影响至关重要。然而,关于信念相互作用的研究通常局限于与特定问题相关的信念,并且严重依赖于调查。我们提出了一种方法,通过利用在线用户辩论数据并将信念映射到使用微调的大型语言模型(LLM)构建的神经嵌入空间,来研究数千种信念之间细微的相互作用。这个信念空间捕捉了跨社会问题的各种信念的相互联系和极化。我们的研究结果表明,这个信念空间中的位置可以预测个体的新信念,并根据现有信念和新信念之间的距离来估计认知失调。这项研究表明,LLM与人类信念的集体在线记录相结合,可以为了解支配人类信念形成的基本原则提供见解。

🔬 方法详解

问题定义:现有研究在理解人类信念体系方面存在局限性。一方面,它们通常关注特定议题下的信念,缺乏对跨领域信念之间相互作用的建模能力。另一方面,研究方法主要依赖于调查问卷,难以捕捉大规模、动态变化的信念数据,并且存在主观偏差。因此,如何构建一个能够有效表示和理解人类信念体系,并能预测个体信念变化的模型,是一个重要的挑战。

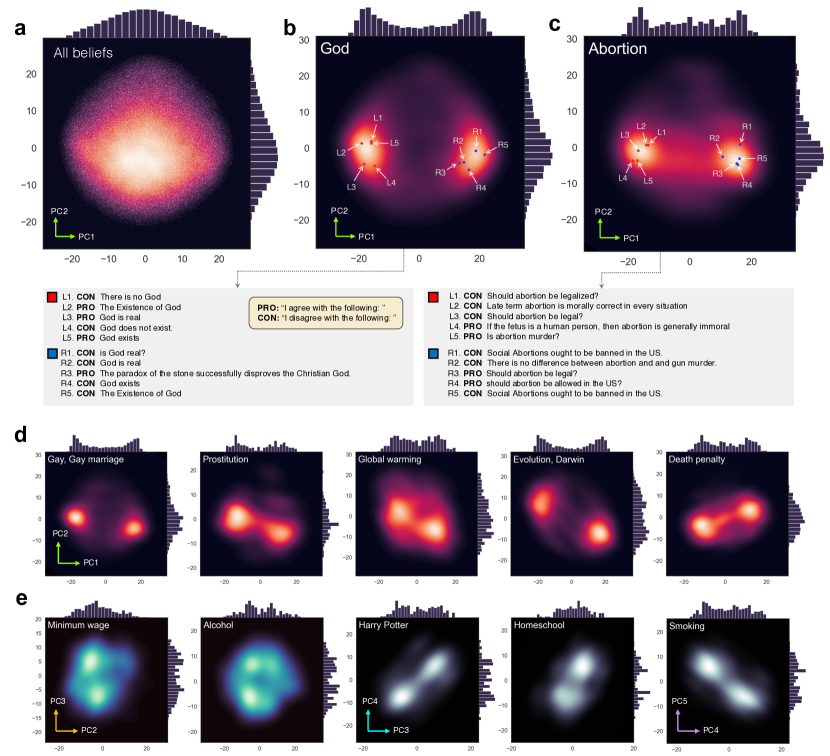

核心思路:论文的核心思路是利用大型语言模型(LLM)的语义理解能力,将人类信念映射到一个高维的语义嵌入空间中。在这个空间中,相似的信念在空间中距离较近,相反的信念距离较远。通过分析信念在空间中的位置和关系,可以理解信念之间的相互作用,并预测个体的新信念。这种方法避免了传统调查问卷的主观性和局限性,能够处理大规模、多样化的信念数据。

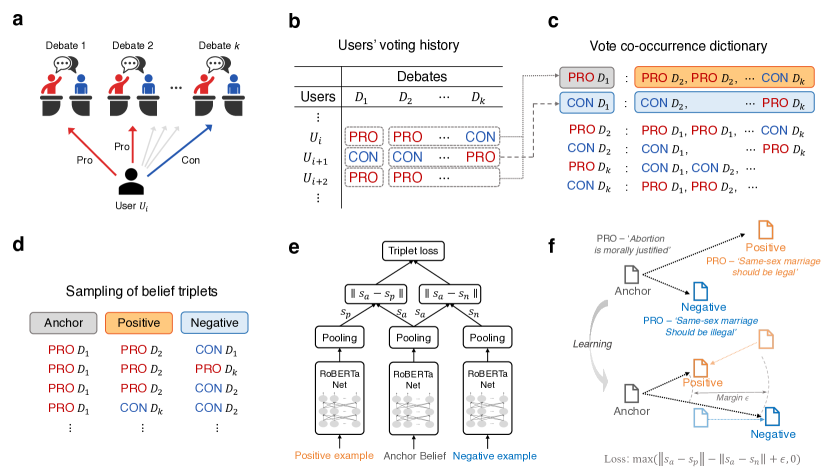

技术框架:该方法主要包含以下几个阶段:1) 数据收集:从在线用户辩论数据中提取人类信念的文本描述。2) 模型微调:使用收集到的信念数据对大型语言模型进行微调,使其更好地理解和表示人类信念。3) 语义嵌入:将信念文本输入到微调后的LLM中,得到信念的语义嵌入向量。4) 信念空间构建:将所有信念的嵌入向量构建成一个高维的语义空间。5) 信念预测和认知失调估计:利用信念空间中的位置和关系,预测个体的新信念,并根据现有信念和新信念之间的距离来估计认知失调。

关键创新:该方法最重要的技术创新点在于利用大型语言模型构建信念的语义嵌入空间。与传统的基于词袋模型或主题模型的信念表示方法相比,LLM能够更好地捕捉信念的语义信息和上下文关系,从而更准确地表示信念之间的相似性和差异性。此外,该方法还能够处理大规模、多样化的信念数据,并能够预测个体的新信念和估计认知失调。

关键设计:论文使用了BERT模型作为基础的LLM,并使用在线辩论数据进行了微调。微调的目标是使模型能够更好地区分支持和反对特定观点的信念。在信念空间构建方面,使用了余弦相似度来衡量信念之间的距离。在信念预测方面,使用了k近邻算法来预测个体的新信念。在认知失调估计方面,使用了信念空间中现有信念和新信念之间的距离作为认知失调的指标。

🖼️ 关键图片

📊 实验亮点

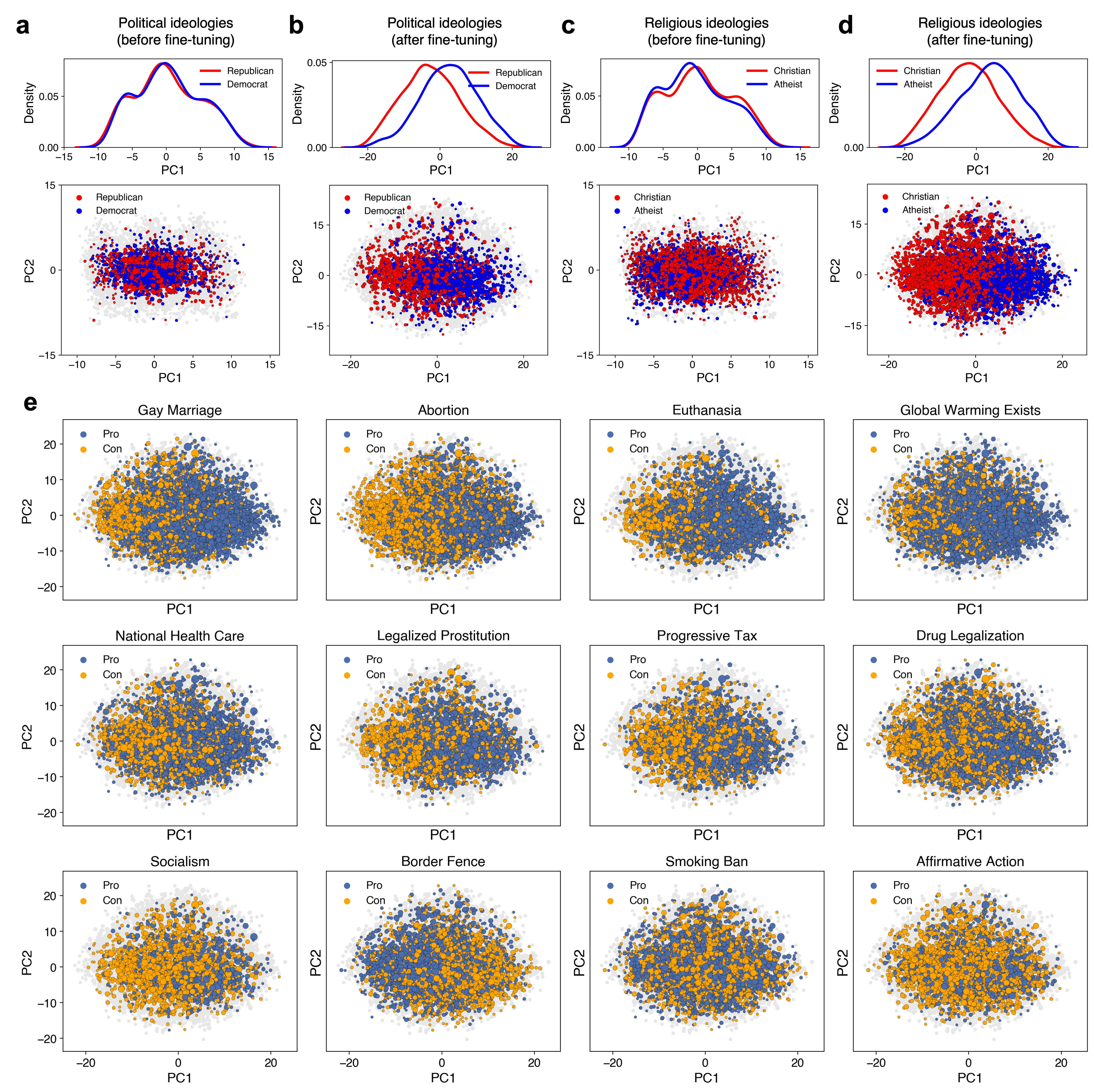

实验结果表明,该方法构建的信念空间能够有效预测个体的新信念,并能够准确估计认知失调。具体来说,信念空间中的位置能够显著预测个体对新信念的接受程度,并且与实际调查数据具有高度一致性。此外,该方法还能够识别出具有较高认知失调风险的个体,为心理干预提供参考。

🎯 应用场景

该研究成果可应用于多个领域。例如,在舆情分析中,可以利用该模型分析社会热点事件中不同群体的信念分布和演变趋势。在个性化推荐中,可以根据用户的信念偏好推荐相关信息和产品。在心理学研究中,可以利用该模型研究信念对个体行为和决策的影响。此外,该模型还可以用于构建智能对话系统,使其能够更好地理解用户的信念,并进行更自然的对话。

📄 摘要(原文)

Beliefs form the foundation of human cognition and decision-making, guiding our actions and social connections. A model encapsulating beliefs and their interrelationships is crucial for understanding their influence on our actions. However, research on belief interplay has often been limited to beliefs related to specific issues and relied heavily on surveys. We propose a method to study the nuanced interplay between thousands of beliefs by leveraging an online user debate data and mapping beliefs onto a neural embedding space constructed using a fine-tuned large language model (LLM). This belief space captures the interconnectedness and polarization of diverse beliefs across social issues. Our findings show that positions within this belief space predict new beliefs of individuals and estimate cognitive dissonance based on the distance between existing and new beliefs. This study demonstrates how LLMs, combined with collective online records of human beliefs, can offer insights into the fundamental principles that govern human belief formation.