Building Decision Making Models Through Language Model Regime

作者: Yu Zhang, Haoxiang Liu, Feijun Jiang, Weihua Luo, Kaifu Zhang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-08-12

💡 一句话要点

提出基于大语言模型的决策模型训练框架LTU,提升电商场景决策能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 决策模型 预训练 微调 电商 广告优化 搜索优化 泛化能力

📋 核心要点

- 传统决策模型泛化性差,需为每个任务单独训练,限制了其应用范围。

- LTU框架利用LLM的泛化能力,通过预训练和微调,构建通用的决策模型。

- 在电商广告和搜索优化实验中,LTU超越了传统监督学习方法,提升了决策能力。

📝 摘要(中文)

本文提出了一种利用大型语言模型(LLM)泛化能力解决决策问题的新方法。传统方法如专家系统、规划算法和强化学习通常泛化能力有限,需要为每个独特任务训练新模型。相比之下,LLM在各种语言任务中表现出卓越的泛化能力,这启发了一种新的决策模型训练策略。该方法被称为“先学习后使用”(LTU),包含两个阶段:首先,通过整合来自各个领域和决策背景的知识,开发一个鲁棒的基础决策模型;然后,针对特定决策场景优化该基础模型。与通过监督学习使用LLM进行决策的其他研究不同,LTU方法采用了一种通用的训练方法,将广泛的预训练与有针对性的微调相结合。在广告和搜索优化等电商领域的实验表明,LTU方法在决策能力和泛化方面优于传统的监督学习方法。LTU方法是第一个将LLM与单步和多步决策任务相结合的实用训练架构,可应用于游戏和机器人领域之外。它为决策提供了一个强大且适应性强的框架,增强了各种系统在应对各种挑战方面的有效性和灵活性。

🔬 方法详解

问题定义:论文旨在解决传统决策模型在不同任务和领域泛化能力不足的问题。现有方法,如专家系统、规划算法和强化学习,通常需要针对每个特定任务进行重新训练,这导致了高昂的开发成本和较低的效率。这些方法难以适应快速变化的环境和新的决策场景。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的泛化能力,构建一个通用的决策模型。通过预训练使LLM学习到广泛的知识和决策模式,然后通过微调使其适应特定的决策任务。这种“先学习后使用”(LTU)的策略旨在克服传统方法的局限性,提高决策模型的泛化能力和适应性。

技术框架:LTU框架包含两个主要阶段:学习阶段和使用阶段。在学习阶段,利用大规模数据集对LLM进行预训练,使其学习到通用的决策知识和模式。预训练数据可以来自不同的领域和决策场景,以增强模型的泛化能力。在使用阶段,针对特定的决策任务,使用少量标注数据对预训练的LLM进行微调,使其适应特定的任务需求。微调过程可以采用监督学习、强化学习或其他优化方法。

关键创新:LTU框架的关键创新在于将LLM的泛化能力与决策模型相结合,提出了一种新的决策模型训练范式。与传统的监督学习方法相比,LTU框架能够利用LLM的预训练知识,减少对标注数据的依赖,提高模型的泛化能力。此外,LTU框架还提供了一种通用的训练架构,可以应用于单步和多步决策任务,并扩展到游戏和机器人领域之外。

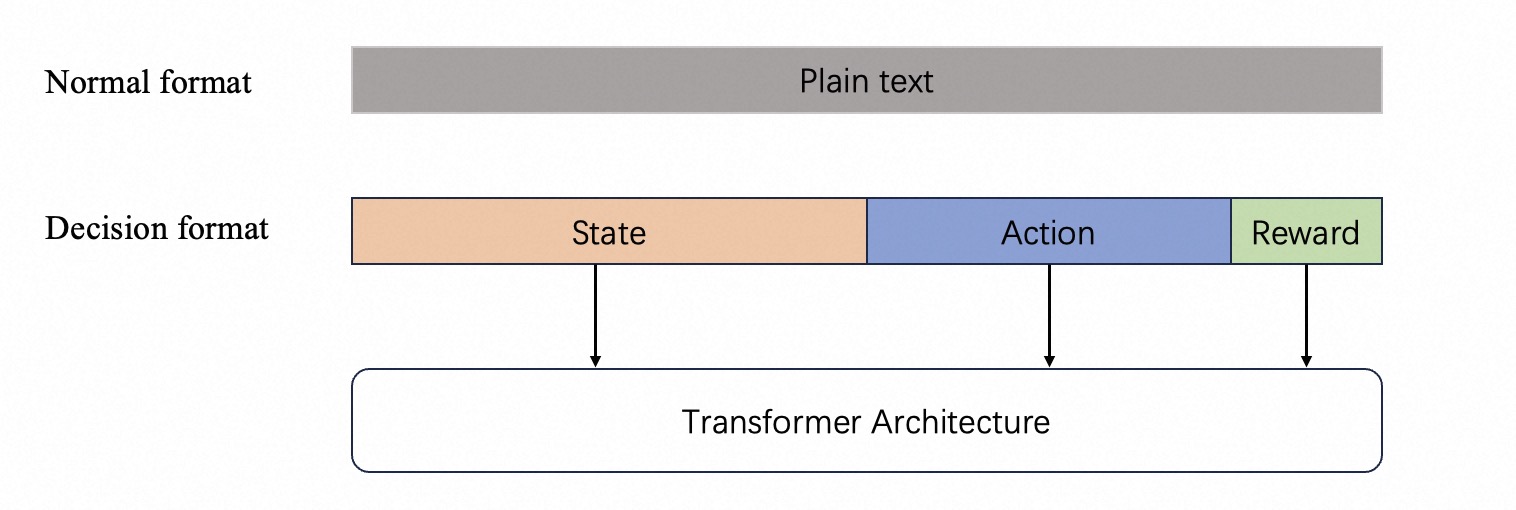

关键设计:论文中没有详细说明具体的参数设置、损失函数或网络结构等技术细节。但是,可以推断,预训练阶段可能采用标准的语言模型训练目标,如Masked Language Modeling (MLM) 或 Causal Language Modeling (CLM)。微调阶段可能采用交叉熵损失函数或强化学习中的奖励函数。具体的网络结构可能基于Transformer架构,并根据具体的决策任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LTU方法在电商广告和搜索优化等任务中,优于传统的监督学习方法。具体性能数据和提升幅度在论文中未明确给出,但强调了LTU在决策能力和泛化性方面的优势。该方法为LLM在决策领域的应用提供了新的思路和实践方案。

🎯 应用场景

该研究成果可广泛应用于电商、金融、医疗等领域的决策支持系统。例如,在电商领域,可以用于广告投放优化、搜索结果排序、推荐系统等。在金融领域,可以用于风险评估、信用评分、投资决策等。在医疗领域,可以用于疾病诊断、治疗方案制定等。该方法有望提升决策系统的智能化水平,提高决策效率和准确性。

📄 摘要(原文)

We propose a novel approach for decision making problems leveraging the generalization capabilities of large language models (LLMs). Traditional methods such as expert systems, planning algorithms, and reinforcement learning often exhibit limited generalization, typically requiring the training of new models for each unique task. In contrast, LLMs demonstrate remarkable success in generalizing across varied language tasks, inspiring a new strategy for training decision making models. Our approach, referred to as "Learning then Using" (LTU), entails a two-stage process. Initially, the \textit{learning} phase develops a robust foundational decision making model by integrating diverse knowledge from various domains and decision making contexts. The subsequent \textit{using} phase refines this foundation model for specific decision making scenarios. Distinct from other studies that employ LLMs for decision making through supervised learning, our LTU method embraces a versatile training methodology that combines broad pre-training with targeted fine-tuning. Experiments in e-commerce domains such as advertising and search optimization have shown that LTU approach outperforms traditional supervised learning regimes in decision making capabilities and generalization. The LTU approach is the first practical training architecture for both single-step and multi-step decision making tasks combined with LLMs, which can be applied beyond game and robot domains. It provides a robust and adaptable framework for decision making, enhances the effectiveness and flexibility of various systems in tackling various challenges.