HiLight: A Hierarchy-aware Light Global Model with Hierarchical Local ConTrastive Learning

作者: Zhijian Chen, Zhonghua Li, Jianxin Yang, Ye Qi

分类: cs.CL

发布日期: 2024-08-11

💡 一句话要点

提出HiLight模型,通过层级局部对比学习解决层级文本分类中的结构编码器扩展性问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 层级文本分类 对比学习 轻量级模型 结构编码器 多标签分类

📋 核心要点

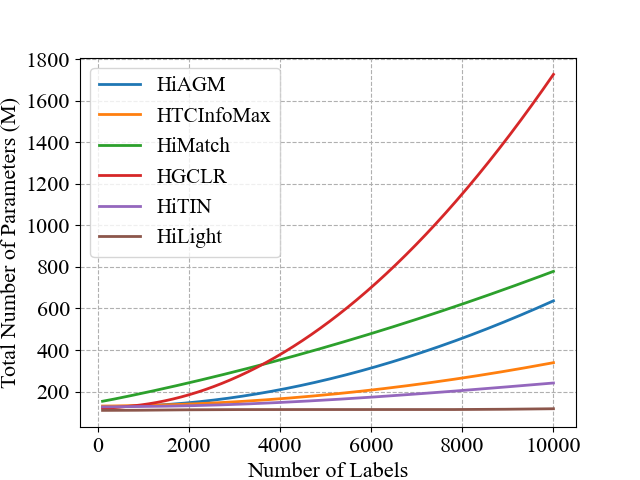

- 现有层级文本分类模型依赖结构编码器,但其参数量随分类体系增大而迅速增长,导致扩展性问题。

- HiLight模型通过层级局部对比学习(HiLCL)引入层级信息,无需复杂的结构编码器,降低了模型复杂度。

- 实验结果表明,HiLight模型在两个基准数据集上表现出色,验证了其在层级文本分类任务中的有效性。

📝 摘要(中文)

层级文本分类(HTC)是多标签分类(MLC)的一个特殊子任务,其分类体系构建为一棵树,每个样本至少分配树中的一条路径。最新的HTC模型包含三个模块:文本编码器、结构编码器和多标签分类头。其中,结构编码器旨在编码分类体系的层级结构。然而,结构编码器存在规模问题,随着分类体系规模的增加,最近的HTC模型的可学习参数迅速增长。递归正则化是另一种广泛使用的方法来引入层级信息,但它存在崩溃问题,通常通过分配一个很小的权重(例如1e-6)来缓解。在本文中,我们提出了一个层级感知的轻量级全局模型,称为HiLight,它仅由文本编码器和多标签分类头组成,并通过层级局部对比学习(HiLCL)引入层级信息。在两个基准数据集上进行了大量实验,证明了我们模型的有效性。

🔬 方法详解

问题定义:层级文本分类(HTC)任务旨在将文本样本分配到预定义的层级结构(通常是树形结构)中的一个或多个类别。现有的方法,特别是那些依赖结构编码器的模型,在处理大规模层级结构时面临参数量爆炸的问题,导致模型难以训练和部署。此外,递归正则化方法虽然可以引入层级信息,但容易出现崩溃问题,需要仔细调整权重。

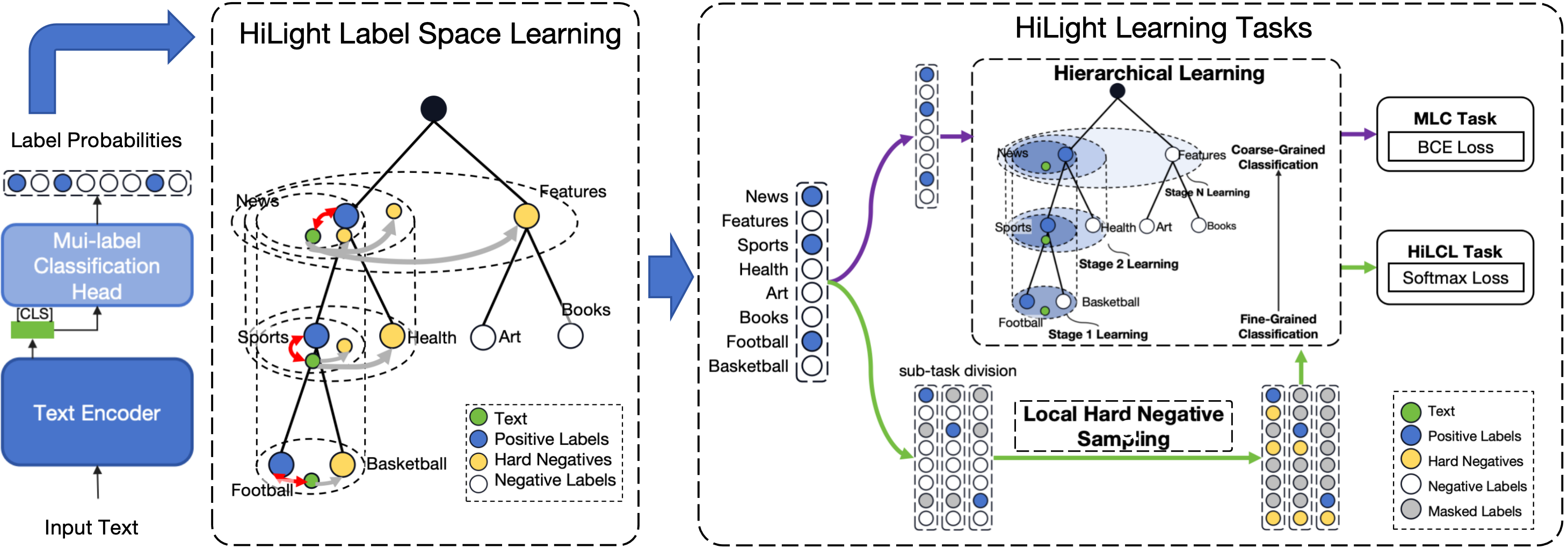

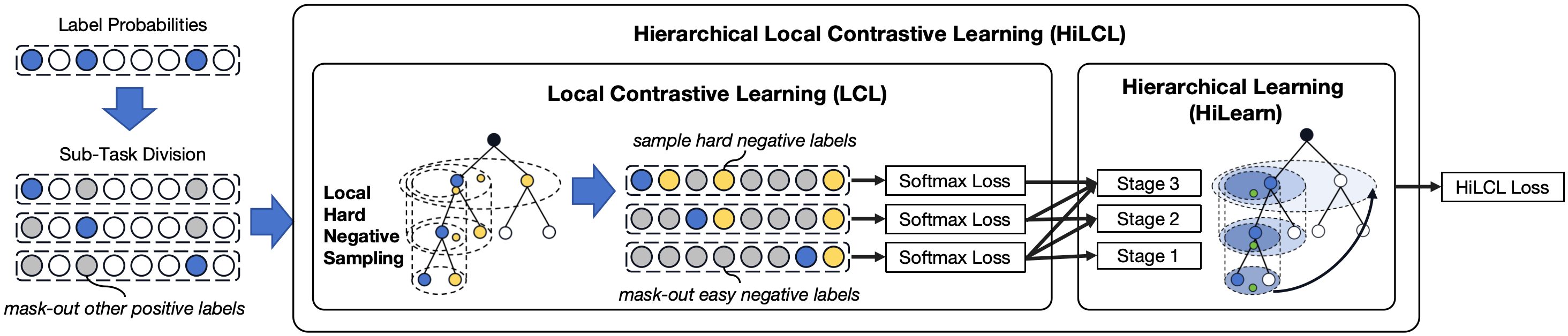

核心思路:HiLight的核心思路是通过一种新的学习任务——层级局部对比学习(HiLCL),在不引入复杂结构编码器的情况下,将层级信息融入到模型的学习过程中。HiLCL旨在学习文本表示,使得在层级结构中语义相关的类别在表示空间中更接近,而语义不相关的类别则更远离。

技术框架:HiLight模型由两个主要模块组成:文本编码器和多标签分类头。文本编码器负责将输入文本转换为向量表示。多标签分类头基于文本表示预测文本所属的类别。关键在于,HiLight并没有使用结构编码器来显式地编码层级结构,而是通过HiLCL损失函数隐式地学习层级信息。

关键创新:HiLight的关键创新在于提出了层级局部对比学习(HiLCL)方法。与传统的对比学习不同,HiLCL考虑了类别之间的层级关系,只在局部层级结构中进行对比学习。这使得模型能够更好地学习到层级结构中的语义关系,同时避免了全局对比学习带来的计算负担。

关键设计:HiLCL损失函数的设计是关键。对于每个样本,首先确定其在层级结构中的局部邻域(例如,父节点、子节点、兄弟节点)。然后,HiLCL损失函数的目标是拉近样本表示与其局部邻域内正样本表示的距离,同时推远样本表示与其局部邻域外负样本表示的距离。具体的损失函数形式可以采用InfoNCE损失等常用的对比学习损失函数。

🖼️ 关键图片

📊 实验亮点

HiLight模型在两个基准数据集上进行了评估,实验结果表明,HiLight模型在性能上与现有的最先进模型相当,同时显著减少了模型参数量。具体来说,HiLight模型在保持甚至略微提升分类精度的同时,避免了结构编码器带来的参数规模增长问题,验证了HiLCL的有效性。

🎯 应用场景

HiLight模型可应用于各种需要进行层级文本分类的场景,例如:新闻文章分类、产品分类、医学文献分类等。该模型由于其轻量级的特性,尤其适用于资源受限的场景,例如移动设备或嵌入式系统。未来,该模型可以进一步扩展到其他层级数据结构,例如知识图谱。

📄 摘要(原文)

Hierarchical text classification (HTC) is a special sub-task of multi-label classification (MLC) whose taxonomy is constructed as a tree and each sample is assigned with at least one path in the tree. Latest HTC models contain three modules: a text encoder, a structure encoder and a multi-label classification head. Specially, the structure encoder is designed to encode the hierarchy of taxonomy. However, the structure encoder has scale problem. As the taxonomy size increases, the learnable parameters of recent HTC works grow rapidly. Recursive regularization is another widely-used method to introduce hierarchical information but it has collapse problem and generally relaxed by assigning with a small weight (ie. 1e-6). In this paper, we propose a Hierarchy-aware Light Global model with Hierarchical local conTrastive learning (HiLight), a lightweight and efficient global model only consisting of a text encoder and a multi-label classification head. We propose a new learning task to introduce the hierarchical information, called Hierarchical Local Contrastive Learning (HiLCL). Extensive experiments are conducted on two benchmark datasets to demonstrate the effectiveness of our model.