Document-Level Event Extraction with Definition-Driven ICL

作者: Zhuoyuan Liu, Yilin Luo

分类: cs.CL, cs.AI, cs.CY, cs.IR

发布日期: 2024-08-10

💡 一句话要点

提出定义驱动的文档级事件抽取方法DDEE,优化LLM的prompt设计以提升事件抽取性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文档级事件抽取 大型语言模型 Prompt工程 定义驱动 数据平衡

📋 核心要点

- 现有文档级事件抽取方法在prompt设计上存在挑战,影响大型语言模型的性能。

- DDEE通过调整prompt长度、增强启发式信息清晰度,并结合数据平衡技术来优化事件抽取。

- 实验表明,该方法能够有效提升LLM在文档级事件抽取任务中的性能和泛化能力。

📝 摘要(中文)

本文提出了一种名为“定义驱动的文档级事件抽取(DDEE)”的优化策略,旨在解决大型语言模型(LLMs)在文档级事件抽取任务中面临的prompt设计挑战。通过调整prompt的长度并增强启发式信息的清晰度,显著提高了LLMs的事件抽取性能。采用数据平衡技术解决长尾效应问题,增强模型对事件类型的泛化能力。同时,优化prompt使其简洁而全面,以适应LLMs对prompt风格的敏感性。此外,引入结构化启发式方法和严格的限制条件,提高了事件和论元角色抽取的精度。这些策略不仅解决了LLMs在文档级事件抽取中的prompt工程问题,还促进了事件抽取技术的发展,为自然语言处理领域的其他任务提供了新的研究视角。

🔬 方法详解

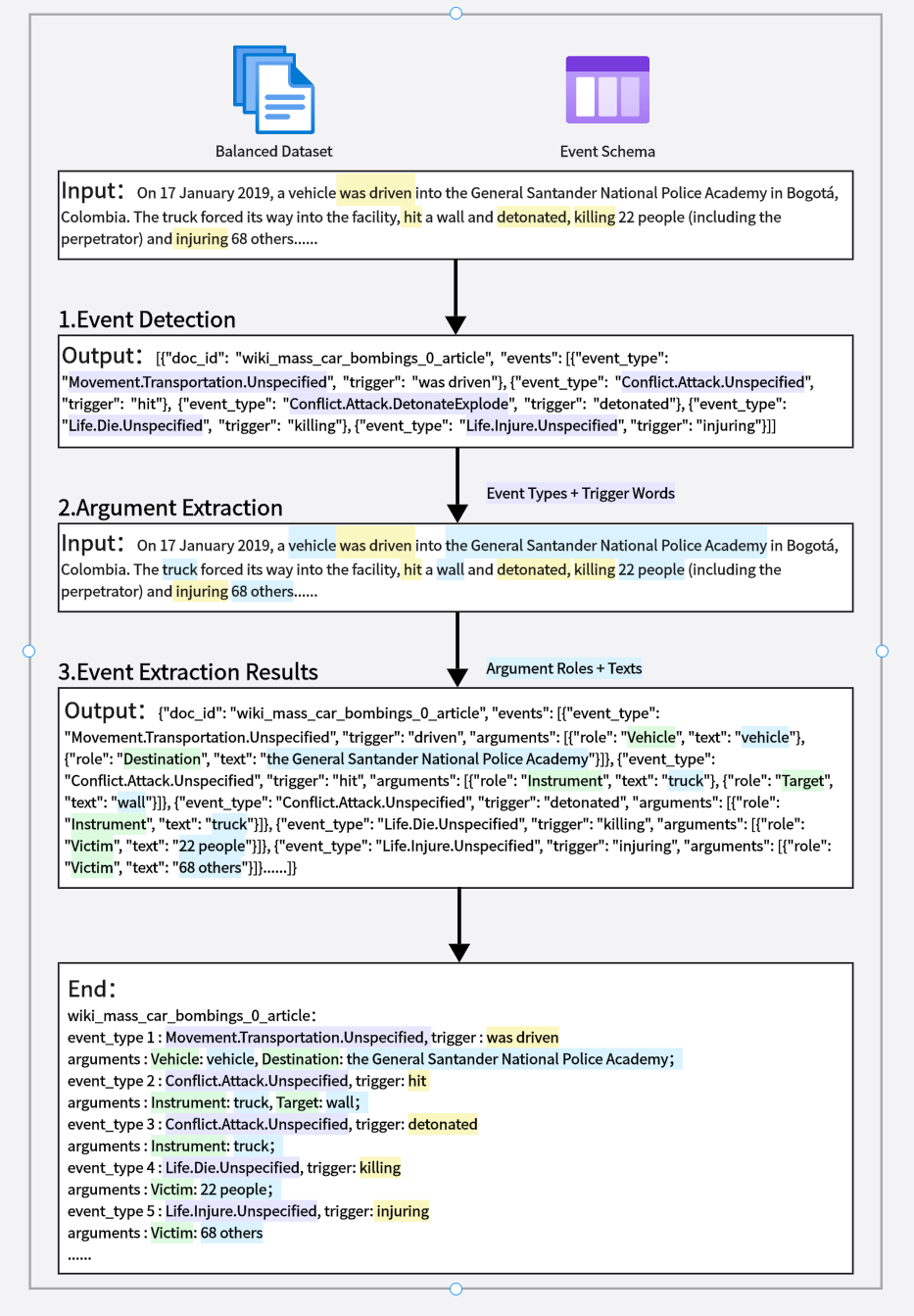

问题定义:文档级事件抽取旨在从长文档中识别事件及其参与者(论元)。现有方法在使用大型语言模型时,面临prompt设计上的挑战,例如prompt长度、启发信息不足、以及对prompt风格的敏感性,导致抽取性能受限,尤其是在处理长尾事件类型时,泛化能力不足。

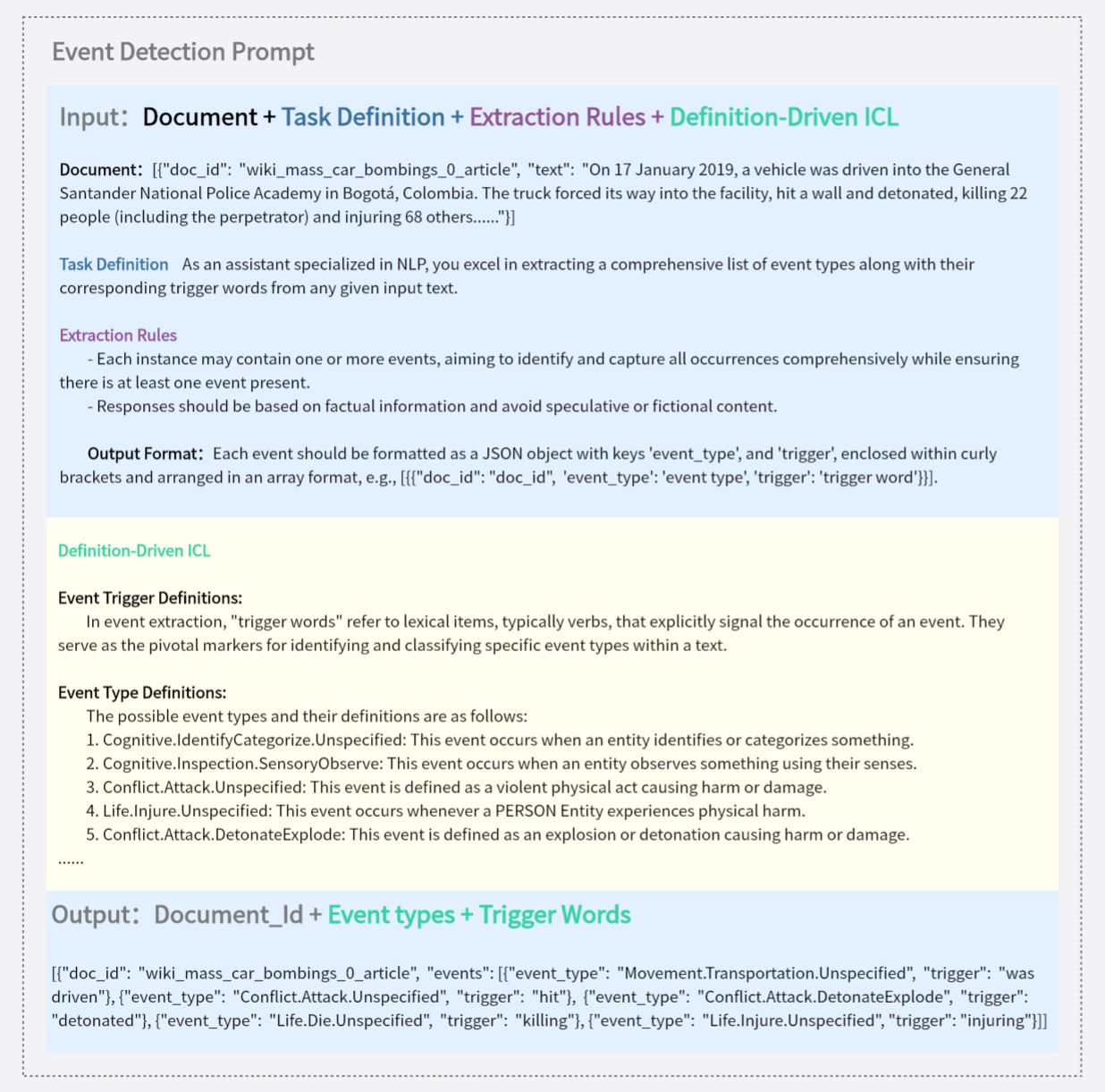

核心思路:本文的核心思路是通过精心设计的prompt来引导大型语言模型进行事件抽取。具体而言,通过“定义驱动”的方式,即在prompt中明确事件类型的定义和论元角色,从而提高模型对事件的理解和抽取精度。同时,采用数据平衡策略来缓解长尾效应,提升模型的泛化能力。

技术框架:DDEE方法主要包含以下几个关键模块:1) Prompt优化模块:负责调整prompt的长度,使其既包含足够的上下文信息,又避免冗余;增强启发式信息的清晰度,明确事件类型定义和论元角色;优化prompt风格,使其更符合LLM的偏好。2) 数据平衡模块:采用过采样或欠采样等技术,平衡不同事件类型的数据分布,缓解长尾效应。3) 结构化启发式模块:引入结构化的规则或约束,例如论元类型限制,来提高事件和论元角色抽取的精度。

关键创新:DDEE的关键创新在于其“定义驱动”的prompt设计理念。与传统的prompt工程方法不同,DDEE更加注重在prompt中明确事件类型的定义和论元角色,从而使LLM能够更好地理解事件的语义信息,提高抽取精度。此外,结合数据平衡和结构化启发式方法,进一步提升了模型的性能和泛化能力。

关键设计:在prompt优化方面,作者可能探索了不同长度的prompt,并评估了它们对性能的影响。启发式信息的设计可能包括事件类型的详细描述、论元角色的定义以及示例。数据平衡方面,可能采用了不同的采样策略,并评估了它们对长尾事件类型抽取性能的影响。结构化启发式方法可能包括论元类型约束、事件触发词约束等。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了DDEE方法的有效性,结果表明,DDEE在文档级事件抽取任务上取得了显著的性能提升。具体而言,通过优化prompt设计和采用数据平衡技术,模型在事件抽取精度和泛化能力方面均得到了提升。具体的性能数据和对比基线未知,但摘要强调了性能的显著提升。

🎯 应用场景

该研究成果可应用于新闻事件监测、金融风险分析、舆情分析等领域。通过自动抽取文档中的事件信息,可以帮助人们快速了解事件的发生、发展和影响,从而做出更明智的决策。未来,该技术还可以应用于智能客服、知识图谱构建等领域,提升自然语言处理的应用价值。

📄 摘要(原文)

In the field of Natural Language Processing (NLP), Large Language Models (LLMs) have shown great potential in document-level event extraction tasks, but existing methods face challenges in the design of prompts. To address this issue, we propose an optimization strategy called "Definition-driven Document-level Event Extraction (DDEE)." By adjusting the length of the prompt and enhancing the clarity of heuristics, we have significantly improved the event extraction performance of LLMs. We used data balancing techniques to solve the long-tail effect problem, enhancing the model's generalization ability for event types. At the same time, we refined the prompt to ensure it is both concise and comprehensive, adapting to the sensitivity of LLMs to the style of prompts. In addition, the introduction of structured heuristic methods and strict limiting conditions has improved the precision of event and argument role extraction. These strategies not only solve the prompt engineering problems of LLMs in document-level event extraction but also promote the development of event extraction technology, providing new research perspectives for other tasks in the NLP field.