Towards a Generative Approach for Emotion Detection and Reasoning

作者: Ankita Bhaumik, Tomek Strzalkowski

分类: cs.CL, cs.AI

发布日期: 2024-08-09

💡 一句话要点

提出一种基于生成式问答的大语言模型情感检测与推理方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感检测 情感推理 生成式模型 大型语言模型 零样本学习

📋 核心要点

- 现有零样本情感检测方法依赖文本蕴含模型,受限于预定义标签集,无法满足复杂应用需求。

- 提出将情感分析转化为生成式问答任务,通过生成相关背景知识逐步推理情感。

- 实验表明,该方法在情感检测数据集上有效,并提供了细粒度情感标签和解释,促进情感推理系统发展。

📝 摘要(中文)

大型语言模型(LLMs)在使用思维链(CoT)提示技术时,在数学和常识推理任务中表现出了令人印象深刻的性能。但是,通过将“让我们逐步思考”添加到输入提示中,它们能否执行情感推理?在本文中,我们研究了这个问题,并介绍了一种使用LLM进行零样本情感检测和情感推理的新方法。现有的最先进的零样本方法依赖于文本蕴含模型来为输入文本选择最合适的情感标签。我们认为,这强烈地将模型限制为一组固定的标签,这些标签可能不适合或不足以满足许多需要情感分析的应用。相反,我们建议将情感分析问题构建为一个生成式问答(QA)任务。我们的方法使用两步方法,即生成相关的上下文或背景知识,以逐步回答情感检测问题。我们的论文是第一项使用生成方法来共同解决文本的情感检测和情感推理任务的工作。我们在两个流行的情感检测数据集上评估了我们的方法,并发布了细粒度的情感标签和解释,以进一步训练和微调情感推理系统。

🔬 方法详解

问题定义:现有零样本情感检测方法依赖于文本蕴含模型,其主要痛点在于情感标签的选择被限制在一组固定的预定义标签中。这种限制使得模型难以捕捉文本中细微的情感变化,并且无法适应需要更灵活情感表达的应用场景。因此,如何突破固定标签的限制,实现更准确、更灵活的情感检测是本文要解决的核心问题。

核心思路:本文的核心思路是将情感分析问题转化为一个生成式问答(QA)任务。通过这种方式,模型不再需要从预定义的标签集中选择答案,而是可以生成自由形式的文本来表达情感。这种方法能够更灵活地捕捉文本中的情感细微差别,并提供更丰富的解释。

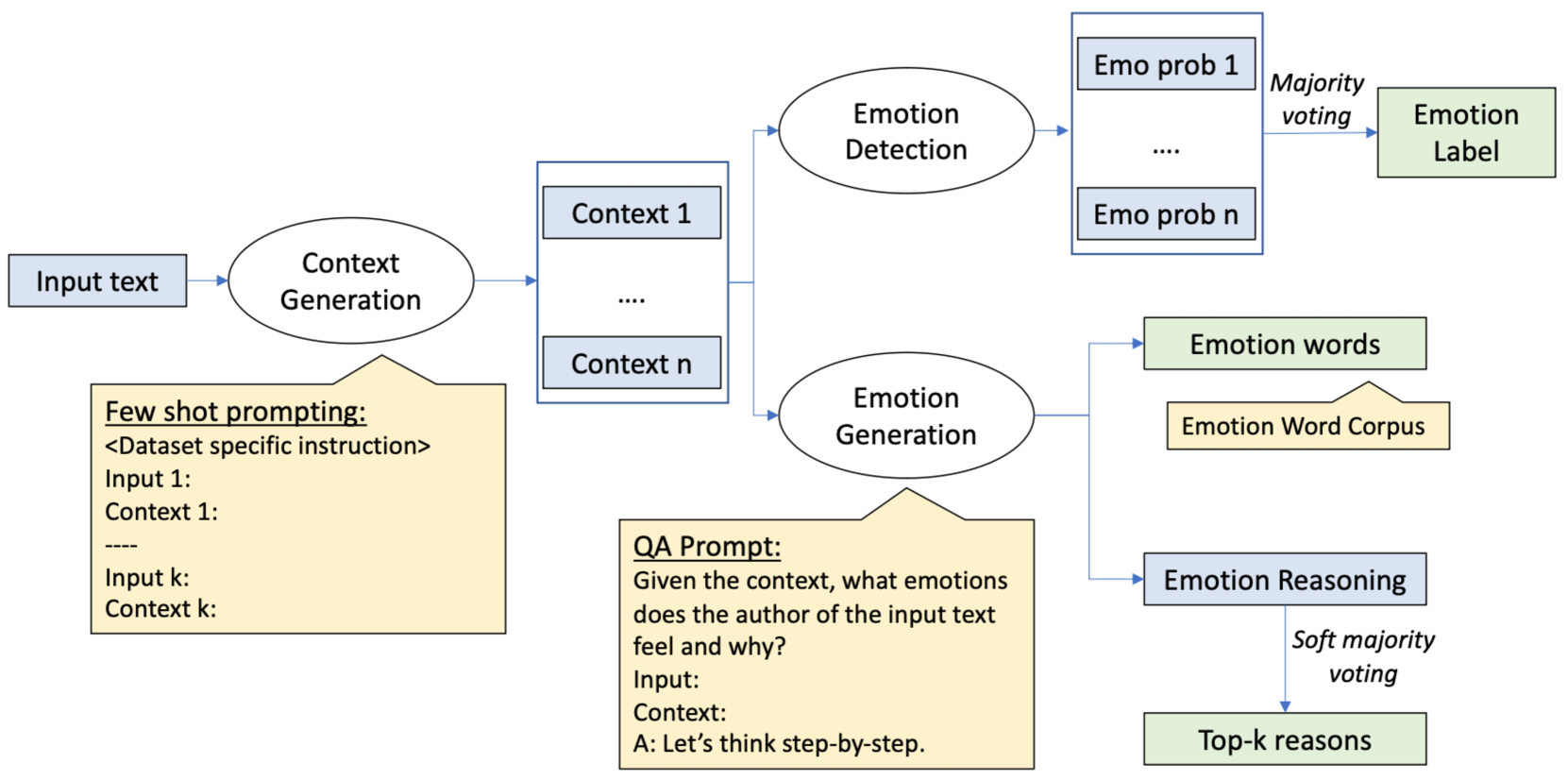

技术框架:该方法采用两步流程。第一步,针对输入文本,模型生成相关的上下文或背景知识。这一步旨在为情感推理提供必要的支持信息。第二步,模型利用生成的上下文知识,逐步回答情感检测问题。整个过程类似于人类进行情感分析时的思考过程,即首先理解文本的背景,然后推断出文本的情感。

关键创新:该方法最重要的技术创新点在于将情感分析任务从传统的分类或文本蕴含任务转化为生成式问答任务。这种转变使得模型能够摆脱固定标签的束缚,从而实现更灵活、更准确的情感检测。此外,该方法还通过生成上下文知识来增强情感推理能力,这与现有方法有本质区别。

关键设计:该论文使用大型语言模型(LLMs)作为生成器,利用其强大的文本生成能力。具体的参数设置和网络结构取决于所使用的LLM。关键在于如何设计提示(prompt)来引导LLM生成相关的上下文知识和情感解释。此外,损失函数的设计也需要考虑如何鼓励模型生成高质量的上下文和准确的情感表达。具体细节在论文中可能没有详细说明,需要参考相关LLM的文献。

🖼️ 关键图片

📊 实验亮点

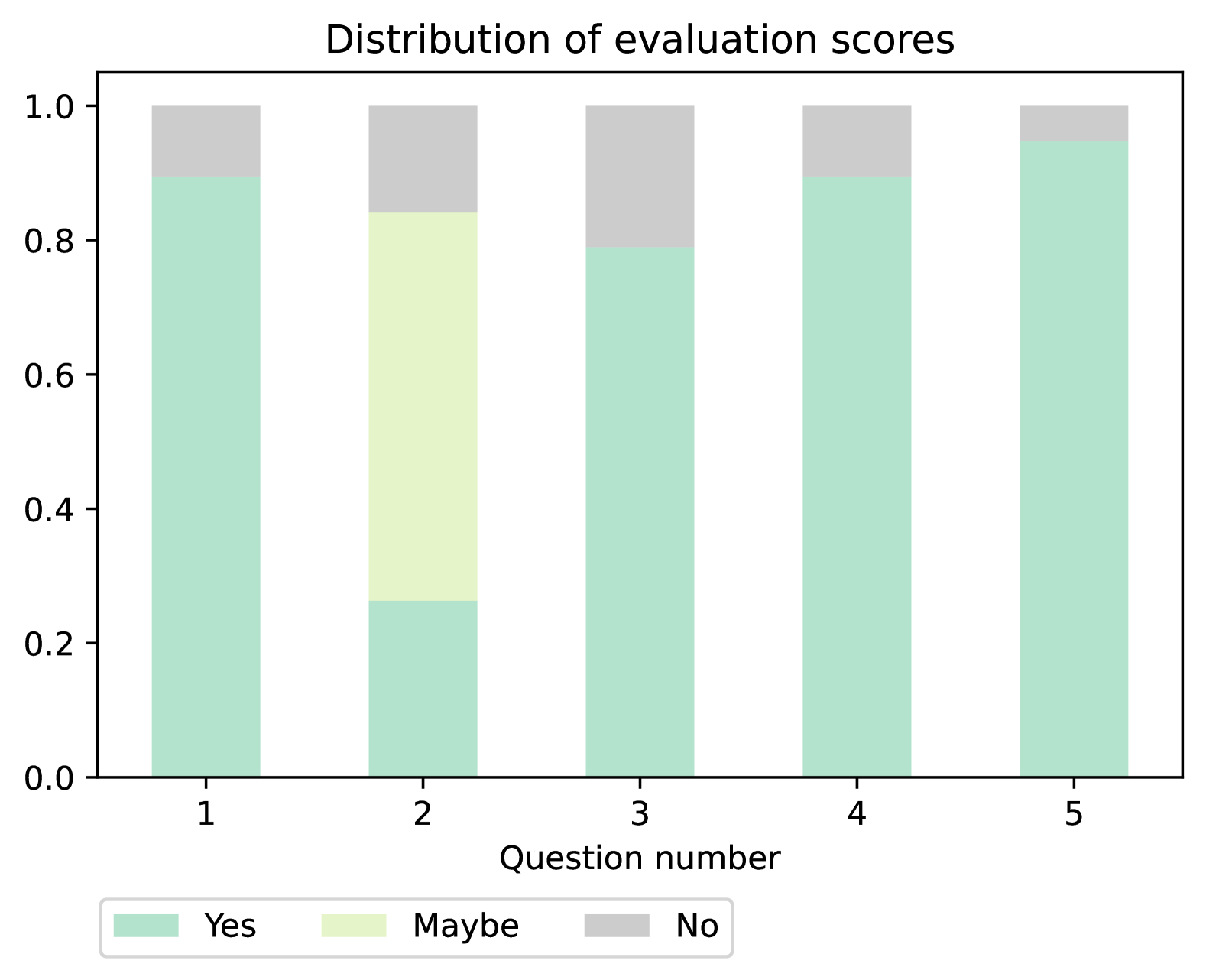

该论文在两个情感检测数据集上进行了评估,但摘要中没有提供具体的性能数据和对比基线。论文强调其贡献在于提出了生成式情感检测方法,并发布了细粒度的情感标签和解释,为进一步研究情感推理系统提供了资源。具体的性能提升幅度未知,需要查阅论文全文。

🎯 应用场景

该研究成果可应用于情感聊天机器人、舆情监控、心理健康评估、智能客服等领域。通过更准确地理解用户的情感,可以提升人机交互的自然性和有效性,为用户提供更个性化的服务。未来,该方法有望应用于更复杂的情感分析场景,例如多模态情感分析和情感驱动的决策支持系统。

📄 摘要(原文)

Large language models (LLMs) have demonstrated impressive performance in mathematical and commonsense reasoning tasks using chain-of-thought (CoT) prompting techniques. But can they perform emotional reasoning by concatenating `Let's think step-by-step' to the input prompt? In this paper we investigate this question along with introducing a novel approach to zero-shot emotion detection and emotional reasoning using LLMs. Existing state of the art zero-shot approaches rely on textual entailment models to choose the most appropriate emotion label for an input text. We argue that this strongly restricts the model to a fixed set of labels which may not be suitable or sufficient for many applications where emotion analysis is required. Instead, we propose framing the problem of emotion analysis as a generative question-answering (QA) task. Our approach uses a two step methodology of generating relevant context or background knowledge to answer the emotion detection question step-by-step. Our paper is the first work on using a generative approach to jointly address the tasks of emotion detection and emotional reasoning for texts. We evaluate our approach on two popular emotion detection datasets and also release the fine-grained emotion labels and explanations for further training and fine-tuning of emotional reasoning systems.