Mitigating Hallucinations in Large Vision-Language Models (LVLMs) via Language-Contrastive Decoding (LCD)

作者: Avshalom Manevich, Reut Tsarfaty

分类: cs.CL, cs.AI, cs.CV

发布日期: 2024-08-06

💡 一句话要点

提出语言对比解码(LCD)算法,有效缓解大型视觉语言模型(LVLM)中的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 幻觉缓解 语言对比解码 大型语言模型 图像描述

📋 核心要点

- LVLM依赖文本线索易产生对象幻觉,现有方法缺乏有效的缓解策略。

- 提出语言对比解码(LCD)算法,利用LLM的置信度调整LVLM输出,减少幻觉。

- 实验表明,LCD在COCO数据集上显著提升了LVLM的性能,且易于部署。

📝 摘要(中文)

大型视觉语言模型(LVLM)是大型语言模型(LLM)的扩展,能够处理图像和文本输入,从而扩展了人工智能的能力。然而,由于LVLM依赖于文本线索和学习到的对象共现偏差,因此它们在对象幻觉方面存在困难。虽然大多数研究都量化了这些幻觉,但缓解策略仍然不足。本研究引入了一种语言对比解码(LCD)算法,该算法基于LLM分布置信度水平调整LVLM输出,从而有效减少对象幻觉。我们证明了LCD在领先的LVLM中的优势,在COCO验证集上,POPE F1分数提高了高达4%,CHAIR分数降低了高达36%,同时也提高了字幕质量分数。我们的方法有效地改进了LVLM,无需复杂的后处理或重新训练,并且易于应用于不同的模型。我们的发现强调了进一步探索LVLM特定解码算法的潜力。

🔬 方法详解

问题定义:大型视觉语言模型(LVLM)在生成描述图像的文本时,容易产生“幻觉”,即生成的内容与图像不符,例如描述图像中不存在的物体。现有方法主要集中在量化这些幻觉,而缺乏有效的缓解策略。LVLM过度依赖文本先验知识和对象共现偏差是导致幻觉的主要原因。

核心思路:论文的核心思路是利用大型语言模型(LLM)的语言建模能力,通过对比不同文本生成的置信度,来调整LVLM的输出,从而抑制幻觉。具体来说,LCD算法会鼓励LVLM生成更符合LLM语言模型分布的文本,从而减少对图像中不存在物体的描述。

技术框架:LCD算法可以作为一个后处理模块,应用于现有的LVLM。其主要流程如下:1) LVLM生成初始文本;2) LCD算法基于LLM的概率分布,对初始文本进行调整;3) 输出调整后的文本。该框架不需要重新训练LVLM,易于集成到不同的模型中。

关键创新:LCD算法的关键创新在于利用LLM的语言建模能力来指导LVLM的文本生成过程。与传统的解码方法不同,LCD算法不仅仅考虑了视觉信息,还考虑了语言模型的先验知识,从而能够更有效地抑制幻觉。这种语言对比的思想可以扩展到其他多模态任务中。

关键设计:LCD算法的关键设计在于如何计算LLM的置信度。论文中使用了LLM生成文本的概率作为置信度指标。具体来说,对于LVLM生成的每个token,LCD算法会计算LLM生成该token的概率,并根据该概率调整LVLM的输出。此外,论文还探索了不同的对比策略,例如对比不同文本生成的概率,以进一步提高性能。

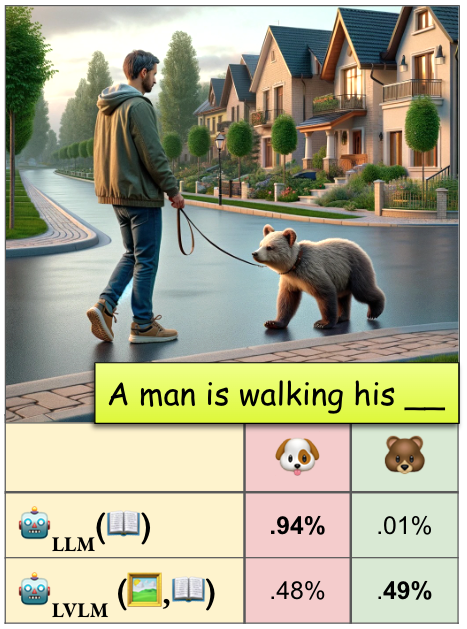

🖼️ 关键图片

📊 实验亮点

实验结果表明,LCD算法在COCO验证集上显著提升了LVLM的性能。具体来说,POPE F1分数提高了高达4%,CHAIR分数降低了高达36%。同时,LCD算法还提高了字幕质量分数,表明其在减少幻觉的同时,也保持了文本的流畅性和准确性。这些结果表明LCD算法是一种有效的LVLM幻觉缓解方法。

🎯 应用场景

该研究成果可广泛应用于需要高质量图像描述的场景,例如:智能客服、图像搜索引擎、辅助视觉障碍人士等。通过减少LVLM中的幻觉,可以提高这些应用的可信度和实用性。未来,该方法有望扩展到其他多模态任务,例如视频描述、视觉问答等。

📄 摘要(原文)

Large Vision-Language Models (LVLMs) are an extension of Large Language Models (LLMs) that facilitate processing both image and text inputs, expanding AI capabilities. However, LVLMs struggle with object hallucinations due to their reliance on text cues and learned object co-occurrence biases. While most research quantifies these hallucinations, mitigation strategies are still lacking. Our study introduces a Language Contrastive Decoding (LCD) algorithm that adjusts LVLM outputs based on LLM distribution confidence levels, effectively reducing object hallucinations. We demonstrate the advantages of LCD in leading LVLMs, showing up to %4 improvement in POPE F1 scores and up to %36 reduction in CHAIR scores on the COCO validation set, while also improving captioning quality scores. Our method effectively improves LVLMs without needing complex post-processing or retraining, and is easily applicable to different models. Our findings highlight the potential of further exploration of LVLM-specific decoding algorithms.