Citekit: A Modular Toolkit for Large Language Model Citation Generation

作者: Jiajun Shen, Tong Zhou, Yubo Chen, Kang Liu

分类: cs.CL, cs.AI

发布日期: 2024-08-06 (更新: 2024-12-17)

备注: 7 pages, 14 figures

🔗 代码/项目: GITHUB

💡 一句话要点

Citekit:一个模块化工具包,用于大语言模型引文生成。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 引文生成 问答系统 模块化工具包 可验证性 知识检索 评估框架

📋 核心要点

- 现有大语言模型引文生成方法缺乏统一框架,难以复现和公平比较,阻碍了该领域的发展。

- Citekit提供了一个模块化工具包,支持构建引文生成pipeline,方便评估现有方法和开发新方法。

- 实验表明,Citekit可以有效评估不同模块在答案准确性和引文质量方面的作用,并提出了一种新的self-RAG方法。

📝 摘要(中文)

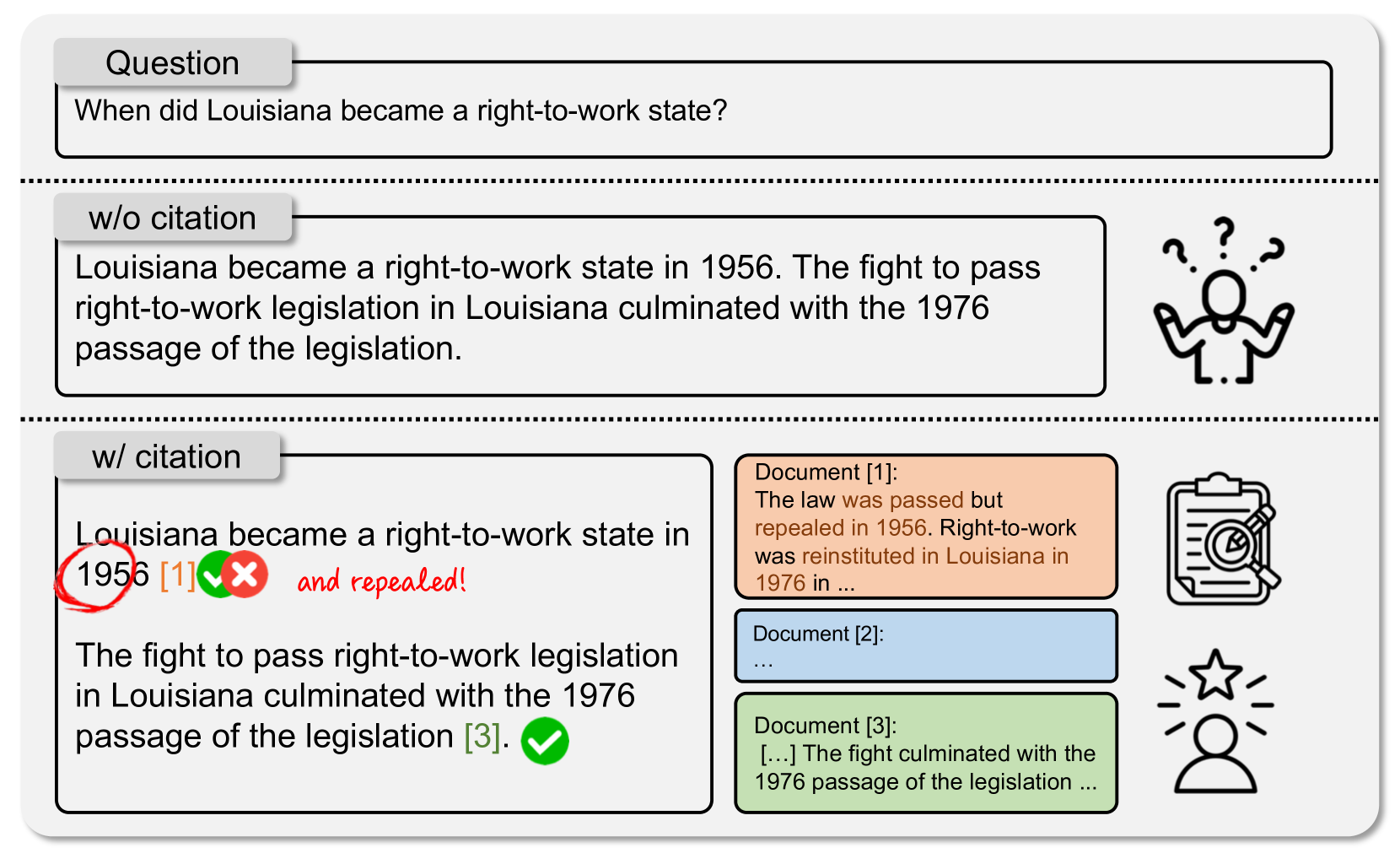

为了增强大语言模型(LLMs)在问答(QA)任务中生成答案的可验证性,一种新兴范式是让LLMs在生成答案时利用外部参考并提供引文。然而,目前缺乏统一的框架来标准化和公平地比较不同的引文生成方法,导致不同方法的复现和全面评估存在困难。为了解决上述问题,我们推出了Citekit,一个开源和模块化的工具包,旨在促进现有引文生成方法的实现和评估,同时促进新方法的开发,以提高LLM输出中引文的质量。该工具具有高度可扩展性,允许用户利用4个主要模块和14个组件来构建pipeline,评估现有方法或创新设计。我们使用两个最先进的LLM和11个引文生成基线进行的实验表明,不同模块在提高答案准确性和引文质量方面具有不同的优势,以及提高粒度的挑战。基于我们对组件有效性的分析,我们提出了一种新方法,self-RAG snippet,获得了平衡的答案准确性和引文质量。Citekit已在https://github.com/SjJ1017/Citekit上发布。

🔬 方法详解

问题定义:论文旨在解决大语言模型在问答任务中生成引文时缺乏统一评估标准和复现困难的问题。现有方法难以公平比较,且缺乏模块化设计,不利于新方法开发和性能提升。

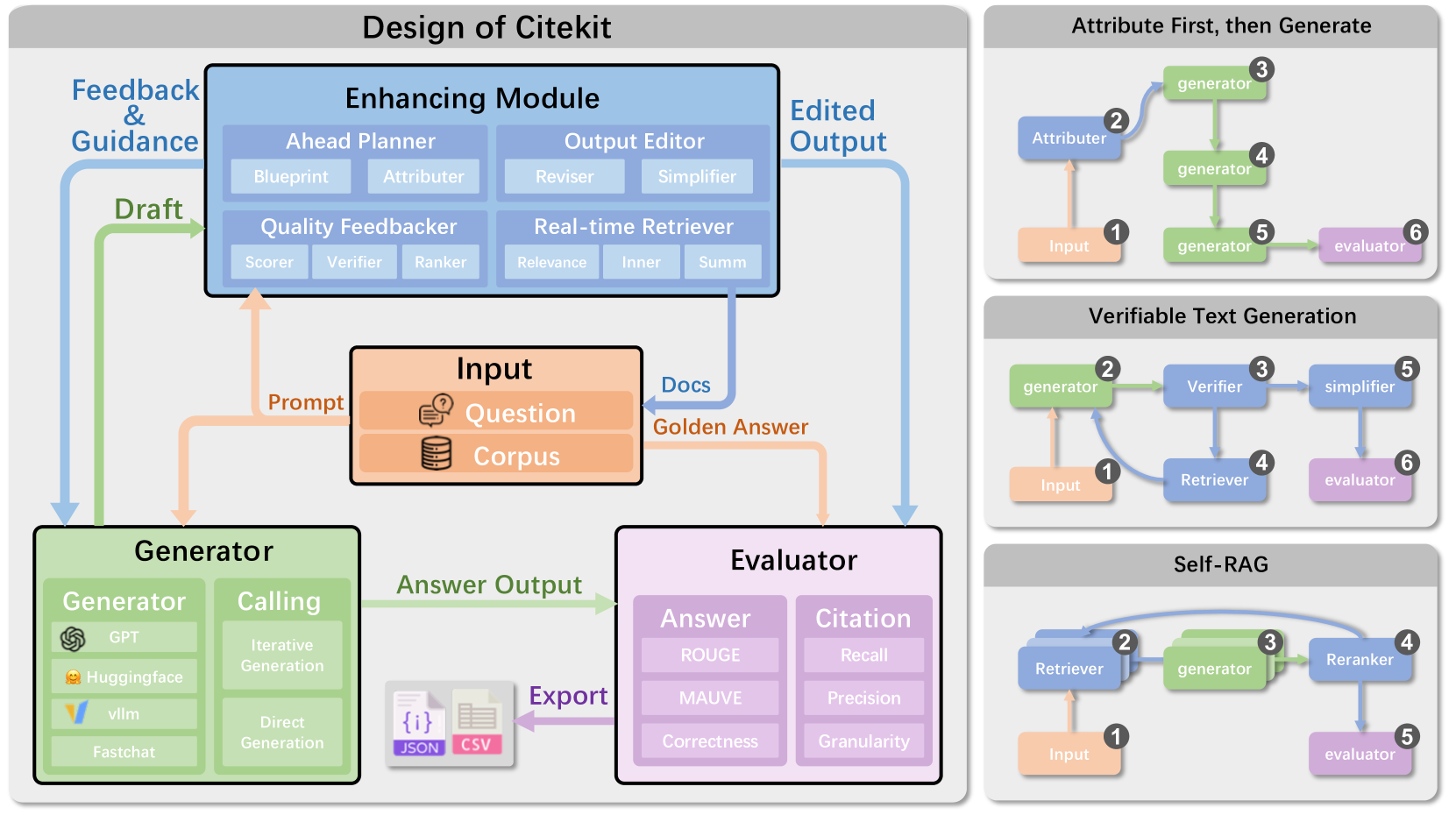

核心思路:论文的核心思路是构建一个模块化的工具包Citekit,将引文生成过程分解为多个可插拔的模块和组件,用户可以灵活组合这些模块和组件,构建自定义的引文生成pipeline,并进行统一的评估。

技术框架:Citekit包含四个主要模块:数据处理模块、检索模块、生成模块和评估模块。数据处理模块负责处理输入数据,检索模块负责从外部知识库中检索相关文档,生成模块负责生成答案和引文,评估模块负责评估答案的准确性和引文的质量。每个模块包含多个可选择的组件,例如不同的检索算法、生成模型和评估指标。用户可以根据需要选择不同的组件来构建pipeline。

关键创新:Citekit的关键创新在于其模块化和可扩展的设计。它提供了一个统一的框架,方便研究人员复现和比较不同的引文生成方法,并促进新方法的开发。此外,Citekit还提供了一套全面的评估指标,可以更全面地评估引文生成方法的性能。

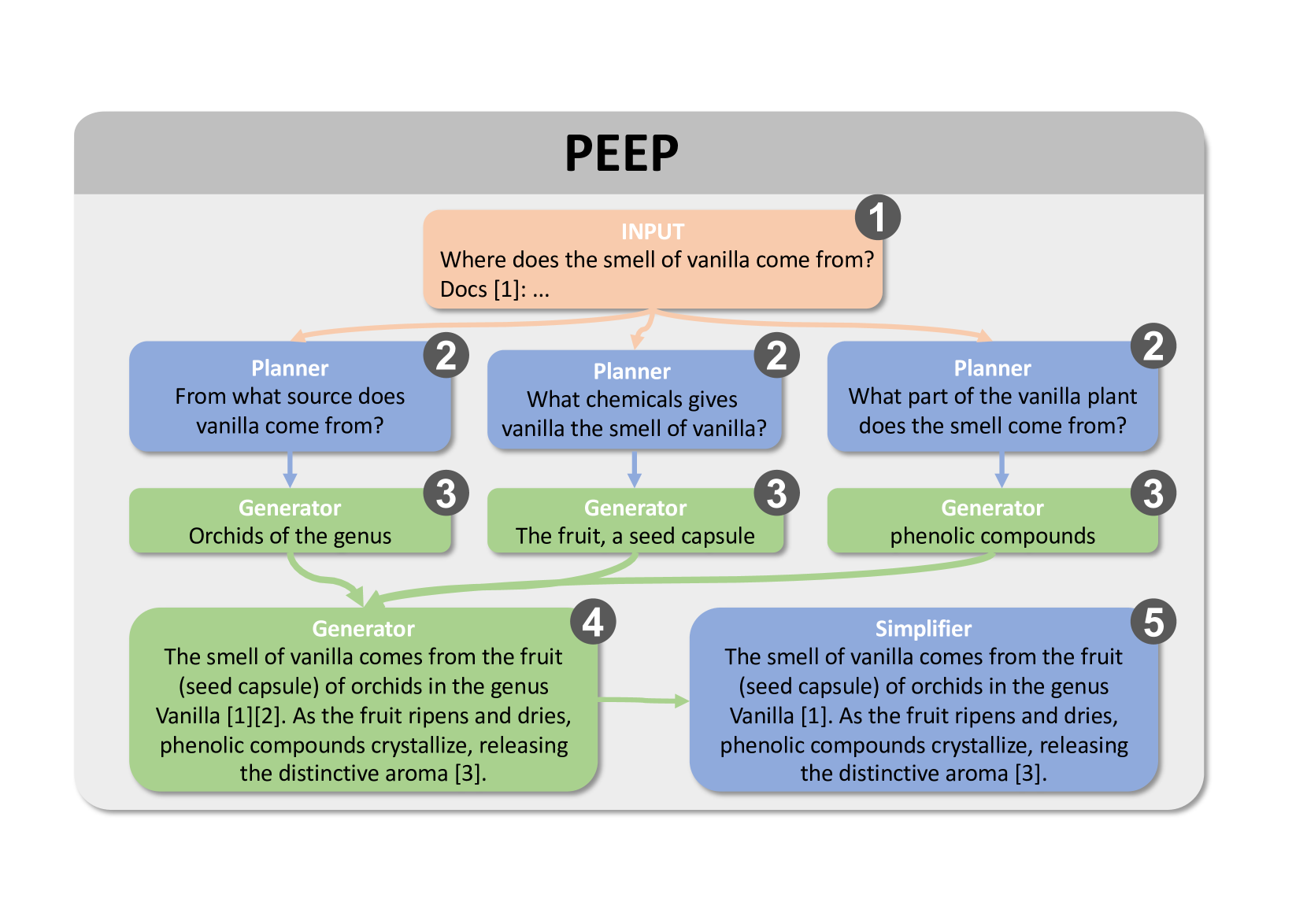

关键设计:Citekit的关键设计包括:1) 模块化架构,方便用户自定义pipeline;2) 可扩展的组件库,支持不同的检索算法、生成模型和评估指标;3) 统一的评估框架,方便用户比较不同方法的性能;4) 提供了一个新的self-RAG snippet方法,用于平衡答案准确性和引文质量,具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Citekit可以有效评估不同模块在答案准确性和引文质量方面的作用。通过对组件有效性的分析,论文提出了一种新的self-RAG snippet方法,在答案准确性和引文质量之间取得了较好的平衡。具体性能数据和对比基线未知。

🎯 应用场景

Citekit可应用于各种需要大语言模型生成引文的场景,例如自动问答系统、知识库构建、学术论文写作辅助等。该工具包可以帮助研究人员和开发人员更方便地开发和评估引文生成方法,提高大语言模型生成答案的可信度和可靠性,并促进相关技术的进步。

📄 摘要(原文)

Enabling Large Language Models (LLMs) to generate citations in Question-Answering (QA) tasks is an emerging paradigm aimed at enhancing the verifiability of their responses when LLMs are utilizing external references to generate an answer. However, there is currently no unified framework to standardize and fairly compare different citation generation methods, leading to difficulties in reproducing different methods and a comprehensive assessment. To cope with the problems above, we introduce \name, an open-source and modular toolkit designed to facilitate the implementation and evaluation of existing citation generation methods, while also fostering the development of new approaches to improve citation quality in LLM outputs. This tool is highly extensible, allowing users to utilize 4 main modules and 14 components to construct a pipeline, evaluating an existing method or innovative designs. Our experiments with two state-of-the-art LLMs and 11 citation generation baselines demonstrate varying strengths of different modules in answer accuracy and citation quality improvement, as well as the challenge of enhancing granularity. Based on our analysis of the effectiveness of components, we propose a new method, self-RAG \snippet, obtaining a balanced answer accuracy and citation quality. Citekit is released at https://github.com/SjJ1017/Citekit.