Evaluating the Translation Performance of Large Language Models Based on Euas-20

作者: Yan Huang, Wei Liu

分类: cs.CL, cs.AI

发布日期: 2024-08-06

备注: 15 pages, 8 figures

💡 一句话要点

构建Euas-20数据集,评估大型语言模型在机器翻译任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器翻译 大型语言模型 数据集构建 性能评估 自然语言处理

📋 核心要点

- 现有机器翻译方法在处理复杂语境和低资源语言时仍面临挑战,大型语言模型虽有进步,但仍需系统评估。

- 论文构建Euas-20数据集,旨在全面评估大型语言模型在不同语言和预训练数据影响下的翻译能力。

- 该数据集为研究人员和开发者提供了一个基准,用于分析和改进大型语言模型的翻译性能。

📝 摘要(中文)

近年来,随着深度学习技术的快速发展,BERT和GPT等大型语言模型(LLMs)在自然语言处理任务中取得了突破性成果。机器翻译(MT)作为自然语言处理的核心任务之一,也受益于大型语言模型的发展,实现了质的飞跃。尽管大型语言模型在翻译性能方面取得了显著进展,但机器翻译仍然面临许多挑战。因此,本文构建了Euas-20数据集,旨在评估大型语言模型在翻译任务中的性能,不同语言之间的翻译能力,以及预训练数据对LLM翻译能力的影响,为研究人员和开发人员提供参考。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在机器翻译任务中的性能评估问题。现有方法缺乏一个专门针对大型语言模型翻译能力的评估数据集,无法全面了解模型在不同语言和预训练数据影响下的表现。

核心思路:论文的核心思路是构建一个高质量的、多语言的翻译数据集Euas-20,用于系统地评估大型语言模型在翻译任务中的性能。通过该数据集,可以分析模型在不同语言对上的翻译能力,以及预训练数据对翻译效果的影响。

技术框架:论文主要工作集中在数据集的构建上,没有涉及具体的模型架构或训练流程。数据集Euas-20的设计考虑了多种语言,并可能包含不同难度级别的翻译样本,以全面评估模型的翻译能力。

关键创新:该论文的关键创新在于构建了一个新的、专门用于评估大型语言模型翻译能力的数据集Euas-20。这个数据集的特点是针对大型语言模型设计,可能包含特定类型的翻译样本,以更好地反映模型的优势和不足。

关键设计:由于论文主要关注数据集构建,因此没有详细的网络结构、损失函数等设计细节。数据集Euas-20的具体构成(例如,包含哪些语言对,样本数量,样本难度分布等)是关键设计,但摘要中未提及。

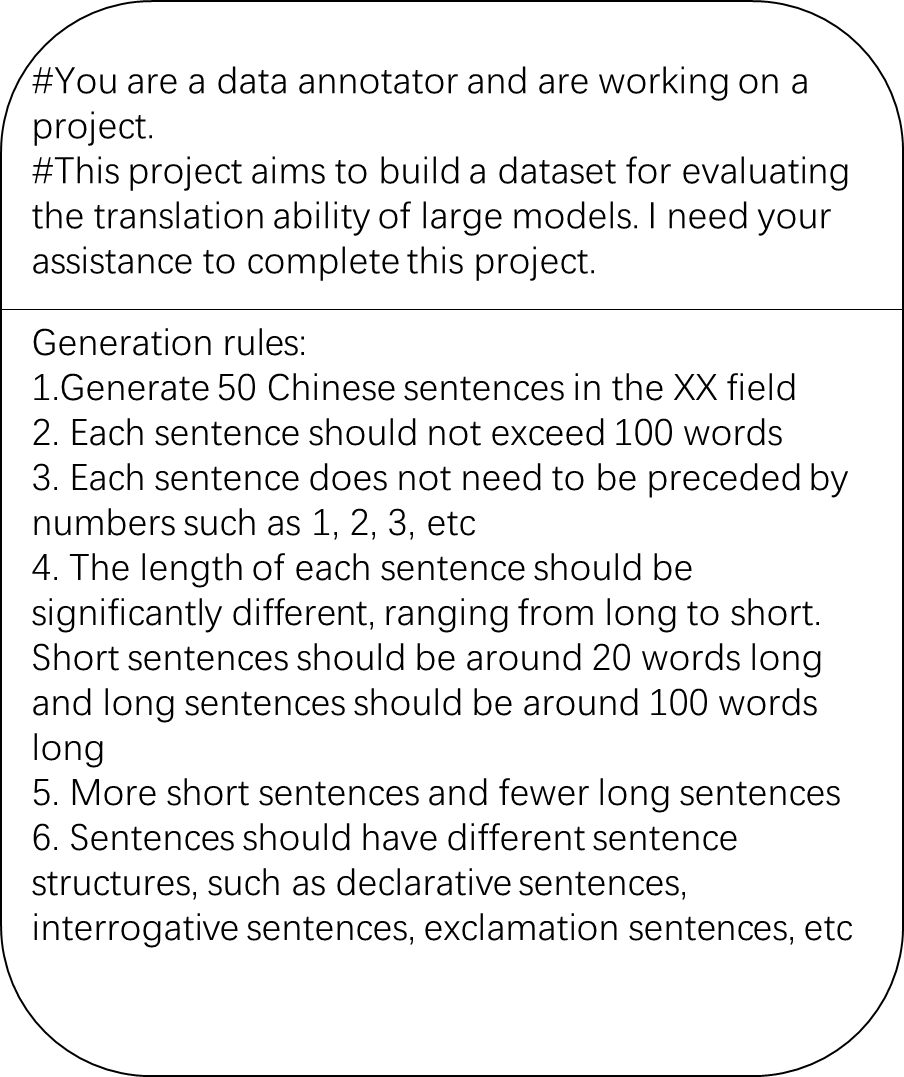

🖼️ 关键图片

📊 实验亮点

论文的主要亮点在于构建了Euas-20数据集,为评估大型语言模型的翻译性能提供了一个新的基准。摘要中没有提供具体的实验结果或性能数据,但该数据集的发布本身就是一个重要的贡献,可以促进相关领域的研究。

🎯 应用场景

该研究成果可应用于机器翻译系统的开发与评估,帮助研究人员和开发者更好地了解大型语言模型的翻译能力,并针对性地改进模型。此外,该数据集还可以用于评估不同预训练数据对翻译性能的影响,指导预训练数据的选择和优化。未来,基于该数据集的研究可以推动机器翻译技术的进一步发展,提高翻译质量和效率。

📄 摘要(原文)

In recent years, with the rapid development of deep learning technology, large language models (LLMs) such as BERT and GPT have achieved breakthrough results in natural language processing tasks. Machine translation (MT), as one of the core tasks of natural language processing, has also benefited from the development of large language models and achieved a qualitative leap. Despite the significant progress in translation performance achieved by large language models, machine translation still faces many challenges. Therefore, in this paper, we construct the dataset Euas-20 to evaluate the performance of large language models on translation tasks, the translation ability on different languages, and the effect of pre-training data on the translation ability of LLMs for researchers and developers.