UnifiedMLLM: Enabling Unified Representation for Multi-modal Multi-tasks With Large Language Model

作者: Zhaowei Li, Wei Wang, YiQing Cai, Xu Qi, Pengyu Wang, Dong Zhang, Hang Song, Botian Jiang, Zhida Huang, Tao Wang

分类: cs.CL

发布日期: 2024-08-05

🔗 代码/项目: GITHUB

💡 一句话要点

提出UnifiedMLLM以解决多模态任务统一表示问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 统一表示 任务路由 推理能力 专家模型

📋 核心要点

- 现有的多模态大语言模型通常针对特定任务训练,缺乏统一的表示方式,限制了其广泛适用性。

- UnifiedMLLM通过统一表示处理多种任务,能够理解用户意图并生成多种输出,提升了模型的灵活性和适应性。

- 实验结果显示,UnifiedMLLM在多项任务上表现优于现有方法,展现出卓越的可扩展性和通用性。

📝 摘要(中文)

近年来,多模态大语言模型(MLLMs)在理解和推理多样任务方面取得了显著进展。然而,这些模型通常针对特定任务进行训练,并依赖于任务特定的输入输出格式,限制了其在更广泛任务中的适用性。为此,本文提出了UnifiedMLLM,一个旨在通过统一表示来处理不同多模态任务的综合模型。该模型能够理解用户指令的隐含意图并进行推理,除了生成文本响应外,还输出任务标记和基础标记,指示任务类型和粒度。这些输出通过任务路由器引导至特定的专家模型以完成任务。我们构建了一个任务特定数据集和一个包含复杂场景的10万多任务数据集,采用三阶段训练策略,赋予模型强大的推理和任务处理能力,同时保持其泛化能力和知识储备。实验结果表明,我们的统一表示方法在多项任务中表现优异,超越了现有方法。

🔬 方法详解

问题定义:本文旨在解决多模态大语言模型在处理不同任务时缺乏统一表示的问题。现有方法通常依赖于特定任务的输入输出格式,限制了模型的适用范围和灵活性。

核心思路:UnifiedMLLM的核心思想是通过统一的表示方式来处理多种多模态任务,增强模型对用户指令的理解和推理能力。该设计旨在提高模型的通用性,使其能够适应不同的任务需求。

技术框架:UnifiedMLLM的整体架构包括多个主要模块:任务标记生成、基础标记生成、任务路由器和专家模型。模型首先生成任务标记和基础标记,然后通过任务路由器将这些信息引导至相应的专家模型进行任务完成。

关键创新:本文的主要创新在于提出了一种统一的任务表示方法,使得模型能够同时处理多种任务类型,显著提高了模型的灵活性和适应性。这一方法与现有的任务特定模型形成了鲜明对比。

关键设计:在训练过程中,UnifiedMLLM采用了三阶段训练策略,构建了一个任务特定数据集和一个包含复杂场景的10万多任务数据集。模型的损失函数和网络结构经过精心设计,以确保其推理能力和任务处理能力的同时保持泛化能力。

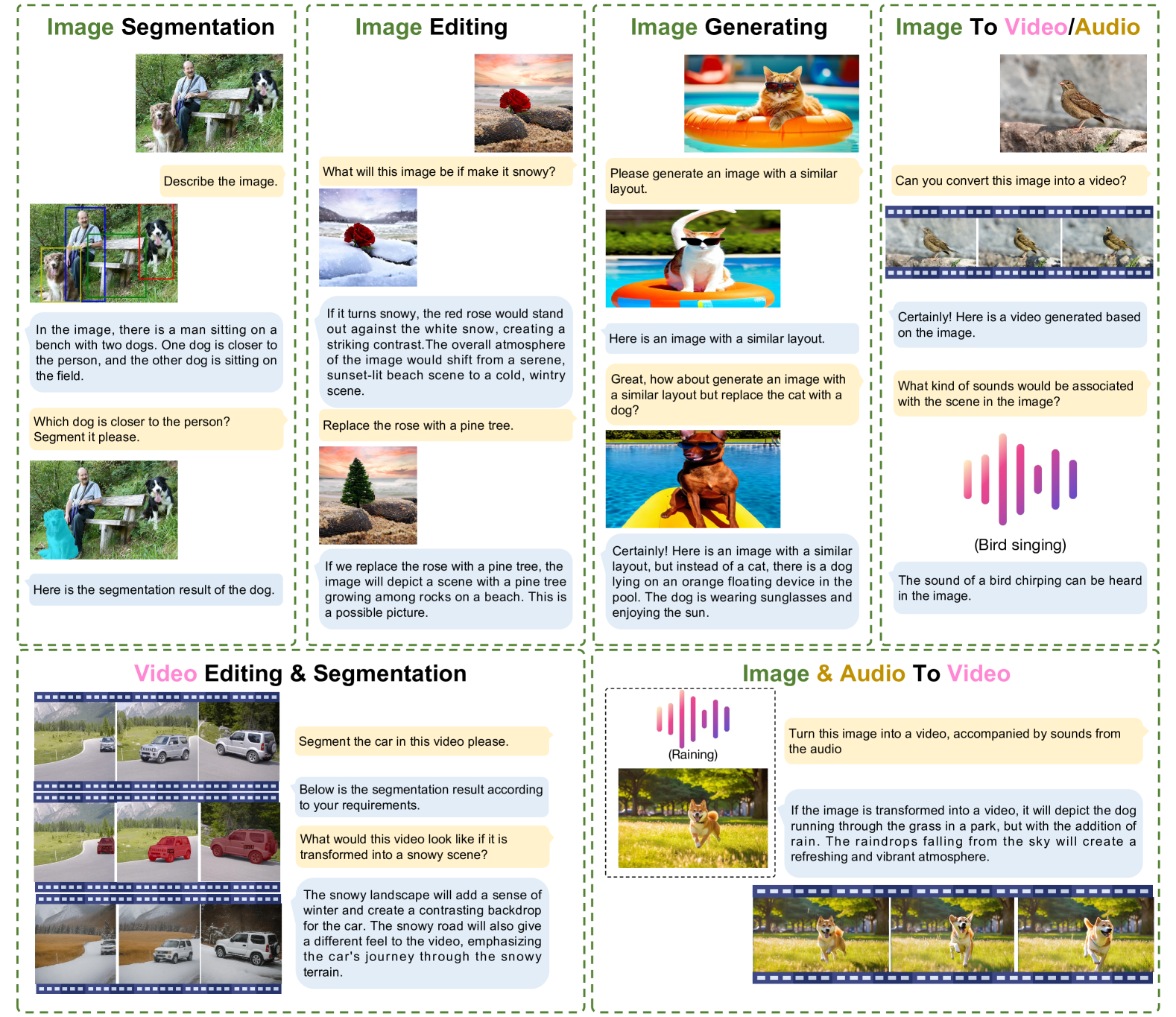

🖼️ 关键图片

📊 实验亮点

实验结果表明,UnifiedMLLM在多项任务上表现优异,超越了现有方法,尤其在复杂场景下的推理能力显著提升。具体性能数据未提供,但整体提升幅度显著,展示了该方法的有效性和可扩展性。

🎯 应用场景

UnifiedMLLM在多模态任务处理中的潜在应用广泛,包括智能助手、自动问答系统和多模态内容生成等领域。其统一表示方法能够有效提升模型在不同任务间的适应性,未来可能推动多模态人工智能的进一步发展。

📄 摘要(原文)

Significant advancements has recently been achieved in the field of multi-modal large language models (MLLMs), demonstrating their remarkable capabilities in understanding and reasoning across diverse tasks. However, these models are often trained for specific tasks and rely on task-specific input-output formats, limiting their applicability to a broader range of tasks. This raises a fundamental question: Can we develop a unified approach to represent and handle different multi-modal tasks to maximize the generalizability of MLLMs? In this paper, we propose UnifiedMLLM, a comprehensive model designed to represent various tasks using a unified representation. Our model exhibits strong capabilities in comprehending the implicit intent of user instructions and preforming reasoning. In addition to generating textual responses, our model also outputs task tokens and grounding tokens, serving as indicators of task types and task granularity. These outputs are subsequently routed through the task router and directed to specific expert models for task completion. To train our model, we construct a task-specific dataset and an 100k multi-task dataset encompassing complex scenarios. Employing a three-stage training strategy, we equip our model with robust reasoning and task processing capabilities while preserving its generalization capacity and knowledge reservoir. Extensive experiments showcase the impressive performance of our unified representation approach across various tasks, surpassing existing methodologies. Furthermore, our approach exhibits exceptional scalability and generality. Our code, model, and dataset will be available at \url{https://github.com/lzw-lzw/UnifiedMLLM}.