What if Red Can Talk? Dynamic Dialogue Generation Using Large Language Models

作者: Navapat Nananukul, Wichayaporn Wongkamjan

分类: cs.CL

发布日期: 2024-07-29

备注: ACL Wordplay 2024

💡 一句话要点

提出基于知识图谱增强的大语言模型对话生成框架,提升RPG游戏角色互动沉浸感。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话生成 大型语言模型 知识图谱 角色扮演游戏 游戏AI

📋 核心要点

- 现有RPG游戏中,角色对话主要依赖预先编写的脚本,缺乏动态性和个性化,限制了玩家的沉浸感。

- 该论文提出利用知识图谱增强的大语言模型,构建对话填充框架,动态生成符合角色个性的对话。

- 实验结果表明,GPT-4能够根据设定的角色个性生成对话,但对微妙性格的建模仍有提升空间。

📝 摘要(中文)

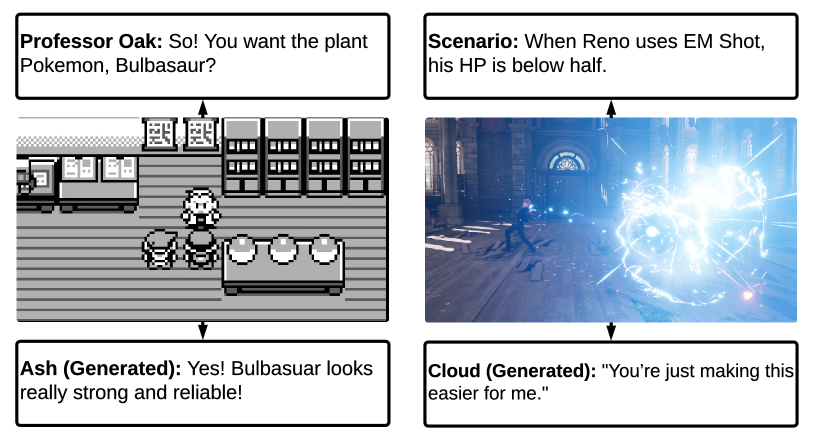

本文提出了一种对话填充框架,该框架利用大型语言模型(LLMs)并结合知识图谱,旨在生成动态且符合语境的角色互动,从而增强角色扮演游戏(RPGs)的玩家沉浸感。在《最终幻想VII 重制版》和《宝可梦》的环境中测试了该框架,通过定性和定量证据表明,GPT-4 能够以设定的个性进行角色扮演并生成对话。然而,研究也发现了一些缺陷,例如 GPT-4 倾向于过于积极,或者成熟等微妙性格的生成质量低于胆怯等明显特征。本研究旨在帮助开发者制作更细致的填充对话,从而丰富玩家的沉浸感并提升整体 RPG 体验。

🔬 方法详解

问题定义:现有RPG游戏中的角色对话主要依赖于预先编写的脚本,这些脚本缺乏动态性和上下文适应性,难以满足玩家对个性化和沉浸式游戏体验的需求。尤其是在非主线剧情的填充对话中,对话的单调和重复会显著降低玩家的参与感。因此,如何生成动态、符合角色个性和游戏环境的对话,是提升RPG游戏体验的关键问题。

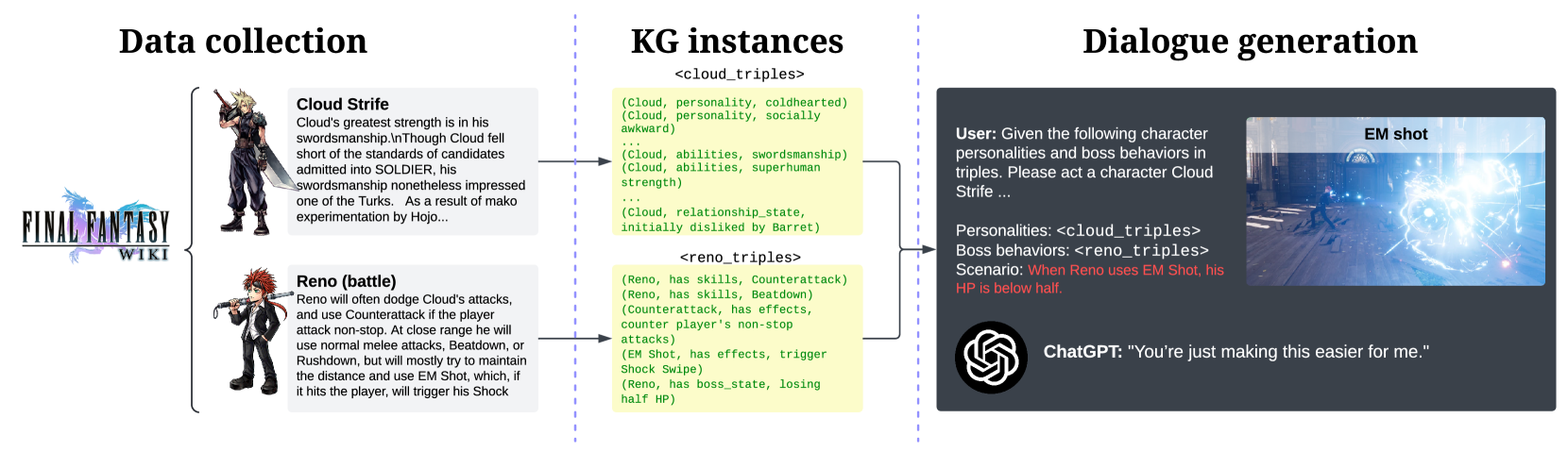

核心思路:该论文的核心思路是利用大型语言模型(LLMs)强大的生成能力,并结合知识图谱来增强LLMs对游戏世界和角色个性的理解,从而生成更具上下文相关性和角色一致性的对话。通过知识图谱,LLMs可以更好地理解角色之间的关系、游戏世界的背景知识,以及角色的性格特征,从而生成更自然、更符合游戏设定的对话。

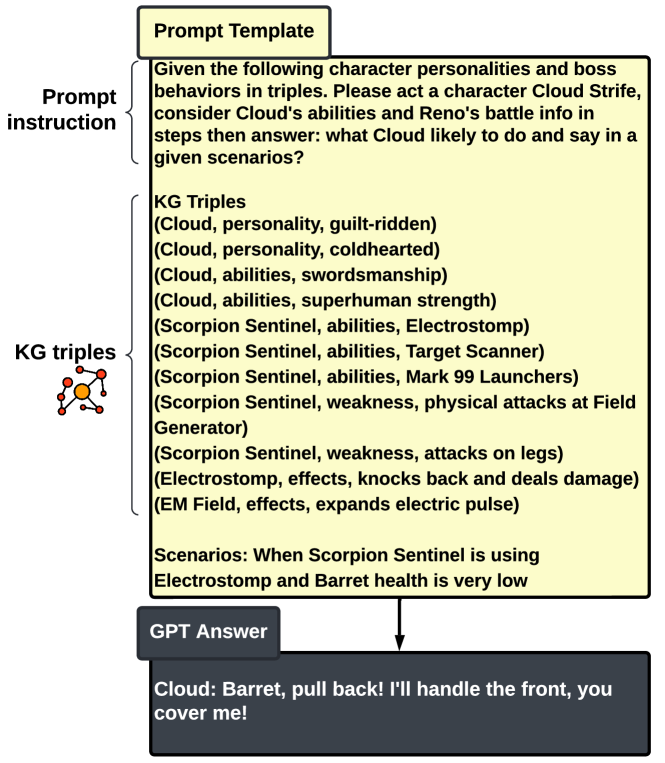

技术框架:该对话填充框架主要包含以下几个模块:1) 角色和世界知识图谱构建模块:用于构建游戏世界和角色的知识图谱,包含角色关系、背景故事、性格特征等信息。2) 上下文信息提取模块:用于从游戏环境中提取当前对话的上下文信息,包括对话历史、角色位置、游戏事件等。3) LLM对话生成模块:利用LLM(如GPT-4)结合知识图谱和上下文信息,生成符合角色个性的对话。4) 对话评估模块:用于评估生成对话的质量,包括流畅度、相关性、角色一致性等。

关键创新:该论文的关键创新在于将知识图谱与大型语言模型相结合,用于动态对话生成。与传统的基于规则或模板的对话生成方法相比,该方法能够生成更自然、更具上下文相关性的对话。此外,该方法还能够根据角色个性生成不同的对话风格,从而增强玩家的沉浸感。

关键设计:在知识图谱构建方面,需要仔细设计实体和关系的类型,以确保能够充分表达游戏世界和角色的信息。在LLM对话生成方面,需要设计合适的prompt,将知识图谱和上下文信息有效地输入到LLM中。同时,需要对LLM的生成结果进行后处理,以确保对话的流畅性和一致性。论文中未提及具体的参数设置、损失函数或网络结构等细节,这些可能是基于GPT-4的固有能力,而没有进行额外的训练或调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPT-4在《最终幻想VII 重制版》和《宝可梦》等游戏中,能够根据设定的角色个性生成对话,证明了该框架的有效性。定性分析表明,生成的对话具有较高的流畅性和相关性,能够较好地模拟角色的性格特征。定量分析也表明,生成的对话在角色一致性方面表现良好。但研究也发现,GPT-4在处理微妙性格时表现不如明显性格,仍有提升空间。

🎯 应用场景

该研究成果可广泛应用于角色扮演游戏、虚拟现实、智能客服等领域。在RPG游戏中,可以用于生成更丰富的角色互动,提升玩家的沉浸感和游戏体验。在虚拟现实中,可以用于创建更逼真的虚拟角色,增强用户的交互体验。在智能客服领域,可以用于生成更自然、更个性化的对话,提升用户的满意度。未来,该技术有望应用于更广泛的人机交互场景,例如教育、娱乐等。

📄 摘要(原文)

Role-playing games (RPGs) provide players with a rich, interactive world to explore. Dialogue serves as the primary means of communication between developers and players, manifesting in various forms such as guides, NPC interactions, and storytelling. While most games rely on written scripts to define the main story and character personalities, player immersion can be significantly enhanced through casual interactions between characters. With the advent of large language models (LLMs), we introduce a dialogue filler framework that utilizes LLMs enhanced by knowledge graphs to generate dynamic and contextually appropriate character interactions. We test this framework within the environments of Final Fantasy VII Remake and Pokemon, providing qualitative and quantitative evidence that demonstrates GPT-4's capability to act with defined personalities and generate dialogue. However, some flaws remain, such as GPT-4 being overly positive or more subtle personalities, such as maturity, tend to be of lower quality compared to more overt traits like timidity. This study aims to assist developers in crafting more nuanced filler dialogues, thereby enriching player immersion and enhancing the overall RPG experience.