Modular RAG: Transforming RAG Systems into LEGO-like Reconfigurable Frameworks

作者: Yunfan Gao, Yun Xiong, Meng Wang, Haofen Wang

分类: cs.CL, cs.AI, cs.IR

发布日期: 2024-07-26

💡 一句话要点

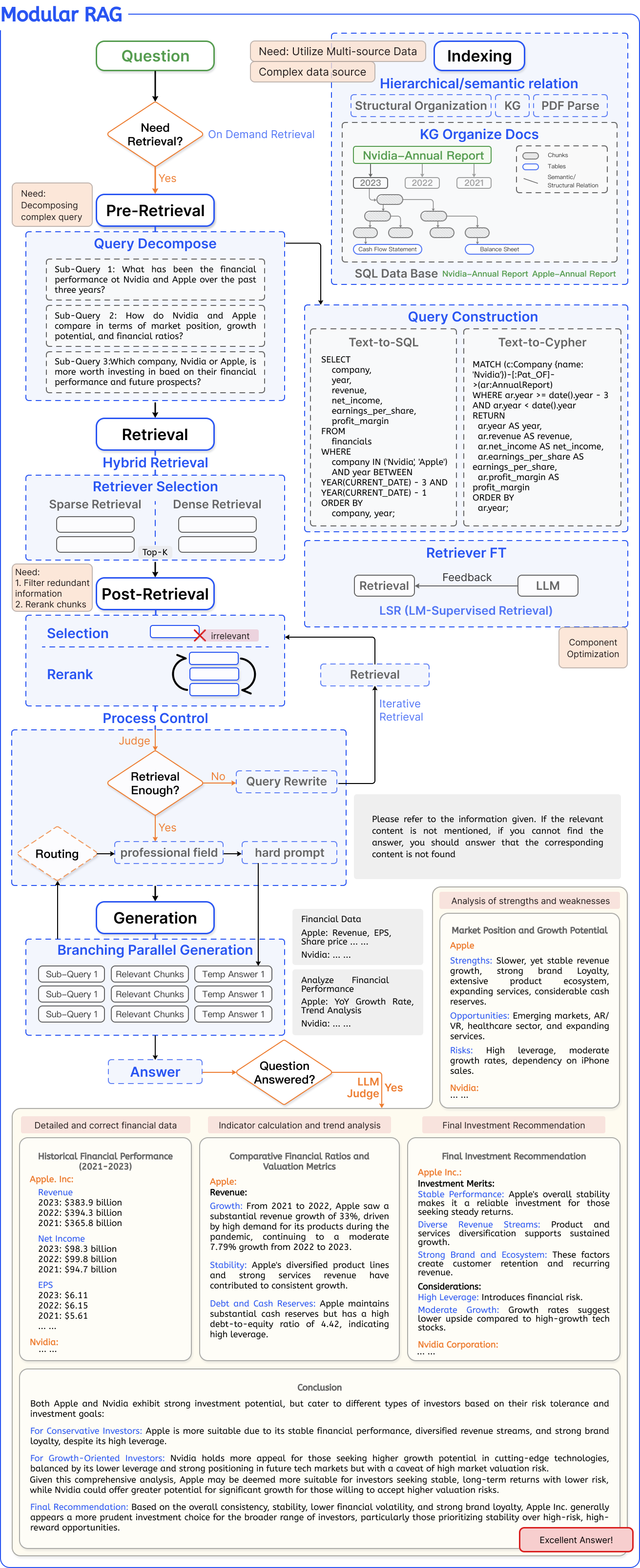

提出模块化RAG框架,将RAG系统重构为乐高式可配置框架,提升灵活性和可扩展性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 模块化设计 大型语言模型 可配置框架 知识密集型任务

📋 核心要点

- 现有RAG系统日益复杂,但缺乏统一的框架,难以适应快速发展的技术。

- 模块化RAG将复杂系统分解为独立模块和算子,实现高度可配置的框架。

- 该框架集成了路由、调度和融合机制,支持线性、条件、分支和循环等多种RAG模式。

📝 摘要(中文)

检索增强生成(RAG)显著增强了大型语言模型(LLM)在知识密集型任务中的能力。应用场景的日益增长的需求推动了RAG的演进,促使高级检索器、LLM和其他互补技术的集成,这也增加了RAG系统的复杂性。然而,快速的进步超过了基础RAG范式,许多方法难以在“检索-然后-生成”的过程中统一。在此背景下,本文研究了现有RAG范式的局限性,并介绍了模块化RAG框架。通过将复杂的RAG系统分解为独立的模块和专门的算子,它促进了一个高度可重构的框架。模块化RAG超越了传统的线性架构,采用了一种更先进的设计,集成了路由、调度和融合机制。借鉴广泛的研究,本文进一步确定了流行的RAG模式——线性、条件、分支和循环——并全面分析了它们各自的实现细微之处。模块化RAG为RAG系统的概念化和部署提供了创新的机会。最后,本文探讨了新的算子和范式可能出现的潜力,为RAG技术的持续发展和实际部署奠定了坚实的理论基础和实践路线图。

🔬 方法详解

问题定义:现有RAG系统日益复杂,集成了各种检索器、LLM和其他技术,但缺乏一个统一的、可重构的框架。传统的“检索-然后-生成”范式难以涵盖所有新的RAG方法,限制了RAG系统的灵活性和可扩展性。现有方法难以适应快速变化的应用场景和技术发展。

核心思路:核心思路是将RAG系统解耦为多个独立的、可插拔的模块,每个模块执行特定的功能(例如,检索、重排序、生成)。通过定义标准化的接口和协议,这些模块可以灵活地组合和配置,形成各种不同的RAG流程。这种模块化的设计使得RAG系统更容易扩展、定制和维护。

技术框架:模块化RAG框架包含以下主要模块:1) 数据源模块:负责管理和索引知识库;2) 检索模块:根据查询检索相关文档;3) 重排序模块:对检索结果进行排序和过滤;4) 生成模块:利用LLM生成最终答案;5) 路由模块:根据查询类型或上下文选择合适的模块组合;6) 调度模块:控制模块的执行顺序和资源分配;7) 融合模块:将不同模块的输出进行融合。这些模块通过定义好的API进行交互,可以灵活地组合成不同的RAG流程。

关键创新:最重要的创新点在于将RAG系统从一个固定的线性流程转变为一个可配置的模块化框架。通过引入路由、调度和融合机制,模块化RAG可以支持更复杂的RAG模式,例如条件RAG、分支RAG和循环RAG。与传统的RAG方法相比,模块化RAG具有更高的灵活性、可扩展性和可维护性。

关键设计:关键设计包括:1) 定义标准化的模块接口,确保模块之间的互操作性;2) 设计灵活的路由策略,根据查询类型选择合适的模块组合;3) 实现高效的调度算法,优化模块的执行顺序和资源分配;4) 开发有效的融合方法,将不同模块的输出进行整合。具体的参数设置、损失函数和网络结构取决于各个模块的具体实现。

🖼️ 关键图片

📊 实验亮点

论文提出了模块化RAG框架,通过将RAG系统分解为独立的模块和算子,实现了高度可重构的框架。虽然摘要中没有明确提及实验结果,但该框架为RAG系统的概念化和部署提供了创新的机会,并为RAG技术的持续发展和实际部署奠定了坚实的理论基础和实践路线图。未来的研究可以集中在评估不同模块组合和配置对RAG性能的影响。

🎯 应用场景

模块化RAG框架可广泛应用于知识密集型任务,如问答系统、文档摘要、代码生成等。它能够根据不同的应用场景和数据特点,灵活地配置RAG流程,提高系统的性能和效率。该框架还可用于构建个性化的RAG系统,根据用户的知识背景和偏好,定制检索和生成策略。未来,模块化RAG有望成为构建下一代智能应用的关键技术。

📄 摘要(原文)

Retrieval-augmented Generation (RAG) has markedly enhanced the capabilities of Large Language Models (LLMs) in tackling knowledge-intensive tasks. The increasing demands of application scenarios have driven the evolution of RAG, leading to the integration of advanced retrievers, LLMs and other complementary technologies, which in turn has amplified the intricacy of RAG systems. However, the rapid advancements are outpacing the foundational RAG paradigm, with many methods struggling to be unified under the process of "retrieve-then-generate". In this context, this paper examines the limitations of the existing RAG paradigm and introduces the modular RAG framework. By decomposing complex RAG systems into independent modules and specialized operators, it facilitates a highly reconfigurable framework. Modular RAG transcends the traditional linear architecture, embracing a more advanced design that integrates routing, scheduling, and fusion mechanisms. Drawing on extensive research, this paper further identifies prevalent RAG patterns-linear, conditional, branching, and looping-and offers a comprehensive analysis of their respective implementation nuances. Modular RAG presents innovative opportunities for the conceptualization and deployment of RAG systems. Finally, the paper explores the potential emergence of new operators and paradigms, establishing a solid theoretical foundation and a practical roadmap for the continued evolution and practical deployment of RAG technologies.