Every Part Matters: Integrity Verification of Scientific Figures Based on Multimodal Large Language Models

作者: Xiang Shi, Jiawei Liu, Yinpeng Liu, Qikai Cheng, Wei Lu

分类: cs.CL, cs.AI, cs.CV, cs.DL, cs.MM

发布日期: 2024-07-26

备注: 28 pages, 11 figures, under review

💡 一句话要点

提出EPM框架,利用多模态大语言模型验证科学图中图文一致性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 图文一致性验证 科学图形理解 Figure Integrity Verification 增量式对齐 类比推理 Figure-seg数据集

📋 核心要点

- 现有方法在理解科学图形时,对图文细粒度对齐能力不足,难以处理复杂图形。

- EPM框架利用多模态大语言模型,通过增量式对齐和类比推理,提升图文一致性验证的精度。

- 实验表明,EPM框架显著优于现有方法,能够更精确地分析复杂科学图形。

📝 摘要(中文)

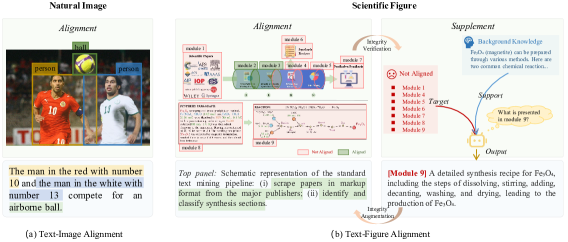

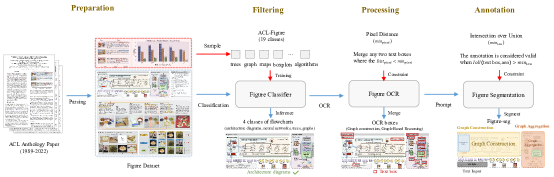

本文旨在解决科学图理解中的一个关键问题:文本与图形的细粒度对齐。现有研究主要集中在简单的、数据驱动的可视化(如条形图和饼图),并且仅通过标题和分类提供对图表的基本理解。为此,我们引入了一项新任务:图形完整性验证,旨在评估技术在对齐科学图中文本知识与视觉元素方面的精确性。为了支持这项任务,我们开发了一种半自动方法来构建大规模数据集Figure-seg。此外,我们提出了一个创新框架Every Part Matters (EPM),它利用多模态大语言模型(MLLM),不仅逐步提高文本-图形完整性的对齐和验证,而且通过类比推理来增强完整性。综合实验表明,这些创新显著优于现有方法,从而能够更精确、更彻底地分析复杂的科学图形。这一进展不仅加深了我们对多模态技术的理解,而且促进了需要精确解释复杂视觉数据的领域中的进一步研究和实际应用。

🔬 方法详解

问题定义:论文旨在解决科学图中图文一致性验证问题。现有方法主要关注简单图表,缺乏对复杂科学图中细粒度文本和视觉元素对齐的精确验证能力,难以保证科学结论的可靠性。

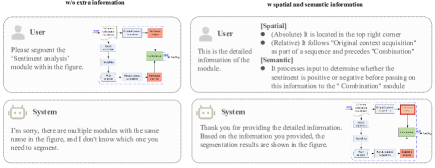

核心思路:论文的核心思路是利用多模态大语言模型(MLLM)的强大理解和推理能力,将文本信息和视觉信息进行深度融合,通过增量式对齐和类比推理,提高图文一致性验证的准确性。这种方法能够更好地捕捉图表中各个部分的细节信息,从而更全面地评估图表的完整性。

技术框架:EPM框架包含以下主要模块:1) 数据集构建模块,用于构建大规模的Figure-seg数据集,包含图文对齐标注信息;2) 多模态大语言模型,作为核心推理引擎,用于融合文本和视觉信息;3) 增量式对齐模块,逐步提高文本和图形的对齐精度;4) 类比推理模块,通过类比推理增强图文一致性验证能力。整体流程是:输入科学图形及其相关文本,通过MLLM进行特征提取和融合,然后通过增量式对齐和类比推理模块进行图文一致性验证,最终输出验证结果。

关键创新:论文的关键创新在于提出了Figure Integrity Verification任务,并设计了EPM框架。EPM框架利用MLLM进行图文融合和推理,并通过增量式对齐和类比推理进一步提升验证精度。与现有方法相比,EPM框架能够更精确地分析复杂科学图形,并提供更可靠的图文一致性验证结果。

关键设计:论文采用半自动方法构建Figure-seg数据集,保证数据质量和规模。在MLLM的选择上,可能采用了预训练的多模态模型,并针对科学图形的特点进行了微调。增量式对齐模块和类比推理模块的具体实现细节未知,可能涉及到特定的损失函数设计和网络结构优化。

🖼️ 关键图片

📊 实验亮点

论文提出了Figure Integrity Verification任务和EPM框架,并在Figure-seg数据集上进行了实验验证。实验结果表明,EPM框架显著优于现有方法,能够更精确地分析复杂科学图形,提升幅度未知,但摘要中强调了“substantially improve upon existing methods”。

🎯 应用场景

该研究成果可应用于科学论文审稿、科研数据分析、医学图像诊断等领域,有助于提高科学研究的可靠性和效率。通过自动化的图文一致性验证,可以减少人工审核的工作量,并降低因图形错误导致的科研风险。未来,该技术有望应用于更广泛的视觉信息理解和知识发现场景。

📄 摘要(原文)

This paper tackles a key issue in the interpretation of scientific figures: the fine-grained alignment of text and figures. It advances beyond prior research that primarily dealt with straightforward, data-driven visualizations such as bar and pie charts and only offered a basic understanding of diagrams through captioning and classification. We introduce a novel task, Figure Integrity Verification, designed to evaluate the precision of technologies in aligning textual knowledge with visual elements in scientific figures. To support this, we develop a semi-automated method for constructing a large-scale dataset, Figure-seg, specifically designed for this task. Additionally, we propose an innovative framework, Every Part Matters (EPM), which leverages Multimodal Large Language Models (MLLMs) to not only incrementally improve the alignment and verification of text-figure integrity but also enhance integrity through analogical reasoning. Our comprehensive experiments show that these innovations substantially improve upon existing methods, allowing for more precise and thorough analysis of complex scientific figures. This progress not only enhances our understanding of multimodal technologies but also stimulates further research and practical applications across fields requiring the accurate interpretation of complex visual data.