Boosting Large Language Models with Socratic Method for Conversational Mathematics Teaching

作者: Yuyang Ding, Hanglei Hu, Jie Zhou, Qin Chen, Bo Jiang, Liang He

分类: cs.CL

发布日期: 2024-07-24

备注: Accepted By CIKM 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出SocraticLLM以提升数学教学效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数学教学 苏格拉底教学法 知识增强 对话系统

📋 核心要点

- 现有的数学推理方法主要集中在解决方案的提供,缺乏引导学习者深入思考的能力。

- 本文提出了一种基于苏格拉底教学法的LLM,旨在通过对话促进学习者的自我发现和深刻理解。

- 实验结果显示,SocraticLLM在生成可靠响应方面优于多种强大的生成模型,展现出显著的优势。

📝 摘要(中文)

随着大型语言模型(LLMs)的引入,自动数学推理取得了显著成功。然而,现有方法主要集中在提供解决方案或使用链式思维等技术来提高问题解决的准确性。本文关注通过基于苏格拉底教学法的LLM(SocraticLLM)来改善数学教学能力,该模型通过对话引导学习者进行深刻思考和自我发现。我们收集并发布了一个高质量的数学教学数据集SocraticMATH,提供了带有额外知识的苏格拉底式问题对话。此外,我们提出了一种知识增强的LLM作为强基线,能够生成可靠的响应,包括审查、指导/启发、纠正和总结。实验结果表明,SocraticLLM在与多种强生成模型的比较中表现出显著优势。

🔬 方法详解

问题定义:本文旨在解决现有数学教学方法缺乏引导学习者深入思考的问题。现有方法往往只关注提供答案,未能有效促进学习者的理解和思考能力。

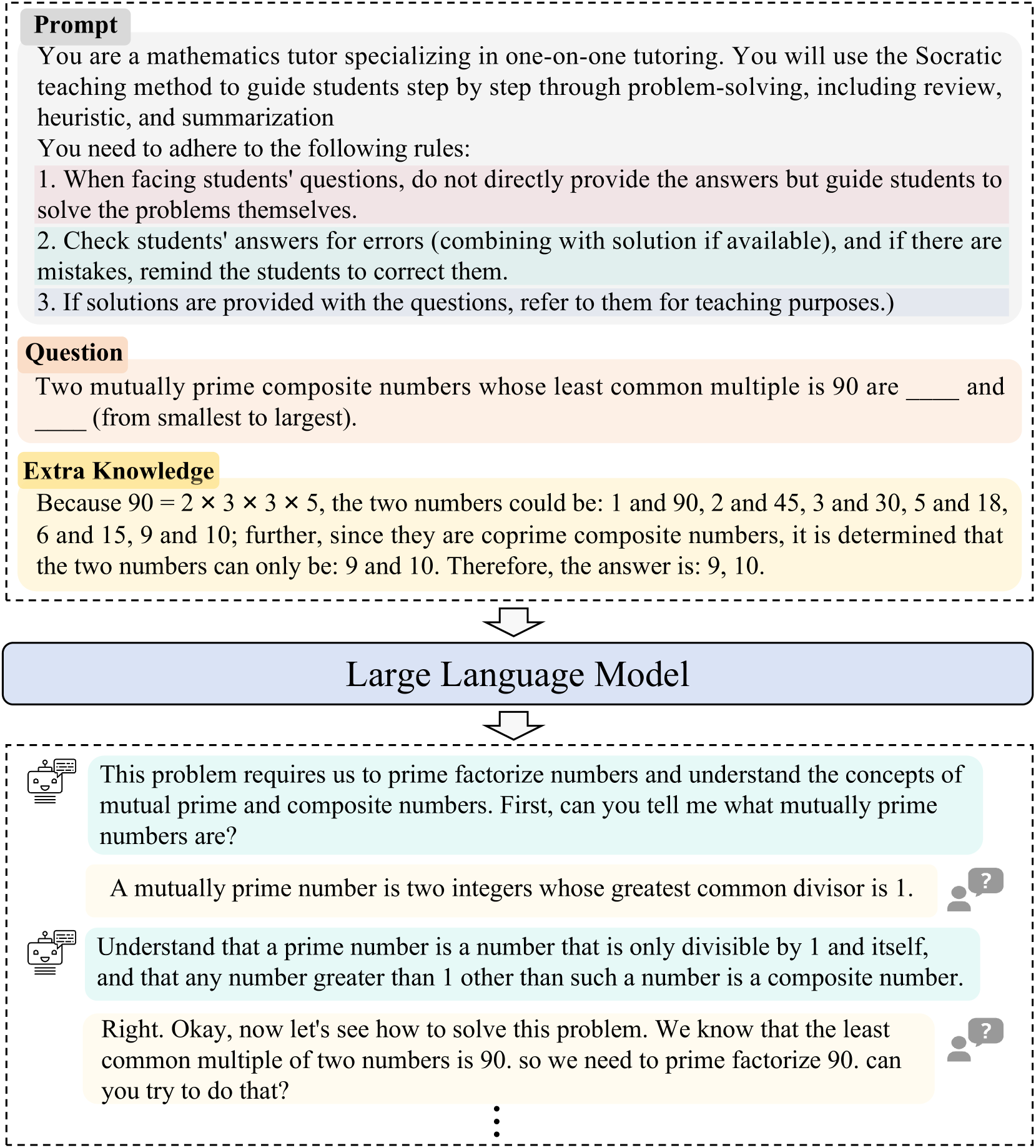

核心思路:论文提出的SocraticLLM通过苏格拉底教学法引导学习者进行对话式学习,强调自我发现和深刻思考,从而提升数学教学的效果。

技术框架:SocraticLLM的整体架构包括数据集SocraticMATH的构建、知识增强的LLM设计,以及生成响应的多个模块,如审查、指导、纠正和总结。

关键创新:最重要的创新在于将苏格拉底教学法与大型语言模型结合,形成了一种新的教学方法,区别于传统的直接解答方式,强调学习者的主动参与。

关键设计:在模型设计中,采用了知识增强机制,确保生成的响应不仅准确,还能提供额外的知识支持。损失函数和网络结构经过精心设计,以优化模型在对话生成中的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SocraticLLM在与多种强生成模型的比较中,生成的响应在准确性和深度上均有显著提升,具体性能数据未详述,但实验显示其在数学教学中的应用效果优于传统方法。

🎯 应用场景

该研究的潜在应用领域包括教育技术、在线学习平台和智能辅导系统。通过提升数学教学效果,SocraticLLM可以帮助学生更好地理解复杂的数学概念,促进自主学习,未来可能对教育行业产生深远影响。

📄 摘要(原文)

With the introduction of large language models (LLMs), automatic math reasoning has seen tremendous success. However, current methods primarily focus on providing solutions or using techniques like Chain-of-Thought to enhance problem-solving accuracy. In this paper, we focus on improving the capability of mathematics teaching via a Socratic teaching-based LLM (\texttt{SocraticLLM}), which guides learners toward profound thinking with clarity and self-discovery via conversation. We collect and release a high-quality mathematical teaching dataset, named \texttt{SocraticMATH}, which provides Socratic-style conversations of problems with extra knowledge. Also, we propose a knowledge-enhanced LLM as a strong baseline to generate reliable responses with review, guidance/heuristic, rectification, and summarization. Experimental results show the great advantages of \texttt{SocraticLLM} by comparing it with several strong generative models. The codes and datasets are available on \url{https://github.com/ECNU-ICALK/SocraticMath}.