Unipa-GPT: Large Language Models for university-oriented QA in Italian

作者: Irene Siragusa, Roberto Pirrone

分类: cs.CL

发布日期: 2024-07-19 (更新: 2025-04-17)

备注: GitHub repository: https://github.com/CHILab1/UnipaGPT-23

期刊: IJCoL [Online], 10-2, (2024)

DOI: 10.17454/IJCOL102.06

💡 一句话要点

Unipa-GPT:基于大型语言模型的意大利语大学问答系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 智能问答系统 检索增强生成 微调 意大利语 大学招生 GPT-3.5-turbo

📋 核心要点

- 现有大学招生咨询系统智能化程度不足,难以满足学生个性化需求,存在信息检索效率低等问题。

- Unipa-GPT利用GPT-3.5-turbo,结合RAG和微调技术,构建智能问答系统,提升信息检索和问题解答的准确性。

- 实验结果表明,Unipa-GPT在特定任务上表现良好,并在欧洲研究者之夜进行了展示,验证了其有效性。

📝 摘要(中文)

本文介绍了Unipa-GPT的架构和训练过程,这是一个基于大型语言模型的聊天机器人,旨在帮助学生在巴勒莫大学选择学士/硕士学位课程。Unipa-GPT基于gpt-3.5-turbo构建,并在欧洲研究者之夜(SHARPER night)上进行了展示。在我们的实验中,我们采用了检索增强生成(RAG)方法和微调来开发该系统。本文介绍了Unipa-GPT的整体架构,比较了RAG和微调系统,并简要讨论了它们的性能。此外,还展示了与其他大型语言模型的比较以及SHARPER night期间的实验结果。语料库和代码可在GitHub上获取。

🔬 方法详解

问题定义:论文旨在构建一个面向巴勒莫大学的智能问答系统,帮助学生选择合适的学士/硕士学位课程。现有方法在处理特定领域知识和意大利语语境下的问答效果不佳,难以提供个性化和准确的建议。

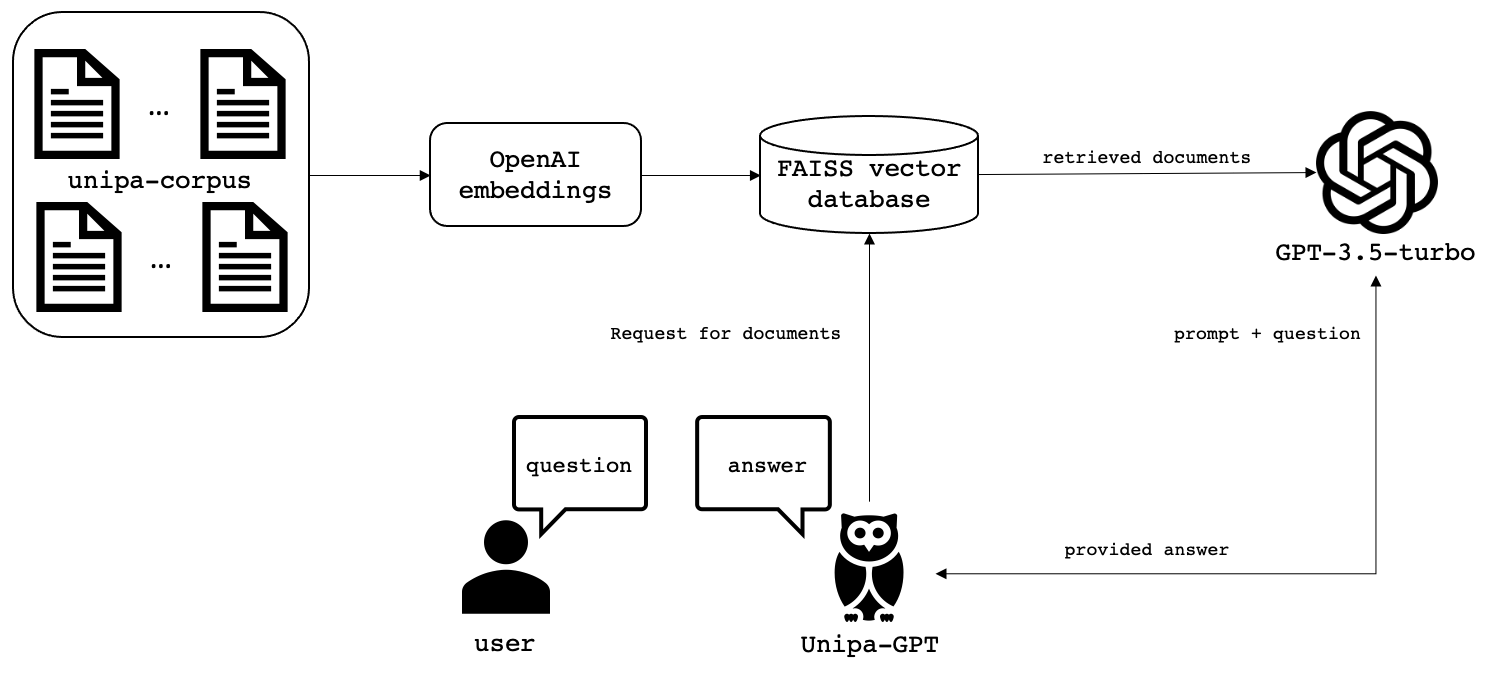

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大能力,结合检索增强生成(RAG)和微调技术,使模型能够更好地理解和回答与大学课程相关的问题。RAG用于从相关文档中检索信息,微调用于使模型适应特定任务和领域。

技术框架:Unipa-GPT的整体架构包括以下几个主要模块:1) 数据收集和预处理:收集巴勒莫大学的课程信息、招生政策等相关文档,并进行清洗和格式化。2) 检索模块:使用RAG方法,根据用户的问题检索相关的文档片段。3) 生成模块:使用GPT-3.5-turbo模型,结合检索到的信息生成答案。4) 微调模块:使用收集到的数据对GPT-3.5-turbo模型进行微调,使其更好地适应大学问答任务。

关键创新:该研究的关键创新在于将RAG和微调技术相结合,应用于意大利语的大学问答场景。通过RAG,模型可以利用外部知识库,避免生成不准确或过时的信息。通过微调,模型可以更好地理解特定领域的术语和表达方式,提高问答的准确性和流畅性。

关键设计:在RAG模块中,使用了余弦相似度来衡量问题和文档片段之间的相关性。在微调模块中,使用了交叉熵损失函数来优化模型参数。具体的参数设置和训练策略在论文中没有详细说明。

🖼️ 关键图片

📊 实验亮点

论文比较了RAG和微调两种方法的性能,并与其他大型语言模型进行了对比。此外,Unipa-GPT在欧洲研究者之夜进行了展示,收集了用户反馈,验证了其在实际应用中的有效性。具体的性能数据和对比结果在论文中没有详细说明。

🎯 应用场景

Unipa-GPT可应用于大学招生咨询、学生服务等领域,为学生提供个性化的课程推荐和问题解答。该研究的实际价值在于提高招生效率、提升学生满意度,并为其他大学构建类似系统提供参考。未来,该系统可以扩展到其他语言和领域,例如职业咨询、法律咨询等。

📄 摘要(原文)

This paper illustrates the architecture and training of Unipa-GPT, a chatbot relying on a Large Language Model, developed for assisting students in choosing a bachelor/master degree course at the University of Palermo. Unipa-GPT relies on gpt-3.5-turbo, it was presented in the context of the European Researchers' Night (SHARPER night). In our experiments we adopted both the Retrieval Augmented Generation (RAG) approach and fine-tuning to develop the system. The whole architecture of Unipa-GPT is presented, both the RAG and the fine-tuned systems are compared, and a brief discussion on their performance is reported. Further comparison with other Large Language Models and the experimental results during the SHARPER night are illustrated. Corpora and code are available on GitHub