From Words to Worlds: Compositionality for Cognitive Architectures

作者: Ruchira Dhar, Anders Søgaard

分类: cs.CL, cs.AI, cs.CY, cs.LG, cs.SC

发布日期: 2024-07-18

备注: Accepted to ICML 2024 Workshop on LLMs & Cognition

💡 一句话要点

研究LLM的组合性学习能力,揭示规模化与指令调优的微妙影响。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 组合性 指令调优 规模化 认知架构

📋 核心要点

- 现有研究对LLM的组合性能力理解不足,缺乏系统性的评估和分析。

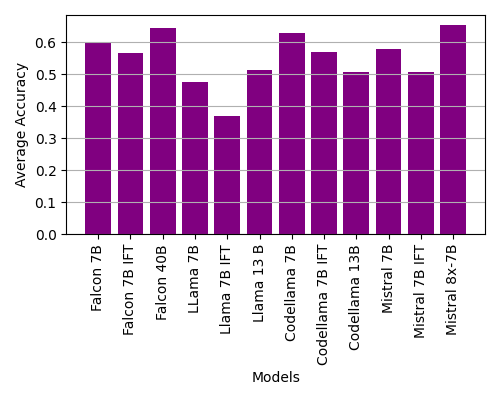

- 通过跨多个LLM家族和任务的实验,深入分析规模化和指令调优对组合性学习的影响。

- 实验结果表明,规模化通常增强组合性,而指令调优可能降低组合性,揭示了二者之间的微妙关系。

📝 摘要(中文)

大型语言模型(LLM)是高性能的连接主义系统,但它们是否展现出更强的组合性?更重要的是,这是否是它们表现如此出色的原因之一?本文对四个LLM家族(12个模型)和三个任务类别进行了实证分析,包括一项新颖的任务。研究结果揭示了LLM在组合策略学习中存在细微的关系——虽然规模化增强了组合能力,但指令调优往往会产生相反的效果。这种差异引出了一些关于大型语言模型开发和改进以符合人类认知能力的开放性问题。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLM)是否具备组合性,以及这种组合性是否是其高性能的原因之一。现有方法缺乏对LLM组合性学习的深入理解,特别是规模化和指令调优对其影响的系统性分析。

核心思路:论文的核心思路是通过设计实验,评估LLM在不同任务上的组合性能力,并分析模型规模和指令调优对组合性学习的影响。通过比较不同模型家族和任务类别,揭示LLM组合性学习的内在机制。

技术框架:论文的技术框架主要包括以下几个部分:1) 选择四个LLM家族(共12个模型);2) 设计三个任务类别,包括一项新颖的任务,用于评估组合性;3) 对每个模型在不同任务上进行实验,并记录性能数据;4) 分析实验结果,比较不同模型和任务之间的差异,评估规模化和指令调优对组合性学习的影响。

关键创新:论文的关键创新在于:1) 系统性地研究了LLM的组合性学习能力,并揭示了规模化和指令调优的微妙影响;2) 设计了一项新颖的任务,用于更有效地评估LLM的组合性;3) 通过跨多个LLM家族和任务的实验,提供了更全面的分析结果。

关键设计:论文的关键设计包括:1) 任务的设计,需要能够有效衡量模型的组合性能力;2) 模型选择,需要覆盖不同规模和架构的LLM;3) 实验设置,需要控制变量,确保结果的可靠性;4) 分析方法,需要能够区分规模化和指令调优对组合性的不同影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM的规模化通常能够增强其组合性能力,但指令调优可能会产生相反的效果。这一发现挑战了以往对LLM的认知,并为未来的研究提供了新的方向。具体的性能数据和提升幅度在论文中进行了详细的展示。

🎯 应用场景

该研究成果可应用于指导LLM的开发和改进,使其更符合人类认知能力。通过理解规模化和指令调优对组合性的影响,可以更好地设计训练策略,提高LLM在复杂任务中的表现。此外,该研究还有助于开发更可靠、更可解释的AI系统。

📄 摘要(原文)

Large language models (LLMs) are very performant connectionist systems, but do they exhibit more compositionality? More importantly, is that part of why they perform so well? We present empirical analyses across four LLM families (12 models) and three task categories, including a novel task introduced below. Our findings reveal a nuanced relationship in learning of compositional strategies by LLMs -- while scaling enhances compositional abilities, instruction tuning often has a reverse effect. Such disparity brings forth some open issues regarding the development and improvement of large language models in alignment with human cognitive capacities.